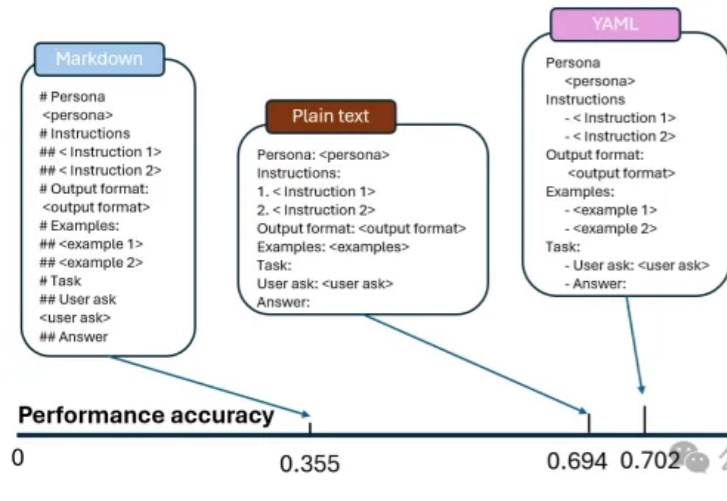

微软和麻省理工权威发布:Prompt格式显著影响LLM性能,JSON比Markdown准确性高42%

微软和麻省理工权威发布:Prompt格式显著影响LLM性能,JSON比Markdown准确性高42%朋友们,想了解为什么同一模型会带来大量结果的不一致性吗?今天,我们来一起深入分析一下来自微软和麻省理工学院的一项重大发现——不同的Prompt格式如何显著影响LLM的输出精度。这些研究结果对于应用Prompt优化设计具有非常重要的应用价值。

搜索

搜索

朋友们,想了解为什么同一模型会带来大量结果的不一致性吗?今天,我们来一起深入分析一下来自微软和麻省理工学院的一项重大发现——不同的Prompt格式如何显著影响LLM的输出精度。这些研究结果对于应用Prompt优化设计具有非常重要的应用价值。

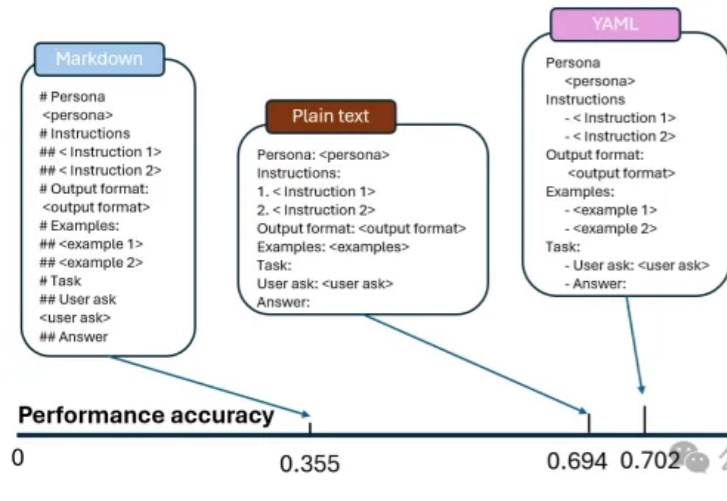

大模型在数学问题上的表现不佳,原因在于采取启发式算法进行数学运算的,通过定位到多层感知机(MLP)中的单个神经元,可以对进行数学运算的具体过程进行解释。

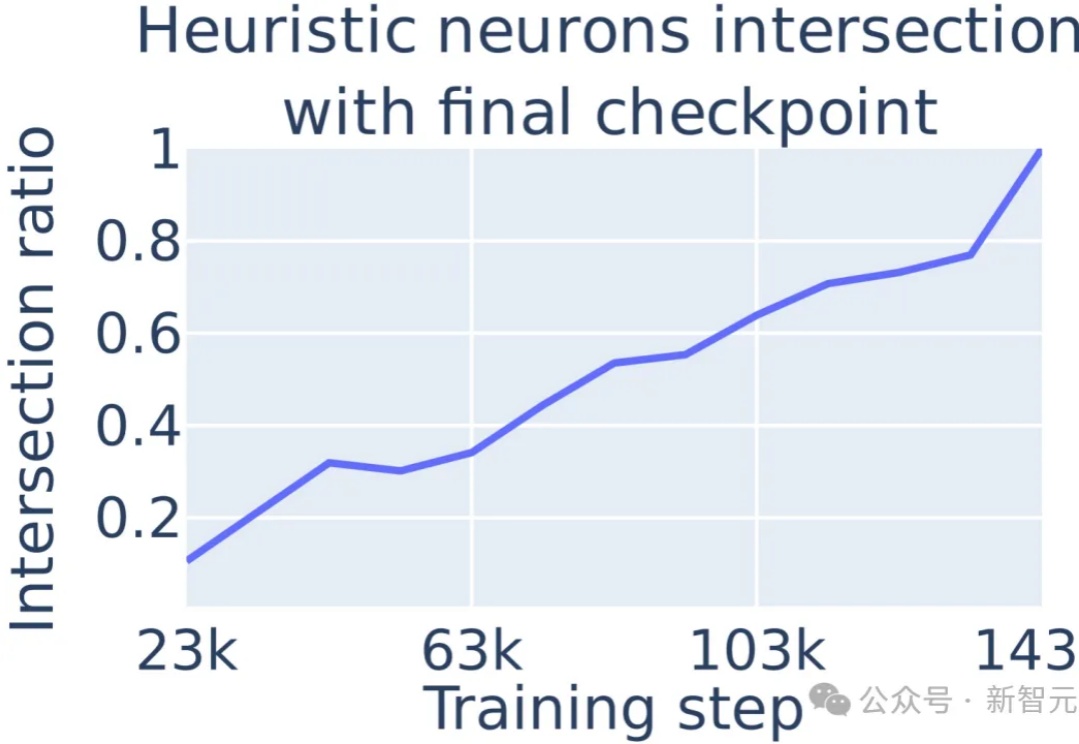

自我纠错(Self Correction)能力,传统上被视为人类特有的特征,正越来越多地在人工智能领域,尤其是大型语言模型(LLMs)中得到广泛应用,最近爆火的OpenAI o1模型[1]和Reflection 70B模型[2]都采取了自我纠正的方法。

自从生成式 AI 和 LLM 在世界舞台上占据中心位置以来,员工们一直在思考如何最好地将这些变革性的新工具应用于他们的工作流程。然而,他们中的许多人在尝试将生成式 AI 集成到企业环境中时遇到了类似的问题,例如隐私泄露、缺乏相关性以及需要更好的个性化结果。

一位AI从业者分享的14天学习路线图,涵盖大模型从基础到高级的主要关键概念!

最近,Nature上的一项研究,全面驳斥了LLM具有类人推理能力的说法。研究者设定的「人类亲吻难题」把7个大模型彻底绕晕。最终研究者表示,与其说LLM是科学理论,不如说它们更接近工具,比如广义导数。

利用概念激活向量破解大模型的安全对齐,揭示LLM重要安全风险漏洞。

预测金融市场和股票价格变动需分析公司表现、历史价格、行业事件及人类因素(如社交媒体和新闻报道)。

这篇文章获选 Neurips 2024 Spotlight,作者均来自于伊利诺伊大学香槟分校计算机系。第一作者是博士生林啸,指导老师是童行行教授。所在的 IDEA 实验室的研究兴趣涵盖图机器学习、可信机器学习、LLM 优化以及数据挖掘等方面。

受 ChatGPT 强大问答能力的影响,大型语言模型(LLM)提供商往往优化模型来回答人们的问题,以提供良好的消费者体验。