扩散模型成最快深度思考!告别自回归每秒1009个tokens,英伟达微软都投了

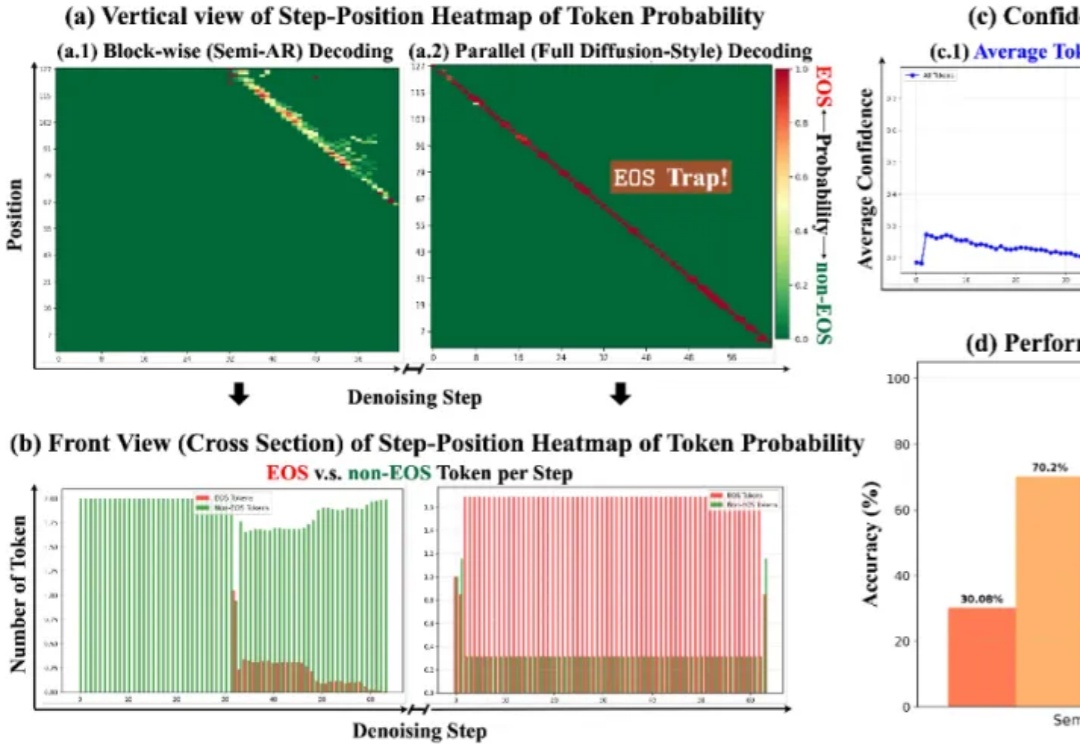

扩散模型成最快深度思考!告别自回归每秒1009个tokens,英伟达微软都投了前面已经说了,传统自回归就像打字机一样,一次只能处理一个token,且必须按照从左到右的顺序。但扩散模型Mercury 2的工作方式更像一位编辑——最终,Mercury 2能将生成速度提升5倍以上,且速度曲线截然不同。

前面已经说了,传统自回归就像打字机一样,一次只能处理一个token,且必须按照从左到右的顺序。但扩散模型Mercury 2的工作方式更像一位编辑——最终,Mercury 2能将生成速度提升5倍以上,且速度曲线截然不同。

扩散大语言模型得到了突飞猛进的发展,早在 25 年 2 月 Inception Labs 推出 Mercury—— 第一个商业级扩散大型语言模型,同期人民大学发布第一个开源 8B 扩散大语言模型 LLaDA,5 月份 Gemini Diffusion 也接踵而至。

刚刚,OpenAI内部秘密项目「Mercury」(水星)曝出!该项目正高薪招募百名前投行精英训练财务模型,旨在替代初级银行家的重复性工作。业内普遍认为,这是OpenAI在算力成本高企背景下,加速商业化与盈利的关键一步。

10月21日消息,据最新披露的文件显示,OpenAI正在秘密推进一项名为“水星项目”(Project Mercury)的绝密计划,已招募超过100名前投资银行家,协助训练AI系统构建复杂的金融模型,从而取代初级投行员工耗费大量时间的工作。

谁说扩散模型只能生成图像和视频?现在它们能高质量地写代码了,速度还比传统大模型更快!Inception Labs推出基于扩散技术的全新商业级大语言模型——Mercury。

AI 会计初创公司 Campfire 于 6 月 30 日宣布完成 3500 万美元 A 轮融资,由 Accel 领投,Foundation Capital、Y Combinator、Capital 49 以及 Mercury 首席财务官 Dan Kang 等天使投资人跟投。

只需一眨眼的功夫,Mercury 就把任务完成了。「我们非常高兴地推出 Mercury,这是首款专为聊天应用量身定制的商业级扩散 LLM!Mercury 速度超快,效率超高,能够为对话带来实时响应,就像 Mercury Coder 为代码带来的体验一样。」

最近,扩散语言模型(dLLM)有点火。现在,苹果也加入这片新兴的战场了。

ChatGPT 平地一声雷,打乱了很多人、很多行业的轨迹和节奏。这两年模型发布的数量更是数不胜数,其中文本大模型就占据了 AIGC 赛道的半壁江山。关注我的家人们永远都是抢占 AI 高地的冲锋者。

2025年2月27日,由前扩散模型领域顶尖研究者创立的Inception Labs正式发布了全球首个商业级扩散大语言模型(dLLM)——“Mercury”。这一里程碑式产品不仅在生成速度、硬件效率和成本控制上实现突破,更标志着自然语言处理技术从自回归(Autoregressive)范式向扩散(Diffusion)范式的重大跃迁。