Gemini Pro 学生优惠还能这么玩?免费 Opus 4.5 接入 Claude Code 实测

Gemini Pro 学生优惠还能这么玩?免费 Opus 4.5 接入 Claude Code 实测上上周跟大家盘了 Gemini 学生教育优惠。

搜索

搜索

上上周跟大家盘了 Gemini 学生教育优惠。

太香了太香了,妥妥完爆ChatGPT和Nano Banana!

最初只是我写了一个特别好玩的 prompt,那个 prompt 是一个代入修仙世界的文字游戏,没想到这个 prompt 会成为所有故事的起点。后来我们把 prompt 包了一下,上了个简单的网页,实际上开发1周,形态是chatbox,纯文本+流式输出,有选项、死亡状态,非常简单的一波流的小玩具,但是也收到了很多正向反馈。

腾讯混元大模型团队正式发布并开源HunyuanOCR模型!这是一款商业级、开源且轻量(1B参数)的OCR专用视觉语言模型,模型采用原生ViT和轻量LLM结合的架构。目前,该模型在抱抱脸(Hugging Face)趋势榜排名前四,GitHub标星超过700,并在Day 0被vllm官方团队接入。

Google 前天发布了 Antigravity,一款号称“下一代 agentic 开发平台”的全新 IDE。官方宣传强调它能规划、执行、验证整个开发流程,似乎代表着 AI 编程进入了新的阶段。然而,最早一批上手使用的开发者却纷纷吐槽:任务跑着跑着就因“模型过载”中断,信用额度几十分钟内耗尽,连完整测试都难以完成,体验堪称“开局即崩”。

如果说过去一年里,AI 让开发者生产力翻倍,那么如今它也开始以同样的速度放大风险。 上周,Google 刚刚推出的基于 Gemini 的全新 AI 编码工具 Antigravity,上线不到 24 小时便被一名安全研究员攻破,指出它存在严重的安全Bug。

Google昨天伴随Gemini3.0pro一同发布了他们的AI IDE产品Antigravity《与Gemini 3.0一起发布的AI IDE「Antigravity」究竟有多厉害?》。其震撼性的三位一体全流程Agent体验让无数开发者直呼“Cursor危险了”。

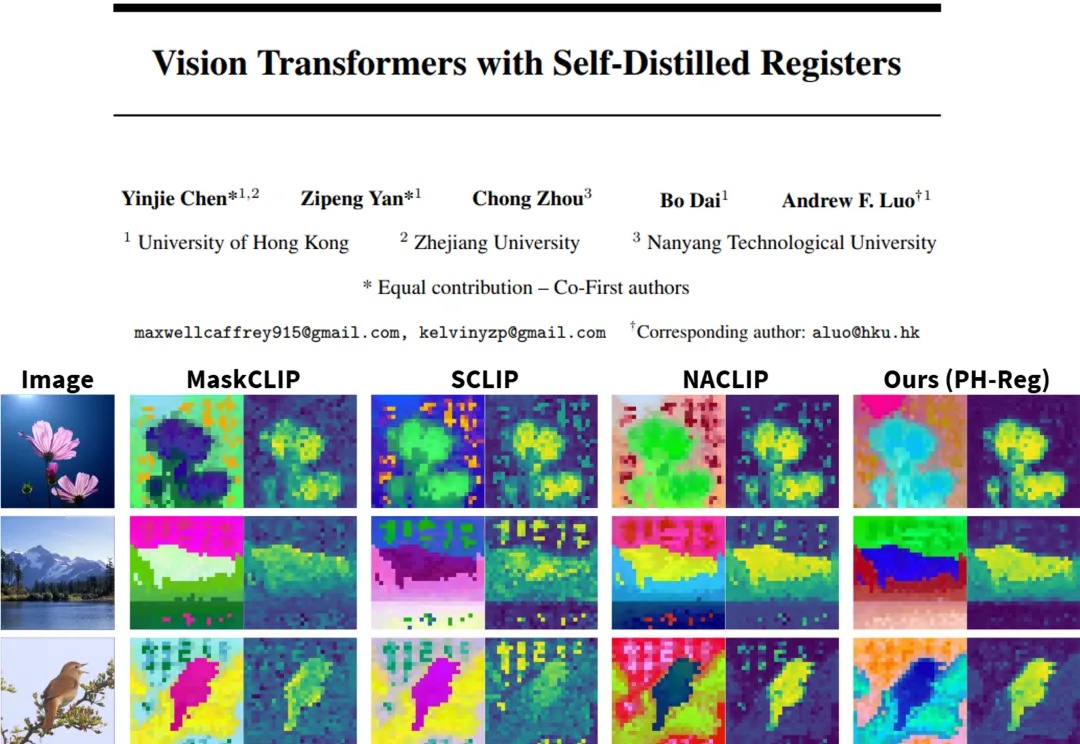

在视觉处理任务中,Vision Transformers(ViTs)已发展成为主流架构。然而,近期研究表明,ViT 模型的密集特征中会出现部分与局部语义不一致的伪影(artifact),进而削弱模型在精细定位类任务中的性能表现。因此,如何在不耗费大量计算资源的前提下,保留 ViT 模型预训练核心信息并消除密集特征中的伪影?

就在几小时前,Gemini 3.0重磅发布。随着而来的还有其颠覆性的AI原生IDE产品——Antigravity,这不只是一个新工具那么简单。谷歌的这次发布,将三个核心开发工具,AI代理(Agent)、代码编辑器(Editor)和浏览器(Browser) 集成在了一起,构建了由AI驱动、从编码、研究、测试到验证的完整闭环,一举打通了自家的生态。

凌晨,谷歌终极杀器Gemini 3重磅来袭,一出手就是Pro顶配版,号称「史上最强推理+多模态+氛围编程」三合一AI战神!基准测试横扫全场,就连GPT-5.1也被斩于马下,AI的下一个时代开启。而且,一上来就是顶配的Gemini 3 Pro——迄今推理最强,多模态理解最强,以及「智能体」+「氛围编程」最强的模型!