比Stable Diffusion便宜118倍!1890美元训出11.6亿参数高质量文生图模型

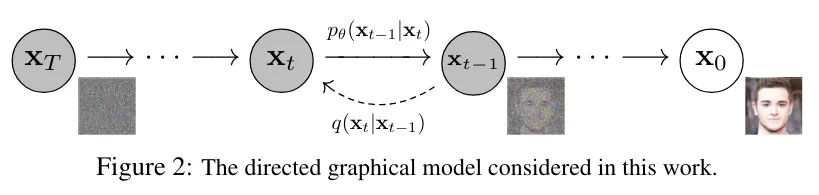

比Stable Diffusion便宜118倍!1890美元训出11.6亿参数高质量文生图模型近日,来自加州大学尔湾分校等机构的研究人员,利用延迟掩蔽、MoE、分层扩展等策略,将扩散模型的训练成本降到了1890美元。

近日,来自加州大学尔湾分校等机构的研究人员,利用延迟掩蔽、MoE、分层扩展等策略,将扩散模型的训练成本降到了1890美元。

2017 年,谷歌在论文《Attention is all you need》中提出了 Transformer,成为了深度学习领域的重大突破。该论文的引用数已经将近 13 万,后来的 GPT 家族所有模型也都是基于 Transformer 架构,可见其影响之广。 作为一种神经网络架构,Transformer 在从文本到视觉的多样任务中广受欢迎,尤其是在当前火热的 AI 聊天机器人领域。

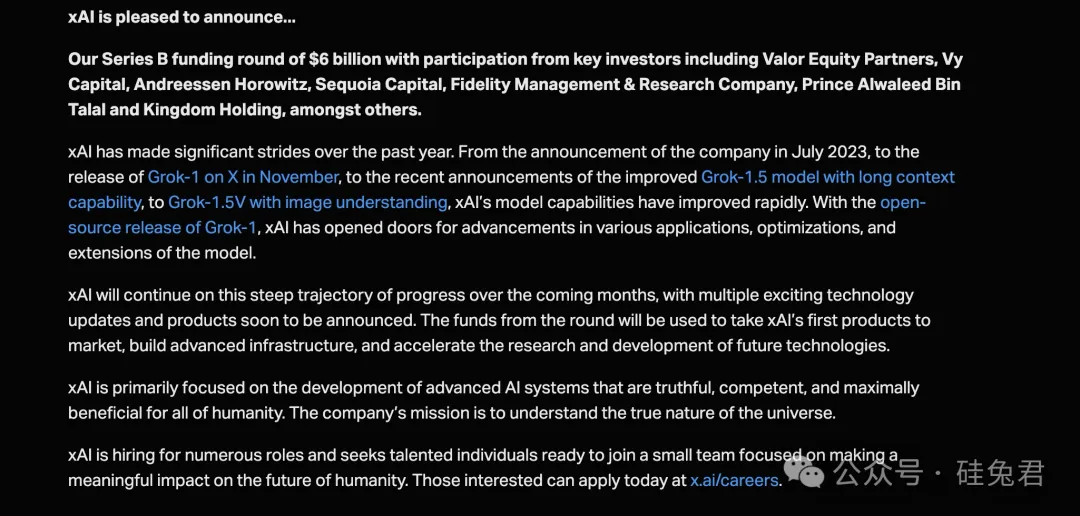

2024年,投资市场的钱都流向了哪里?

用 FlexAttention 尝试一种新的注意力模式。

Meta似乎也已经意识到,当下最好的选择是授人以渔。

2011 年 11 月,微信更新了 v3.1,首发于诺基亚的塞班上,带来了「二维码」。一周后,这一功能也上线到了安卓和 iOS。

不开颅,把 ChatGPT 装进脑子里?

字节版Sora“即梦AI”上线手机应用商店。

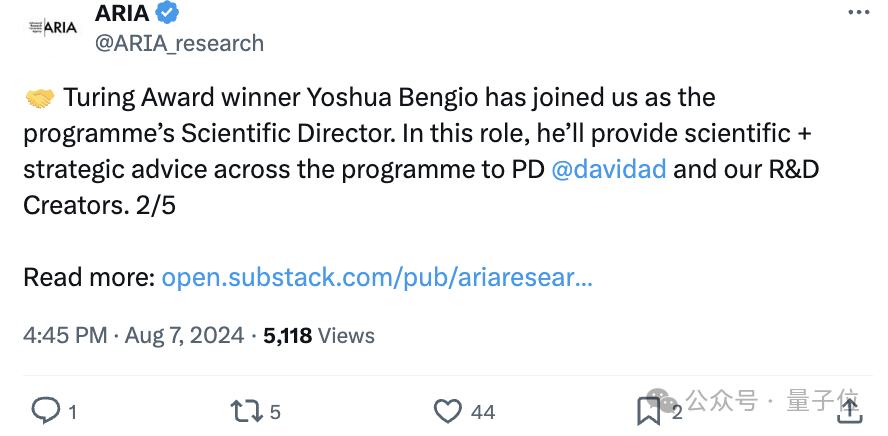

深度学习三巨头之一Yoshua Bengio的下一步动向公开了,关于AI安全——

也许视觉模型离AGI更近。