拿20年前的苹果“古董”笔记本跑模型推理:九分之一现代CPU速度,但成功了

拿20年前的苹果“古董”笔记本跑模型推理:九分之一现代CPU速度,但成功了众所周知,大语言模型(LLM)往往对硬件要求很高。

众所周知,大语言模型(LLM)往往对硬件要求很高。

AI乃至生成式 AI 正以前所未有的态势向边缘设备迁移,从 AIoT 的初步探索,迈向真正意义上的边缘 AI 时代,这一转变让嵌入式行业发生着天翻地覆的巨变。

Llama 4真要被锤爆了,这次是大模型竞技场(Chatbot Arena)官方亲自下场开怼:

大家翘首以盼的 Llama 4,用起来为什么那么拉跨?

一块毫无设计感的电路板,成了全网最火的「AI 硬件」。

法国班轮巨头达飞与本土科技公司Mistral AI合作,在未来五年内投资1亿欧元(1.1亿美元),为集团的航运、物流和媒体活动部署定制的人工智能解决方案。

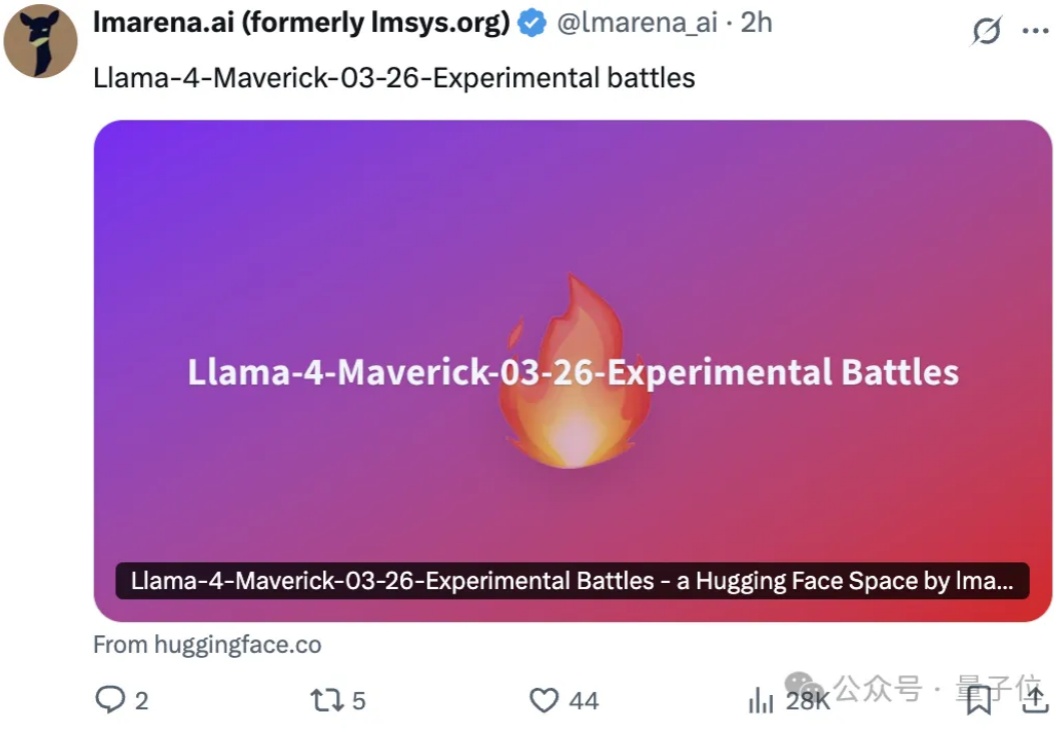

在信息检索系统中,搜索引擎的能力只是影响结果的一个方面,真正的瓶颈往往在于:用户的原始 query 本身不够好。

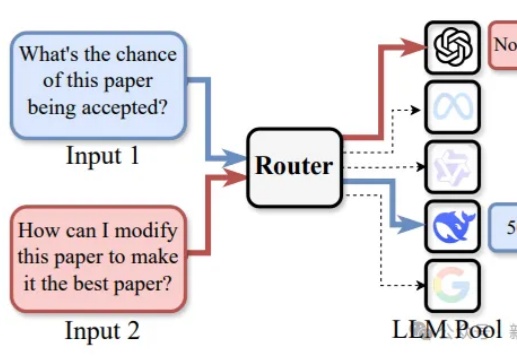

路由LLM是指一种通过router动态分配请求到若干候选LLM的机制。论文提出且开源了针对router设计的全面RouterEval基准,通过整合8500+个LLM在12个主流Benchmark上的2亿条性能记录。将大模型路由问题转化为标准的分类任务,使研究者可在单卡甚至笔记本电脑上开展前沿研究。

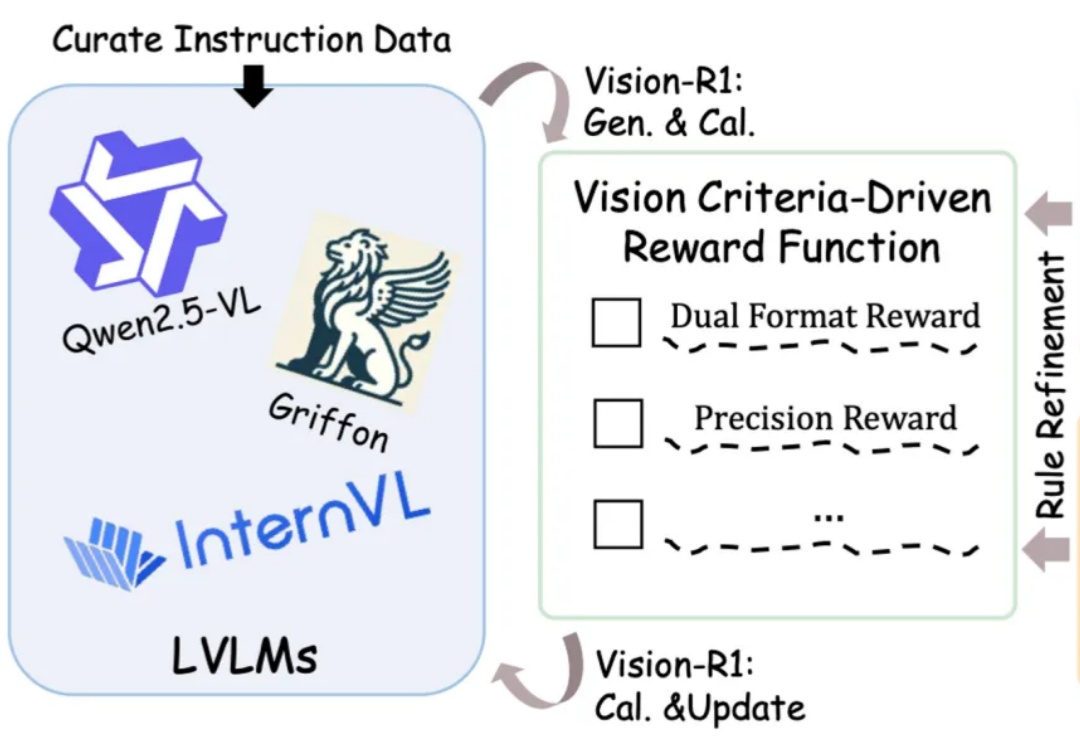

图文大模型通常采用「预训练 + 监督微调」的两阶段范式进行训练,以强化其指令跟随能力。受语言领域的启发,多模态偏好优化技术凭借其在数据效率和性能增益方面的优势,被广泛用于对齐人类偏好。目前,该技术主要依赖高质量的偏好数据标注和精准的奖励模型训练来提升模型表现。然而,这一方法不仅资源消耗巨大,训练过程仍然极具挑战。

我之前拉了一个AI自媒体的群,就...同行交流,互相学习。