华人团队领衔!OpenAI深夜祭出「首个生命科学大模型」GPT-Rosalind,碾压95%人类专家!

华人团队领衔!OpenAI深夜祭出「首个生命科学大模型」GPT-Rosalind,碾压95%人类专家!就在今天,OpenAI正式宣布推出GPT-Rosalind,一款专为生物学和药物研发打造的垂直领域推理模型!它旨在加速从基础生物学、药物发现到转化医学的整个研究流程,解决新药研发周期长、流程复杂等核心痛点。

搜索

搜索

就在今天,OpenAI正式宣布推出GPT-Rosalind,一款专为生物学和药物研发打造的垂直领域推理模型!它旨在加速从基础生物学、药物发现到转化医学的整个研究流程,解决新药研发周期长、流程复杂等核心痛点。

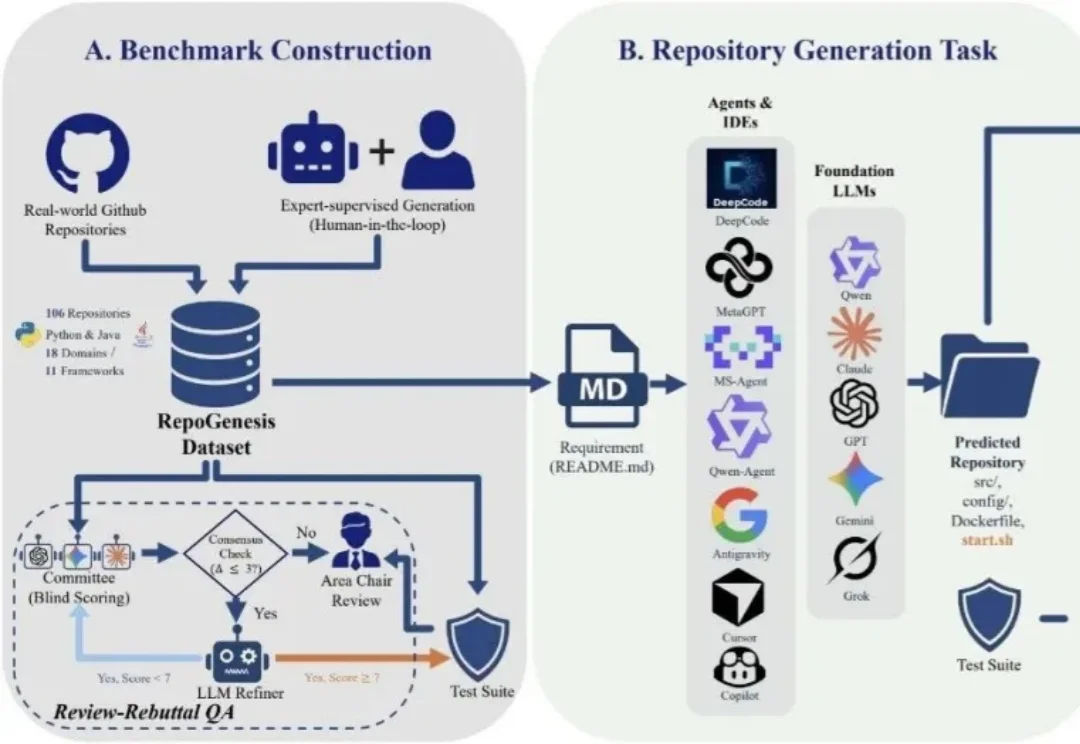

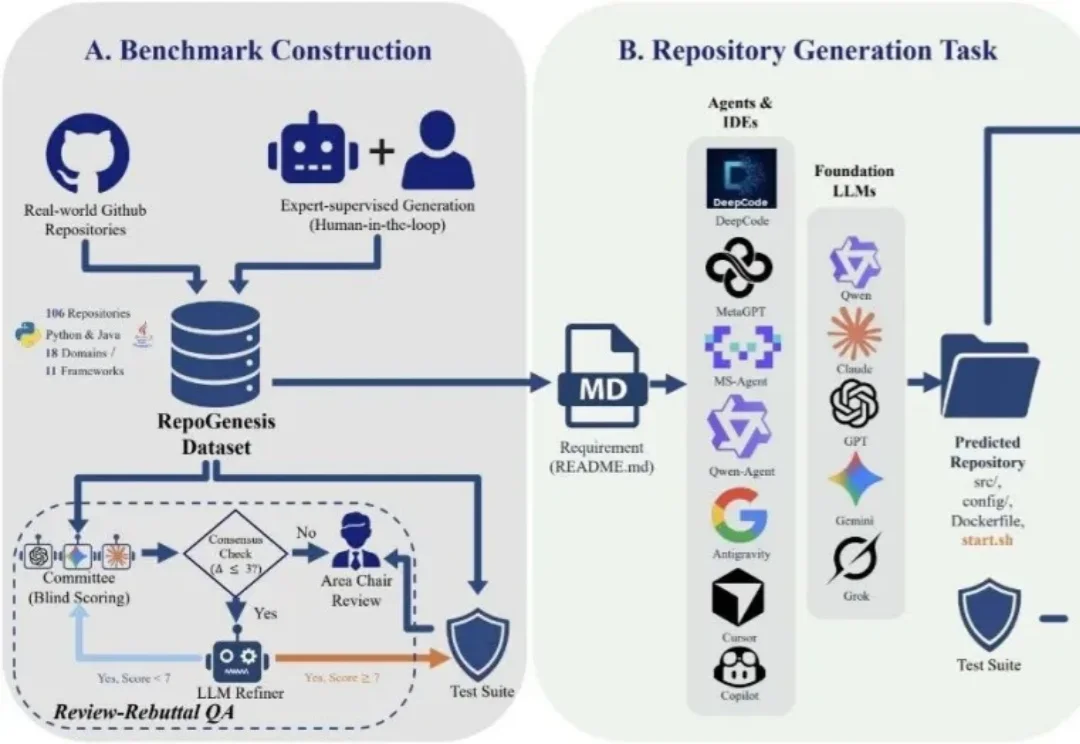

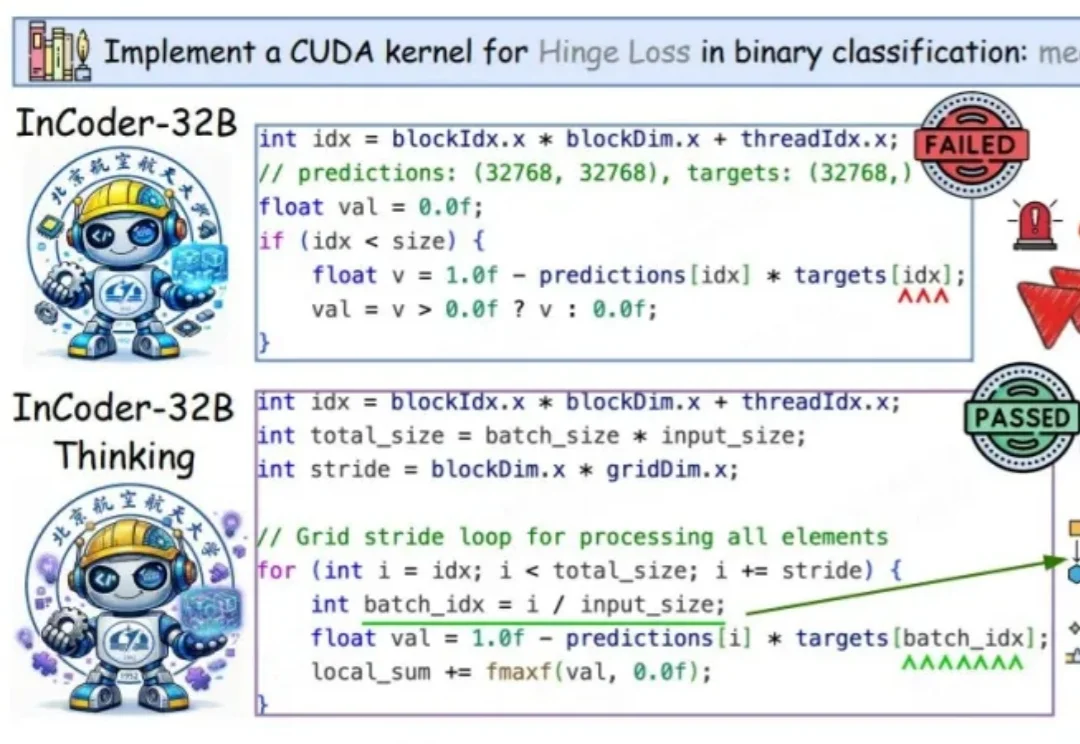

大模型写代码这件事,越来越像「既能写片段,又离真实工程差一截」。

AI模型只看了一串纯数字序列,就能继承另一个模型的危险偏好,即使删掉敏感词没有用,合成数据时代最隐蔽的安全裂缝,被撕开了。

两眼一睁,Claude又更新了。Anthropic发布新一代旗舰大模型Claude Opus 4.7。该模型在高级软件工程方面相比Opus 4.6有显著提升,尤其在处理最复杂的任务时提升明显;高分辨率图像处理能力大幅提升,是此前Claude模型的3倍以上

大模型写代码这件事,越来越像「既能写片段,又离真实工程差一截」。

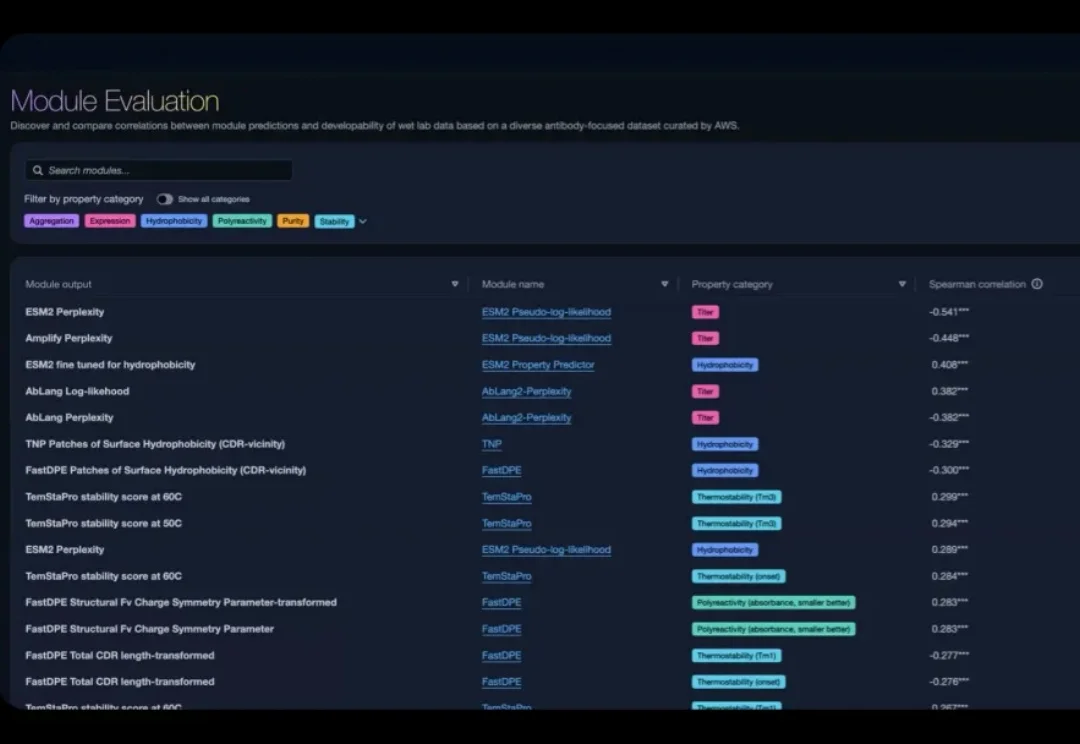

巨头亚马逊,也深度入局生命科学了。

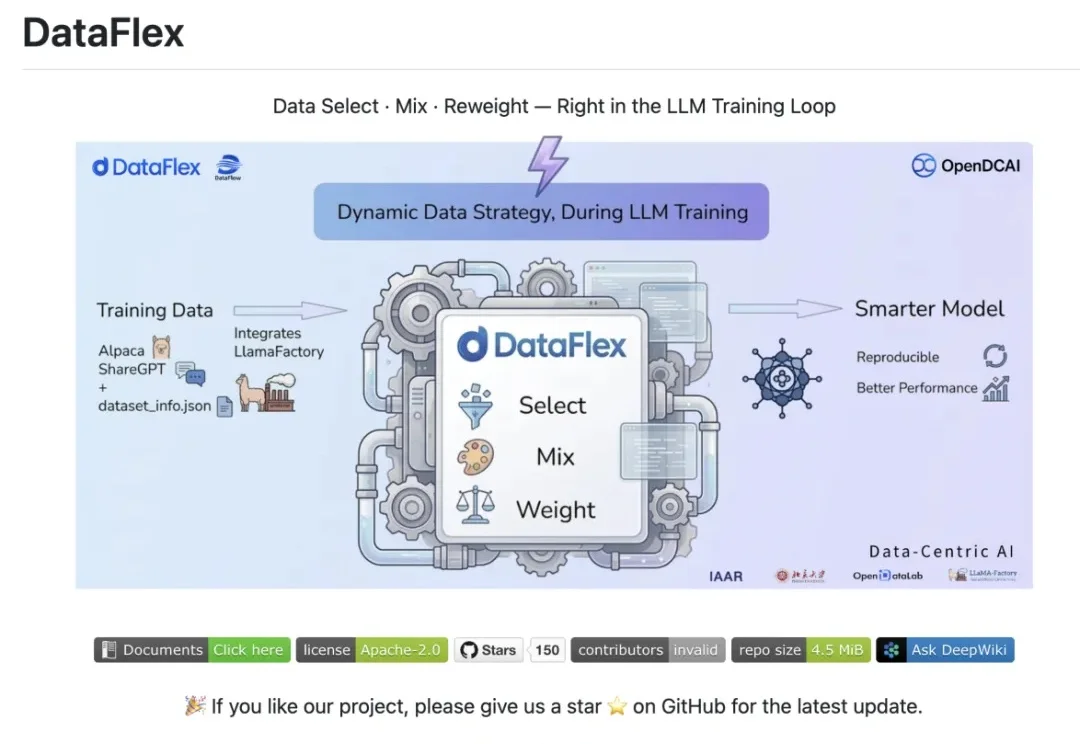

当大模型训练进入深水区,竞争的关键已经不再只是「模型参数怎么调」,而逐渐转向一个更核心、也更难系统解决的问题:模型在训练过程中究竟看到了什么数据、以什么比例看到、哪些样本应该被更频繁地学习。

当大模型训练进入深水区,竞争的关键已经不再只是「模型参数怎么调」,而逐渐转向一个更核心、也更难系统解决的问题:模型在训练过程中究竟看到了什么数据、以什么比例看到、哪些样本应该被更频繁地学习。

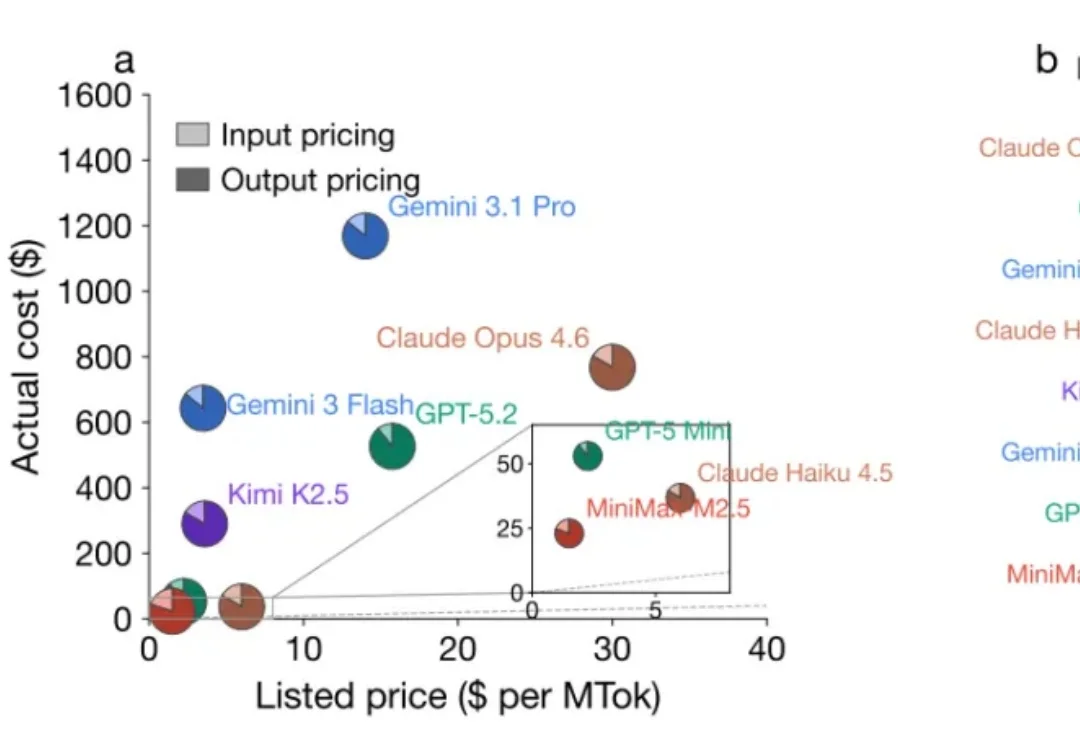

在选择使用大模型 (LLM) 时,除了模型性能强弱,价格也是一个重要指标。人们通常会用大模型的 API 定价更贵或更便宜,来比较模型的价格高低。但事实上,定价低的模型真的比定价高的模型使用起来更便宜吗?

代码大模型会写代码,这件事已经不新鲜了。