不用英伟达GPU!华为盘古Ultra来了:昇腾原生、135B稠密通用大模型

不用英伟达GPU!华为盘古Ultra来了:昇腾原生、135B稠密通用大模型终于,华为盘古大模型系列上新了,而且是昇腾原生的通用千亿级语言大模型。我们知道,如今各大科技公司纷纷发布百亿、千亿级模型。但这些大部分模型训练主要依赖英伟达的 GPU。

搜索

搜索

终于,华为盘古大模型系列上新了,而且是昇腾原生的通用千亿级语言大模型。我们知道,如今各大科技公司纷纷发布百亿、千亿级模型。但这些大部分模型训练主要依赖英伟达的 GPU。

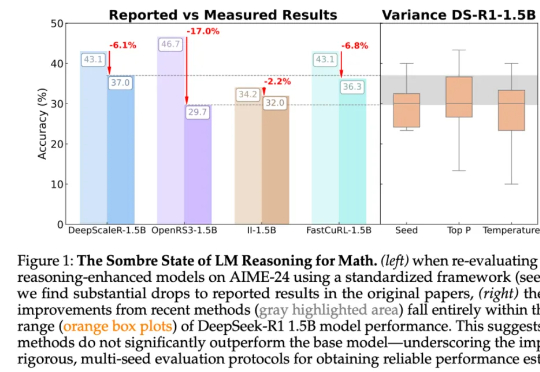

尽管这些论文的结论统统指向了强化学习带来的显著性能提升,但来自图宾根大学和剑桥大学的研究者发现,强化学习导致的许多「改进」可能只是噪音。「受推理领域越来越多不一致的经验说法的推动,我们对推理基准的现状进行了严格的调查,特别关注了数学推理领域评估算法进展最广泛使用的测试平台之一 HuggingFaceH4,2024;AI - MO。」

本文作者刘圳是香港中文大学(深圳)数据科学学院的助理教授,肖镇中是德国马克思普朗克-智能系统研究所和图宾根大学的博士生,刘威杨是德国马克思普朗克-智能系统研究所的研究员,Yoshua Bengio 是蒙特利尔大学和加拿大 Mila 研究所的教授,张鼎怀是微软研究院的研究员。此论文已收录于 ICLR 2025。

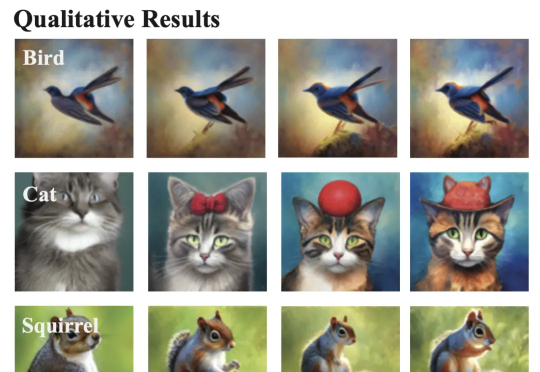

来自Meta和NYU的团队,刚刚提出了一种MetaQuery新方法,让多模态模型瞬间解锁多模态生成能力!令人惊讶的是,这种方法竟然如此简单,就实现了曾被认为需要MLLM微调才能具备的能力。

Eden AI打破AI开发技术壁垒:统一API接口,聚合OpenAI、Google等超100个主流AI模型,具有一键调用多平台能力,提供可视化工作流构建器,拖拽式设计AI流程可以保证0代码实现复杂应用。

如果你没有杜蕾斯背后强大的5A广告公司、鬼才般的创意团队、句句封神的的金牌文案、审美爆辣的视觉艺术家。借助即梦刚上线的3.0生图模型以及 Deepseek生创意和文案,你也可以轻松复刻一个「杜蕾斯级别」的刷屏海报。

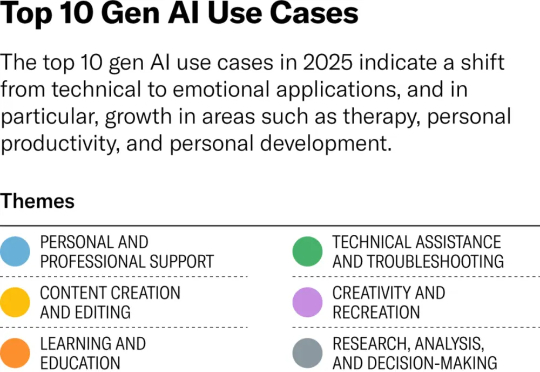

在这篇文章中,我采用了与去年研究人们如何使用 AI 的相同方法,但搜索了更多数据,并将结果限制在过去 12 个月内。我查看了在线论坛(Reddit、Quora)以及包含明确、具体的技术应用的文章。也许是由于其固有的匿名性,Reddit 再次提供了最丰富的见解。我阅读了这些文章,并将每个相关帖子添加到该类别的统计中。几天后,我统计出了 100 个新的使用案例,并逐一引用。

人和智能体共享奖励参数,这才是强化学习正确的方向?

在大模型争霸的时代,算力与效率的平衡成为决定胜负的关键。

高质量数据枯竭,传统预训练走向终点,大模型如何突破瓶颈?