ACM Computing Surveys | 港大等基于可靠性视角的深度伪造检测综述,覆盖主流基准库、模型

ACM Computing Surveys | 港大等基于可靠性视角的深度伪造检测综述,覆盖主流基准库、模型基于深度神经网络对人脸图像进行编辑和篡改,深度伪造的发展为人们的生活带来了便利,但对其错误的应用也同时危害着人们的隐私和信息安全。

搜索

搜索

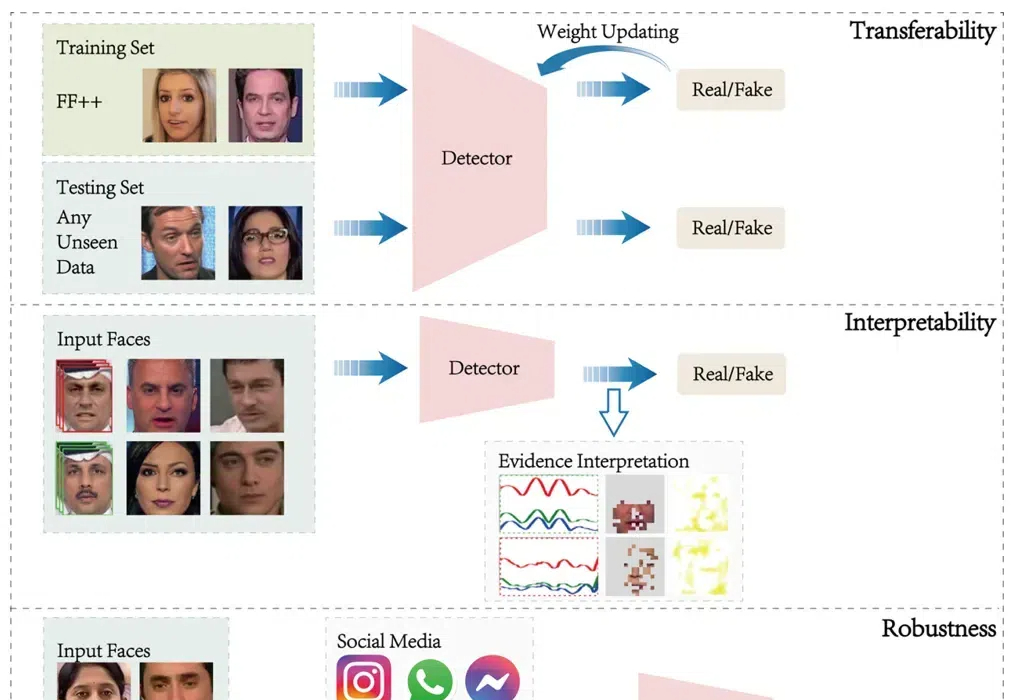

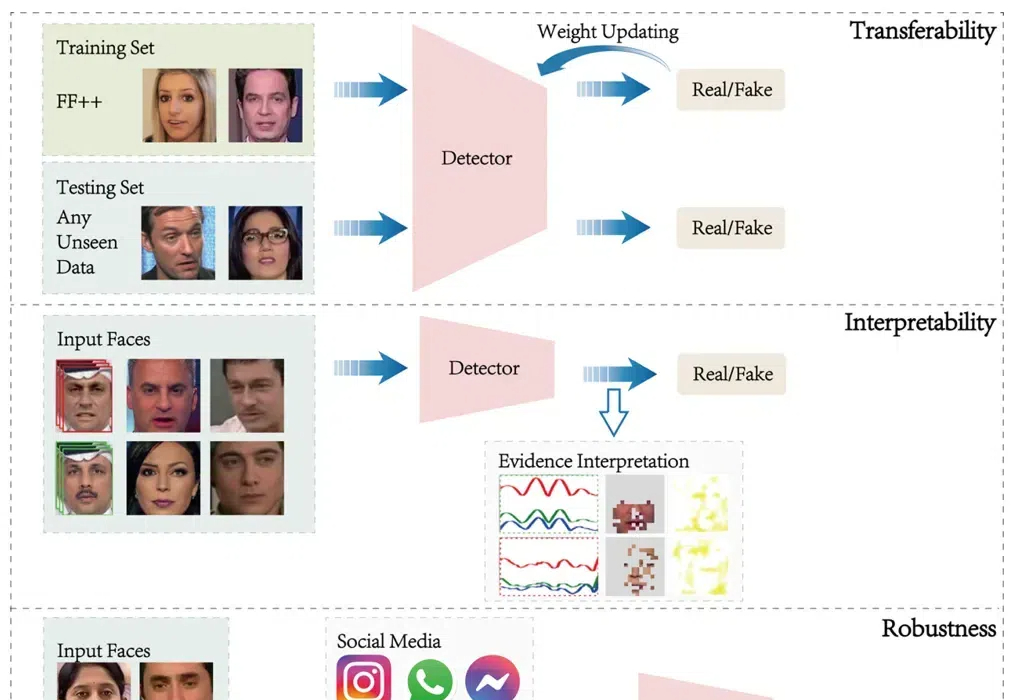

基于深度神经网络对人脸图像进行编辑和篡改,深度伪造的发展为人们的生活带来了便利,但对其错误的应用也同时危害着人们的隐私和信息安全。

GAN已死?不,它卷土重来了!布朗大学和康奈尔大学的研究者刚刚提出了R3GAN,充分利用现代架构设计,彻底摒弃临时技巧,一半参数就能碾压扩散模型。网友惊呼:游戏规则要改变了!

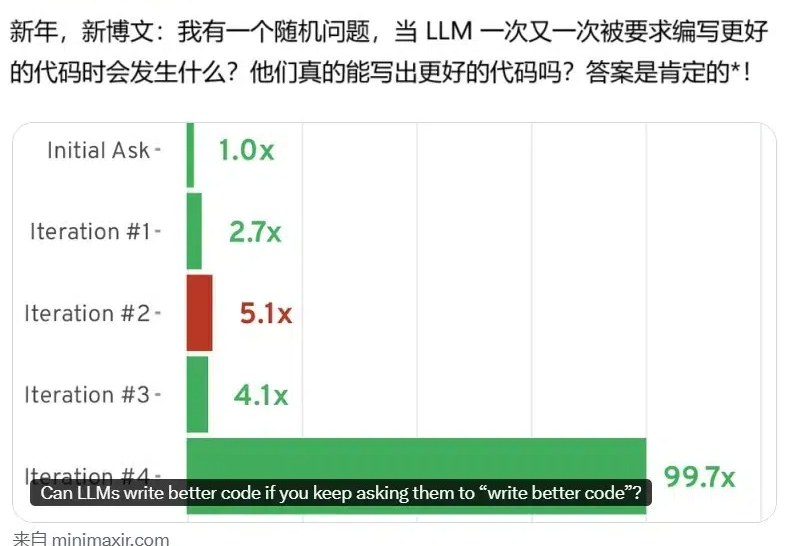

AI 的编程能力已经得到了证明,但还并不完美。近日,BuzzFeed 的资深数据科学家 Max Woolf 发现,如果通过提示词不断要求模型写更好的代码(write better code),AI 模型还真能写出更好的代码!

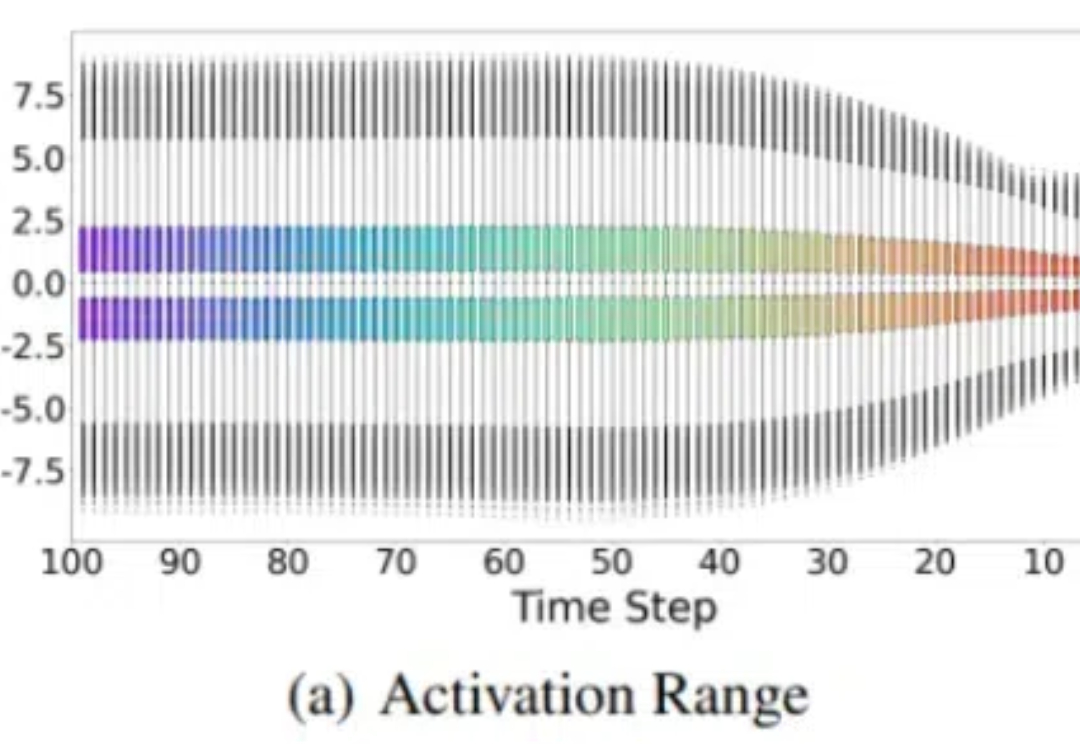

将扩散模型量化到1比特极限,又有新SOTA了! 来自北航、ETH等机构的研究人员提出了一种名为BiDM的新方法,首次将扩散模型(DMs)的权重和激活完全二值化。

眼病诊疗,会迈上怎样的台阶? 用“手机看病”,这个听起来颇为科幻的场景,其实已经走进了现实。

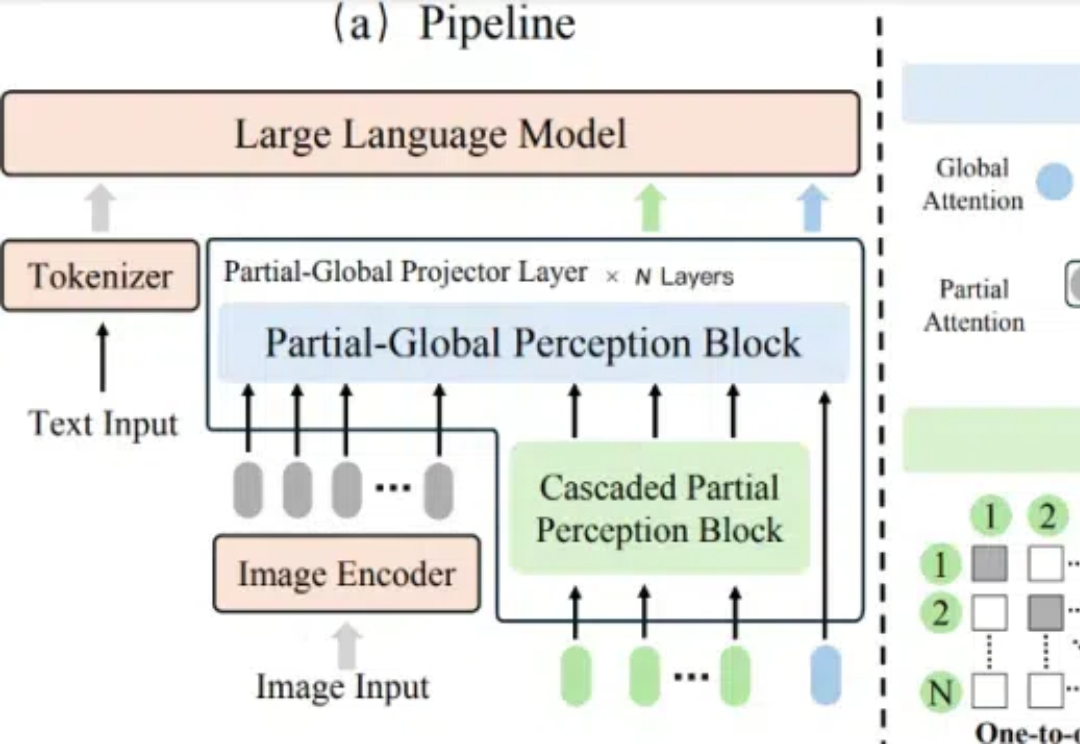

在多模态大语言模型(MLLMs)的发展中,视觉 - 语言连接器作为将视觉特征映射到 LLM 语言空间的关键组件,起到了桥梁作用。

LLM会把编程淘汰吗?近日,哥本哈根大学的计算机教授,通过分析计算理论中的定理所施加的基本限制,得出结论:距离编程的终结还远得很。

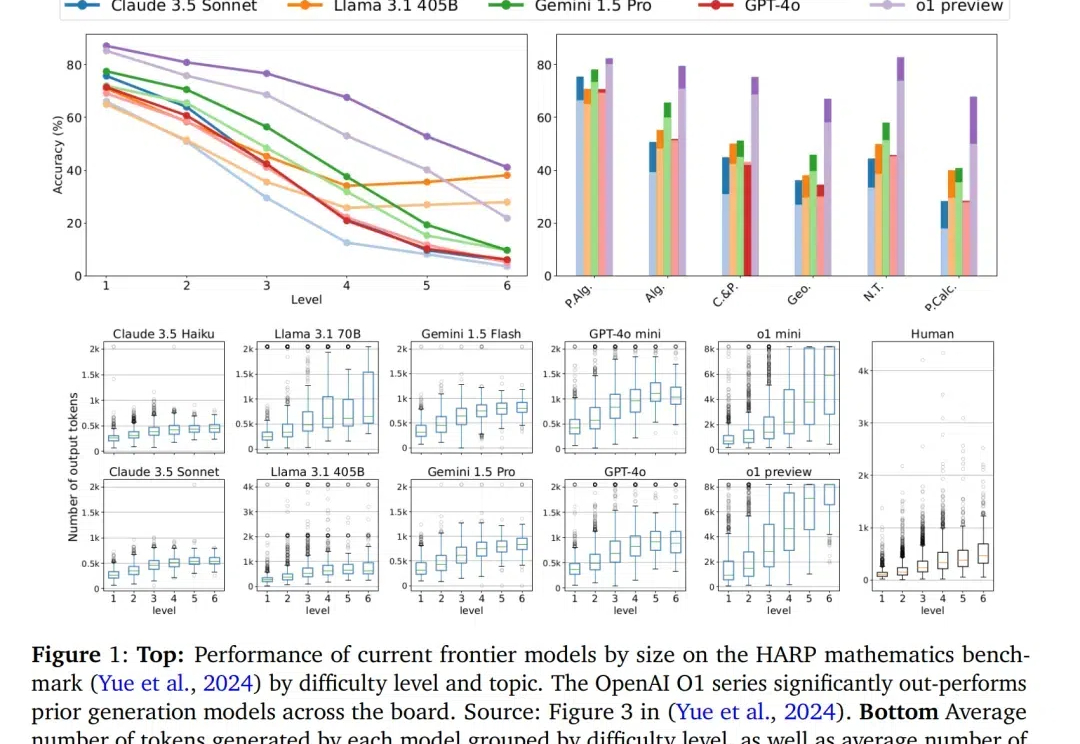

Meta-CoT 通过显式建模生成特定思维链(CoT)所需的底层推理过程,扩展了传统的思维链方法。

2025年1月7日上午,在CES大会开幕式上,身穿黑皮衣的英伟达创始人黄仁勋,用一番激情演讲,拉开了新一年AI的大幕——英伟达不仅推出了新一代基于Blackwell架构的GPU RTX 5090,还发布了开源可商用的世界基础模型Cosmos。两项产品,为AI应用的变革提供了全新的“基础设施”。

大模型长序列的处理能力已越来越重要,像复杂长文本任务、多帧视频理解任务、以及 OpenAI 近期发布的 o1、o3 系列模型的高计算量模式,需要处理的输入 + 输出总 token 数从几万量级上升到了几百万量级。