DeepSeek-R1、o1都在及格线挣扎!字节开源全新知识推理测评集,覆盖285个学科

DeepSeek-R1、o1都在及格线挣扎!字节开源全新知识推理测评集,覆盖285个学科要知道,过去几年,各种通用评测逐渐同质化,越来越难以评估模型真实能力。GPQA、MMLU-pro、MMLU等流行基准,各家模型出街时人手一份,但局限性也开始暴露,比如覆盖范围狭窄(通常不足 50 个学科),不含长尾知识;缺乏足够挑战性和区分度,比如 GPT-4o 在 MMLU-Pro 上准确率飙到 92.3%。

搜索

搜索

要知道,过去几年,各种通用评测逐渐同质化,越来越难以评估模型真实能力。GPQA、MMLU-pro、MMLU等流行基准,各家模型出街时人手一份,但局限性也开始暴露,比如覆盖范围狭窄(通常不足 50 个学科),不含长尾知识;缺乏足够挑战性和区分度,比如 GPT-4o 在 MMLU-Pro 上准确率飙到 92.3%。

美国本科生最难数学竞赛,o1 pro竟然只用半小时就全部做出来了?要知道,参赛学生的正常答题时长是6小时。不过网友们仔细看它的解题过程后发现,错误率似乎高达100%,12道题没有一道完全正确?

最近,Nature上的一项研究,全面驳斥了LLM具有类人推理能力的说法。研究者设定的「人类亲吻难题」把7个大模型彻底绕晕。最终研究者表示,与其说LLM是科学理论,不如说它们更接近工具,比如广义导数。

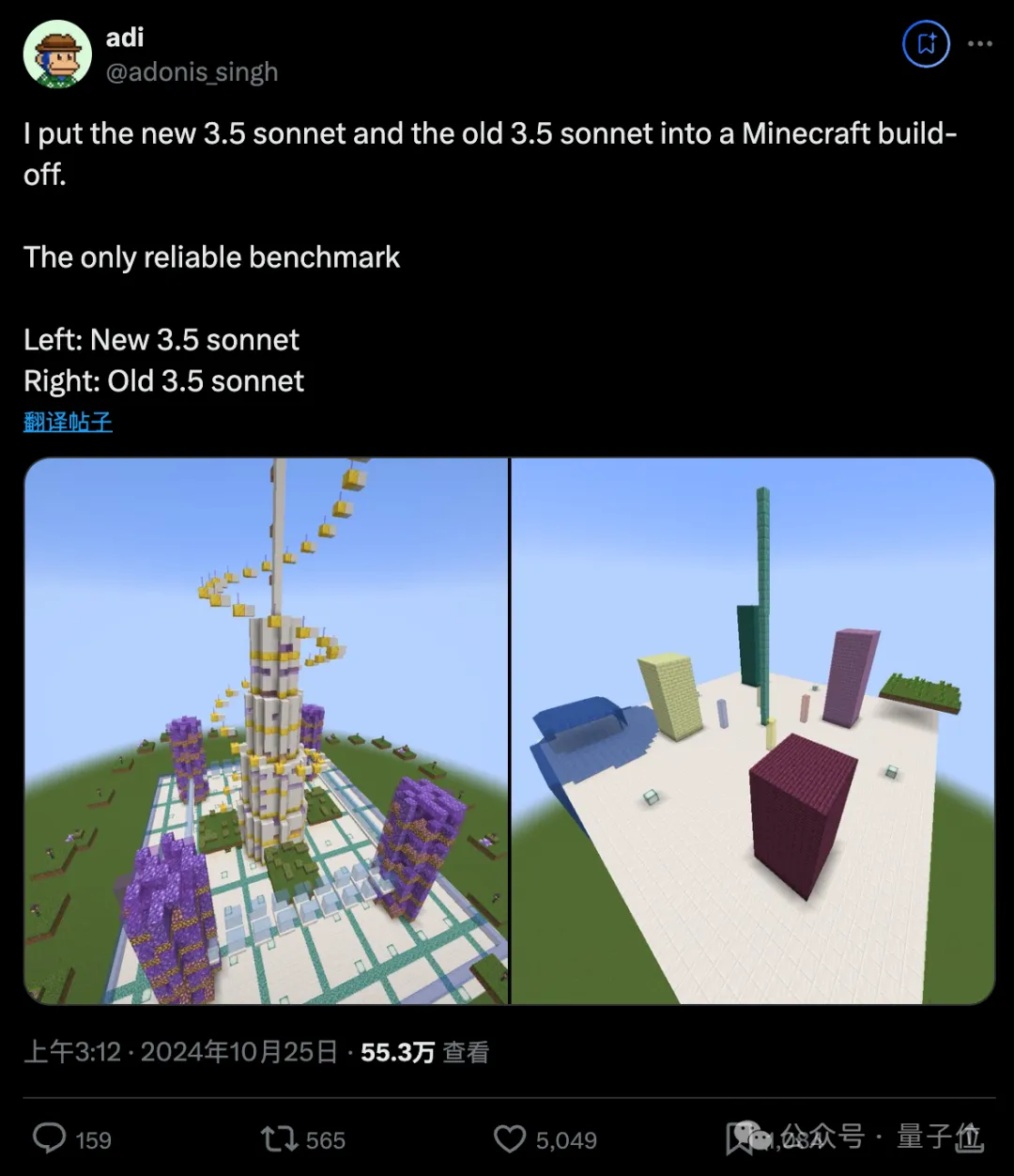

测评大模型Agent能力,从未如此直观。 新旧两版Claude 3.5 Sonnet在《我的世界》里PK盖楼,差距不要太明显,引来大量围观。

单元测试是软件开发流程中的一个关键环节,主要用于验证软件中的最小可测试单元,函数或模块是否按预期工作。单元测试的目标是确保每个独立的代码片段都能正确执行其功能,对于提高软件质量和开发效率具有重要意义。

长文本处理能力对LLM的重要性是显而易见的。在2023年初,即便是当时最先进的GPT-3.5,其上下文长度也仅限于2k,然而今日,128k的上下文长度已经成为衡量模型技术先进性的重要标志之一。那你知道LLMs的长文本阅读能力如何评估吗?

OpenAI长期霸榜的SuperCLUE(中文大模型测评基准),终于被国产大模型反将一军。

在2023年的「百模大战」中,众多实践者推出了各类模型,这些模型有的是原创的,有的是针对开源模型进行微调的;有些是通用的,有些则是行业特定的。如何能合理地评价这些模型的能力,成为关键问题

参照SuperCLUE(中文通用大模型综合性测评基准)框架专门定制了1000道题目集,一一测试了ChatGPT4、 智谱chatGLM-4、Baichuan2-Turbo、百度ERNIE-Bot 4.0、Yi-34B-chat、llama 2等模型在保险业务上的表现。

新华社研究院发布了《人工智能大模型体验报告2.0》,对国内主流大模型进行使用体验的横向测评。该榜单用500道题目评测了国内8款主流AI大模型,最终讯飞星火排名第一,百度文心一言排名第二,阿里通义千问排在倒数第二。