谷歌苹果曝出LLM惊人内幕,自主识别错误却装糊涂!AI幻觉背后藏着更大秘密

谷歌苹果曝出LLM惊人内幕,自主识别错误却装糊涂!AI幻觉背后藏着更大秘密大模型幻觉,究竟是怎么来的?谷歌、苹果等机构研究人员发现,大模型知道的远比表现的要多。它们能够在内部编码正确答案,却依旧输出了错误内容。

大模型幻觉,究竟是怎么来的?谷歌、苹果等机构研究人员发现,大模型知道的远比表现的要多。它们能够在内部编码正确答案,却依旧输出了错误内容。

在翻译领域,生成性人工智能有一个巨大的机会,一家名为Panjaya的初创公司正在将这一概念提升到一个新的水平:一个超现实的基于生成性人工智能的视频配音工具,可以重现一个人用新语言说话的原始声音,同时视频和说话者的身体动作会自动调整,以自然地与新的语音模式相匹配。

目前苹果在AI服务器市场的需求相对较小,但寻找合适的供应商并不简单。

今天我就来教大家如何通过一些操作,将自己的iPhone从国行设备“改造”为可以体验苹果AI的设备。

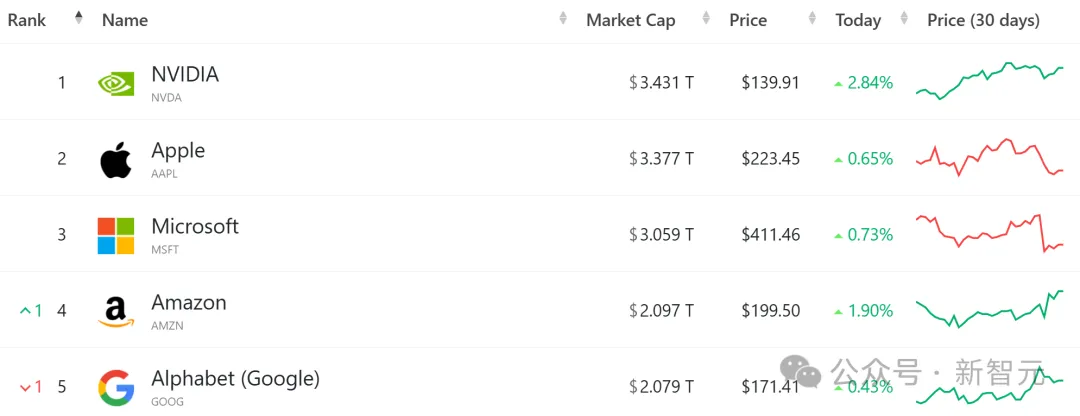

继6月短暂超越苹果市值后,英伟达再次超越苹果成为全球最高市值公司!

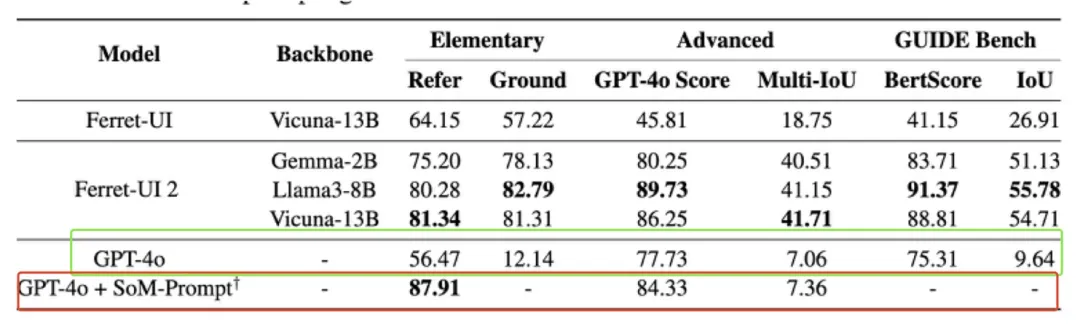

家人们,苹果一直在悄悄进步! 近期,据小鹿观察,各大科技巨头不仅在提升模型解决复杂问题的能力上竞争激烈,而且还在大语言模型应用于用户界面(UI)交互方面上暗暗发力!

Ferret-UI 2 是苹果研究团队最新发表的一款先进的多模态大型语言模型(MLLM),旨在实现跨多个平台的通用用户界面(UI)理解。

一周Mac三连发,压轴场MacBook Pro终于来了,也宣告着M4全系芯片诞生。最强性能野兽M4 Pro、M4 Max采用第二代3nm工艺,快到起飞续航长达24小时。

Coframe是一家能够为客户提供网站编程优化的AI初创公司。该公司于本周二宣布获得了 930 万美元的种子轮融资,

首款M4 Mac、「全世界最好的AI一体机」终于来了!同时,苹果AI也正式上线,iOS 18.1、iPadOS 18.1和macOS Sequoia 15.1用户,已经可以体验首批Apple Intelligence功能了……库克直呼:激动人心的新时代开始了!