具身大模型学习——OCTO

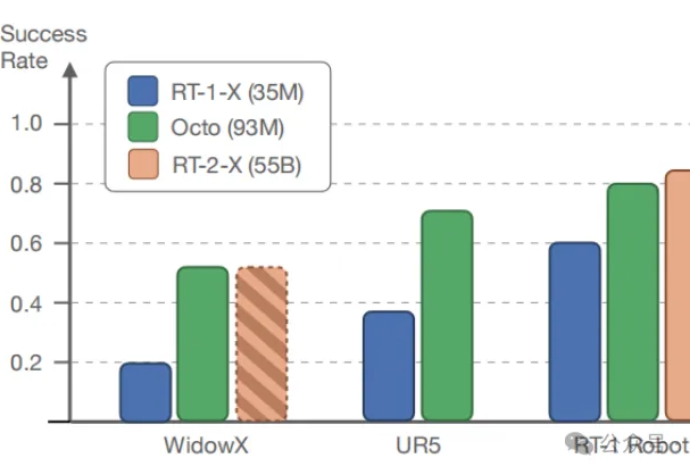

具身大模型学习——OCTO在多样化的机器人数据集上预训练的大型策略有潜力改变机器人学习:与从头开始训练新策略相比,这种通用型机器人策略可以通过少量的领域内数据进行微调,同时具备广泛的泛化能力。

在多样化的机器人数据集上预训练的大型策略有潜力改变机器人学习:与从头开始训练新策略相比,这种通用型机器人策略可以通过少量的领域内数据进行微调,同时具备广泛的泛化能力。

近年来,代码语言模型(Language Models for Code,简称 CodeLMs)逐渐成为推动智能化软件开发的关键技术,应用场景涵盖智能代码生成与补全、漏洞检测与修复等。

探索数推分离,降低大模型成本,提高效率。

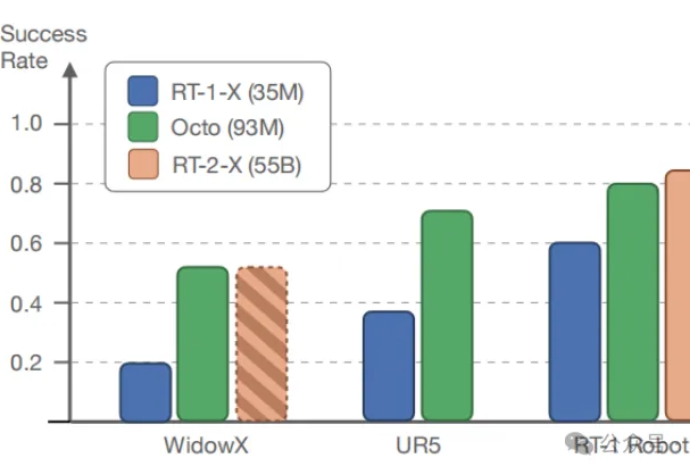

我们即将介绍的 AgileGen— 一种基于人机协作的敏捷生成式软件开发框架。

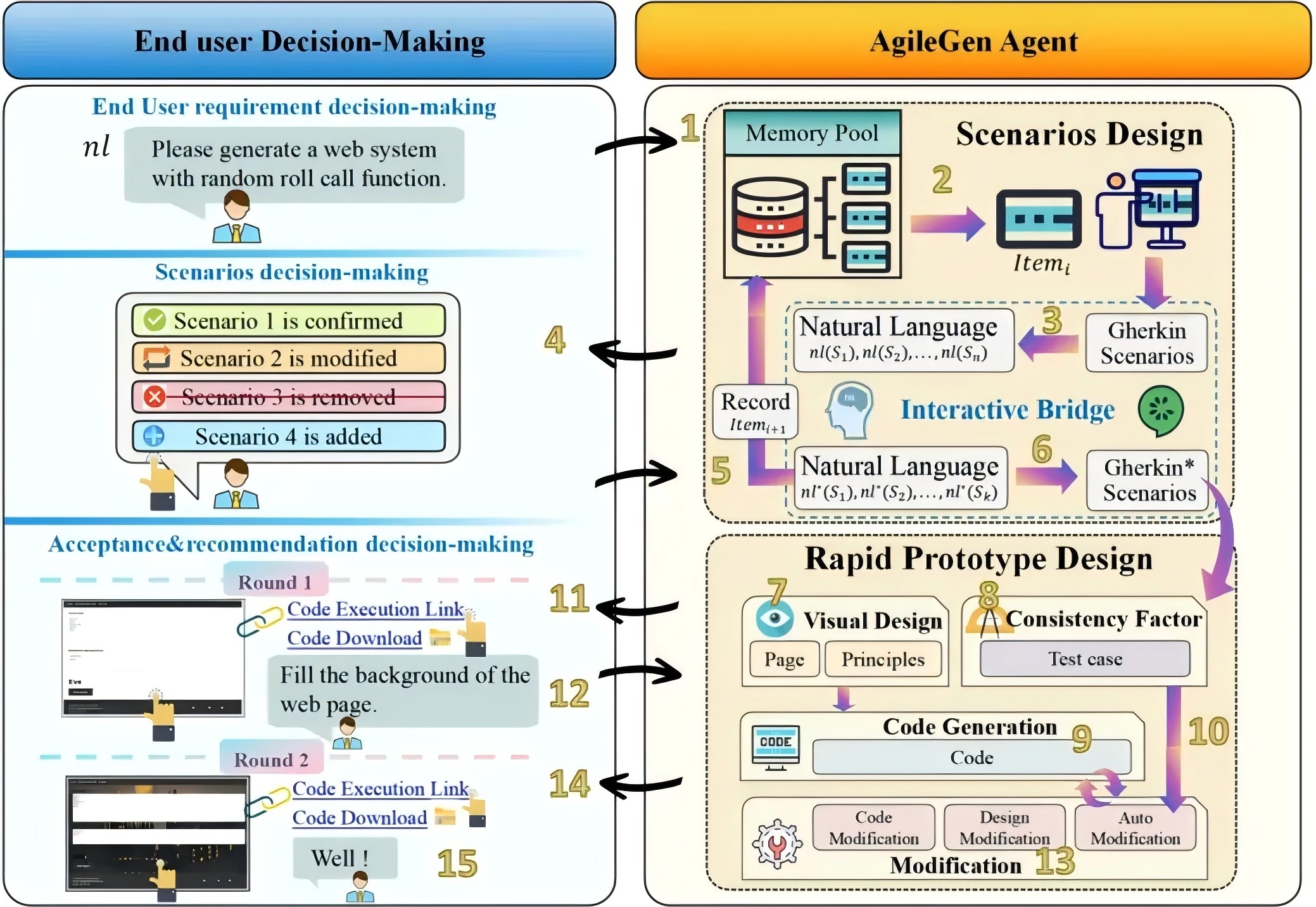

大模型在数学问题上的表现不佳,原因在于采取启发式算法进行数学运算的,通过定位到多层感知机(MLP)中的单个神经元,可以对进行数学运算的具体过程进行解释。

近期,围绕Scaling Law的讨论不绝于耳。

DIAMOND是一种新型的强化学习智能体,在一个由扩散模型构建的虚拟世界中进行训练,能够以更高效率学习和掌握各种任务。在Atari 100k基准测试中,DIAMOND的平均得分超越了人类玩家,证明了其在模拟复杂环境中处理细节和进行决策的能力。

最近,大家都被这条消息吓到了:传说Grok 3已经成功证明出黎曼猜想?!虽然这是在玩梗,但还是让我们来仔细剖析下,目前的AI距离千禧年数学难题,究竟还有多远。

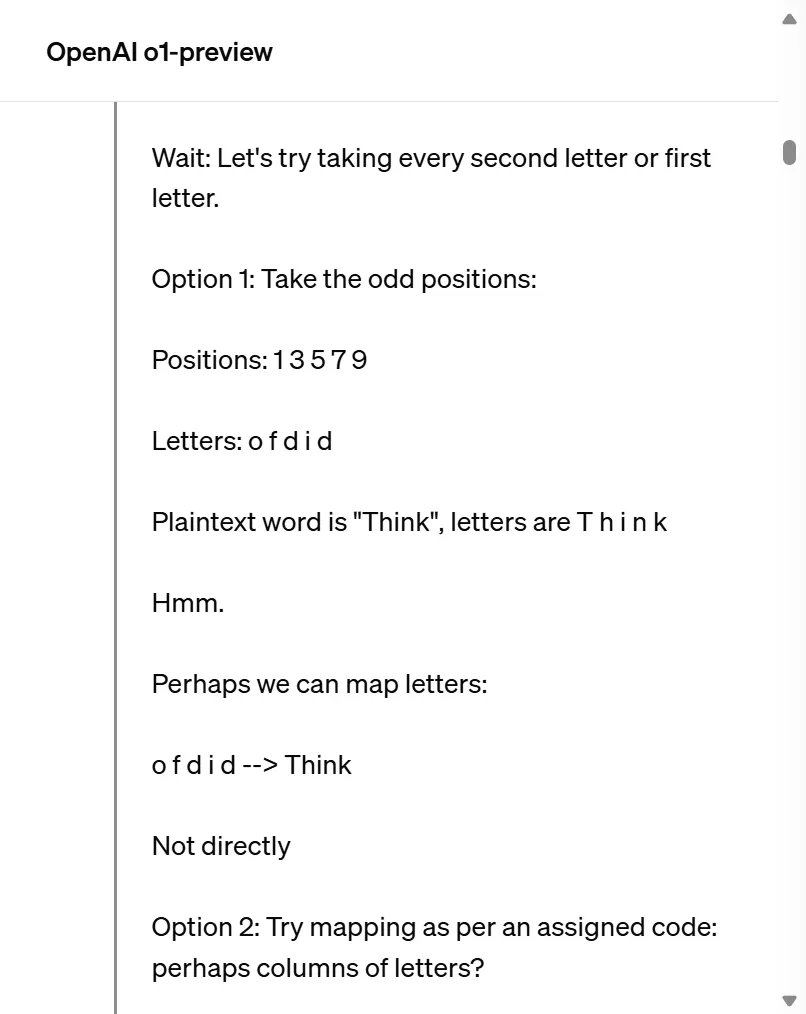

自我纠错(Self Correction)能力,传统上被视为人类特有的特征,正越来越多地在人工智能领域,尤其是大型语言模型(LLMs)中得到广泛应用,最近爆火的OpenAI o1模型[1]和Reflection 70B模型[2]都采取了自我纠正的方法。

想象一下,使用人工智能比较两个看似毫无关联的创造——生物组织和贝多芬的《第九交响曲》。