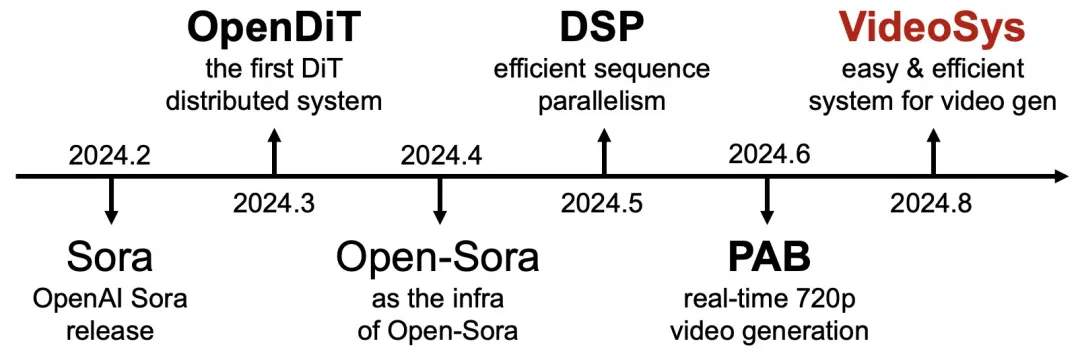

视频生成要有自己的系统!尤洋团队历时半年开源VideoSys

视频生成要有自己的系统!尤洋团队历时半年开源VideoSys视频时代需要自己的基础设施。VideoSys 的目标是使视频生成对于每个人而言都简便、迅速且成本低廉。

搜索

搜索

视频时代需要自己的基础设施。VideoSys 的目标是使视频生成对于每个人而言都简便、迅速且成本低廉。

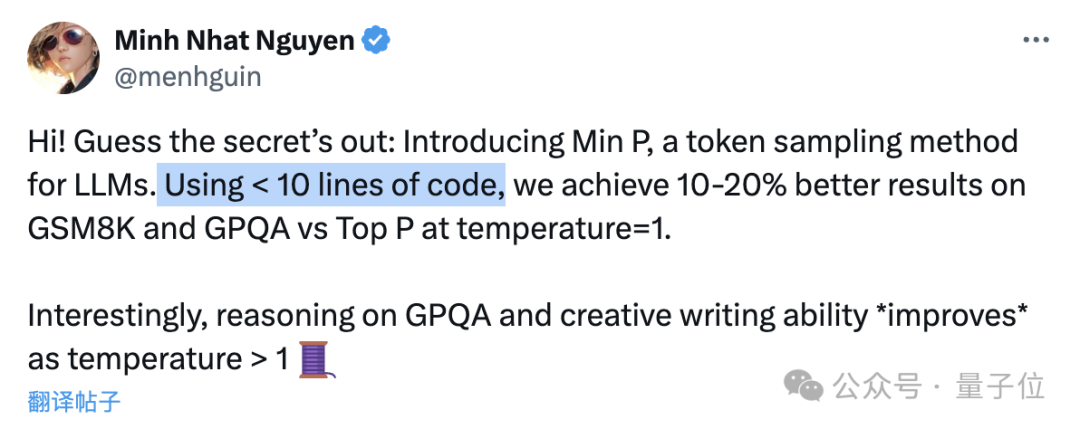

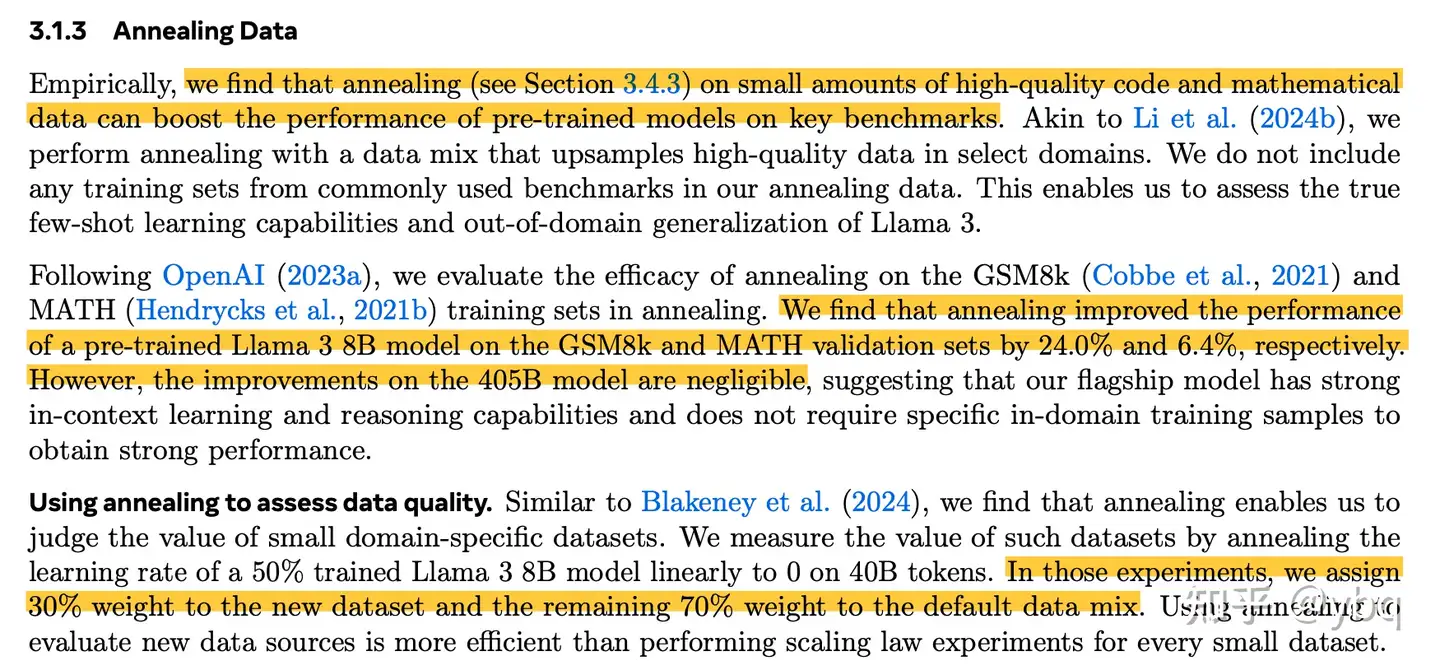

只要不到10行代码,就能让大模型数学能力(GSM8k)提升20%!

就在刚刚,Meta最新发布的Transfusion,能够训练生成文本和图像的统一模型了!完美融合Transformer和扩散领域之后,语言模型和图像大一统,又近了一步。也就是说,真正的多模态AI模型,可能很快就要来了!

这篇文章对如何进行领域模型训练进行一个简单的探讨,主要内容是对 post-pretrain 阶段进行分析,后续的 Alignment 阶段就先不提了,注意好老生常谈的“数据质量”和“数据多样性”即可。

神经网络是一种灵活且强大的函数近似方法。而许多应用都需要学习一个相对于某种对称性不变或等变的函数。图像识别便是一个典型示例 —— 当图像发生平移时,情况不会发生变化。等变神经网络(equivariant neural network)可为学习这些不变或等变函数提供一个灵活的框架。

今年以来,具身智能正在成为学术界和产业界的热门领域,相关的产品和成果层出不穷。

AI,智能体,ADAS,元智能体搜索,模型训练

代码知识原来这么重要。

Emory大学的研究团队提出了一种创新的方法,将大语言模型(LLM)在文本图(Text-Attributed Graph, 缩写为TAG)学习中的强大能力蒸馏到本地模型中,以应对文本图学习中的数据稀缺、隐私保护和成本问题。通过训练一个解释器模型来理解LLM的推理过程,并对学生模型进行对齐优化,在多个数据集上实现了显著的性能提升,平均提高了6.2%。

构建支持和增强人类能力的AI工具,而不是试图完全取代人类。