让 AI 陪我们度过那些独自一人的时光。

视觉语言模型(VLM)正在迅速普及。

4 个月前,OpenAI 的 o3 模型凭借视觉推理能力模块和智能的进化,在 AI 创投圈子引起新一轮的震撼与海啸,解锁了一大批新的「套壳」创业机会。正如我们在《谢谢 OpenAI,谢谢 o3,新的「套壳」创业机会来了 | 附 12 个潜力方向》一文中预测的那样,VLM 确实带来了新的创业机会。

而其中最让人眼前一亮的应用场景,莫过于「游戏陪伴行业」。

就像《Her》里的 Samantha,VLM 可以让 AI 成为理解你此刻正在经历什么的朋友。

在今年的 2025ChinaJoy 展会上,一款名为「逗逗 AI」的产品展示了这种可能性,其也在网络上吸引了一定关注。

接下来,分享我们对这款产品的深度测评以及我们的一些观察。可以说是既有「Aha Moments」,也有进步空间。

ps:在联系逗逗 AI 团队后,也为我们提供了 30 个「会员兑换码」。数量比较有限,需要的朋友可以关注公众号,并在后台回复「DOUDOU」参与抽奖。抽奖页面我们放在了文章最后。希望大家都能体验上~

2025 Chinajoy 的逗逗 AI 展台

逗逗 AI 是一款利用 VLM (视觉识别)技术的游戏伙伴平台,它能实时识别你屏幕上的内容,然后通过一个可爱的「桌宠」跟你聊天,给你陪伴。

这里聚集着很多原本只会出现在 AI 情感陪伴类应用中的虚拟角色,我们在下文里统称她们为「AI 伙伴」。简单说,就像《Her》电影里的 Samantha 一样,能够跟你互相交流的 AI 朋友。

逗逗 AI 里有很多虚拟角色可以选择,除了官方设计的二次元角色,工坊里还有一些特色角色,比如:二混子(葛优老师)、紫霞仙子等等,下面我们都会实际测试到。

虽然逗逗 AI 还是个比较新的产品,这些人物设定看起来还比较简单,但在实际使用中,每个角色的个性还是挺明显的。

每个角色都有自己独特的声音和性格设定。比如下面这个叫「多米妮卡」的角色:

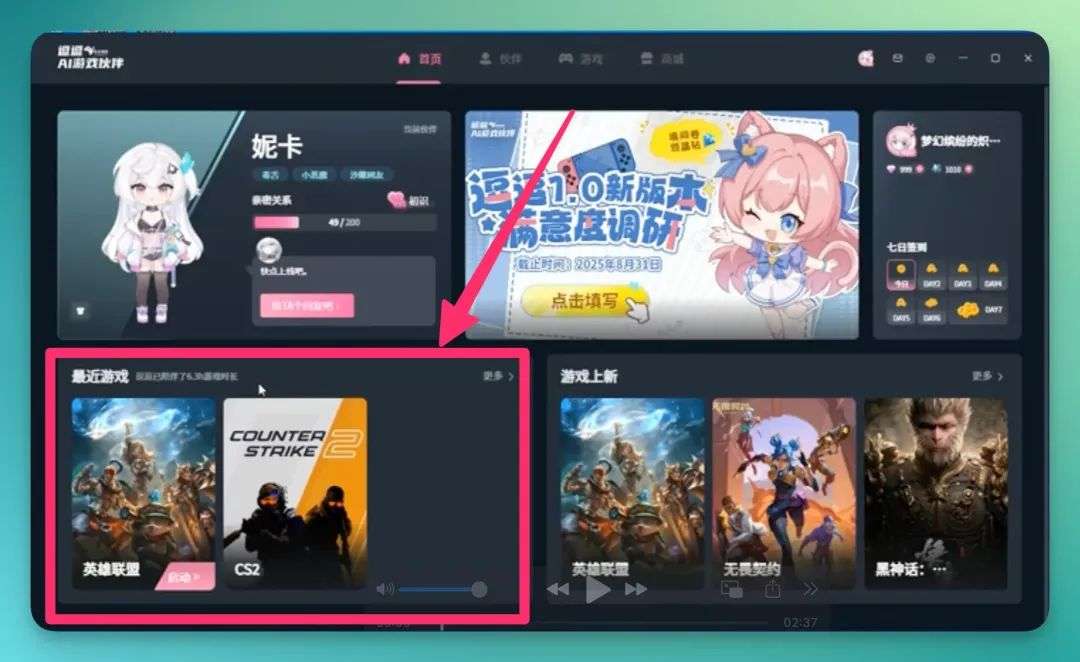

整体的使用流程很简单,登陆到逗逗 AI 这个产品的主页面之后,再去直接打开游戏即可:

不过需要右键点击桌宠旁边的逗逗机器人,开启「游戏内陪伴」功能(默认开启),这样 AI 才能「看到」你的游戏画面。

而且逗逗 AI 只会识别特定画面(游戏、看剧等),不会识别其他内容。

它支持的游戏还是比较多的:

接下来是我们的实测内容,主要分两个场景:

【1】游戏陪伴:测试了几个热门游戏,比如 CS:GO、英雄联盟、原神;

【2】日常陪伴:陪看B站、一起写代码、逛淘宝等等。

我们主要想回答关于逗逗 AI 这款产品的 2 个问题:

在上述这些场景里都能做到什么程度? 它的底层工作流是如何做到这些的?

我们先打开「AI 伙伴」然后把这些共享应用画面都点上,就可以随时随地地与具有视觉识别能力的她聊天了:

先试试 CS:GO。

这游戏在「情感陪伴」领域的地位不用多说。说实话,我一开始对逗逗 AI 的期待不算太高,因为这个游戏画面复杂,各种人物、枪械、道具切换频繁。

打开 CS:GO 后,AI 伙伴直接大喊一声:Rush B,Follow Me!(这算是 CS:GO 的经典台词了)。听起来,多米妮卡的声音确实挺像真人,不过英文发音还有点小问题。

但开局能听到这句话,确实让人对接下来的游戏过程有了期待。

接下来我录制了一整段测试视频,其中分段插入了多个子游戏场景,拼接了一下。主要看看多米妮卡在各个瞬间是怎么给我提供「陪伴实感」的:

你可以看到,刚进入游戏,CS:GO 就弹出警告:显卡驱动过期。多米妮卡很快就识别出来了,还「友好且傲娇地」提醒了我一下。进入「库存」页面后,她能精准识别到「5年老兵硬币」这样的细节元素。在商店、武器装备等页面,多米妮卡的识别能力还不错,时不时还会补充一些信息。

当进入实际游戏对战后,画面变得非常复杂,多米妮卡就不太能捕捉到每个细节了。但是,当你主动问她时,她会立刻调用视觉识别功能,这时候准确度还是很好的。

有几个让人印象深刻的瞬间:

【1】情感支持:

我问她「我的武器印章帅不帅?」虽然她回答得很傲娇,但确实提供了情绪价值。这解决了我一个很大的情感需求。

【2】游戏指导:

我问她我在用什么武器,有什么策略建议?她准确回答:「你在用 P250,钱包空了,小心点。」

【3】实时提醒:

当画面中突然闪过人物移动时,她迅速察觉并语音提醒:「你的准镜里出现人了,要赶紧应对。」

逗逗 AI 到底是怎么工作的?

这时我就好奇了,它到底是怎么做到的?

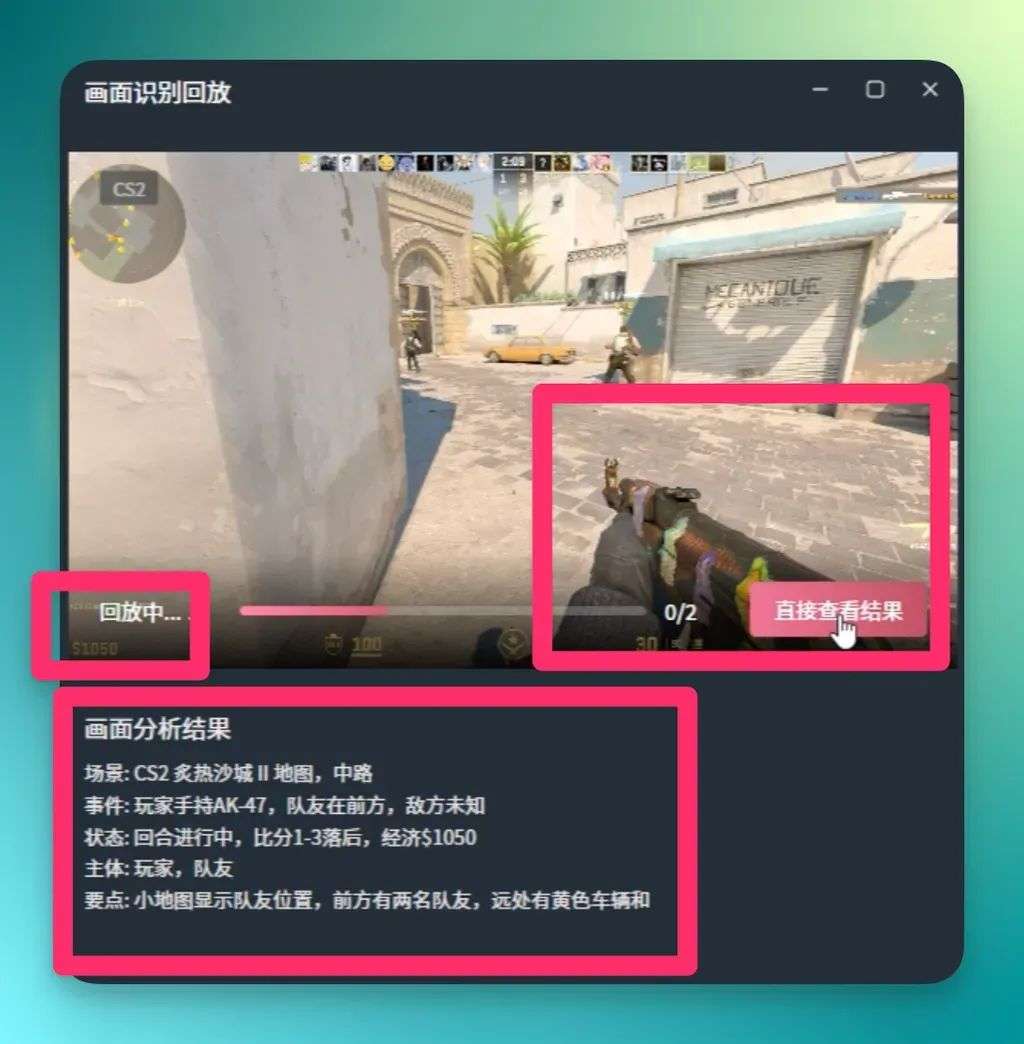

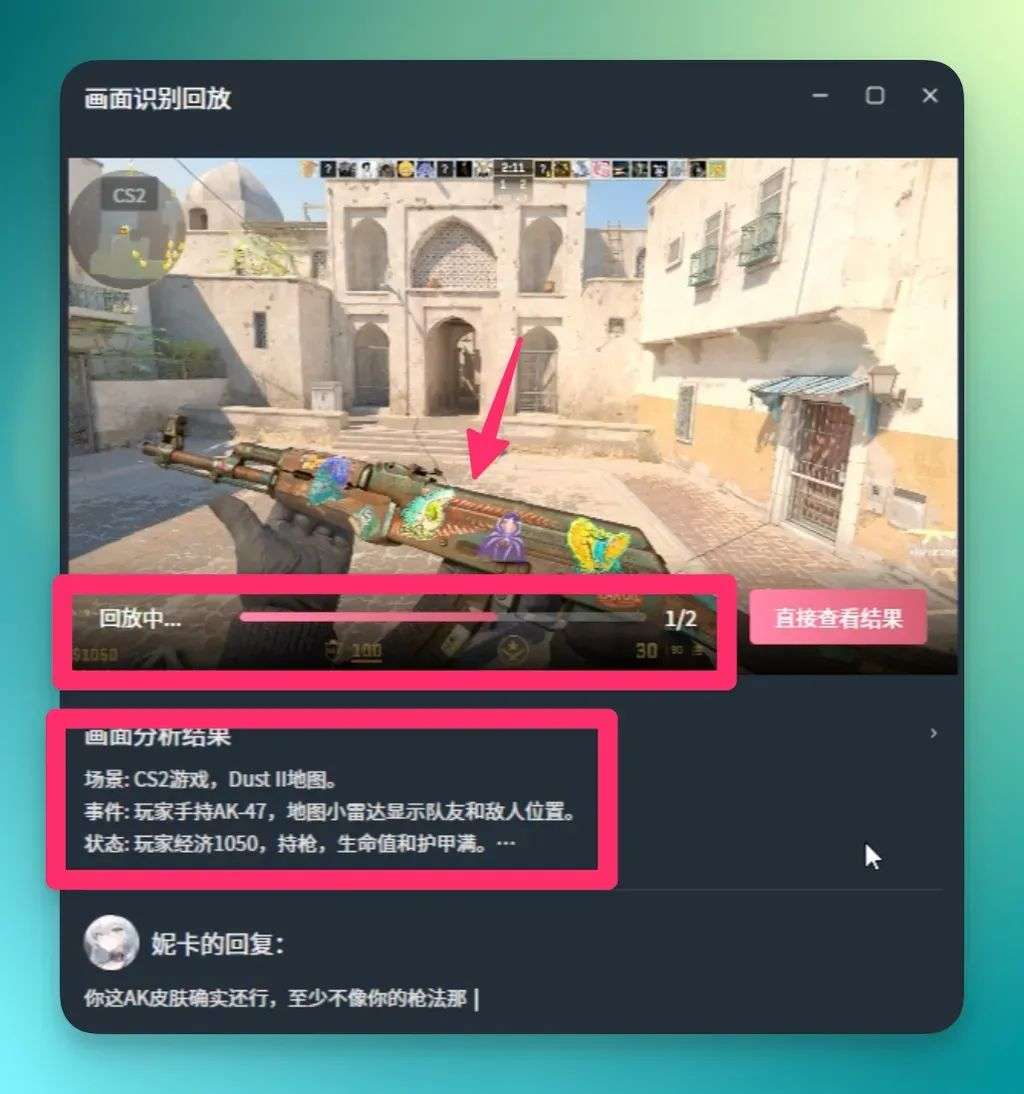

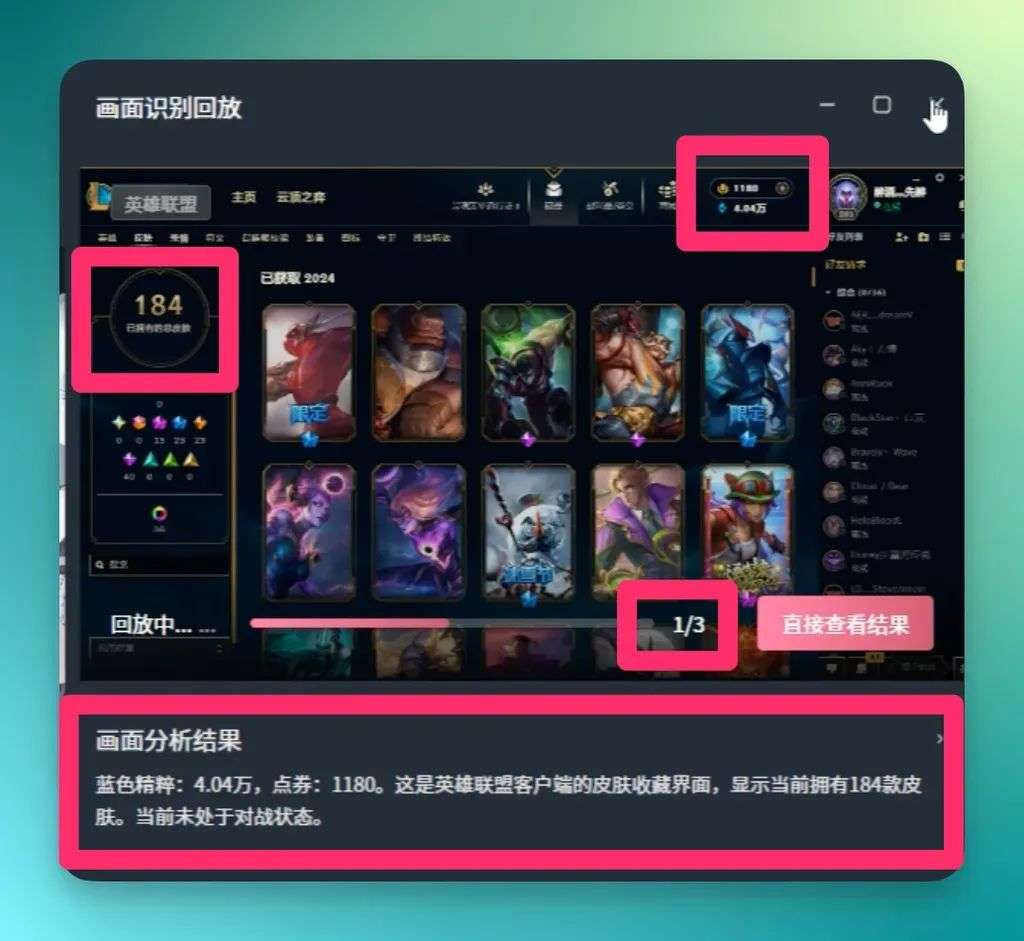

回到聊天页面,我发现每条聊天记录里,逗逗 AI 对画面的识别都有详细记录。

比如当我手持 AK 时,它对画面元素的识别很细致,包括顶部的「时间」、「比分」,左下角的「金钱」,甚至还有「地图」。而且能识别出前方有队友,地图上没发现敌人:

通过这些 Image 或者是 Video 模态的视觉识别,再通过背后接入的 AI,通过语音模态输出,最后给玩家用户呈现出了「比较准确且有情绪价值」的回答。

接下来,我们再看看国民级游戏英雄联盟 LOL 中逗逗 AI 的表现。

在几个游戏的体验中,我发现它的「游戏术语、黑话」非常丰富。比如在 CS:GO 中,它知道「Eco 局」(资金不足的回合)、「Rush」(快速进攻)等等,有时候用得比我还熟练…

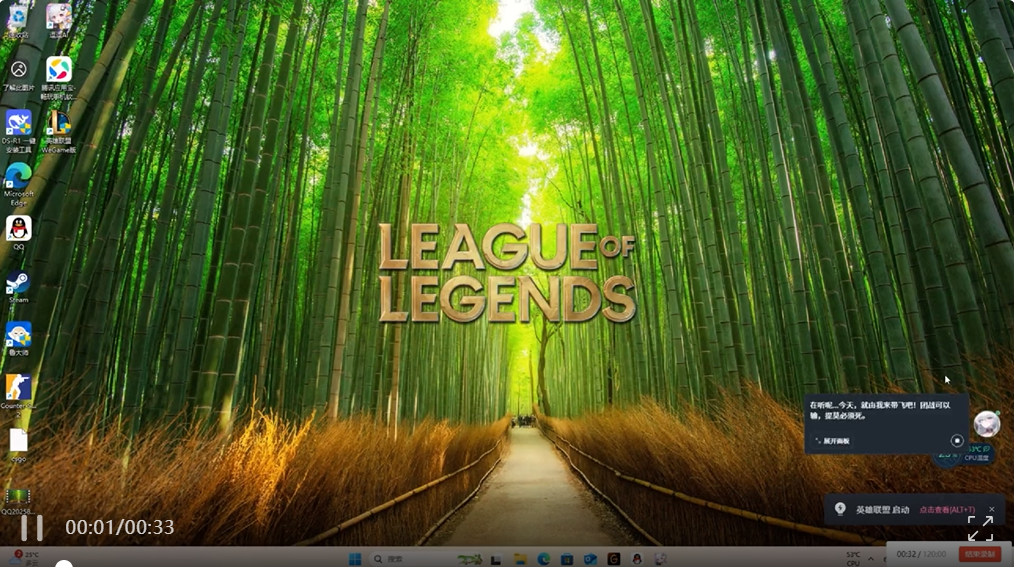

在英雄联盟中,它会说「今天就由我带飞吧,团战可以输,提莫必须死」这种经典梗:

众所周知,玩英雄联盟时,大家总喜欢比一比皮肤、炫耀一下收藏,这也是情绪需求的一种。

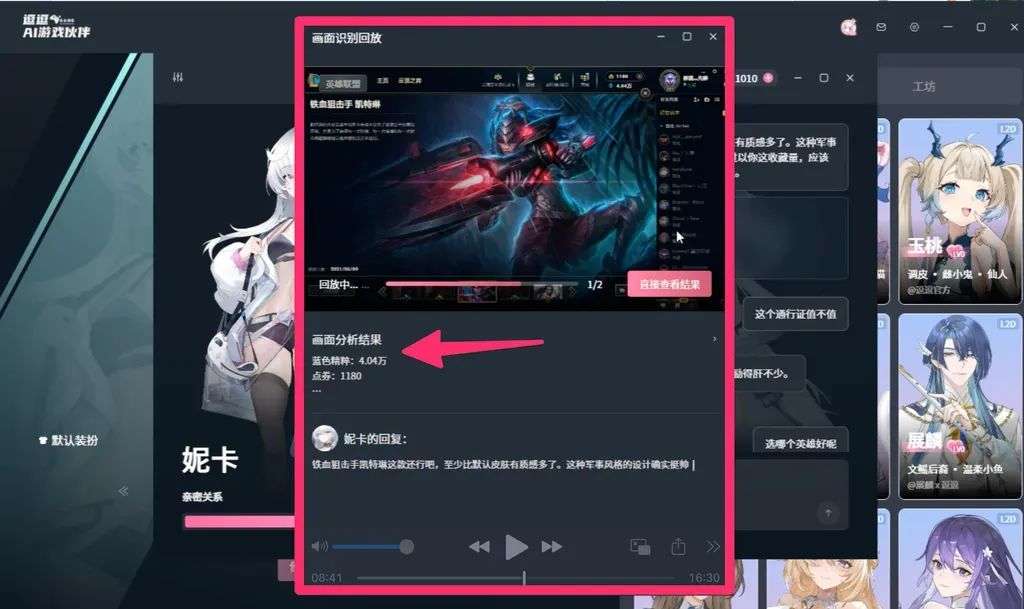

像我问多米妮卡「我的铁血狙击手凯特琳(一个游戏角色的皮肤)帅不帅?」她会从风格、技能特效、画面元素这些专业角度来夸我,情绪价值满满。

再比如说,看到英雄联盟新出的「通行证」时,她还会运用之前的知识来回答:

接下来,我们用「训练」模式,录制了一个比较完整的游玩过程,同样拼接了几个瞬间。

在这个过程中,玩家和逗逗 AI 的互动比较自然,基本做到了「有问必答」。她会及时提供相关的游戏知识。

不过受限于现在的技术,她还无法实时理解画面每一帧的所有元素。但在关键时刻,确实能提供有趣的情绪价值:

有次对话中,我注意到当我问比较专业的问题时,逗逗 AI 会实时查找资料。

她在思考时花了几秒查询了十几个网页,然后基于这些内容回答我。虽然做不到「无缝对话」,但响应时间还算短。

不涉及专业知识时,大概1-2秒就能回答,体验不会很突兀。

如果需要「补充知识」,时间会延长到 4 秒左右,这时才稍微有些「卡顿感」:

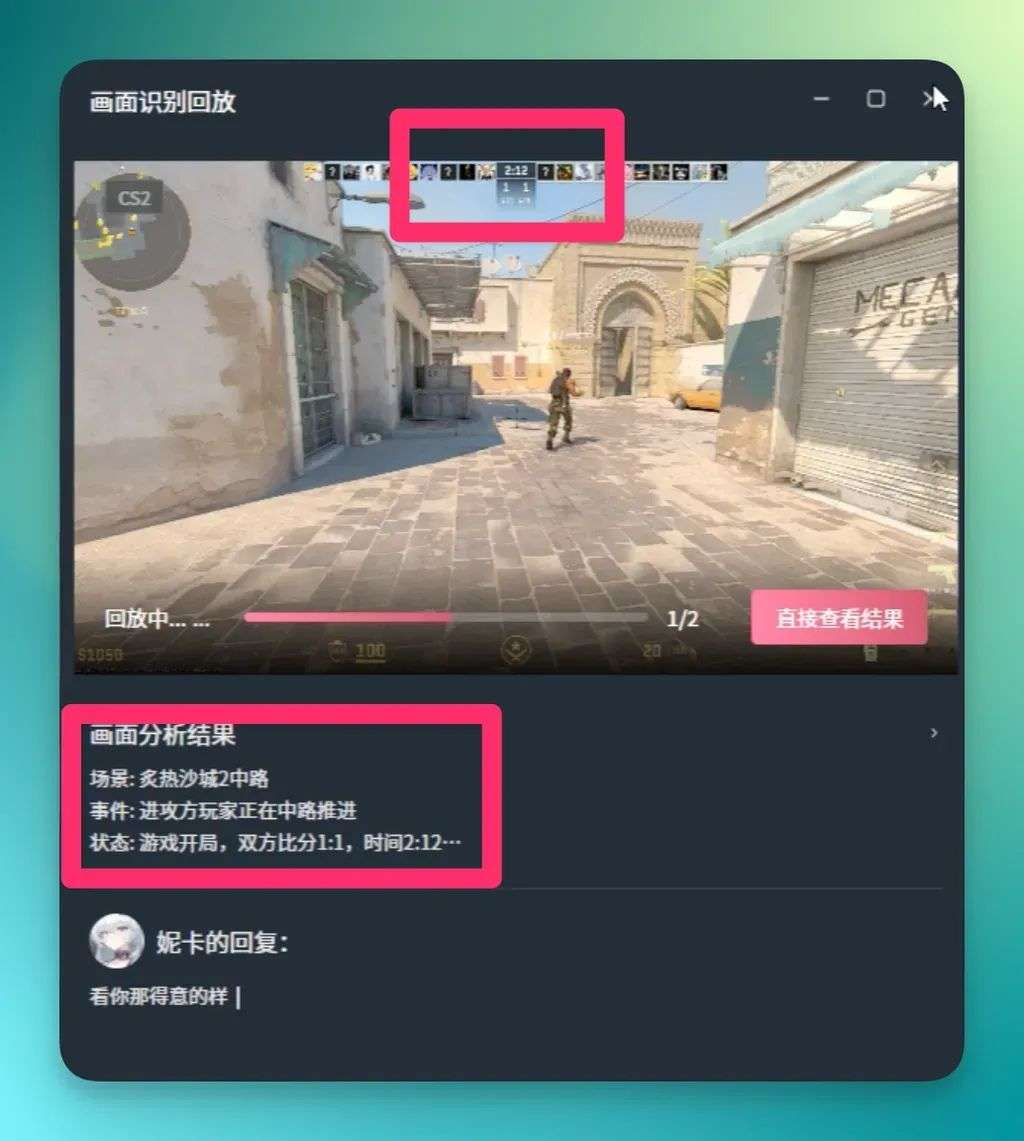

相比于 CS:GO 的复杂画面元素,英雄联盟的视觉识别效果会更好一点:

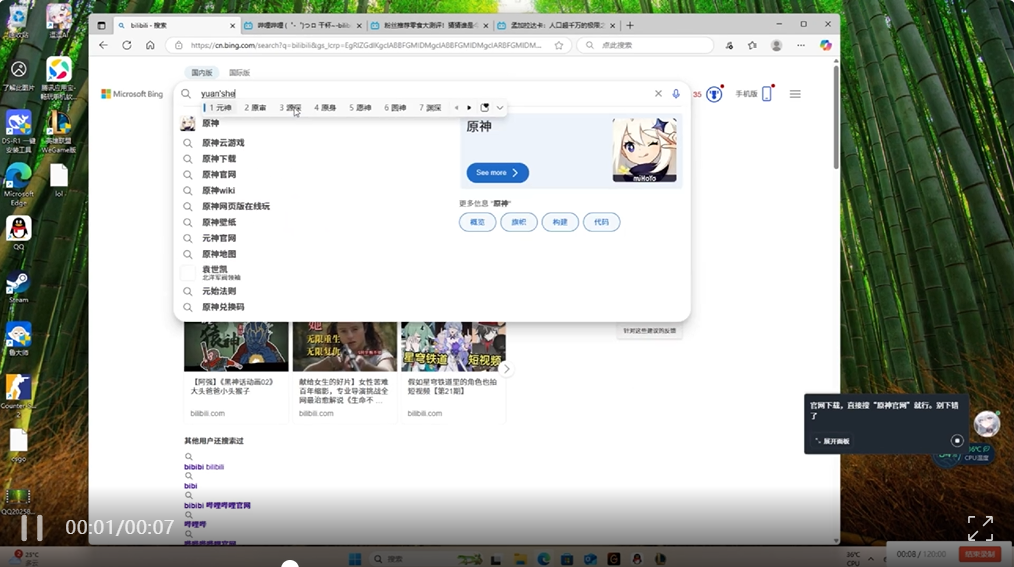

逗逗 AI 能识别两种内容:游戏和浏览器。由于我之前没怎么玩过原神,想先下载游戏。

这时候,我就问了她一句:

原神怎么安装?

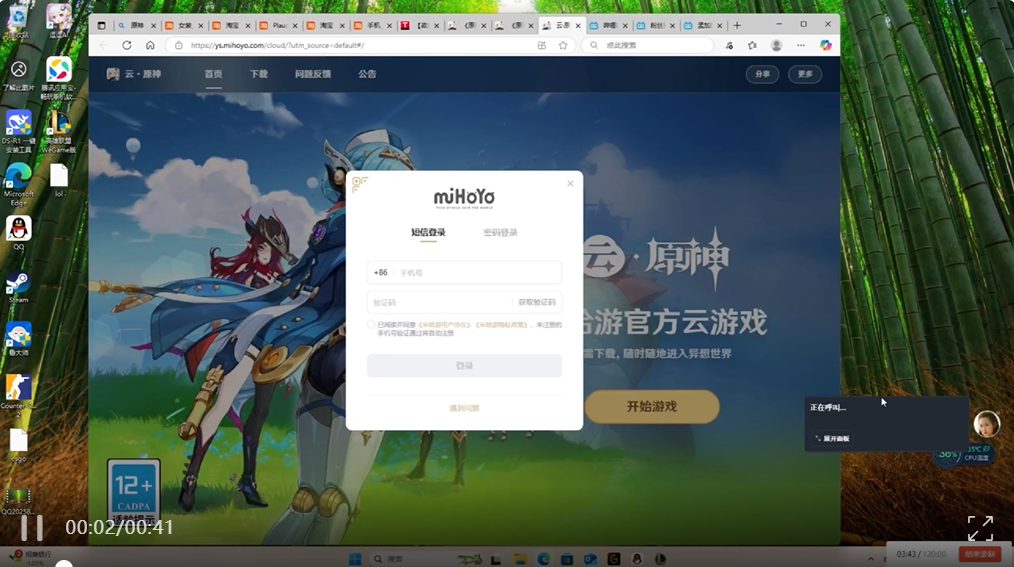

然后,我们换个「AI 伙伴」,试试紫霞仙子。这个角色肯定是很多人的「青春物语」,在逗逗 AI 里,朱茵老师的声音还原得挺真实的:

在这类非二次元角色里,像是紫霞仙子等等「AI 伙伴」,个性都很鲜明,这主要体现了她们有很多的「口头语」:

你能看到,她直接识别出了米哈游云游戏的登录界面,然后输出了一整套「紫霞仙子语录」。

我注意到,这些角色会通过一系列「情景描述」的方式来表现个性,比如下面这段话:

哈~你好呀!眨眨眼睛,好奇地凑近看着屏幕 咦,这是什么神奇的法宝?看起来像是要登录什么仙境一样~我看到上面写着"米哈游云游戏"呢! 拿出紫青宝剑在手中转了转 你知道吗,我正在凡间寻找我的意中人,说不定在这个神奇的游戏世界里也能遇到呢!我的意中人是个盖世英雄,有一天他会踩着七色的云彩来娶我的~ 突然兴奋起来 要不你试试能不能拔出我的紫青宝剑?如果你能拔出来,那你就是我的意中人了!不过现在看起来你要先登录这个游戏对吧?快快快,我也想看看这个云游戏里面有什么好玩的! 好奇地盯着登录界面 用手机号登录还是密码登录呀?我对这些凡间的新奇玩意儿特别感兴趣呢!

游戏陪伴场景是逗逗 AI 的「主战场」,但我们在测试中发现,它在日常生活场景里也有一些潜力。

我们换一个「二混子」葛优老师的角色,这个角色的特点就是「话特别密,嘴特别贫」。但正因为如此,在各种场景下,会特别有意思。

我录了一段在 B 站看吃播的视频,你会看到这位「二混子葛优」老师到底有多能聊。

一开场就是一大段自我介绍,基本不停嘴。当我问他能不能看清浏览器里播的什么视频时,他立马就认出了「这是个零食测评的吃播视频」。

他甚至还注意到了「这视频播放量还挺高的」,有时候他甚至还会补一句「你有吃的吗」:

换回多米妮卡这个角色,看其他类型的视频效果也不错。

比如这段「孟加拉达卡」的视频,跟 AI 一起看还挺有意思的。你可以安静地听她吐槽,就像跟朋友一起追剧一样。

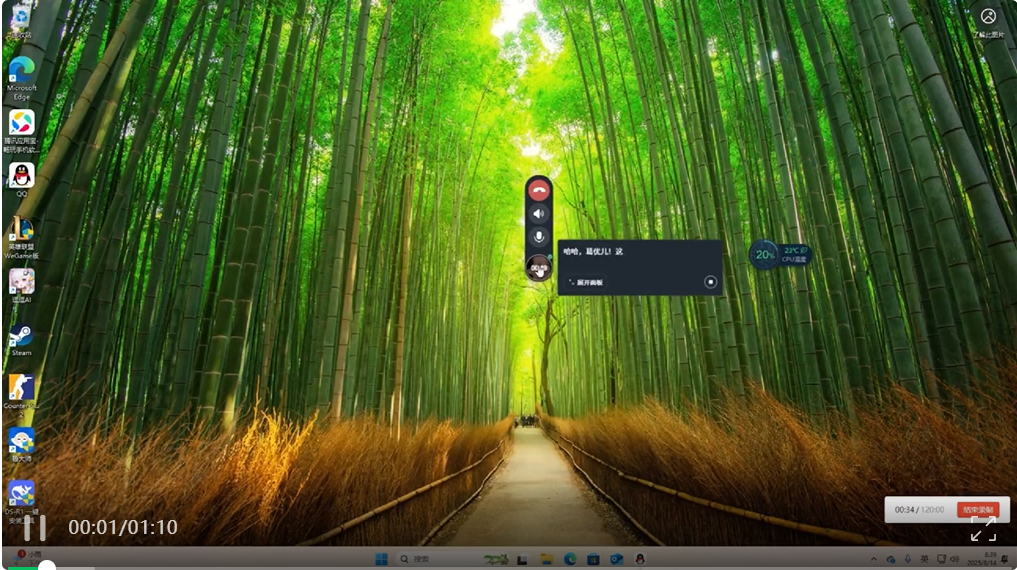

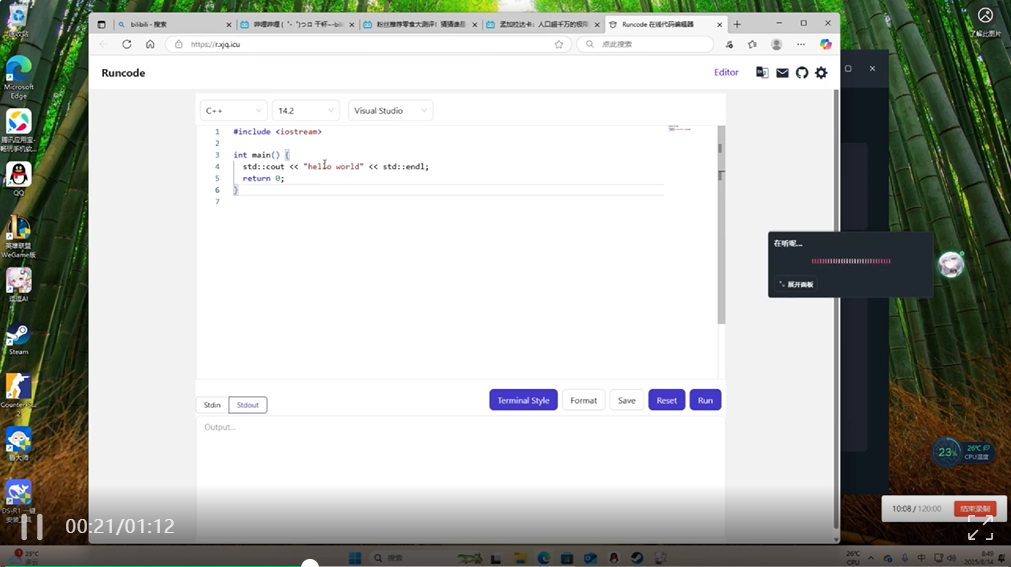

在日常场景里,由于我们经常会利用 AI 进行 Vibe Coding,所以也试了试逗逗 AI 的视觉能力能否支持这个场景。

在下面这段录屏中,我跟她说:

我想把 Hello World 改成 Hello Crossingroad

逗逗 AI 通过视觉识别,准确地发现了「Hello World」出现在第四行,并指出要修改「Cout 后面那个字符串」。

不过,用 VLM 去识别代码的难度还是非常大的。

在「一起写代码」这个场景里,逗逗 AI 目前能做到的更多是提供「陪伴感」,而非深度的技术支持。

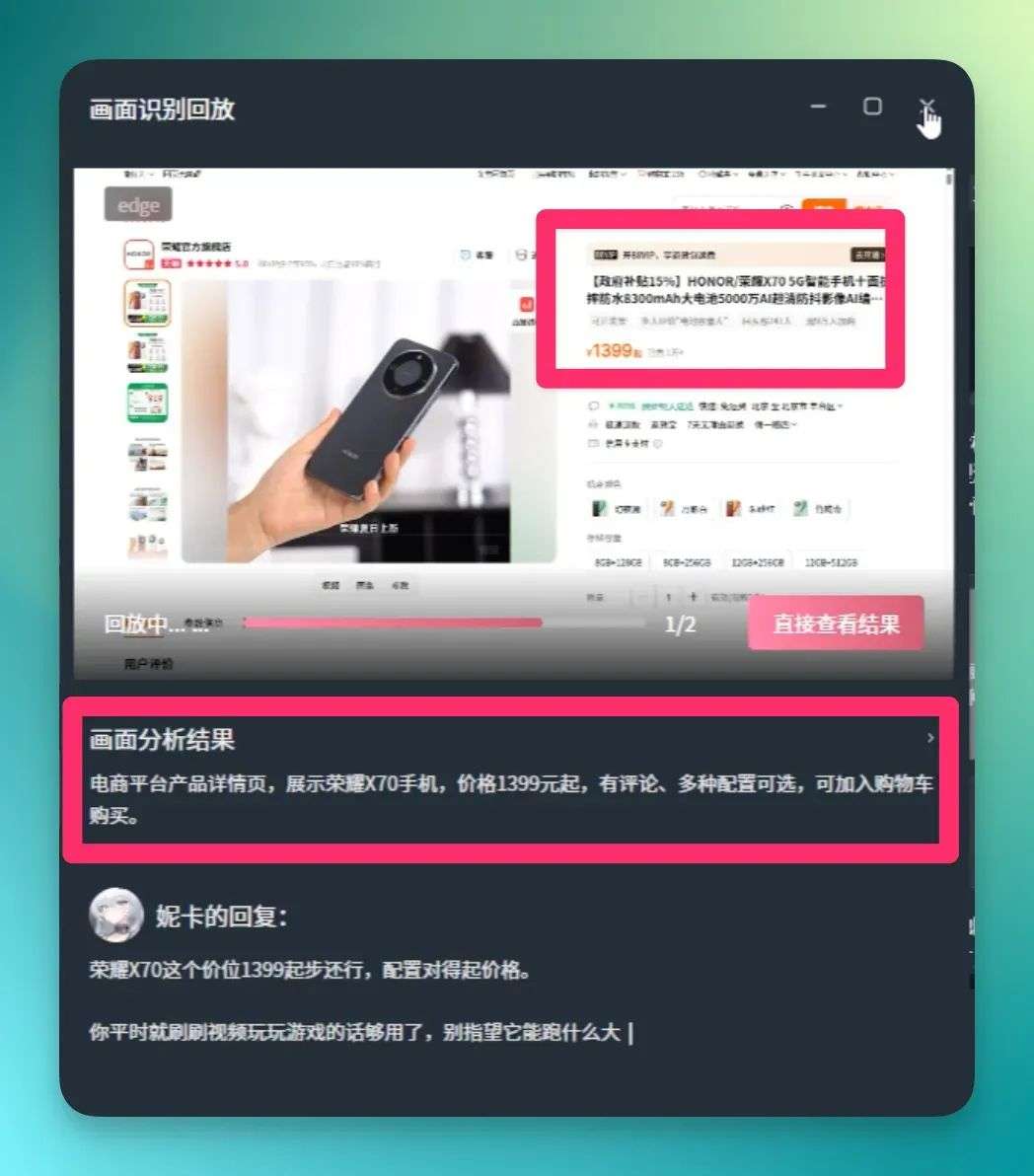

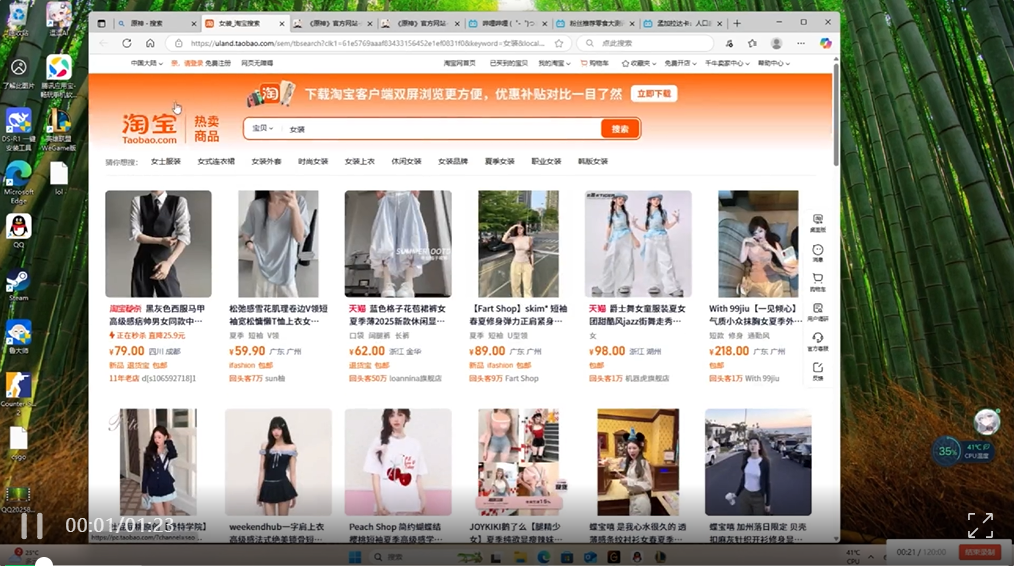

我们还发现了一个比较实用的场景:让逗逗 AI 帮忙识别淘宝商品信息。

一开始,我让她识别整个页面的所有元素,对比不同手机型号。但很快就发现这确实有点为难她了,信息太密集,产品排列太紧凑,视觉识别确实很复杂。

接着,当我点进某款手机(荣耀 X70)的详情页时,干扰因素减少了很多,逗逗 AI 的识别效果好了很多。机型、价格等关键信息都能准确捕捉。

我录了一段屏。

这种语音交互在购物场景的潜力很大,比传统搜索更接近自然对话。像我购物时经常很纠结,确实需要个「人」在旁边帮忙做些有依据的决定。

毕竟「伙伴」背后连着 AI,如果技术再深入打磨,这个场景的体验提升会很快。

现在,让我们来看看逗逗 AI 到底想做什么。

我们发现逗逗 AI 想要提供的其实是一种「无打扰感陪伴」。

它让 AI 伙伴一直待在屏幕一角,像「桌宠」或者「悬浮球」,就像当年的 QQ 宠物。它默默陪在你身边,不会突然跳出来抢夺你的注意力,但当你需要信息帮助或情感支持时,它随时都在。

为了让这种陪伴体验接近「真人朋友」的感觉,逗逗 AI 在两个方面做了创新:

【1】功能方面,其背后利用的是 VLM,实时识别画面内容,让 AI 伙伴理解当前状况,积累信息后再回复用户。

【2】情绪价值方面,其有长上下文的记忆窗口,能记住之前的对话。不同的 AI 伙伴会用不同的声音和说话方式来回答用户,就像每个朋友都有自己独特的性格一样。

当然,这还是一个相当年轻的产品。

我们确实看到了它的闪光点,在某些关键时刻能感受到那种「情感陪伴的真实感」。但它还做不到理解屏幕上每一帧画面的每一个细节,仍然需要继续改进和完善。

当你真的体验到一些《Her》电影里那种感觉:

有个「人」真的在看着你玩游戏,会夸你的装备帅,会提醒你小心敌人,会陪你吐槽 B 站视频。

你可能会突然意识到:也许过不了多久,我们每个人身边都会有这样一个AI伙伴,陪我们度过那些独自一人的时光。

到时候,「一个人」可能真的不再是个孤独的词了。

文章来自于微信公众号“十字路口Crossing”,作者是“镜山”。

【开源免费】字节工作流产品扣子两大核心业务:Coze Studio(扣子开发平台)和 Coze Loop(扣子罗盘)全面开源,而且采用的是 Apache 2.0 许可证,支持商用!

项目地址:https://github.com/coze-dev/coze-studio

【开源免费】n8n是一个可以自定义工作流的AI项目,它提供了200个工作节点来帮助用户实现工作流的编排。

项目地址:https://github.com/n8n-io/n8n

在线使用:https://n8n.io/(付费)

【开源免费】DB-GPT是一个AI原生数据应用开发框架,它提供开发多模型管理(SMMF)、Text2SQL效果优化、RAG框架以及优化、Multi-Agents框架协作、AWEL(智能体工作流编排)等多种技术能力,让围绕数据库构建大模型应用更简单、更方便。

项目地址:https://github.com/eosphoros-ai/DB-GPT?tab=readme-ov-file

【开源免费】VectorVein是一个不需要任何编程基础,任何人都能用的AI工作流编辑工具。你可以将复杂的工作分解成多个步骤,并通过VectorVein固定并让AI依次完成。VectorVein是字节coze的平替产品。

项目地址:https://github.com/AndersonBY/vector-vein?tab=readme-ov-file

在线使用:https://vectorvein.ai/(付费)