如何构建一个真正意义上的“自主代理”(Agent),而不是一个“带LLM的高级工作流”? 让钢铁侠中的“贾维斯”(J.A.R.V.I.S.)真正来到现实,不仅能对话,还能调动资源、控制机械、在复杂战局中自主执行多步任务。

几十年间,这似乎只是遥远的幻想。直到2022年,大语言模型(LLM)的爆发,让我们第一次感觉“贾维斯”近在咫尺。

最近,来自西班牙加泰罗尼亚理工大学和德国慕尼黑工业大学的研究者们发布了一篇论文《构建自主LLM代理的基础》(Fundamentals of Building Autonomous LLM Agents),就系统论述了一个专为解决这个工程困境而设计的“代理认知架构”。

如果你还不清楚“自主代理”和“RAG+Tools”到底有什么本质区别,以及构建自主LLM代理的基础,那么这篇论文则值得你好好看一看。https://arxiv.org/abs/2510.09244v1

在深入探讨技术蓝图之前,论文首先厘清了一个至关重要、却常常被混淆的概念:“工作流”(Workflows)与“代理”(Agents)的本质区别。

很多人认为,给LLM接上几个API或工具,让它按顺序执行1-2-3-4步,就是“代理”了。

研究者尖锐地指出:不,那不是代理,那顶多算是一个“工作流”。

一句话总结:工作流是在“执行指令”,而代理是在“自主决策”。这篇论文的目标,正是要构建后者。

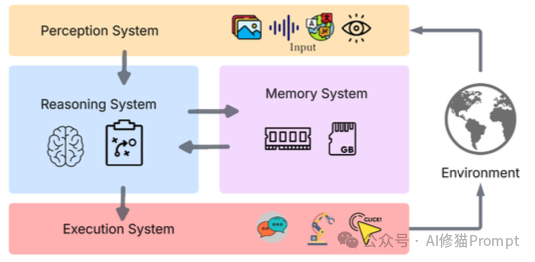

那么,如何将一个“罐中之脑”转变为一个自主的“代理”?研究者提出了一个模仿人类认知过程的四大核心系统架构。这四大支柱共同构成了代理的“心智与身体”:

1.感知系统 (Perception System)

2.推理系统 (Reasoning System)

3.记忆系统 (Memory System)

4.执行系统 (Execution System)

这四大系统通过一个持续的闭环协同工作:感知世界 -> 思考规划 -> 调取记忆 -> 执行行动 -> 感知新状态 -> 再次思考... 这就是自主智能的“心跳”。

接下来的内容,我们将深入论文的精华,逐一拆解这四大系统的实现细节、前沿技术和关键挑战。

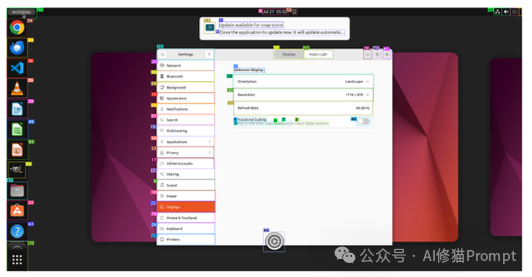

挑战:LLM的“母语”是文本。但现实世界(尤其是电脑GUI界面)是视觉的、动态的、充满噪音的。如何让一个“盲人”在图形界面上导航?

研究者详细阐述了从简单到复杂的四种感知策略:

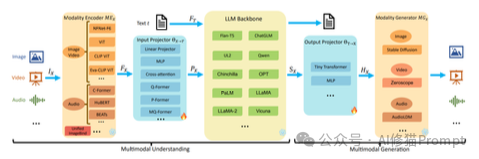

模态编码器(如ViT)将图像转为特征 -> 输入投影器将视觉特征“翻译”对齐到LLM的文本空间 -> LLM主干进行核心推理。关键洞见:解决“GUI接地”的双重感知

论文的精彩之处在于它如何解决代理在GUI操作中的最大痛点:“GUI接地”(GUI Grounding)即模型无法将“截图中看到的按钮”与“点击的精确坐标”完美对应起来。

论文给出的解决方案是一种“组合拳”,即 “视觉+结构”的双重感知。

role="button", label="Reply", state="unread")。当这两种信息结合起来,代理就获得了对界面的完美理解:它既能像人一样“看”到按钮的视觉布局,又能像程序一样“读”到按钮的准确功能和状态。

研究者给出了一个完美的示例来说明这一点。想象一个代理的任务是自动管理网页版电子邮件。

1.视觉捕捉:代理首先截取一张电子邮件应用的屏幕截图。

2.视觉标记 (SoM):它立即启动一个视觉编码器,对截图执行Set-of-Mark操作。这个编码器会在屏幕上每一个可交互的元素(如“回复”按钮、“删除”按钮、每封邮件的复选框)上画一个边界框,并存储所有这些框的精确坐标。

3.结构抓取 (Ally Tree):在同一时刻,代理通过浏览器自动化工具,检索该页面的“可访问性树”(Ally Tree)。

4.数据融合:现在,代理拥有了两份至关重要的数据:

button)、标签("Reply")和状态("unread")。5.形成感知:这两份数据结合起来,就构建了一个强大、可操作的GUI环境模型。当推理系统下达“点击‘回复’按钮”的指令时,代理可以轻松地:(1) 通过Ally树定位到role="button"且label="Reply"的元素;(2) 通过SoM数据查询到该元素对应的精确坐标;(3) 最后,执行系统生成点击该坐标的动作。

挑战:尽管如此,感知系统仍面临幻觉(“看”到不存在的物体) 和延迟(复杂的视觉处理太慢) 的巨大挑战。

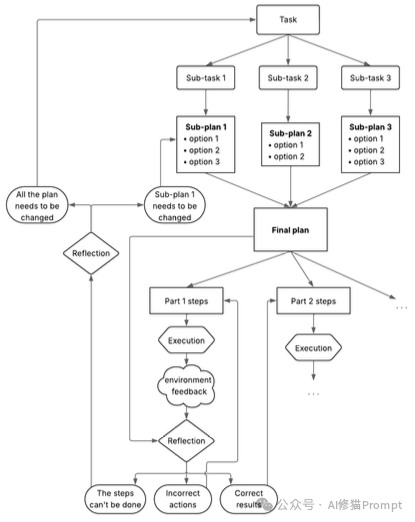

这是四大系统中的“大脑中枢”,也是论文中最核心、最复杂的部分。如果代理要实现自主,它就必须具备强大的规划、反思和纠错能力。

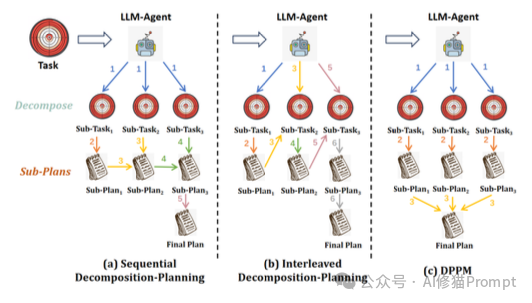

面对“预订一张从柏林到慕尼黑的下周二的火车票”这样的复杂任务,代理不能一步到位。它必须先学会“任务分解”。研究者介绍了两大流派:

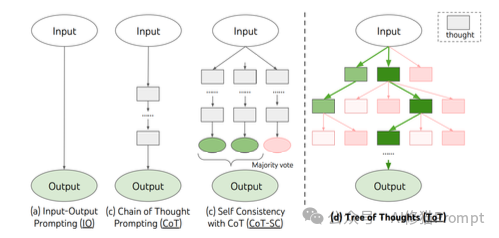

思考 -> 行动 -> 观察结果 -> 再次思考 -> 下一步行动...一个聪明的代理不应“一条路走到黑”。它必须能探索多种可能性,然后选择最优解。研究者详细介绍了从简单到复杂的“思维”技术:

这可能是实现真正自主智能的最关键机制。一个只会执行计划的代理是“机械”的,一个懂得“复盘”和“反思”的代理才是有“灵性”的。

研究者深入探讨了两种“反思”:

click_button工具,你应该先检查按钮是否存在”)。这些“反思”会被存入记忆,用于指导下一次尝试。

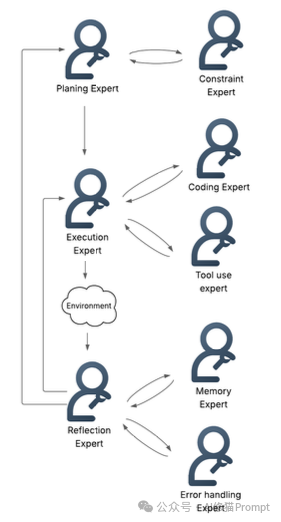

最后,研究者提出了一个极具扩展性的高级架构:与其让一个“全才”代理包办所有事,不如组建一个 “专家团队”(Multi-Agent System),让多个专门的代理协同工作。

这个“认知团队”可以包括:

这种“各司其职”的模块化设计,极大地提升了系统的能力、鲁棒性和可维护性。

挑战:LLM的核心局限之一是其有限的“上下文窗口”。这导致它们只有“短期记忆”(或称“工作记忆”)。一旦对话过长,早期的信息就会被遗忘。

一个自主代理必须拥有长期记忆,才能从过去的经验中学习,并保持行为的一致性。

研究者详细介绍了长期记忆的实现技术:

关键洞见:到底该存储什么?

拥有记忆系统后,一个更重要的问题是:我们应该往里面存什么?

挑战:“记忆管理” 当记忆库变得庞大时,就会出现 “记忆复制”(Memory Duplication)问题。如果存了100条“登录成功”的经验,不仅浪费空间,检索效率也低。 研究者提出了一种巧妙的 “记忆压缩”策略:当某个子目标(如“登录”)的成功序列存储达到一定数量(例如5条)时,系统会触发一次LLM调用,将这5条相似的序列“浓缩”成一个更通用、更鲁棒的统一计划,然后用这个新计划替换掉原来的5条旧记录。

挑战:推理系统产生的“计划”只是一个抽象的想法。执行系统是代理的“手脚”,负责将这个想法变为现实世界中的具体行动。

研究者介绍了从简单到复杂的执行机制:

send_email(to, body),search_web(query))。代理的“行动”就是生成一个结构化输出(通常是JSON),来指定它想调用哪个工具以及使用什么参数。这篇论文描绘了一幅令人振奋的蓝图,但也非常诚实地指出了通往真正自主智能的“拦路虎”。

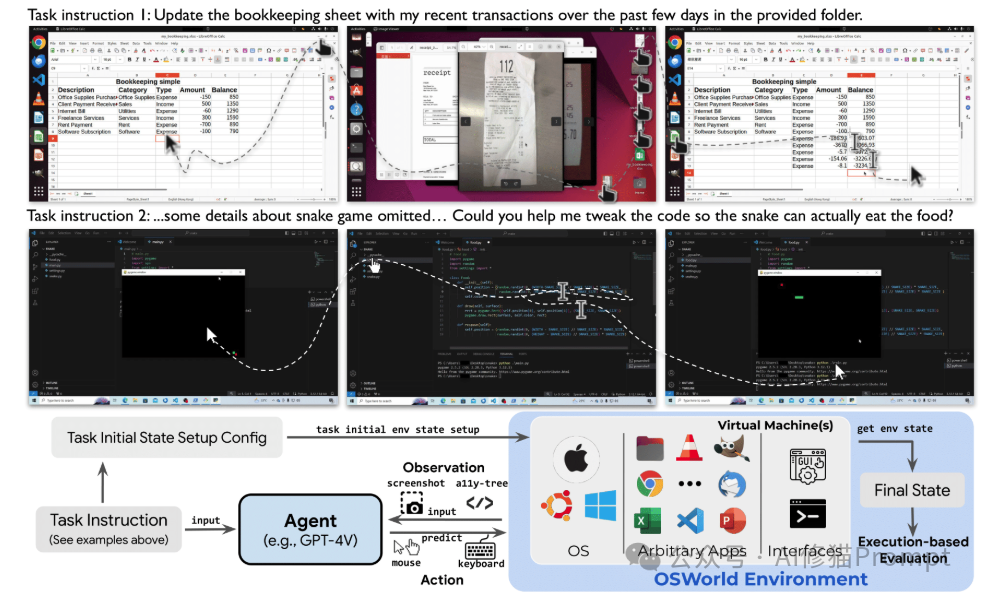

最大的挑战:与人类的巨大性能差距 研究者引用了一个名为OSWorld的基准测试,它要求代理在真实的操作系统环境中完成开放式任务。结果令人警醒:

这近30%的巨大鸿沟,源于几个核心难题:

这篇论文的价值远超一篇学术综述,它为所有致力于构建AIGC应用的工程师和产品经理提供了深刻的启示:

历史走到了必然的下一步:智能需要“肉身”。

我们正处于AI演化的第四个阶段,从“认知智能”迈向“自主智能”(Autonomous Intelligence)的黎明。

未来的道路还很漫长,研究者也指出了“一次性学习”(Learn-from-one-shot,即人类演示一次,代理就能学会) 这样更远大的目标。

这篇论文就是那座灯塔,它照亮的不仅是技术的前路,更是我们对“智能”本身定义的重塑。我们追求的,终将不是一个更快的计算器或更博学的百科全书,而是一个能与我们并肩作战、感知世界、执行任务、并不断进化的“认知协作者”。

文章来自于“AI修猫Prompt”,作者 “AI修猫Prompt”。

【开源免费】OWL是一个完全开源免费的通用智能体项目。它可以远程开Ubuntu容器、自动挂载数据、做规划、执行任务,堪称「云端超级打工人」而且做到了开源界GAIA性能天花板,达到了57.7%,超越Huggingface 提出的Open Deep Research 55.15%的表现。

项目地址:GitHub:https://github.com/camel-ai/owl

【开源免费】Browser-use 是一个用户AI代理直接可以控制浏览器的工具。它能够让AI 自动执行浏览器中的各种任务,如比较价格、添加购物车、回复各种社交媒体等。

项目地址:https://github.com/browser-use/browser-use

【开源免费】字节工作流产品扣子两大核心业务:Coze Studio(扣子开发平台)和 Coze Loop(扣子罗盘)全面开源,而且采用的是 Apache 2.0 许可证,支持商用!

项目地址:https://github.com/coze-dev/coze-studio

【开源免费】n8n是一个可以自定义工作流的AI项目,它提供了200个工作节点来帮助用户实现工作流的编排。

项目地址:https://github.com/n8n-io/n8n

在线使用:https://n8n.io/(付费)

【开源免费】DB-GPT是一个AI原生数据应用开发框架,它提供开发多模型管理(SMMF)、Text2SQL效果优化、RAG框架以及优化、Multi-Agents框架协作、AWEL(智能体工作流编排)等多种技术能力,让围绕数据库构建大模型应用更简单、更方便。

项目地址:https://github.com/eosphoros-ai/DB-GPT?tab=readme-ov-file

【开源免费】VectorVein是一个不需要任何编程基础,任何人都能用的AI工作流编辑工具。你可以将复杂的工作分解成多个步骤,并通过VectorVein固定并让AI依次完成。VectorVein是字节coze的平替产品。

项目地址:https://github.com/AndersonBY/vector-vein?tab=readme-ov-file

在线使用:https://vectorvein.ai/(付费)

【开源免费】AutoGPT是一个允许用户创建和运行智能体的(AI Agents)项目。用户创建的智能体能够自动执行各种任务,从而让AI有步骤的去解决实际问题。

项目地址:https://github.com/Significant-Gravitas/AutoGPT

【开源免费】MetaGPT是一个“软件开发公司”的智能体项目,只需要输入一句话的老板需求,MetaGPT即可输出用户故事 / 竞品分析 / 需求 / 数据结构 / APIs / 文件等软件开发的相关内容。MetaGPT内置了各种AI角色,包括产品经理 / 架构师 / 项目经理 / 工程师,MetaGPT提供了一个精心调配的软件公司研发全过程的SOP。

项目地址:https://github.com/geekan/MetaGPT/blob/main/docs/README_CN.md

【开源免费】FASTGPT是基于LLM的知识库开源项目,提供开箱即用的数据处理、模型调用等能力。整体功能和“Dify”“RAGFlow”项目类似。很多接入微信,飞书的AI项目都基于该项目二次开发。

项目地址:https://github.com/labring/FastGPT

【开源免费】graphrag是微软推出的RAG项目,与传统的通过 RAG 方法使用向量相似性作为搜索技术不同,GraphRAG是使用知识图谱在推理复杂信息时大幅提高问答性能。

项目地址:https://github.com/microsoft/graphrag

【开源免费】Dify是最早一批实现RAG,Agent,模型管理等一站式AI开发的工具平台,并且项目方一直持续维护。其中在任务编排方面相对领先对手,可以帮助研发实现像字节扣子那样的功能。

项目地址:https://github.com/langgenius/dify

【开源免费】RAGFlow是和Dify类似的开源项目,该项目在大文件解析方面做的更出色,拓展编排方面相对弱一些。

项目地址:https://github.com/infiniflow/ragflow/tree/main

【开源免费】phidata是一个可以实现将数据转化成向量存储,并通过AI实现RAG功能的项目

项目地址:https://github.com/phidatahq/phidata

【开源免费】TaskingAI 是一个提供RAG,Agent,大模型管理等AI项目开发的工具平台,比LangChain更强大的中间件AI平台工具。

项目地址:https://github.com/TaskingAI/TaskingAI

【开源免费】XTuner 是一个高效、灵活、全能的轻量化大模型微调工具库。它帮助开发者提供一个简单易用的平台,可以对大语言模型(LLM)和多模态图文模型(VLM)进行预训练和轻量级微调。XTuner 支持多种微调算法,如 QLoRA、LoRA 和全量参数微调。

项目地址:https://github.com/InternLM/xtuner

【开源免费】LangGPT 是一个通过结构化和模板化的方法,编写高质量的AI提示词的开源项目。它可以让任何非专业的用户轻松创建高水平的提示词,进而高质量的帮助用户通过AI解决问题。

项目地址:https://github.com/langgptai/LangGPT/blob/main/README_zh.md

在线使用:https://kimi.moonshot.cn/kimiplus/conpg00t7lagbbsfqkq0