一页纯文本的记忆是看不清世界的。

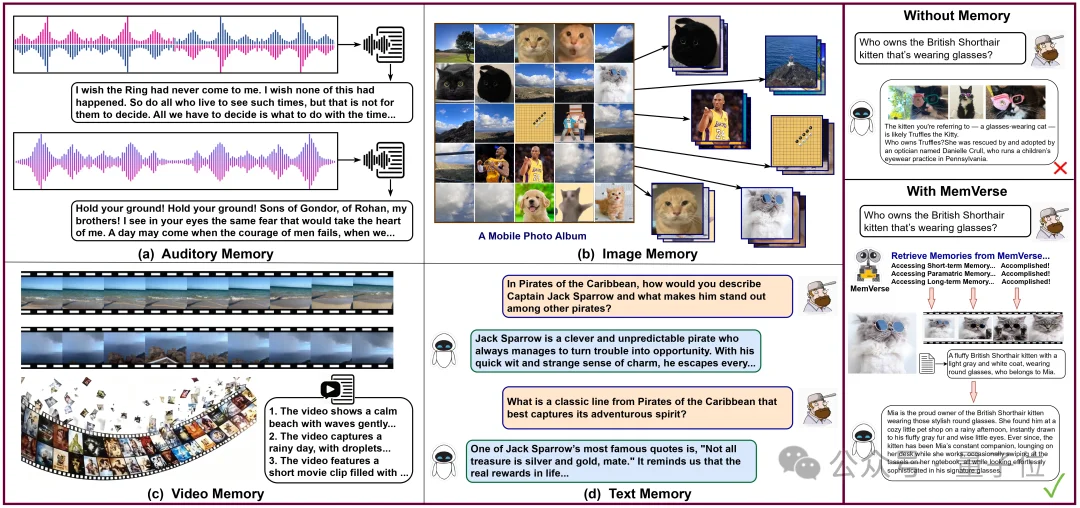

人与世界的交互天然是多模态的。一张产品设计图、一段用户操作录屏、一次包含语音和演示的线上会议,这些由图像、声音、视频构成的高维业务信息,正成为驱动AI智能体创造价值的关键来源。

当前绝大多数“长期记忆”系统在架构上仍设计为纯文本的记忆库。但智能体的“记忆”不应该是扁平的文本日志,而是一个能够记录并关联 “在何时、看到了何物、讨论了何事” 的多维体验图谱。这种跨模态、跨时间的记忆关联与融合能力,是智能体从被动工具进化为智能助手的关键要素。

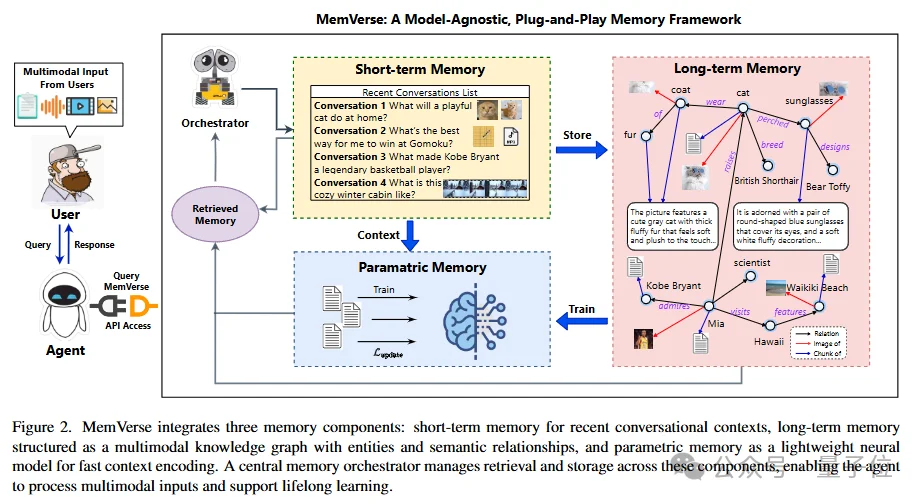

为了攻克这一挑战,上海人工智能实验室正式开源MemVerse—首个面向智能体的通用多模态记忆框架。它突破性地将图像、音频、视频等多模态信息与文本对齐到统一的语义空间进行记忆,并首创 “双通路”架构与“记忆蒸馏” 技术,让智能体首次拥有了可成长、可内化、秒级响应的终身记忆能力。

Agent需要的不是更大的“硬盘”,而是一个会思考的“大脑”。

现有的LLM Agent,无论上下文窗口如何扩展,仍面临灾难性遗忘与模态割裂的双重困境。

传统方法在处理文本时尚可应对,一旦面对图像、视频等多模态信息流,便显得力不从心,通常只能进行机械的切片与检索,无法理解信息内在的时空逻辑与跨模态语义。

针对这一根本性挑战,上海人工智能实验室-数据前沿团队提出全新解决方案:多模态记忆系统MemVerse。

它从人类认知的经典记忆模型中汲取灵感,旨在构建一个包含中央协调器、双通路记忆与参数化蒸馏的完整闭环,实现从“被动数据检索”到“主动记忆运用”的范式转移。

MemVerse的核心是一个精密的三层仿生记忆架构,模拟了人类信息从暂存、结构化到内化的完整认知过程。

在权威基准测试中,MemVerse证明了其架构的优越性:

ScienceQA(科学问答): 搭载MemVerse后,GPT-4o-mini的综合得分从76.82跃升至85.48,实现了接近9个百分点的跨越式提升。

这意味着,MemVerse能让一个轻量级商用模型获得堪比千亿参数大模型的深度认知能力,为开发高性价比的“小而强”智能体提供了关键技术路径。

MSR-VTT(视频检索): 得益于多模态知识图谱,MemVerse在视频细节回忆上的R@1召回率大幅超越了CLIP(29.7%)等传统方法,更显著超过了包括ExCae(67.7%)、VAST(63.9%)在内的专用大模型。

极致效率:通过高效的记忆压缩与知识“蒸馏”机制,MemVerse 在维持高精度的同时,能减少高达90%的Token消耗,大幅降低了长期记忆的运营成本与延迟。

凭借独特的双通道记忆设计,MemVerse 将关键记忆的提取速度提升至毫秒级。

MemVerse为构建具备终身学习能力的智能体提供了一套通用、可扩展的多模态记忆范式,较小的模型也能通过搭载MemVerse具备深度的记忆与推理能力。

目前,该项目已由上海人工智能实验室开源,欢迎开发者试用。

论文地址:https://arxiv.org/pdf/2512.03627

项目主页:https://dw2283.github.io/memverse.ai

GitHub:https://github.com/KnowledgeXLab/MemVerse

文章来自于“量子位”,作者 “MemVerse团队”。

【开源免费】Browser-use 是一个用户AI代理直接可以控制浏览器的工具。它能够让AI 自动执行浏览器中的各种任务,如比较价格、添加购物车、回复各种社交媒体等。

项目地址:https://github.com/browser-use/browser-use

【开源免费】AutoGPT是一个允许用户创建和运行智能体的(AI Agents)项目。用户创建的智能体能够自动执行各种任务,从而让AI有步骤的去解决实际问题。

项目地址:https://github.com/Significant-Gravitas/AutoGPT

【开源免费】MetaGPT是一个“软件开发公司”的智能体项目,只需要输入一句话的老板需求,MetaGPT即可输出用户故事 / 竞品分析 / 需求 / 数据结构 / APIs / 文件等软件开发的相关内容。MetaGPT内置了各种AI角色,包括产品经理 / 架构师 / 项目经理 / 工程师,MetaGPT提供了一个精心调配的软件公司研发全过程的SOP。

项目地址:https://github.com/geekan/MetaGPT/blob/main/docs/README_CN.md

【免费】ffa.chat是一个完全免费的GPT-4o镜像站点,无需魔法付费,即可无限制使用GPT-4o等多个海外模型产品。

在线使用:https://ffa.chat/

【开源免费】XTuner 是一个高效、灵活、全能的轻量化大模型微调工具库。它帮助开发者提供一个简单易用的平台,可以对大语言模型(LLM)和多模态图文模型(VLM)进行预训练和轻量级微调。XTuner 支持多种微调算法,如 QLoRA、LoRA 和全量参数微调。

项目地址:https://github.com/InternLM/xtuner