老黄稳准狠,谷歌的TPU威胁刚至,就钞能力回应了。

200亿美元说砸就砸,只为拉拢一家炙手可热的「铲子新工厂」——Groq。

这无疑也标志这家芯片巨头,面向AI新时代的一次重大布局。但在某种程度上,也的确反映出老黄对包括TPU在内等一众新芯片范式的担忧。

所以,Groq究竟能为英伟达带来什么?

针对这个问题,知名科技投资人Gavin Baker发表了自己的观点。

而他的这一连串技术剖析,纷纷指向了英伟达帝国防守最薄弱的那块领土——推理。

推理方面,Groq LPU的速度远超GPU、TPU,以及目前所见的任何ASIC。

这一观点得到大量网友点赞:

GPU架构根本无法满足推理市场对低延迟的需求,片外HBM显存速度实在太慢了。

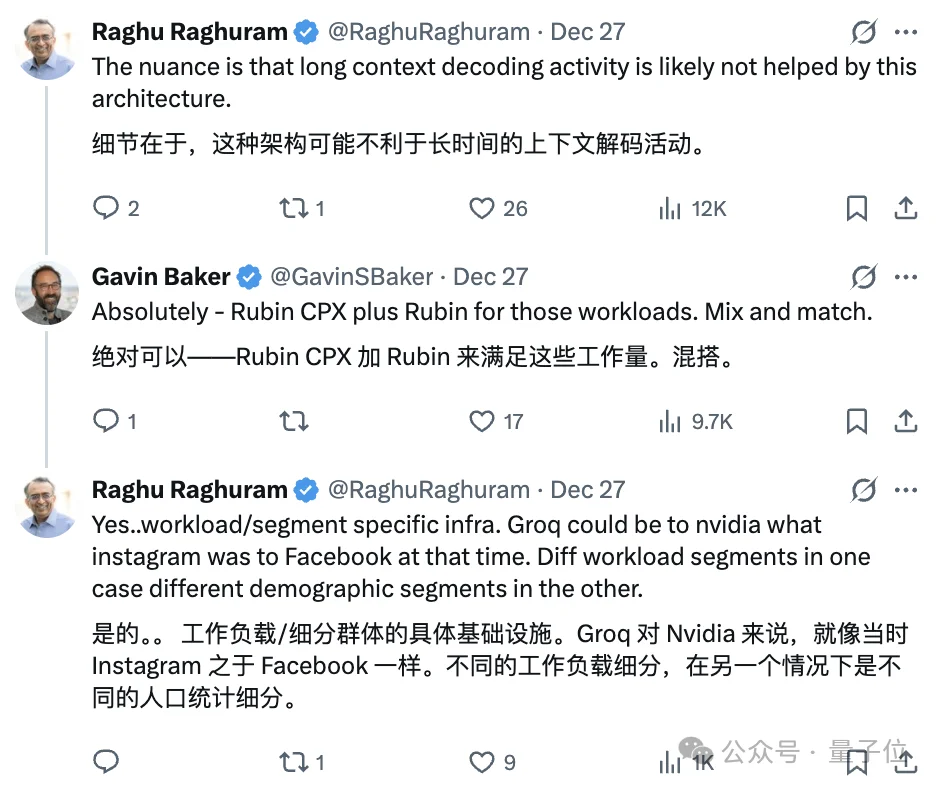

但也有网友指出,LPU所采用的SRAM,或许并不能胜任长下文decode。

对此,Gavin认为英伟达可以通过产品「混搭」的方式解决。

下面具体来看——

Gavin认为,GPU在新时代水土不服的根本原因在于——推理过程的两个阶段,prefill和decode,对芯片能力有截然不同的要求。

先看prefill:

这一步,简单来说就是让模型「读题」,把用户提供的关键信息在脑子里记好,用于后续调用。

读题过程中,模型会一次性吃下用户所给的上下文,所有输入token都可以同时计算。

这正是GPU最擅长的舞台,其为图形处理而生,可以一次性计算数千个像素,天生适合处理并行任务。

在这个准备阶段,模型不用急着响应用户问题。即便有延迟,模型也完全可以通过显示「思考中」来掩盖等待时间。

因此,相比「速度」,prefiil需要芯片有更大的上下文容量。

但到了decode,这套逻辑不再适用。

decode是串行任务,必须得一个一个token挨着算。更重要的是,用户还会亲眼看到token被一个个「打」出来的过程。这种情况下,延迟对用户体验来说是致命的。

然而,GPU的数据主要存放在HBM,而不是紧贴算力核心的片上存储。这意味着,每生成一个token,GPU都需要重新从内存中读取数据。

这时候,GPU的问题就暴露出来了——大部分算力都处于闲置,FLOPs根本用不满,常常在等内存把数据搬过来,实际计算量远小于prefill。

相比之下,Groq有更好的解决方案——LPU。

比起HBM,LPU使用直接集成在芯片硅片中的SRAM。这种片上存储的模式不需要读取数据,这让其速度比GPU快100倍。即使只处理单个用户,它也能跑出每秒300–500个token的速度,并能始终保持满负荷运转。

事实证明,在速度这一块,LPU几乎打遍天下无敌手——不仅是GPU,就连TPU,以及市面上绝大多数ASIC都难以望其项背。

但这并非没有代价的。

相比GPU,LPU的内存容量小的多。单颗Groq的LPU芯片,片上SRAM只有230MB。

作为对比,即便是英伟达的H200 GPU,也配备了高达141GB的HBM3e显存。

结果就是:你必须把成百上千颗LPU芯片连在一起,才能跑起一个模型。

以Llama-3 70B为例,用英伟达GPU的话,只需要两到四张卡,塞进一个小型服务器盒子里就能搞定。而同样的模型,需要数百颗LPU,占地面积也将远大于使用GPU的数据中心。

这意味着,即便单颗LPU价格更低,整体硬件投资依然会非常巨大。

因此,AI公司在考虑LPU时,最重要的问题是——

用户是否愿意为「速度」付费?

对于这个问题,一年前的市场还不无法给出答案。但从Groq如今的业绩情况来看已经非常明确:「速度」是个真实存在的巨大需求,并且仍在高速成长。

而对英伟达而言,这不仅是一个新的业务盘,更是一个颠覆者暗流涌动的高风险地带。倘若错失这个风口,英伟达在AI时代的机会可能会被新玩家颠覆,就像英伟达当年通过游戏业务颠覆其他竞争对手一样。

为了抵抗这些竞争者蚕食自己的护城河,英伟达选择注射名为Groq的疫苗。希望通过人才收购引入新血液,补齐这块低延迟场景的推理短板,帮助英伟达这艘巨舰摆脱创新者窘境。

TPU的崛起,给英伟达的金钟罩撕开了一道裂缝。

通过自研芯片,谷歌成功摆脱了对英伟达天价GPU的依赖,这在很大程度上帮助谷歌削薄了训练和推理成本,这让谷歌在服务大量免费用户的情况下,依然能维持相当健康的财务账面。

谷歌通过Gemini 3 Pro的绝地翻盘,证明了GPU并非AI时代的唯一解。在技术周期高速迭代的背景下,作为AI「心脏」的芯片,也需要根据不同的发展阶段做出相应的调整。

随着基础模型的进展放缓,AI竞争的重点开始从训练层转向应用层。而在AI应用市场,「速度」对用户体验而言至关重要。

而这次人才收购Groq,虽然也是变相承认了公司在推理赛道的不足,但同样标志着英伟达帝国的又一次扩张。

称霸预训练的英伟达,这次要借Groq的东风,入局竞争对手喷涌而出的「推理大陆」。

而在这个新市场,英伟达或许不再能像如今这样风光。

正如Groq CEO所言,推理芯片是项高销量、低利润的苦活。这与即便炒到天价也有客户抢着要,毛利率高达70-80%的GPU截然不同。

参考链接:

[1]https://x.com/gavinsbaker/status/2004562536918598000

[2]https://www.uncoveralpha.com/p/the-20-billion-admission-why-nvidia

文章来自于“量子位”,作者 “Jay”。