本篇论文已被 ACL 2026 接收,主要作者来自上海交通大学自动化与感知学院 IWIN 中心团队。团队负责人为关新平教授,指导老师为陈彩莲教授和乐心怡教授,合作作者还包括南洋理工大学陶大程教授。其他作者来自腾讯、上海人工智能实验室、香港中文大学等机构。第一作者王骥泽为上海交通大学博士生,研究方向为大模型智能体。

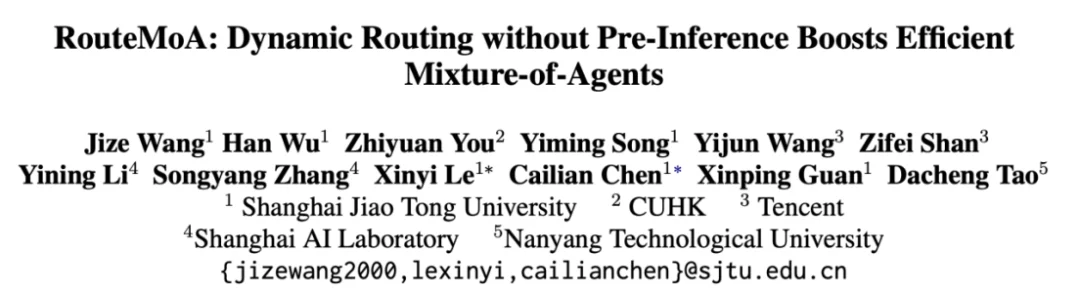

近年来,大语言模型的发展,正在从 “单模型能力提升” 走向 “多模型协作”。这是一个很自然的方向:既然不同模型各有所长,有的擅长数学,有的擅长代码,有的更懂医学,那为什么不让它们协同起来,共同解决更复杂的问题?

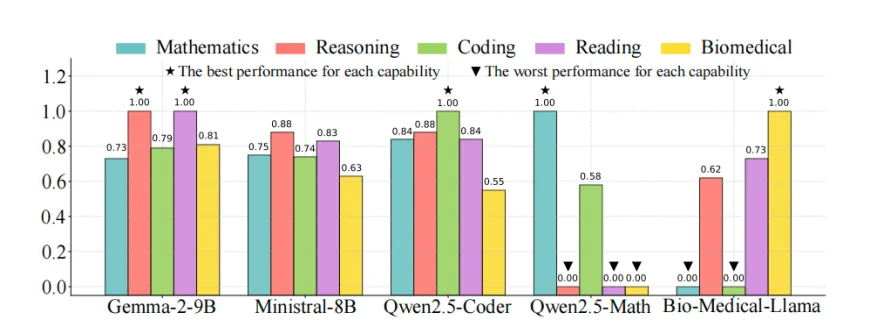

Mixture-of-Agents(MoA)正是在这样的背景下提出的。它通过让多个模型并行生成、逐层交互、反复融合,往往能够得到比单一模型更强的结果。问题也很明显:性能提升的同时,成本和延迟也随之迅速上升。

在标准 MoA 中,每一轮通常都要调用多个模型,再基于它们的输出进行筛选和融合。但究竟该让哪些模型参与、哪些模型可以跳过,往往缺乏明确的选择机制。模型越多、层数越深,整体开销就越高,在大规模模型池场景下,系统效率和可扩展性都会面临很大挑战。

也正因如此,研究者开始尝试让 MoA 变稀疏。例如,一些方法如 Sparse MoA 会先让模型池中的所有模型生成回答,再通过额外的评审模型进行打分和筛选,只保留一部分模型进入后续协作。这样虽然减少了后续融合的负担,但本质上仍然绕不开一个问题:为了决定该选谁,系统还是得先让所有模型都推理一遍。

于是,这篇工作的核心问题就变得非常直接:我们真的需要先让所有模型都回答一遍,才能决定该选谁吗?

一句话总结:RouteMoA 的核心思想是,通过在推理前进行模型能力预测,避免对所有模型进行无效推理。

现有方法的问题:

效率瓶颈不在融合,而在全量推理

当前 MoA 系列方法的一个共同假设是:要判断哪个模型更好,必须先看到它的输出。因此,无论是经典 MoA,还是引入 judge 的 Sparse MoA,本质上都绕不开一个步骤:所有模型先推理 -> 再筛选 -> 再融合。

这带来两个问题:

第一,计算成本无法下降。即使最后只用少数模型,前面已经为所有模型付出了推理代价。

第二,难以扩展到大模型池。当模型数量增加时,全量推理会迅速变得不可承受,甚至超出上下文限制。

也就是说,瓶颈并不在 “如何选”,而在 “选之前已经太贵了”。

RouteMoA:

把 “选模型” 前移到推理之前

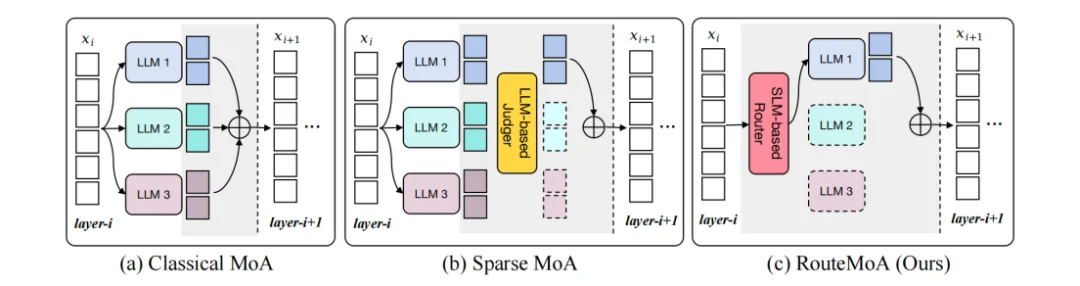

RouteMoA 的关键创新,是把模型选择从 “后验判断” 变成 “先验预测 + 轻量修正”。

整个流程可以分为三个步骤:

1. 先验筛选:不推理,也能判断谁更可能做对

RouteMoA 引入了一个轻量级 scorer,只根据用户 query,就预测每个模型的潜在表现。这个过程不需要调用大模型推理,只做一个粗粒度打分,把模型池缩小到一个潜力子集。本质上,这是在做一件过去被忽略的事情:用 query 本身的信息,提前判断模型能力匹配度。

2. 后验修正:用已有输出做低成本评审

初筛不可避免会有误差,因此 RouteMoA 引入了 mixture-of-judges:

关键在于:这些评估只基于已经生成的输出,不引入额外推理调用。也就是说,系统通过已有信息进行纠错,而不是再算一轮。

3. 综合排序:性能、成本、延迟一起优化

最终,RouteMoA 在模型选择时不仅仅考虑性能,而是同时考虑:

从而在实际系统中实现一个更接近工程最优的决策,而不是单纯追求 accuracy。

实验结果:

少花 90% 的钱,反而更强

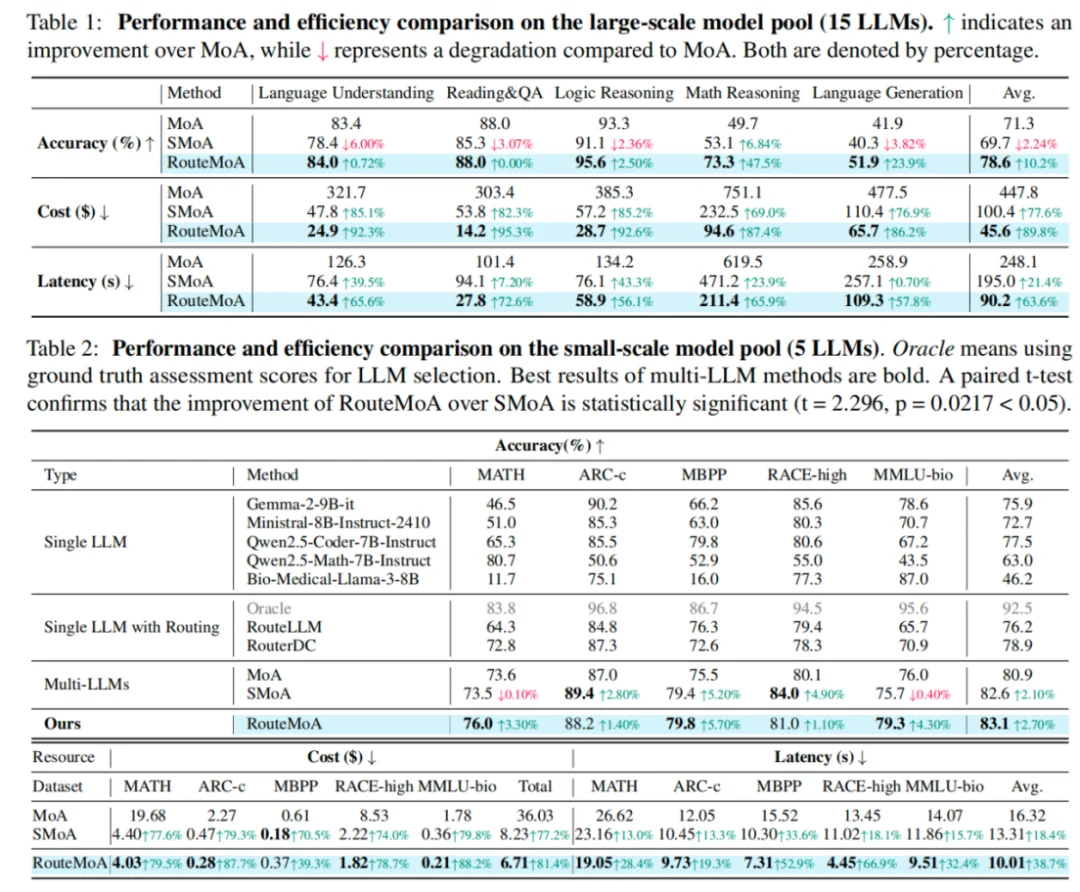

在包含 15 个模型的大规模模型池实验中,RouteMoA 的结果非常直观:

这说明一件事:减少无效计算,不仅不会伤害性能,反而会让系统更专注于对的模型。

一个关键洞察:

多模型系统的本质是稀疏的

论文中一个非常重要的观察是:在绝大多数 query 上,真正关键的模型只占少数。只要初始阶段能把这些模型保留下来,后续协作就足以放大正确答案。实验中,scorer 在 Top-3 内命中正确模型的概率接近 98%,这意味着:系统并不需要看所有答案,只需要别漏掉对的模型。

进一步分析:

失败不在选错模型,而在融合阶段

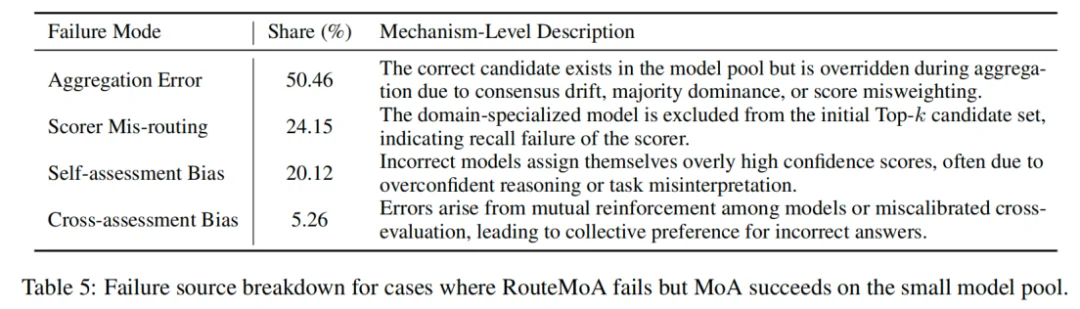

一个很有意思的发现是,在失败案例中:

可见,多模型系统的瓶颈正在发生转移:从 “选谁来回答”,转向 “如何整合多个答案”。

总结:多模型时代,调度很重要

RouteMoA 的意义,并不只是一个更高效的 MoA 变体,而是提供了一种新的范式:

换句话说,随着多模型协作的兴起,系统层的调度与协同,正变得与模型能力同样重要。

文章来自于微信公众号 "机器之心",作者 "机器之心"

【开源免费】Browser-use 是一个用户AI代理直接可以控制浏览器的工具。它能够让AI 自动执行浏览器中的各种任务,如比较价格、添加购物车、回复各种社交媒体等。

项目地址:https://github.com/browser-use/browser-use

【开源免费】AutoGPT是一个允许用户创建和运行智能体的(AI Agents)项目。用户创建的智能体能够自动执行各种任务,从而让AI有步骤的去解决实际问题。

项目地址:https://github.com/Significant-Gravitas/AutoGPT

【开源免费】MetaGPT是一个“软件开发公司”的智能体项目,只需要输入一句话的老板需求,MetaGPT即可输出用户故事 / 竞品分析 / 需求 / 数据结构 / APIs / 文件等软件开发的相关内容。MetaGPT内置了各种AI角色,包括产品经理 / 架构师 / 项目经理 / 工程师,MetaGPT提供了一个精心调配的软件公司研发全过程的SOP。

项目地址:https://github.com/geekan/MetaGPT/blob/main/docs/README_CN.md