本文主要由伊利诺伊大学香槟分校的钱成博士牵头合作完成。钱成目前为二年级博士生,其主要研究方向为大模型驱动智能体,包括智能体推理,交互以及物理智能等。导师为季姮教授。

2025 年是 Agent(智能体)技术落地元年,而如今到了 2026年,World Model(世界模型)也随之有了更广泛的技术突破。我们一边拥抱着五花八门的智能体应用给生活带来切实的便利,另一方面,我们也在加强世界模型的可信度与真实性,希望着它们在未来能够赋能智能体,让智能体能够真正像人类辨别物理空间,思考物理规律,从而更加高效且精准的做出推理与决策。

这二者的相继爆火并非偶然。如果从更本质的视角来看待世界模型和智能体的关系,便会发现:世界模型的本质在于接收当下对于环境的动作或扰动,在物理规律或环境限制的调控下,进而预测下一步的环境状态;而智能体则是根据当前环境状态,在任务目标的调控下,输出下一步应该做出的反应或动作。

从这个角度看,世界模型和智能体其实是一个天生互补的闭环,而这也正是世界模型能够理论上赋能智能体决策的基础。

从智能体的角度来看, 世界模型对其的赋能叫做 Foresight(前瞻)。世界模型能够在智能体并没有做出任何动作前便模拟出可能的后果,就像人类会「脑补」假如做了某件事之后可能会产生的影响,从而避免危害,提高效率,更加理性的在当下进行决策。只不过,人类更像是智能体和世界模型的结合体,因为既拥有前瞻能力,也是任务的执行者。

但是当下智能体和世界模型往往是按照两个完全不同的范式分开训练,那么便再换一种更加简单的思路:从智能体的角度,如果世界模型就是用来提供前瞻性的工具或第三方模块,那么后者在当下能够成功赋能智能体决策吗?

来自伊利诺伊大学香槟分校、清华大学、约翰霍普金斯大学以及哥伦比亚大学的研究人员在反复试验后,却得出来一个与我们的直觉有点相反的结论:大多数当下智能体并不能稳定、有效地把世界模型当作前瞻工具。

这个工作也点出了在当下智能体与世界模型交接之年热潮背后真正的瓶颈:如果真的希望世界模型能够有效赋能智能体,我们不仅需要智能体更强的执行能力或是世界模型更真实的模拟能力,同时也需要二者更好的磨合和适配,即智能体需要知道这个前瞻能力怎么用、何时用,才能更好地把推演融入到其多步决策的闭环中。这项能力在文章中被称作 Foresight Governance(前瞻治理)。

将世界模型的前瞻「工具化」

对于智能体而言,万物皆是达成目标的工具:互联网,数据库,甚至是人类,其实都可以看作是智能体为了达到目标的工具箱。

例如智能体向用户反问了一个澄清性质的问题,这时「向用户澄清」,或者说「向用户索要额外信息」便也可以看作是其为了达成目的的手段或工具之一。这一论断在 MCP 以及 Skill 兴起后更是如此,因为技能其实就是工具的抽象化,而统一接口后,智能体通过 MCP 对于外部的所有认知都可以看作是技能化,工具化的。

那么,从智能体的角度,它将怎么看待世界模型呢?答案呼之欲出,那便是将世界模型也看作一种能够提供前瞻性的工具。基于这个思路,文章作者首先构建了一套以智能体为核心,将世界模型「工具化」的研究范式。

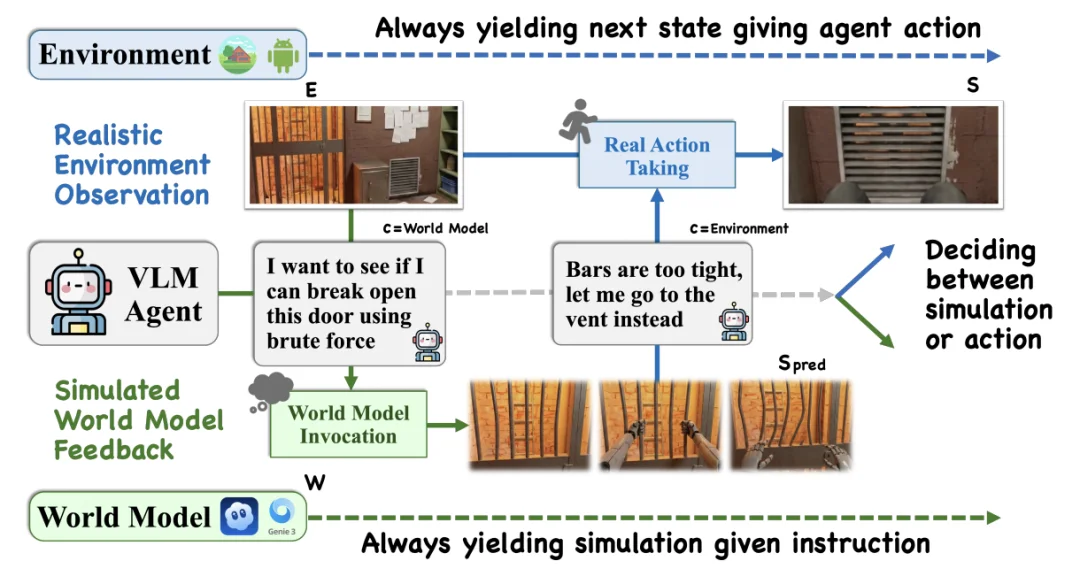

图 1: 在世界模型「工具化」的范式下,智能体在每一步执行前能够自行选择是否调用世界模型进行前瞻

在这套范式中,智能体不仅能够调用传统意义上的工具来执行和解决问题(例如不同 API 接口),同时其也可以在进行每一步行动前,都自行选择是否调用是世界模型来对动作影响进行前瞻。

例如在上图的例子中,把智能体放置于一个密室逃脱的具身环境中,智能体便可以选择调用模拟器对铁栅拉拽的动作后果进行前瞻和评估,从而更高效的找到真正的逃脱出口。

任务与测试模式拆解

作者在文章中主要探索了两类任务,其中每一类,世界模型都能「理论上」辅助智能体更好的进行决策和规划:

在智能体任务中,环境模拟器本身便是一个天然的世界模型,其能够直接帮助智能体获得精准的动作前瞻信号,理论上应当能帮助智能体规避一些不可逆的错误,让目标完成更加精准与高效。

在这类任务里,我们不再有一个百分百准确的模拟器提供真实的前瞻信号,因此作者采用了以开源模型 WAN2.1 进行 Rollout 的方式,模拟对于智能体指定动作的前瞻预测,并将视频信息返回给后者,以帮助其进行推理。

除了这两类任务,文章还采用了三种评测模式来进行对比分析:

世界模型对智能体的赋能并不可靠

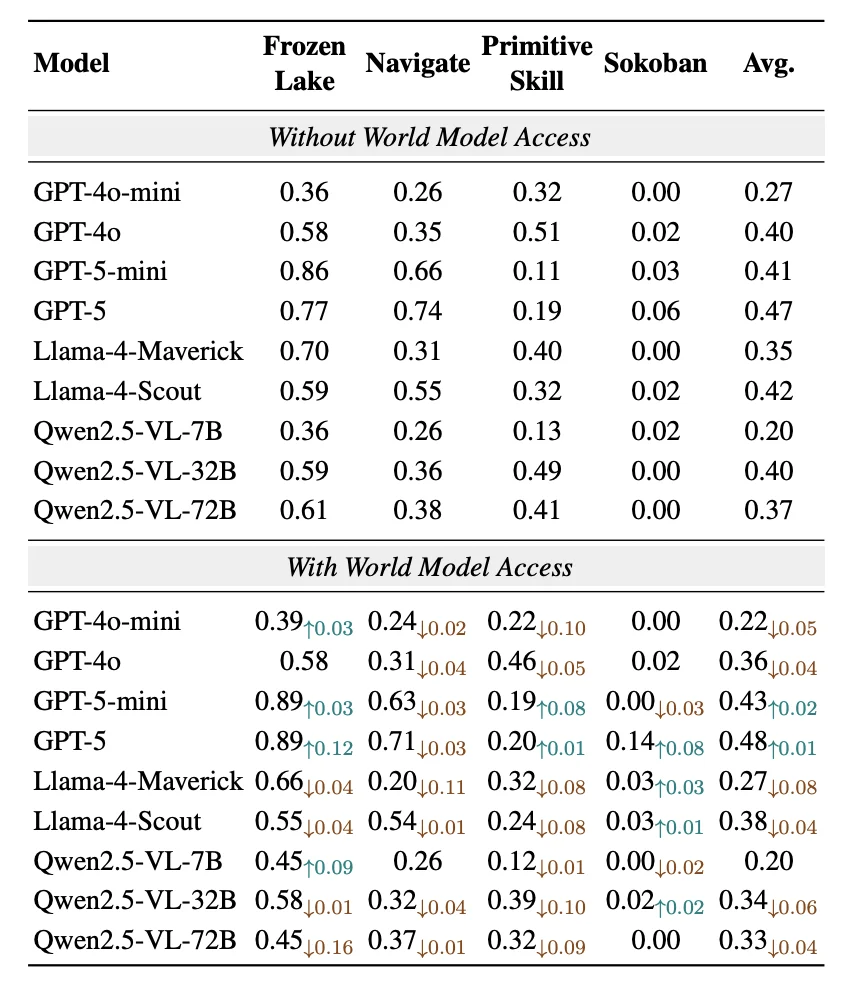

对比原始模式以及正常模式,在 GPT、Llama、Qwen 等当下主流模型上,文章发现了有点出乎意料的结果。

图 2: 在智能体任务(上) 以及视觉推理任务(下)上的主要实验结果:世界模型带来的动作影响前瞻,就算是百分百精准的,也并不能如期的帮助智能体提升能力。

发现一:世界模型带来的增强并不可靠,很多时候反而会拖后腿

文章对比了正常模式和原始模式,并发现在智能体任务中,被测模型在引入智能体的前瞻信号后,并没有有效的对其进行利用,反而是将其当作了噪声,从而使得平均表现甚至更差。这并不是前瞻信号不准确造成的:因为在智能体任务中,前瞻信号来自模拟器真实的直接模拟,这个返回结果一定是百分百准确的,但是被测智能体始终还是无法有效对其进行理解。

在视觉推理任务中,作者也发现了类似的现象:模型在利用前瞻信号后提升很小,几乎可以忽略不计。这些所有结果都在挑战着「世界模型都应该能天然赋能智能体行动」的直觉,也提醒着我们在目前智能体和世界模型分开训练的范式下,二者的磨合还并不够完善。

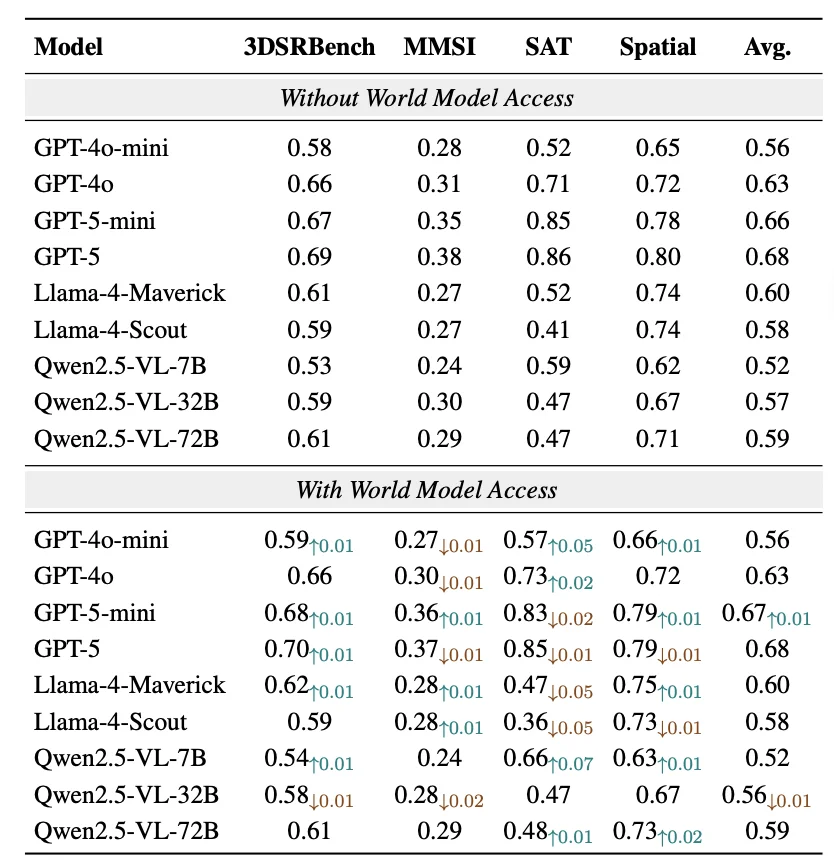

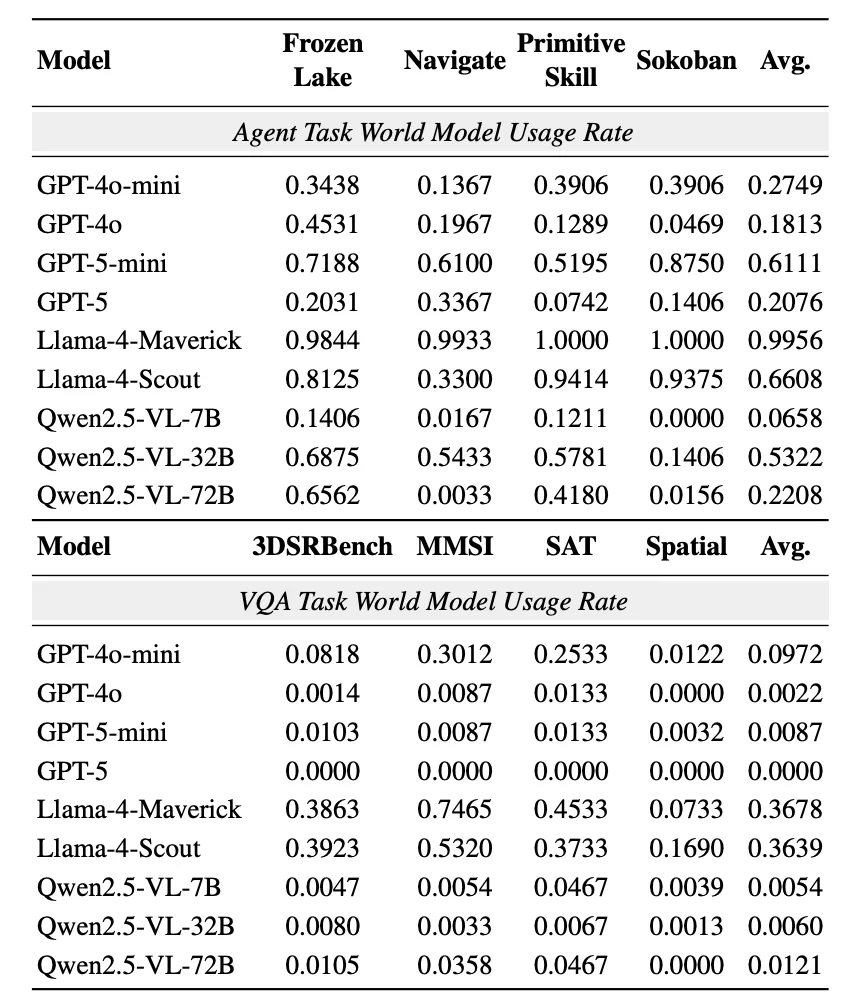

图 3: 在不同任务上模型调用世界模型的平均次数:大部分模型很多时候并不愿意调用世界模型进行前瞻,而更相信自身推理。

发现二:被测模型往往根本不愿意调用世界模型进行前瞻

文章还额外统计了世界模型在每个任务中平均被调用的次数。统计完才发现,在正常模式下,很多模型去尝试进行前瞻的意愿甚至都非常低,对于世界模型的调用率也整体偏低。

这个倾向在视觉推理任务上尤其明显:很多模型家族对于世界模型前瞻的调用不足 0.1,GPT-5 更是一次调用都没有,完全相信着自己的推理能力。但是从图 2 的模型表现来看,其仅凭借自身的推理也并没有达到接近满分的程度。

这个结果也意味着,被测智能体并不是不会调用世界模型,很多时候只是单纯的自信,不想调用外部信号来增强自身前瞻。大部分目前模型都缺乏着对于自身的清晰认知,不知道对于前瞻应当何时利用。

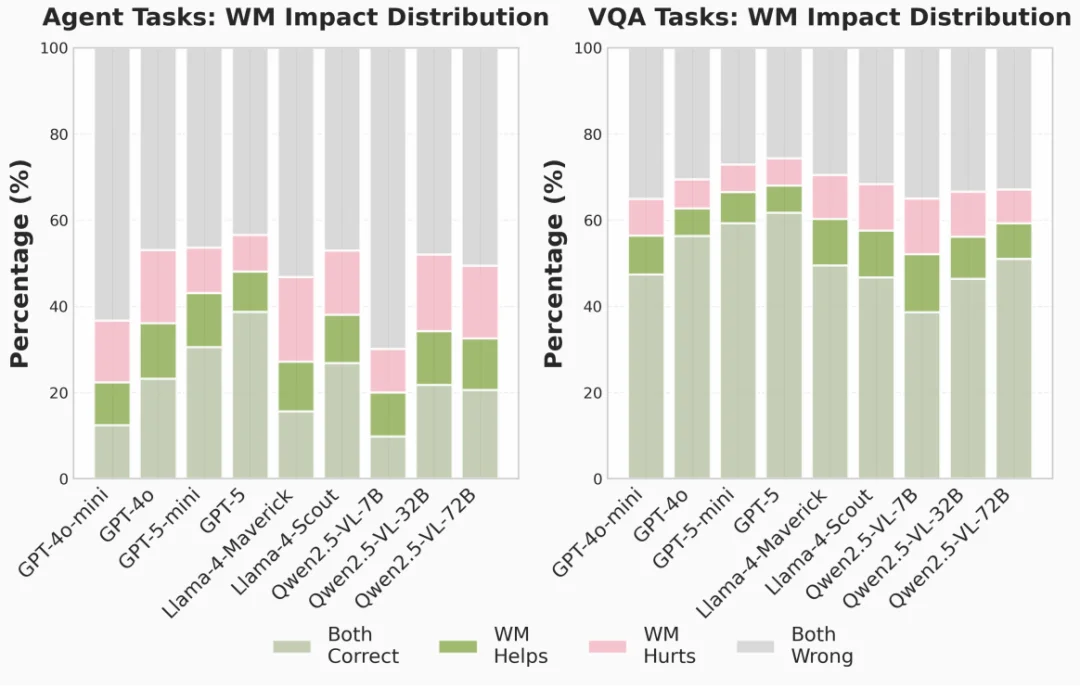

图 4: 世界模型前瞻的调用对于不同模型的影响:好坏往往相互抵消。

发现三:不同模型家族的调用性格不同,但都不等于会用

文章还观察到了一些有趣的模型家族间的差异:有的模型家族会更积极的调用前瞻信号,但收益不明显,例如 Llama 系列模型便是如此。而就算在同一个模型家族中,往往小模型也会更爱调用世界模型提供的前瞻信号,而大模型往往更加自信,倾向于「我自己想就够了」。这点比较符合直觉,因为小模型往往需要外部工具的调用来弥补自身能力的不足。这个现象往往被称作 Cognitive Offloading(认知负担转移)。

但是同时,从结果当中也不难看出,对于世界模型调用率高的也并不意味着表现就一定会上升,而调用率低的也并不意味着就更安全。就像图 4 当中所展现的,世界模型对于目前智能体表现来说,功过往往相抵。

这一现象表明除了何时利用的问题,智能体目前还需要学会如何更好的将前瞻融入到推理中,即怎样利用。

智能体与世界模型交互的关键在于前瞻治理

上述的所有发现都推动着研究人员进一步思考,智能体与世界模型的交互到底是哪里出现了问题。从何时利用,到怎样利用,文章作者总结出了当前世界模型赋能智能体问题的根源:前瞻治理。

虽然结果都有点出乎意料,但是文章并非想表达这个范式是错的或者世界模型的前瞻没用。恰恰相反,如果整个智能体与世界模型交互的闭环每一步都能够进行更好的前瞻治理,我们反而能帮助智能体更好的利用世界模型,从而对环境进行感知与学习。

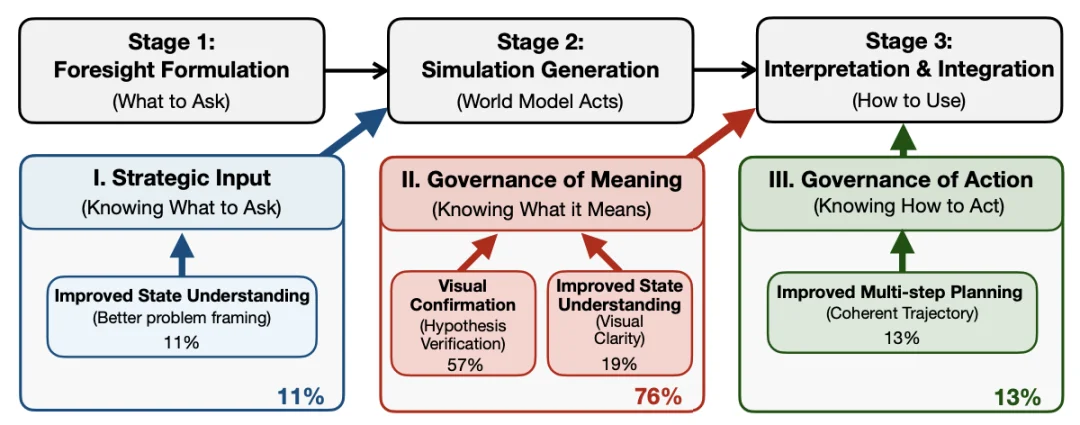

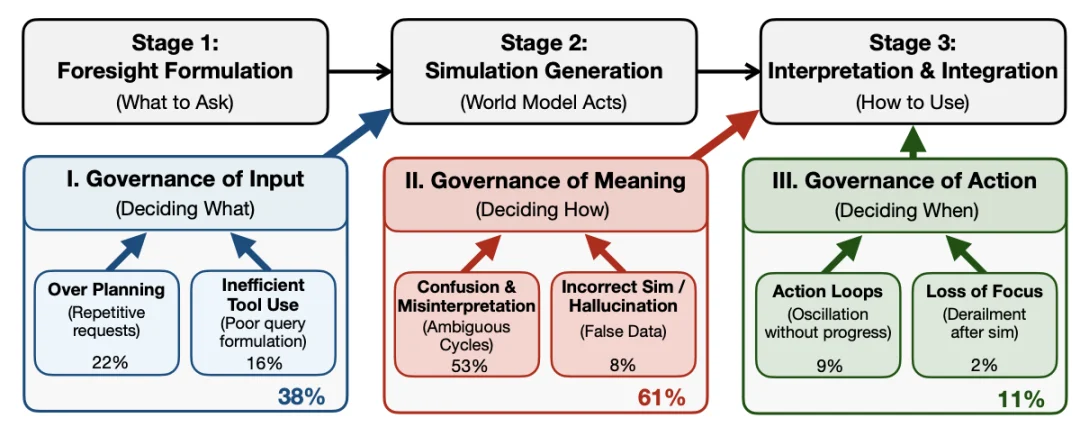

文章对于前瞻治理给出了三个重要的方面,并拆开构建了详细的类别框架:

图 5: 模型能够成功进行前瞻治理的原因分析。

成功的前瞻治理:三件事缺一不可

图 5: 模型前瞻治理失败的原因分析

失败的前瞻治理:常见崩坏模式

基于上述这些观察,文章也点出了一个核心论断:目前智能体与世界模型有效交互的主导瓶颈是前瞻治理的稳定性。这启示着之后的研究除了可以做更大更强的智能体或世界模型,同时也需要从智能体的角度探索如何更好地做调度、校准、以及证据整合。

对智能体 + 世界模型热潮的启示

启示一:比起单纯把世界模型接进工具箱,智能体更需要先学会判断「这一步值不值得前瞻」

从文章结果来看,很多智能体的问题出在并不是没有世界模型可用,而是不知道什么时候该用、用了是否真的划算。说到底,当前智能体缺少的是一套对于前瞻调用时机、收益与风险的基本判断机制。只有先学会评估当前动作到底有没有不确定性,前瞻能不能真正减少决策偏差,世界模型才不会只沦为一个摆设。

启示二:世界模型真正要赋能智能体的应是能够被当作证据使用的前瞻信号

文章里很多失败,本质上都不是因为模型什么都没看到,而是看到了以后也没有把这些信息转化成有效的判断依据,最终仍然被主观推理带偏。这说明未来世界模型的输出如果只是更长的状态描述、更完整的生成画面,未必就能真正帮到智能体。相比之下,哪些变量发生了变化、哪些差异最关键、哪些结论更值得相信,反而可能是更重要的智能体与世界模型间的接口形式。

启示三:未来真正需要对齐的是智能体如何围绕前瞻建立起稳定的治理能力

这篇工作最值得重视的一点正在于,它已经在尽量理想的条件下给了智能体一个足够可靠的模拟器,但结果依然说明,问题并不会因为模拟更准就自动消失。比起继续单纯追求更强大的模型,后续研究或许更需要回答的问题是智能体怎样提出更好的前瞻请求,怎样理解返回结果,又怎样把这些结果真正转化为下一步行动。换句话说,这点出了真正需要补上的不只是模拟能力,而是围绕前瞻展开的整套治理能力。

文章来自于微信公众号 "机器之心",作者 "机器之心"

【开源免费】Browser-use 是一个用户AI代理直接可以控制浏览器的工具。它能够让AI 自动执行浏览器中的各种任务,如比较价格、添加购物车、回复各种社交媒体等。

项目地址:https://github.com/browser-use/browser-use

【开源免费】AutoGPT是一个允许用户创建和运行智能体的(AI Agents)项目。用户创建的智能体能够自动执行各种任务,从而让AI有步骤的去解决实际问题。

项目地址:https://github.com/Significant-Gravitas/AutoGPT

【开源免费】MetaGPT是一个“软件开发公司”的智能体项目,只需要输入一句话的老板需求,MetaGPT即可输出用户故事 / 竞品分析 / 需求 / 数据结构 / APIs / 文件等软件开发的相关内容。MetaGPT内置了各种AI角色,包括产品经理 / 架构师 / 项目经理 / 工程师,MetaGPT提供了一个精心调配的软件公司研发全过程的SOP。

项目地址:https://github.com/geekan/MetaGPT/blob/main/docs/README_CN.md