ICLR 2026 Oral|大模型总爱「想太多」? DECS从源头消除冗余思考,实现推理token减半且性能不降反升

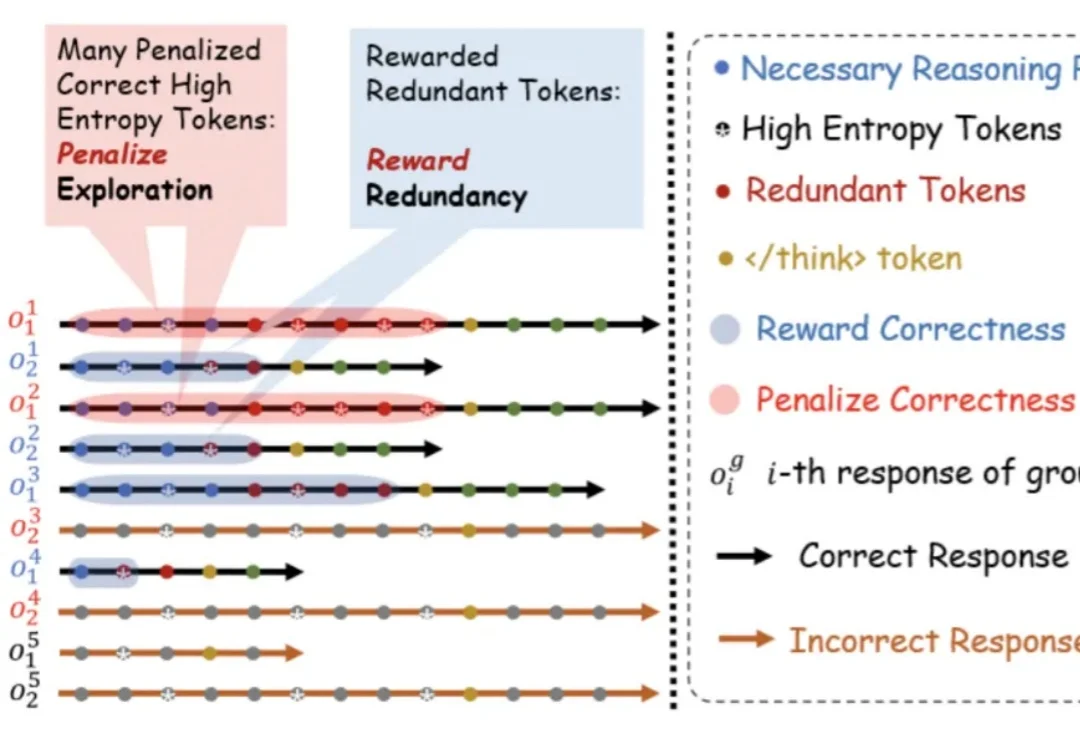

ICLR 2026 Oral|大模型总爱「想太多」? DECS从源头消除冗余思考,实现推理token减半且性能不降反升以 DeepSeek-R1、OpenAI GPT Thinking 为代表的大型推理模型,通过长达数千 token 的「思维链」在各类复杂推理任务中展现出卓越的性能。然而,这些模型普遍存在一个核心问题,即过度思考(overthinking) :

搜索

搜索

以 DeepSeek-R1、OpenAI GPT Thinking 为代表的大型推理模型,通过长达数千 token 的「思维链」在各类复杂推理任务中展现出卓越的性能。然而,这些模型普遍存在一个核心问题,即过度思考(overthinking) :

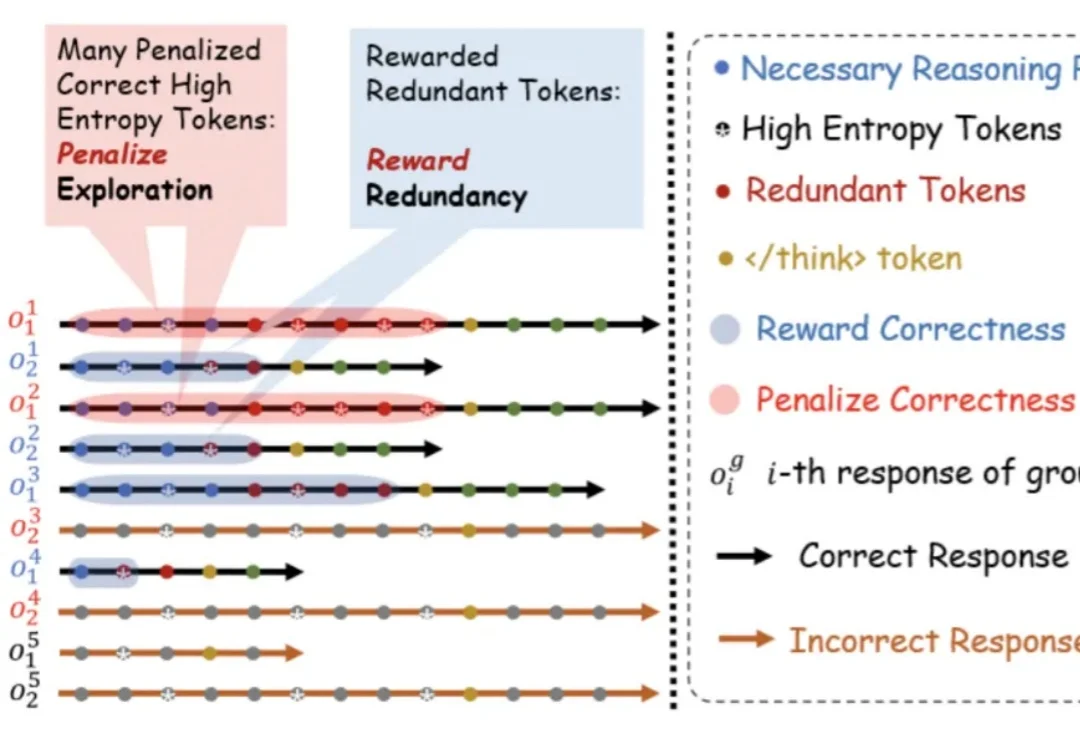

随着语音、视频、多模态能力不断融入大语言模型(LLM),人与 AI 的交互正在越来越接近自然对话。今天的 LLM 不再只是回答问题的工具,也越来越多地出现在教育、客服、陪伴、心理健康等高度依赖情绪理解的场景中。

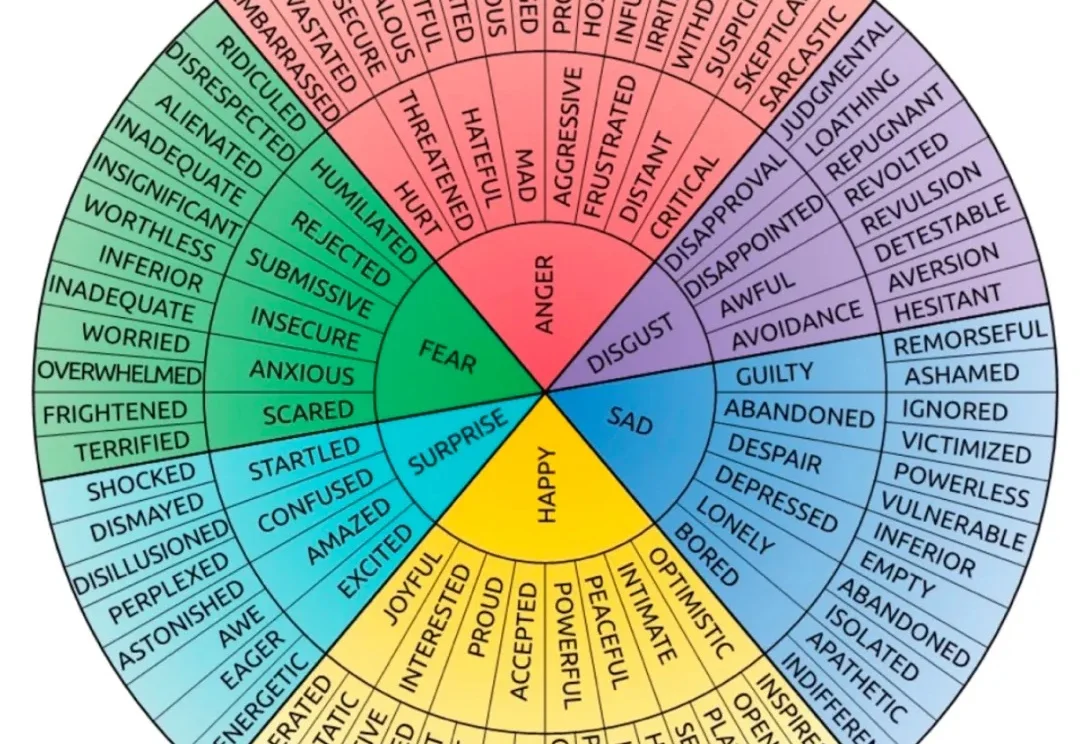

近日,原力灵机开源的具身智能原生框架 Dexbotic 宣布正式支持以 RLinf 作为其分布式强化学习后端。对具身智能开发者而言,这不仅是一次普通的工程适配,更意味着 VLA 模型研发中长期存在的「SFT 与 RL 割裂」问题,正在被真正打通。

大家好,我是袋鼠帝。 过去这一两年,AI 圈可谓是神仙打架,各种新概念、新模型、新应用天天刷屏。

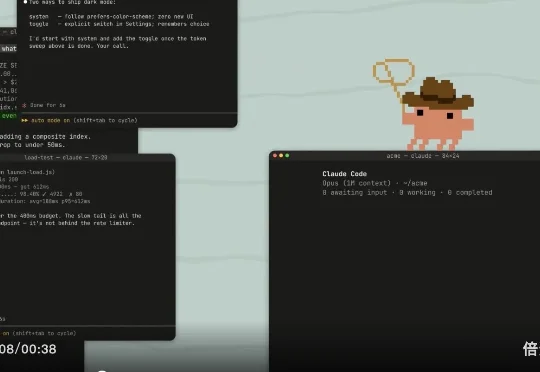

Claude Code今天正式推出Agent视图功能,让用户在一个界面里统一管理所有Claude Code会话。此前并行运行多个Agent时,开发者往往需要同时维护多个终端标签页、一个tmux网格,还得靠脑子记住每个任务的进度。

5月11日,韩国总统府(青瓦台)政策室长金容范(Kim Yong-beom)在其Facebook发文提出,应考虑设立所谓“公民红利”,资金来源为人工智能(AI)产业产生的超额利润。“人工智能基础设施时代的收益,并非仅由个别企业创造,而是源于整个国家在过去半个多世纪中所构建的产业基础。

王珏 (左)方晨(右) 推荐语 动画是一个被低估的品类。它比真人影视更早拥抱数字化工具,比短视频承载更复杂的叙事,从迪士尼到吉卜力,证明了自己能撑起全年龄段的内容消费和完整的商业闭环。但动画的产能瓶颈

最近很多人也在问我,我用Agent,是怎么跟很多数据进行交互的。其实很多的交互,都是我让Claude Code直接跟飞书进行交互的,包括我们公司小伙伴也是,大家用图形化界面的时间占比,反而变得越来越少了。

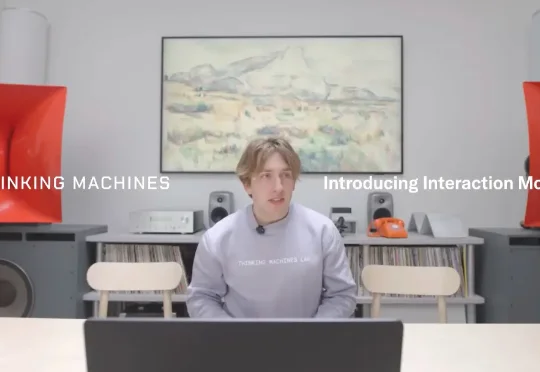

Mira Murati 用一年半时间证明了「人机协作」不是一句口号。 5 月 11 日,Thinking Machines Lab 发布了一段研究预览视频,展示了他们所谓的「交互模型」(Interaction Model)。

「一个人现在可以跑出一家30人公司才能完成的收入。」然后他说:这句话在2022年不成立。在2024年中段某个时间点,变成了真的。而且差距每个季度都在扩大。不是因为这个说法多新鲜——AI能提效这件事大家都听说过了。是因为他不只是说「理论上可以」,他是说他自己做到了,然后顺手把操作手册拿出来给你看。