苹果智能背后模型公布:3B模型优于Gemma-7B,服务器模型媲美GPT-3.5-Turbo

苹果智能背后模型公布:3B模型优于Gemma-7B,服务器模型媲美GPT-3.5-Turbo在刚刚结束的全球开发者大会上,苹果宣布了 Apple intelligence, 这是一款深度集成于 iOS 18、iPadOS 18 和 macOS Sequoia 的全新个性化智能系统。

来自主题: AI技术研报

6253 点击 2024-06-13 10:01

在刚刚结束的全球开发者大会上,苹果宣布了 Apple intelligence, 这是一款深度集成于 iOS 18、iPadOS 18 和 macOS Sequoia 的全新个性化智能系统。

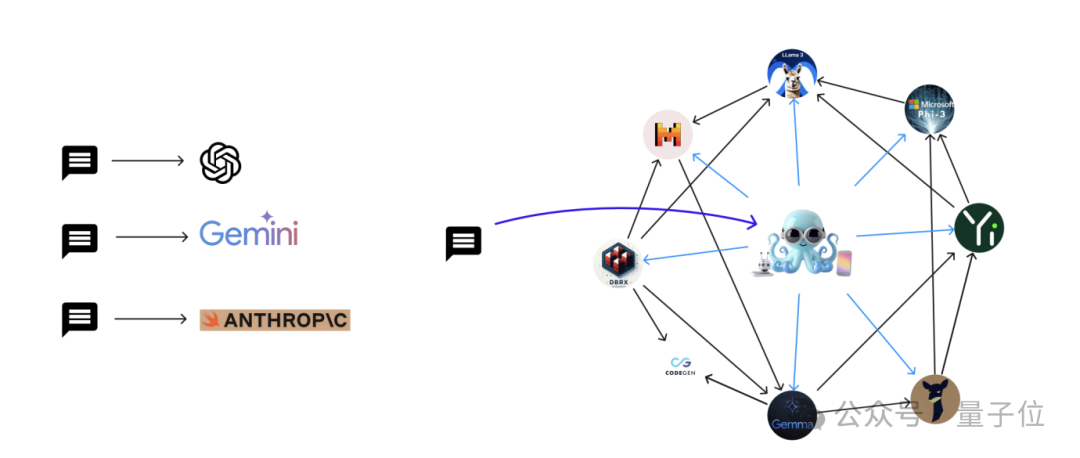

大模型,大,能力强,好用!

混合专家(MoE)架构已支持多模态大模型,开发者终于不用卷参数量了!北大联合中山大学、腾讯等机构推出的新模型MoE-LLaVA,登上了GitHub热榜。

对于大型视觉语言模型(LVLM)而言,扩展模型可以有效提高模型性能。然而,扩大参数规模会显著增加训练和推理成本,因为计算中每个 token 都会激活所有模型参数。

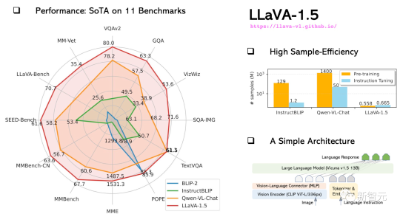

GPT-4V风头正盛,LLaVA-1.5就来踢馆了!它不仅在11个基准测试上都实现了SOTA,而且13B模型的训练,只用8个A100就可以在1天内完成。