2秒终结AI 3D不可能三角,我们和VAST首席科学家曹炎培聊了聊

2秒终结AI 3D不可能三角,我们和VAST首席科学家曹炎培聊了聊速度、质量、管线可用性,是 AI 3D 生成领域公认的不可能三角。三件事,从来没有同时成立过。直到现在。VAST 最新发布的 Tripo P1.0,首次在原生三维空间中实现概率生成,2 秒内即可输出专业建模师级别的 3D 资产,效率较现有方案提升百倍以上。

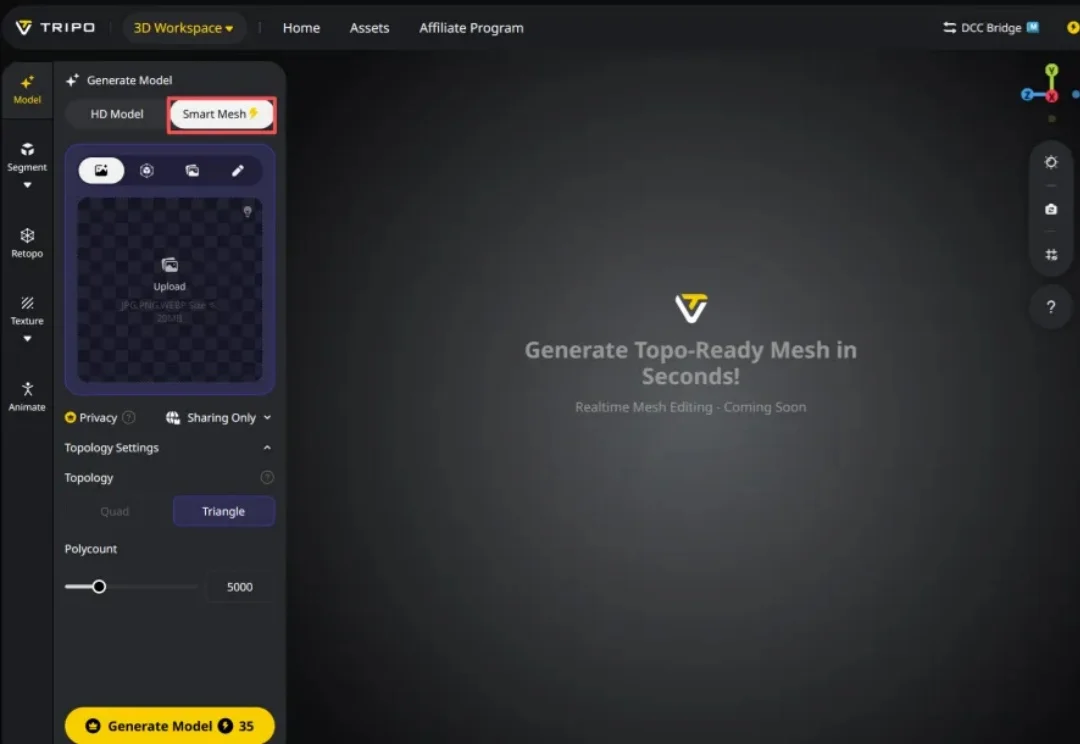

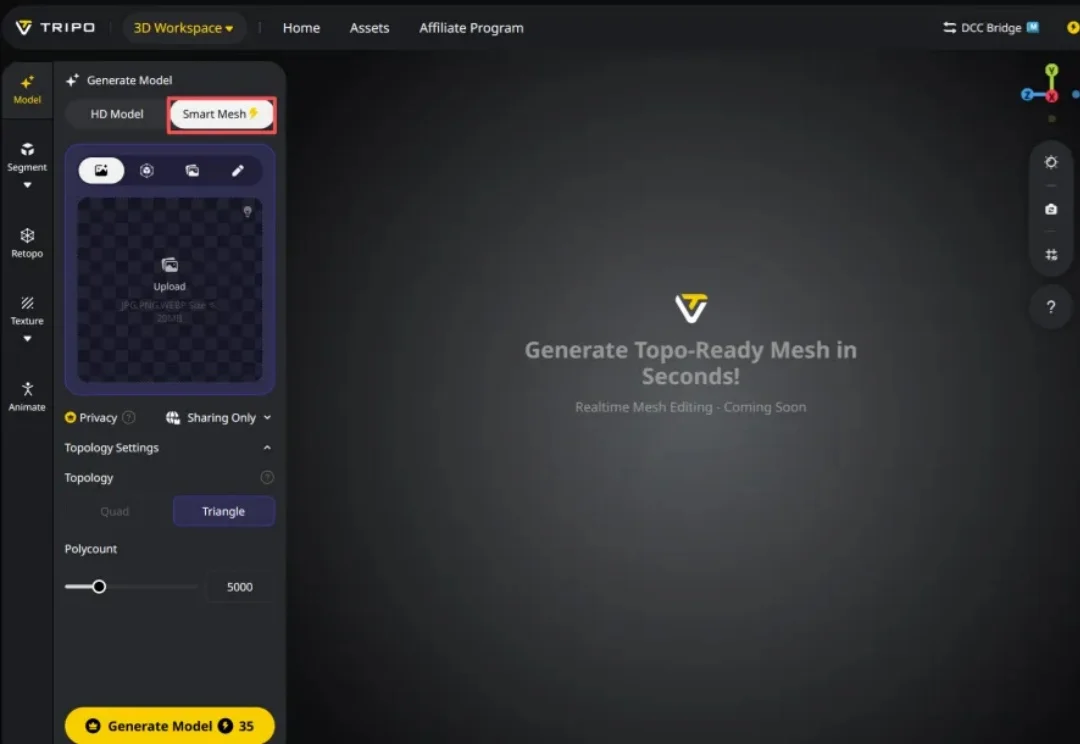

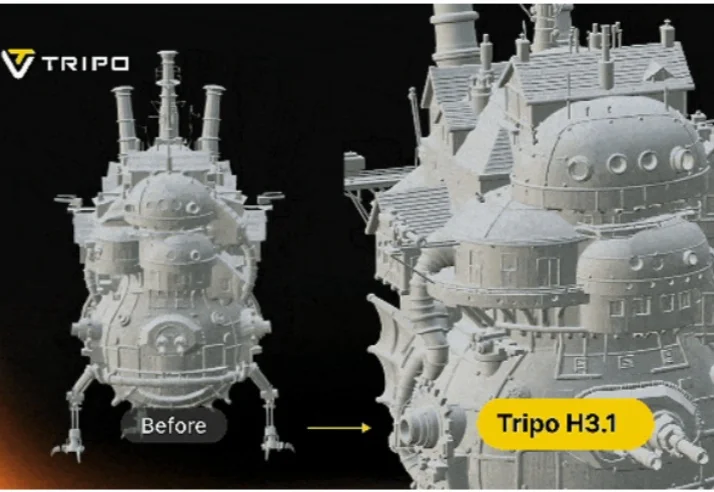

速度、质量、管线可用性,是 AI 3D 生成领域公认的不可能三角。三件事,从来没有同时成立过。直到现在。VAST 最新发布的 Tripo P1.0,首次在原生三维空间中实现概率生成,2 秒内即可输出专业建模师级别的 3D 资产,效率较现有方案提升百倍以上。

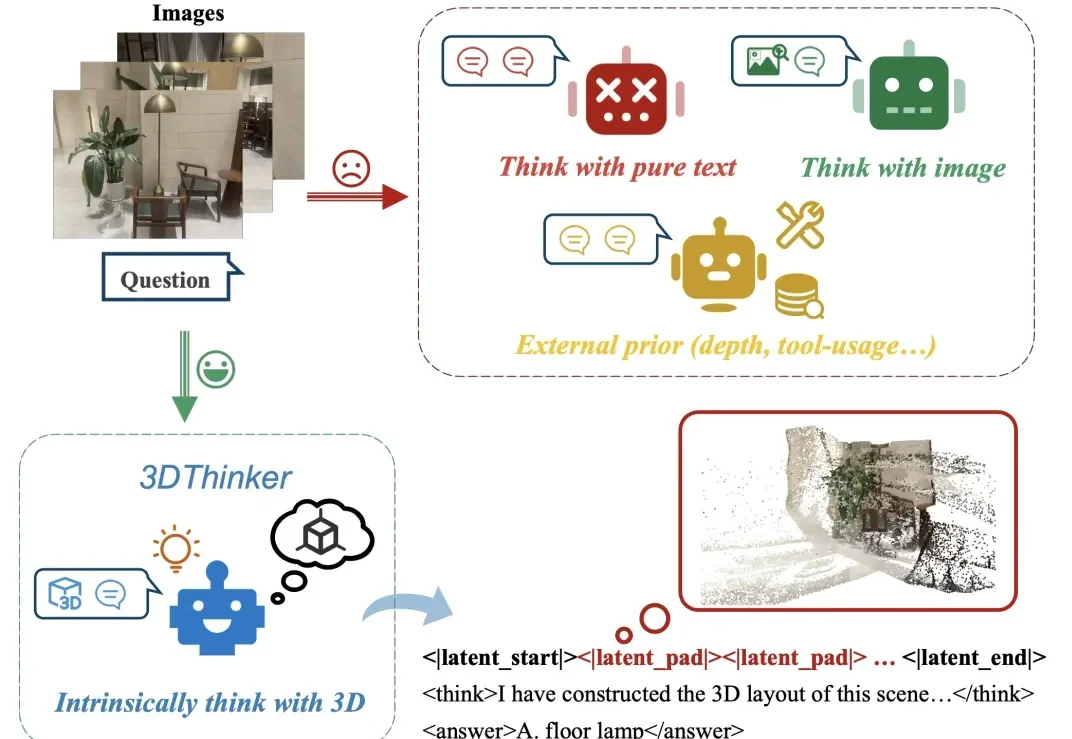

大家是否有这样的感觉?给定几张场景中拍摄的图片,往往能够在脑海中想象出这个场景的三维布局,然而当前的多模态大模型还停留于纯文本或者 2D 视觉的推理表示,限制了图像中隐含几何结构的表达能力。

据我们了解,宋亚宸创办的通用人工智能公司 VAST 近期完成了 5000 万美元 A 轮融资,领投方为阿里和上汽,元禾璞华、BV 百度风投、东方嘉富跟投,老股东春华创投和北京市人工智能产业投资基金也在继续加注。

在 50 亿美元估值神话的背后,这一空间智能的最新高地正被国内创业公司攻克并推向产业纵深。近日,影溯(InSpatio)正式发布并开源了其实时帧生成模型 InSpatio-WorldFM,一个实时交互的 3D 世界模型。这标志着中国团队在空间智能底层技术上取得了奠基性突破,而且以开放的姿态,正成为推动 AI 从虚拟屏幕走向物理现实的关键破局者。

机器之心编辑部 近日,一款名为 StoryWorld 的 iOS 产品 Demo 在海外开发者与 3D 创作者社区引发关注:用户只需用手机摄像头对准真实空间,通过语音输入描述,即可生成 3D 角色与物

通用人工智能公司 VAST 今日宣布完成 5000 万美元 A 轮融资。本轮融资由阿里、恒旭资本联合领投,元禾璞华、BV 百度风投、东方嘉富等跟投,形成覆盖顶级资本、产业巨头、知名战投的全方位赋能格局。

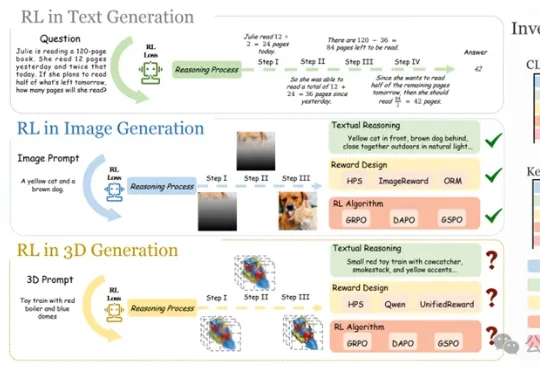

当GRPO让大模型在数学、代码推理上实现质变,研究团队率先给出答案——首个将强化学习系统性引入文本到3D自回归生成的研究正式诞生,并被CVPR 2026接收。该研究不只是简单移植2D经验,而是针对3D生成的独特挑战,从奖励设计、算法选择、评测基准到训练范式,做了一套完整的系统性探索。

「世界正在变成乐高」 一个显而易见的趋势是,AI编程工具正在成为网络世界的引擎。 绝大部分APP终将消失。因为绝大部分软件需求,都可以由编程Agent生成的一次性软件来完成,用完即弃,像3D打印一个零

一次拿下10亿美金,惊爆硅谷!就在刚刚,李飞飞「明星初创」World Labs官宣:成功斩获高达10亿美元的全新一轮融资。此轮融资,投资人阵容堪称豪华——

现在, Gemini 3 Deep Think 看一眼照片,就能脑补全这张锅在各个角度的长宽高、厚度甚至把手的弧度,直接变出一个立体实物原型。