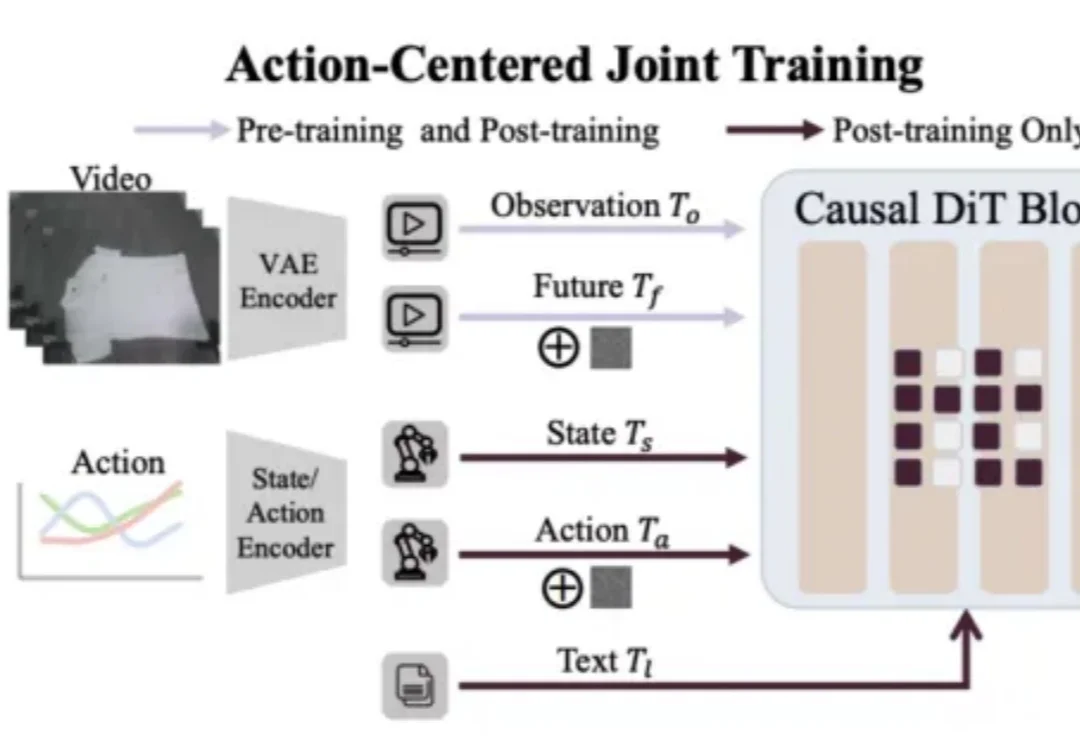

柔体操作最缺数据、最怕仿真失真?新研究让布料物理真实再现

柔体操作最缺数据、最怕仿真失真?新研究让布料物理真实再现近年来研究者们一直在试图通过仿真环境批量产出具身训练数据。

近年来研究者们一直在试图通过仿真环境批量产出具身训练数据。

距离新模型Marble 1.1&1.1-Plus发布不到一个周,李飞飞空间智能独角兽World Labs再度传来新消息—— 开源3D高斯溅射渲染引擎Spark 2.0。

没放出大家伙心心念念的 GPT-5.5 或 GPT-6,OpenAI 刚刚发布了全新的、强调网络安全版本的「GPT-5.4-Cyber」。

太疯狂了!Anthropic刚刚发布Claude Code新版,上线神秘功能Routine:支持定时、API、GitHub三路触发,直接变身「云端员工」。更刺激的是,Opus 4.7即将本周闪电发布,直接跨界硬刚Adobe、Figma。

随着新一代主动执行型 Agent(如 OpenClaw、Hermes Agent 等)的爆发,AI 正经历从「被动工具」向「具备自我演化(Self-Evolving)能力的智能体」的范式跃迁。然而,受限于上下文窗口极限与记忆缺失,现有 Agent 难以在复杂任务中实现经验的复用与自我进化。

当奥特曼两次遇袭后,谷歌 DeepMind 悄悄做了一个反常规的决定:招一位哲学家。这是头部 AI 实验室第一次变相承认,AGI 已经不再只是工程问题。

近日,北京德塔源创智能科技有限公司(简称:德塔智能 Delta Intelligence)宣布完成三轮超亿元融资,由高瓴创投等加注,并引入乐聚、智元、星海图等头部主机厂商战略入局。

AI做PPT倒是得心应手、形式也五花八门了—— But谁来救救表格人??做Excel简直是当代酷刑……

最近,具身智能圈被 Generalist CEO 的一篇长文《Going Beyond World Models & VLAs》刷屏。文章抛出了一个看似振聋发聩的观点:目标远比工具标签更重要。与其陷入 “我们到底是在做 VLA(视觉 - 语言 - 动作模型)还是世界模型(World Model)” 的教条之争,不如回归本源:让机器高效、准确地作用于物理世界。

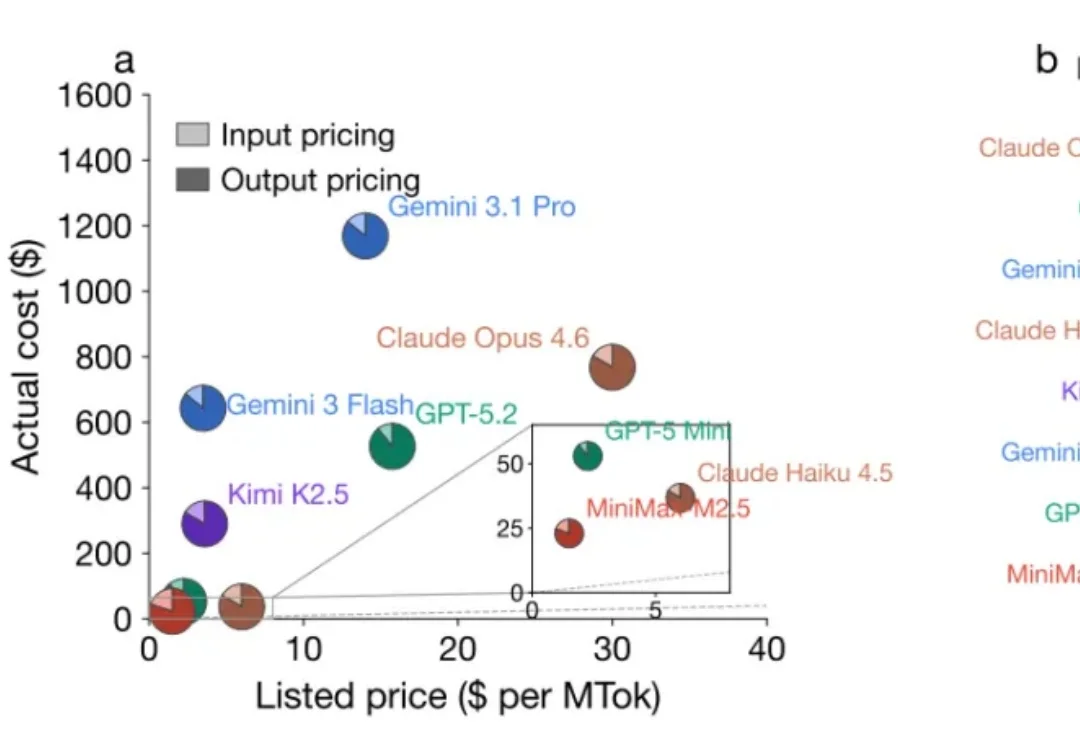

在选择使用大模型 (LLM) 时,除了模型性能强弱,价格也是一个重要指标。人们通常会用大模型的 API 定价更贵或更便宜,来比较模型的价格高低。但事实上,定价低的模型真的比定价高的模型使用起来更便宜吗?