WebRTC创建者加入了OpenAI,他如何思考语音AI的未来?

WebRTC创建者加入了OpenAI,他如何思考语音AI的未来?WebRTC 的早期创建者之一,Fixie.ai 联合创始人兼 CTO Justin Uberti 近日宣布加入 OpenAI,领导实时 AI (Real-Time AI)项目的开发。

WebRTC 的早期创建者之一,Fixie.ai 联合创始人兼 CTO Justin Uberti 近日宣布加入 OpenAI,领导实时 AI (Real-Time AI)项目的开发。

EasyRec利用语言模型的语义理解能力和协同过滤技术,提升了在零样本学习场景下的推荐性能。通过整合用户和物品的文本描述,EasyRec能够生成高质量的语义嵌入,实现个性化且适应性强的推荐。

越来越多研究发现,后训练对模型性能同样重要。Allen AI的机器学习研究员Nathan Lambert最近发表了一篇技术博文,总结了科技巨头们所使用的模型后训练配方。

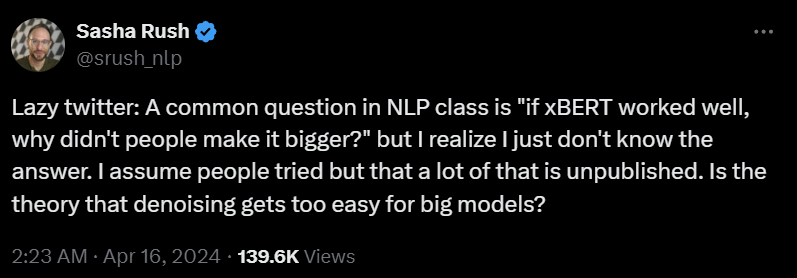

编码器模型哪去了?如果 BERT 效果好,那为什么不扩展它?编码器 - 解码器或仅编码器模型怎么样了?

前谷歌科学家Yi Tay重磅推出「LLM时代的模型架构」系列博客,首篇博文的话题关于:基于encoder-only架构的BERT是如何被基于encoder-decoder架构的T5所取代的,分析了BERT灭绝的始末以及不同架构模型的优缺点,以史为鉴,对于未来的创新具有重要意义。

大模型带来的生命科学领域突破,刚刚再传新进展。

传闻中OpenAI的Q*,已经引得AI大佬轮番下场。AI2研究科学家Nathan Lambert和英伟达高级科学家Jim Fan都激动的写下长文,猜测Q*和思维树、过程奖励模型、AlphaGo有关。人类离AGI,已是临门一脚了?

在快速发展的人工智能领域,自然语言处理已成为研究人员和开发人员关注的焦点。近年来,在Transformer 架构和BERT 双向升级的基础上,出现了几种突破性的语言模型,突破了机器理解和生成的界限。