英特尔:CPU的痛就像送外卖

英特尔:CPU的痛就像送外卖英特尔,真是越来越会玩了—— 因为它把优化CPU这件事的痛点,直接搞得像送外卖似的:

搜索

搜索

英特尔,真是越来越会玩了—— 因为它把优化CPU这件事的痛点,直接搞得像送外卖似的:

如果你是一家连年亏损、销售额腰斩、连线下门店都要全部关停的卖鞋公司,你要怎么做才能让公司股价在一天之内原地起飞,暴涨 700%?答案是停止卖鞋,然后大声喊出那五个拥有起死回生魔力的字母:AI+GPU。

SiFive 是一家由加州大学伯克利分校工程师创办的公司,这些工程师创造了开源芯片设计,该公司已获得一轮超额认购的 4 亿美元融资,公司估值达 36.5 亿美元。

在AI狂飙的这些年里,行业几乎被一条逻辑主导:算力决定上限,而GPU就是算力的核心。

郭亚楠说,Context就承接了新需求。传统OS让人和软件对齐,新OS应该让人和Agent对齐。因为Context是个人数据的结构化、语义化集合,它就像OS管理内存和CPU一样管理每个人的数字痕迹。

很怀念过去的 PC 市场。

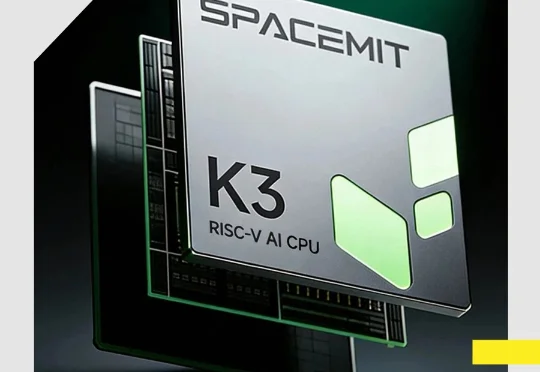

RISC-V摘掉紧箍咒!坐上高端算力牌桌,首次原生跑通千亿大模型。

19日下午,此芯科技以「智启未来 芯动全球」为主题,在深圳举办OpenClaw CPU系列产品及方案矩阵发布会,正式推出全球首款OpenClaw专属CPU——CIX ClawCore螯芯系列。

简单讲,Violoop 是一款巴掌大小的硬件,有一块触屏屏幕,用来显示它当前正在处理的任务。这是一款即插即用的产品,不挤占电脑的 CPU/GPU资源,无需安装任何软件,一台普通电脑通过一根 HDMI 线连上 Violoop,就能秒变「AI 电脑」,成为升级版「龙虾」。

近日,基于RISC-V架构研发和销售下一代AI CPU芯片的企业「进迭时空」完成数亿元B轮融资,我们总结了本轮融资信息和该公司几大亮点: