用AI读懂施工图纸,Meta前AI科学家创业,融资10M,杨立昆押注 | 附8个DEMO

用AI读懂施工图纸,Meta前AI科学家创业,融资10M,杨立昆押注 | 附8个DEMO1天前,2026年4月,Primepoint完成了$10M种子轮融资。对一家成立仅两年、团队不足10人的公司而言,这个数字不算小。更值得关注的是投资人结构:深度学习先驱Yann LeCun亲自下注,多家专注建筑科技的头部VC联合跟投。

1天前,2026年4月,Primepoint完成了$10M种子轮融资。对一家成立仅两年、团队不足10人的公司而言,这个数字不算小。更值得关注的是投资人结构:深度学习先驱Yann LeCun亲自下注,多家专注建筑科技的头部VC联合跟投。

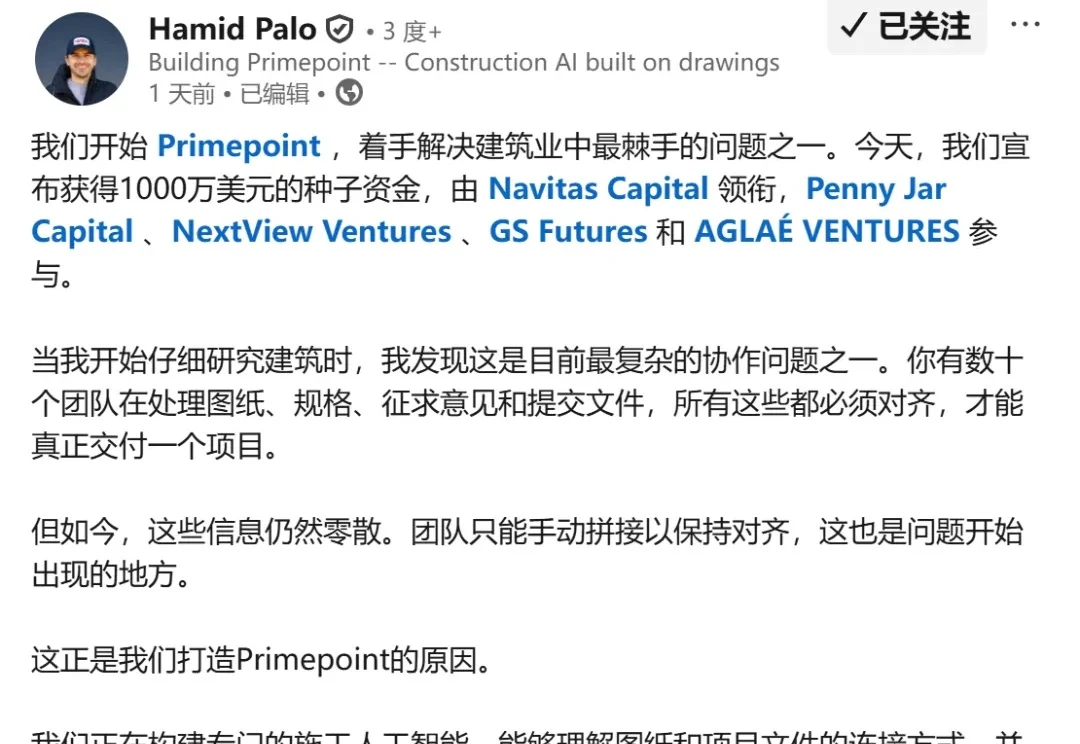

4 月 14 日,智在无界发布第三代旗舰模型 Being-H0.7,该模型将数据规模扩展至 20 万小时人类视频,并提出一种全新的范式 —— 基于潜空间推理的世界模型。在 6 项国际性权威评测中,H0.7 综合排名全球第一(其中 4 项登顶),同时也是首个覆盖跨本体、跨场景、连续动态、流体、柔性物体、物理规律与上下文推理等七大关键维度的通用世界模型。

近期,围绕「世界模型」这一方向,有两项工作受到较多关注。

LeCun世界模型最新进展,开源了一套极简训练方案,单GPU就能跑。

事情果然和大家预想的一样!

当LeCun和李飞飞各自拿下10亿美元押注世界模型时,一个更底层的问题浮出水面:谁来为Physical AI提供真正能用的数据?Ropedia给出的答案,不是更多视频,而是一部结构化的、来自真实世界的「经验百科全书」。

谷歌DeepMind又放大招了:AlphaEvolve自主写算法,一口气改写5个经典拉姆齐数下界,打破了尘封十年的数学纪录!诺奖得主Hassabis和图灵奖得主LeCun都纷纷点赞——AI,正在彻底改变数学突破的方式!

3 月 10 日,APPSO 中文独家获悉,世界模型研究所/创业公司 AMI 已完成 10.3 亿美元融资,投前估值 35 亿美元。该公司由图灵奖得主、前 Meta 首席 AI 科学家杨立昆 (Yann LeCun) 创办。

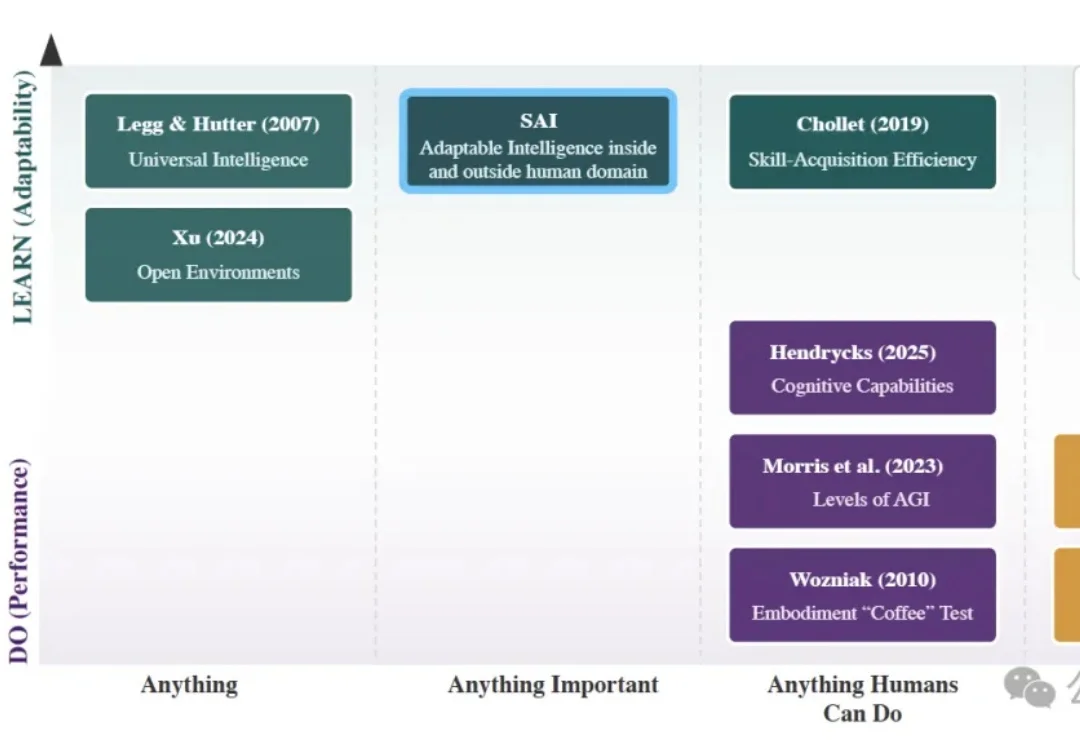

AI圈追逐多年的通用人工智能(AGI),可能从一开始就走偏了。

基础模型时代,大模型能力的爆发,很大程度上源于在海量文本上的预训练。然而问题在于,文本本质上只是人类对现实世界的一种抽象表达,是对真实世界信息的有损压缩。