谷歌发布「AlphaFold 4」,不再开源!性能碾压上一代

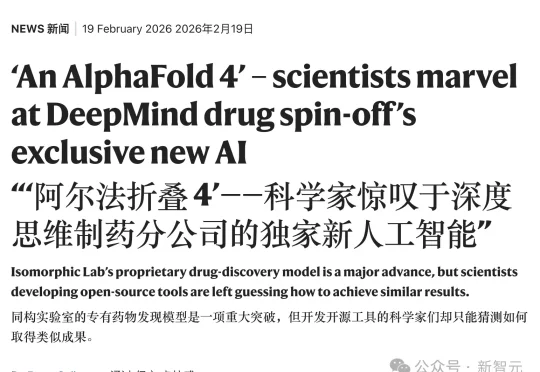

谷歌发布「AlphaFold 4」,不再开源!性能碾压上一代谷歌旗下的 Isomorphic Labs 发布新一代 AI 药物设计引擎 IsoDDE,性能全面碾压 AlphaFold 3,能在几秒内发现科学家花 15 年才找到的隐藏结合位点。但与开源的 AlphaFold 不同,IsoDDE 选择完全闭源,代码、论文、方法均不公开。AI 造福科学的开源黄金时代,可能正走向终结。

谷歌旗下的 Isomorphic Labs 发布新一代 AI 药物设计引擎 IsoDDE,性能全面碾压 AlphaFold 3,能在几秒内发现科学家花 15 年才找到的隐藏结合位点。但与开源的 AlphaFold 不同,IsoDDE 选择完全闭源,代码、论文、方法均不公开。AI 造福科学的开源黄金时代,可能正走向终结。

谷歌DeepMind和Isomorphic Labs合作,祭出了药物设计之王。

过去几年,AI 行业几乎把所有注意力都投向了“会不会想”:更强的推理、更大的模型、更快的生成。但在真实世界里,很多问题并不是想不想得出来,而是你到底记不记得发生过什么——尤其是视频。

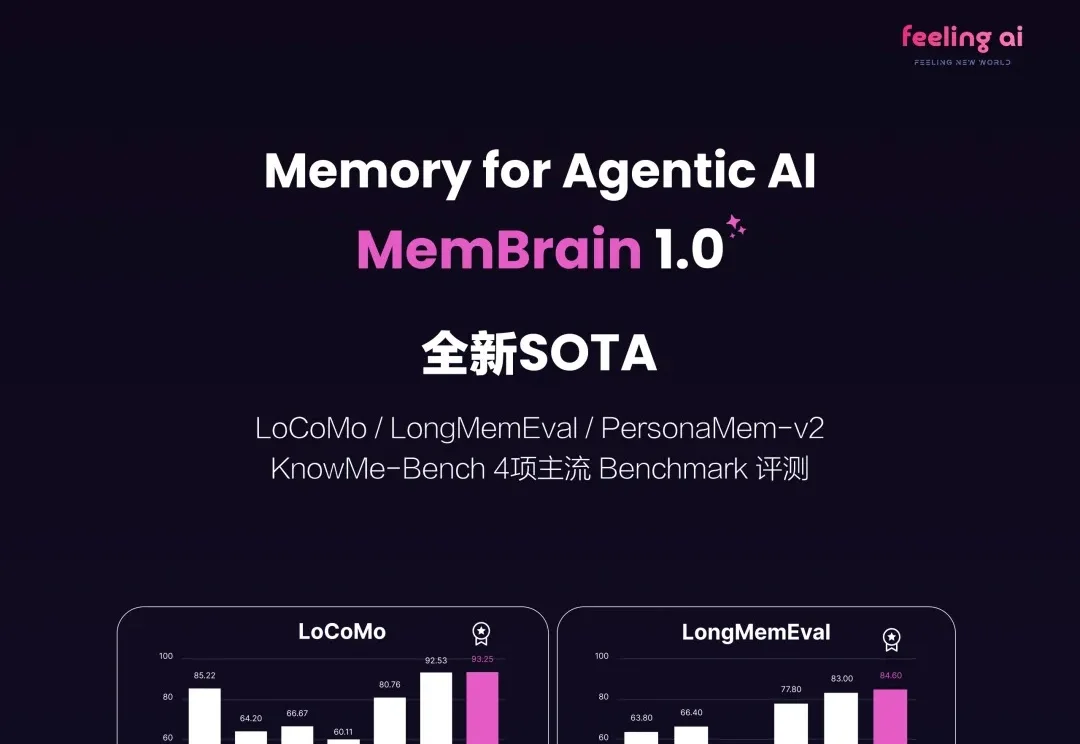

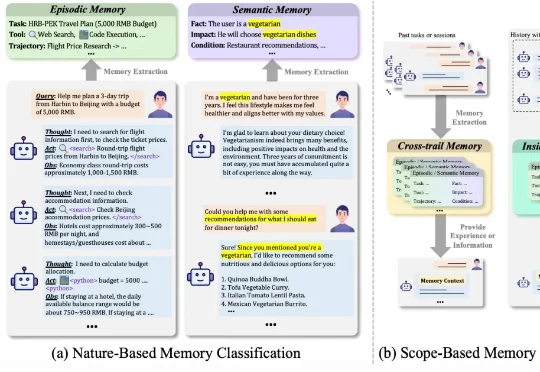

2026 刚来到 2 月,无论是底层模型大厂还是初创公司统统加速开卷,其中 Agentic Memory 方向的快速进化更是把大模型的能力上限推向了 NEXT LEVEL!

“纯做AI工具的创业时代已经结束了,2026年是按效果付费的元年。”

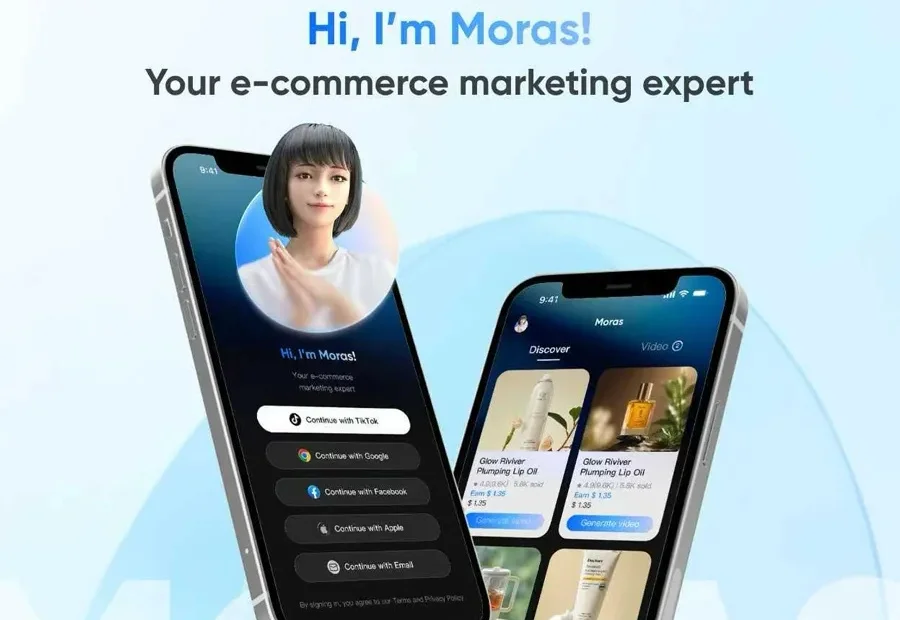

近日,由阿里钉钉最年轻的副总裁王铭创立的攀峰智能(K2 Lab)宣布完成数千万元的种子轮融资,由云时资本独家投资,心流资本FlowCapital担任长期财务顾问。本轮融资资金将主要用于产品和AI能力打造、用户增长和AI Native团队的加速构建,快速推进全球首个面向超级个体的内容电商Agent基建。

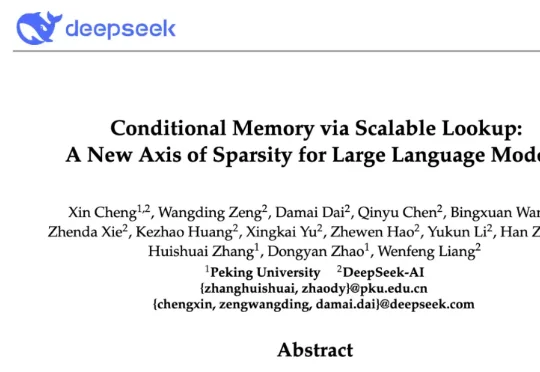

今天凌晨,喜欢闷声做大事的 DeepSeek 再次发布重大技术成果,在其 GitHub 官方仓库开源了新论文与模块 Engram,论文题为 “Conditional Memory via Scalable Lookup: A New Axis of Sparsity for Large Language Models”, 梁文锋再次出现在合著者名单中。

哈工大、鹏城实验室、新加坡国立、复旦、北大联合发布了一篇重磅综述《AI Meets Brain: A Unified Survey on Memory System from Cognitive Neuroscience to Autonomous Agents》,首次打破认知神经科学与人工智能之间的学科壁垒,系统性地将人脑记忆机制与 Agents 记忆统一审视,

CaveAgent的核心思想很简单:与其让LLM费力地去“读”数据的文本快照,不如给它一个如果不手动重启、变量就永远“活着”的 Jupyter Kernel。这项由香港科技大学(HKUST)领衔的研究,为我们展示了一种“Code as Action, State as Memory”的全新可能性。它解决了所有开发过复杂Agent的工程师最头疼的多轮对话中的“失忆”与“漂移”问题。

硬氪独家获悉,在首款AI眼镜发布一年后,闪极科技(深圳)有限公司(以下简称“闪极”)于近日完成近亿元A+轮融资。我们总结了本轮融资信息和该公司几大亮点:融资规模:近亿元