GPT-5.5参数有10T?病毒式论文刚刚被打假,实际缩水至1.5T

GPT-5.5参数有10T?病毒式论文刚刚被打假,实际缩水至1.5T五一假期前,AI社区被一篇「GPT-5.5拥有近10万亿参数」的论文刷屏,今天这项研究就被研究者打假了!研究者表示,修正论文中的各种问题后,GPT-5.5的参数很可能约为1.5T。

搜索

搜索

五一假期前,AI社区被一篇「GPT-5.5拥有近10万亿参数」的论文刷屏,今天这项研究就被研究者打假了!研究者表示,修正论文中的各种问题后,GPT-5.5的参数很可能约为1.5T。

2026年开年以来,Harness工程一词热度渐高,OpenAI在2月发布的一篇详细的内部实验报告标题中使用了此词,ThoughtWorks 首席科学家 Martin Fowler 在 X上也表示Harness工程是AI赋能软件开发的关键部分。

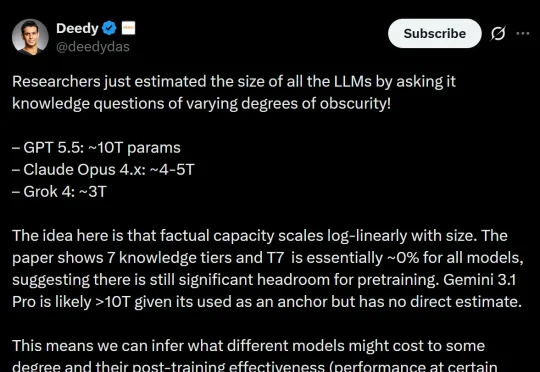

伴随多模态大模型的发展,GUI Agent正成为人机交互的新范式。

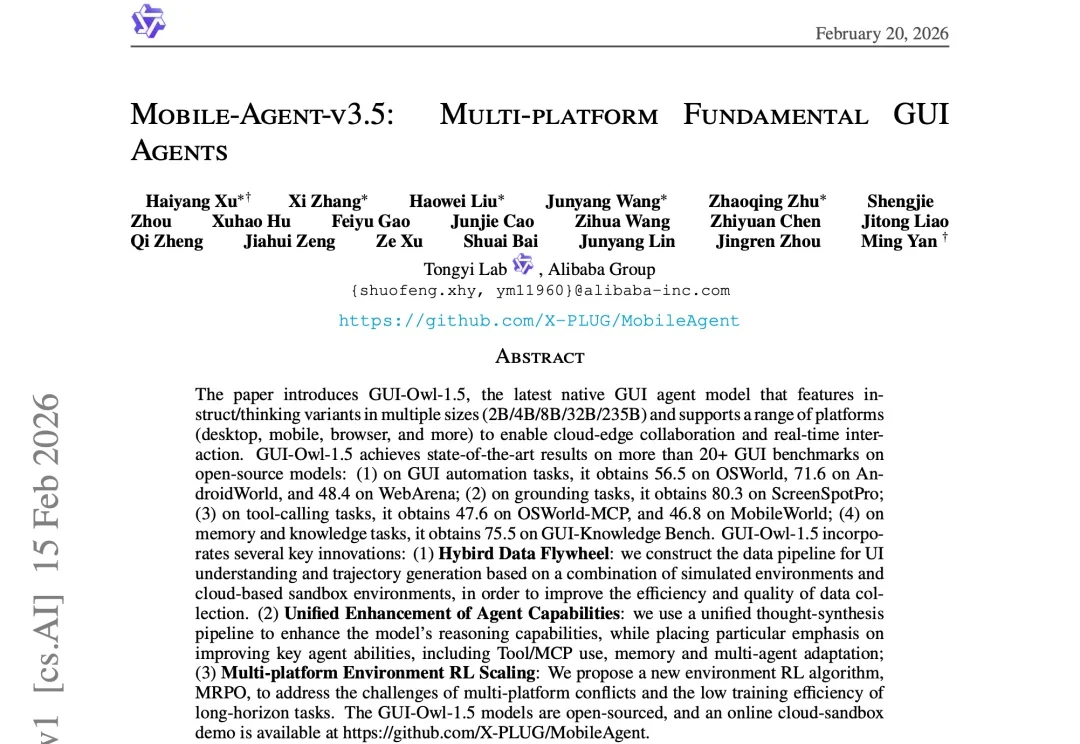

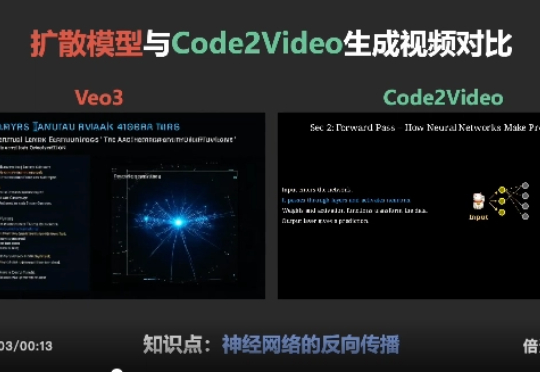

近年来,Stable Diffusion、CogVideoX 等视频生成模型在自然场景中表现惊艳,但面对科学现象 —— 如流体模拟或气象过程 —— 却常常 “乱画”:如下视频所示,生成的流体很容易产生违背物理直觉的现象,比如气旋逆向旋转或整体平移等等。

目前,最先进的对齐方法是使用知识蒸馏(Knowledge Distillation, KD)在所有 token 上最小化 KL 散度。然而,最小化全局 KL 散度并不意味着 token 的接受率最大化。由于小模型容量受限,草稿模型往往难以完整吸收目标模型的知识,导致直接使用蒸馏方法的性能提升受限。在极限场景下,草稿模型和目标模型的巨大尺寸差异甚至可能导致训练不收敛。

尽管今天还有 Sora 角色客串功能和 GPT-5 查找和修复安全漏洞智能体的消息,但本文的重点是深扒 Atlas 背后的「灵魂」—— OWL 架构。看看 OpenAI 究竟是如何驯服 Chromium,把它从浏览器「换皮」玩成了「架构重组」的。

本研究由新加坡国立大学 ShowLab 团队主导完成。 共一作者 Yanzhe Chen 陈彦哲(博士生)与 Kevin Qinghong Lin 林庆泓(博士生)均来自 ShowLab@NUS,分别聚焦于多模态理解以及智能体(Agent)研究。 项目负责人为新加坡国立大学校长青年助理教授 Mike Zheng Shou 寿政。

苹果自研AI搜索引擎,刚刚曝光!据长期追踪苹果资讯的彭博社记者古尔曼爆料,这家公司预计又有两个新动作: 一是在明年春季推出一款代号为“世界知识问答”(World Knowledge Answers)的AI搜索引擎,与ChatGPT和Perplexity展开直接竞争;二是当下倾向于与谷歌合作,利用谷歌模型为Siri的部分功能提供技术支持。

苹果已悄然成立代号「AKI」(Answers, Knowledge & Information)新团队,致力打造类ChatGPT的「答案引擎」,可整合网页信息直接生成回答,计划嵌入Siri、Safari、Spotlight等系统核心功能。这是苹果重塑AI搜索主控权的重大举措。

京东云于今年 7 月正式开源了JoyAgent‑JDGenie,这是业内首个“完整产品级”通用多智能体系统——覆盖前端/后端/智能体框架/执行引擎以及众多子 Agent(如报告、代码、PPT 智能体);在权威 GAIA 基准测试中取得 75.15% 整体准确率,,显著超越 OWL、OpenManus 等同类开源产品。