阿里发布旗舰模型预览版Qwen3.6-Max-Preview!我用这个“半成品”模型,亲手造了一个macOS桌面

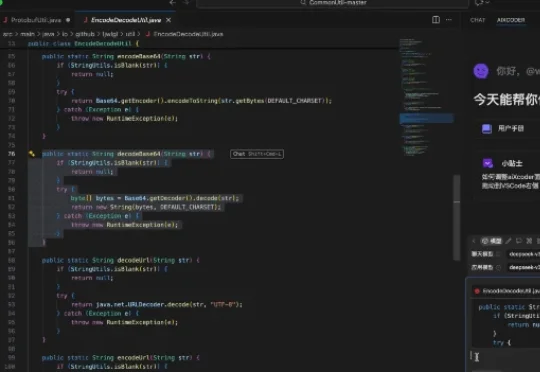

阿里发布旗舰模型预览版Qwen3.6-Max-Preview!我用这个“半成品”模型,亲手造了一个macOS桌面今天,阿里发布了其下一代旗舰模型的早期预览版:Qwen3.6-Max-Preview。在第三方评测榜单Artificial Analysis的智能指数排名中,Qwen3.6-Max-Preview的得分为52分,小幅超过GLM-5.1、MiniMax-M2.7,成为这一榜单上得分最高的国产模型。