ICLR 2026|早于DeepSeek Engram,STEM已重构Transformer「记忆」

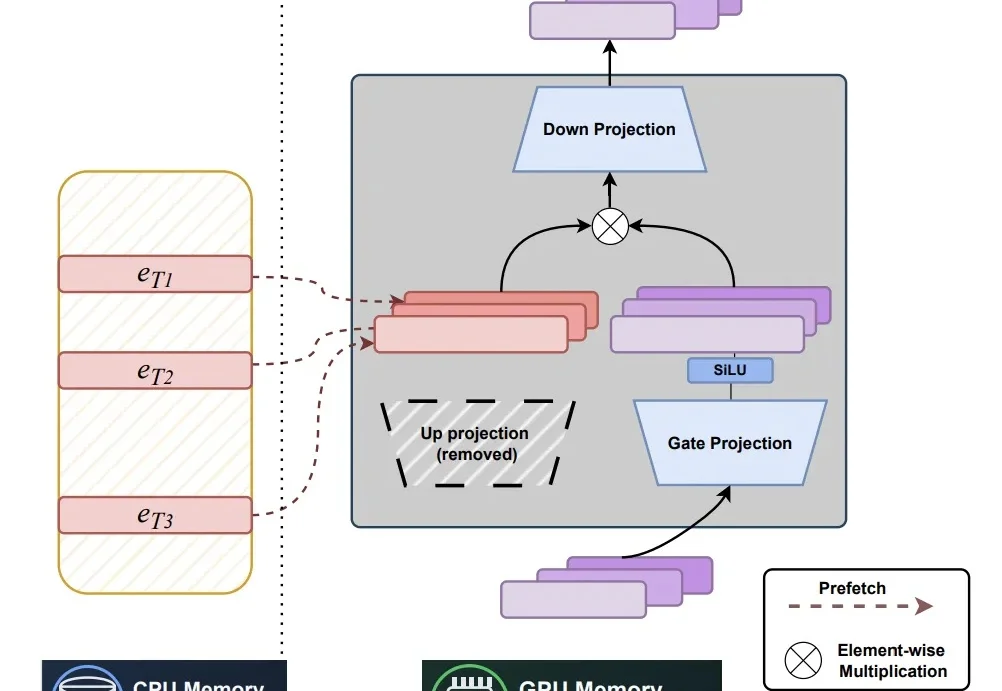

ICLR 2026|早于DeepSeek Engram,STEM已重构Transformer「记忆」近年来,随着大语言模型规模与知识密度不断提升,研究者开始重新思考一个更本质的问题:模型中的参数应如何被组织,才能更高效地充当「记忆」。

近年来,随着大语言模型规模与知识密度不断提升,研究者开始重新思考一个更本质的问题:模型中的参数应如何被组织,才能更高效地充当「记忆」。

OpenAI首席科学家震撼爆料,其神秘内部模型仅凭一周成功攻克了10道未发表顶尖数学难题中的6道。这一名为First Proof的挑战标志着AI已从奥赛选手进化为前沿知识的创造者,奥特曼更直言STEM研究范式将被彻底重塑。

该事故目前已得到谷歌官方技术团队的确认,官方承认属于 “Systemic path-parsing failure ”“Catastrophic impact”“Have seen before”,正在紧急硬编码修复上线中(自 2 月 6 日回复起,截止目前,暂未有修复完成的正式通知)

我们都在System Prompt里写过无数次 You are a helpful assistant,但你是否想过:这行文字在模型的残差流(Residual Stream)中究竟对应着怎样的几何结构?

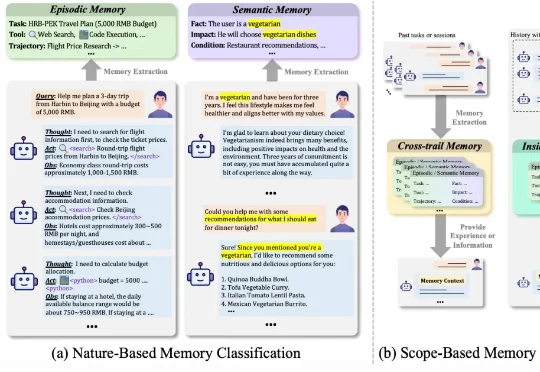

哈工大、鹏城实验室、新加坡国立、复旦、北大联合发布了一篇重磅综述《AI Meets Brain: A Unified Survey on Memory System from Cognitive Neuroscience to Autonomous Agents》,首次打破认知神经科学与人工智能之间的学科壁垒,系统性地将人脑记忆机制与 Agents 记忆统一审视,

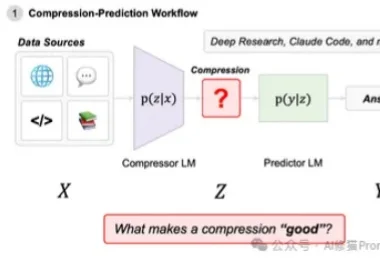

在近一年里,Agentic System(代理系统/智能体系统)正变得无处不在。从Open AI的Deep Research到Claude Code,我们看到越来越多的系统不再依赖单一模型,而是通过多模型协作来完成复杂的长窗口任务。

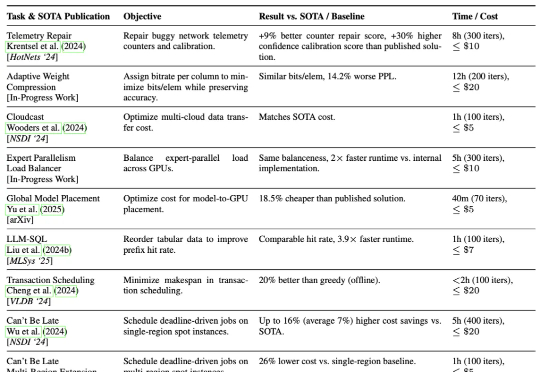

加州大学伯克利分校的研究团队提出了一种AI驱动的系统研究方法ADRS(AI-Driven Research for Systems),它可以通过“生成—评估—改进”的迭代循环,实现算法的持续优化。

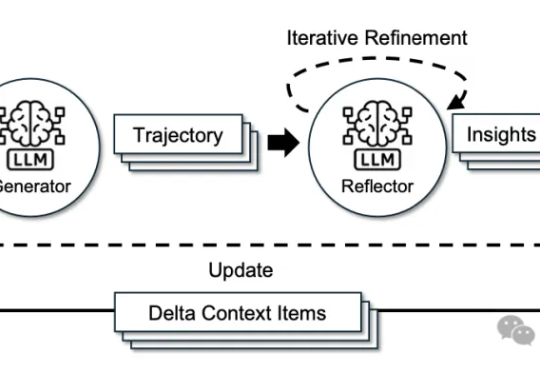

来自斯坦福大学、SambaNova Systems公司和加州大学伯克利分校的研究人员,在新论文中证明:依靠上下文工程,无需调整任何权重,模型也能不断变聪明。他们提出的方法名为智能体上下文工程ACE。

阿里巴巴集团安全部联合清华大学、复旦大学、东南大学、新加坡南洋理工等高校,联合发布技术报告;其理念与最近OpenAI发布的GPT-5 System Card放在首位的“From Hard Refusals to Safe-Completions”理念不谋而合。

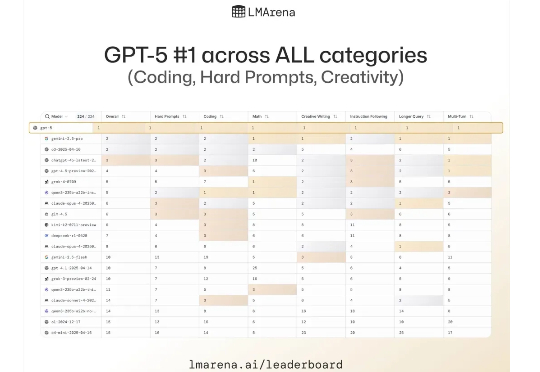

一起给GPT5上上强度吧! 我相信它的参数、API、纸面实力已经被扒得差不多了,所以接下来的内容先会分为总结篇,把system card、发布会、OpenAI自家技术博客、奥特曼私下说的信息做个全篇,然后从编程、写作、多模态、PPT等等给GPT犁一边,最后再总结一下GPT-5后续的一些开发计划啥的,Here we go!