Mamba-3惊现AI顶会ICLR 2026!CMU知名华人教授一作首代工作AI圈爆红

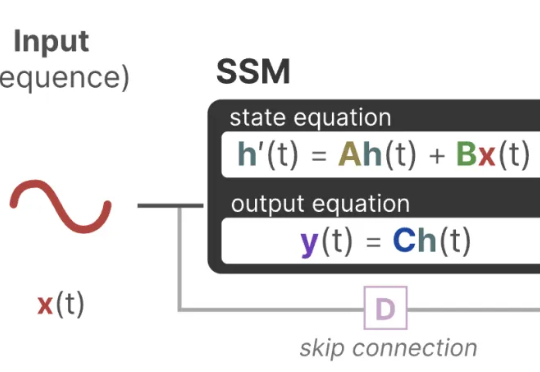

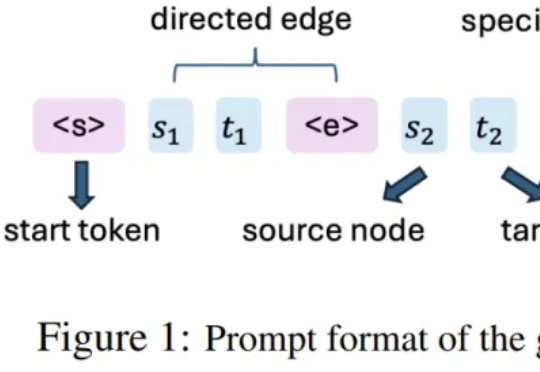

Mamba-3惊现AI顶会ICLR 2026!CMU知名华人教授一作首代工作AI圈爆红曼巴回来了!Transformer框架最有力挑战者之一Mamba的最新进化版本Mamba-3来了,已进入ICLR 2026盲审环节,超长文本处理和低延时是其相对Transformer的显著优势。另一个挑战者是FBAM,从不同的角度探索Transformer的下一代框架。

搜索

搜索

曼巴回来了!Transformer框架最有力挑战者之一Mamba的最新进化版本Mamba-3来了,已进入ICLR 2026盲审环节,超长文本处理和低延时是其相对Transformer的显著优势。另一个挑战者是FBAM,从不同的角度探索Transformer的下一代框架。

该团队 2025 年的研究《Reasoning by superposition: A theoretical perspective on chain of continuous thought》已从理论上指出,连续思维链的一个关键优势在于它能使模型在叠加(superposition)状态下进行推理:当模型面对多个可能的推理路径而无法确定哪一个是正确时,它可以在连续空间中并行地保留所有可能的路

英伟达还能“猖狂”多久?——不出三年! 实现AGI需要新的架构吗?——不用,Transformer足矣! “近几年推理成本下降了100倍,未来还有望再降低10倍!” 这些“暴论”,出自Flash Attention的作者——Tri Dao。

Transformer作者Llion Jones带着自己的初创公司Sakana AI,又来搞事情了。(doge)最新推出的开源框架——ShinkaEvolve,可以让LLM在自己写代码优化自己的同时,还能同时兼顾效率,be like为进化计算装上一个“加速引擎”。

起猛了,苹果怎么搞起跨界AI模型了??发布了一个基于流匹配的蛋白质折叠模型SimpleFold,被网友戏称为“iFold”。SimpleFold没有花里胡哨的专属模块设计,就靠通用的Transformer模块,搭配流匹配生成范式,3B参数版本追平了该领域顶流模型谷歌AlphaFold2的性能。

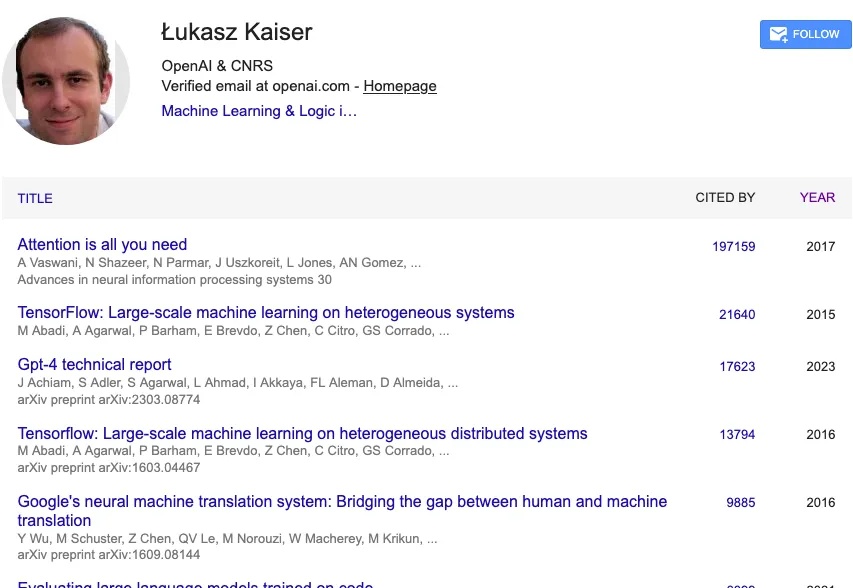

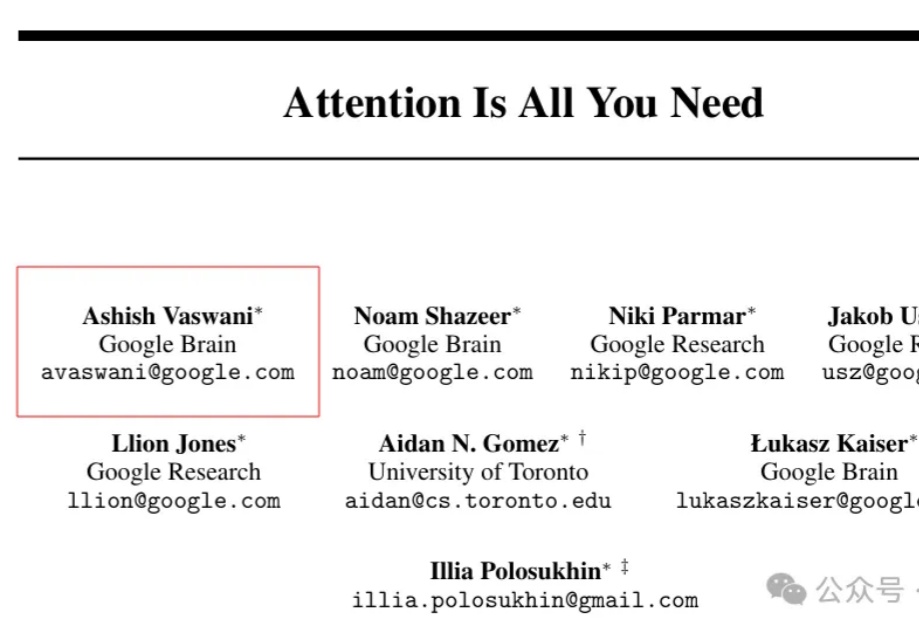

2017 年,一篇标题看似简单、甚至有些狂妄的论文在线上出现:《Attention Is All You Need》。

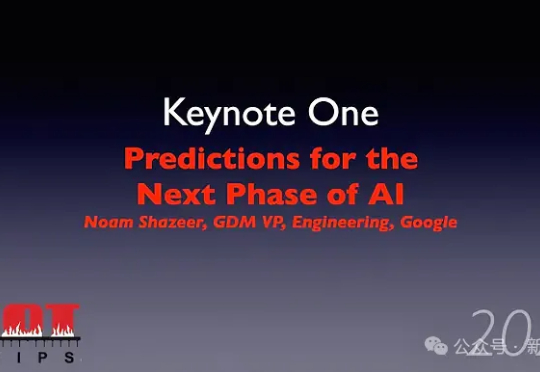

在AI热潮中,大模型最「渴求」的究竟是什么?是算力、是存储,还是复杂的网络互联?在Hot Chips 2025 上,Transformer发明者之一、谷歌Gemini联合负责人Noam Shazeer给出了答案。

AGI真正降临那天,人类意识上传终获「数字永生」!它将模拟大脑每一次脉冲,预测世界每一种变迁,甚至重构灵魂本质。新智元十周年峰会上,清华刘嘉教授带来了一场思想盛宴。他从脑科学角度,深入解析AGI如何突破生物桎梏,开启无限的可能。

“闭源人工智能在阻碍我们探索真正的科学。”

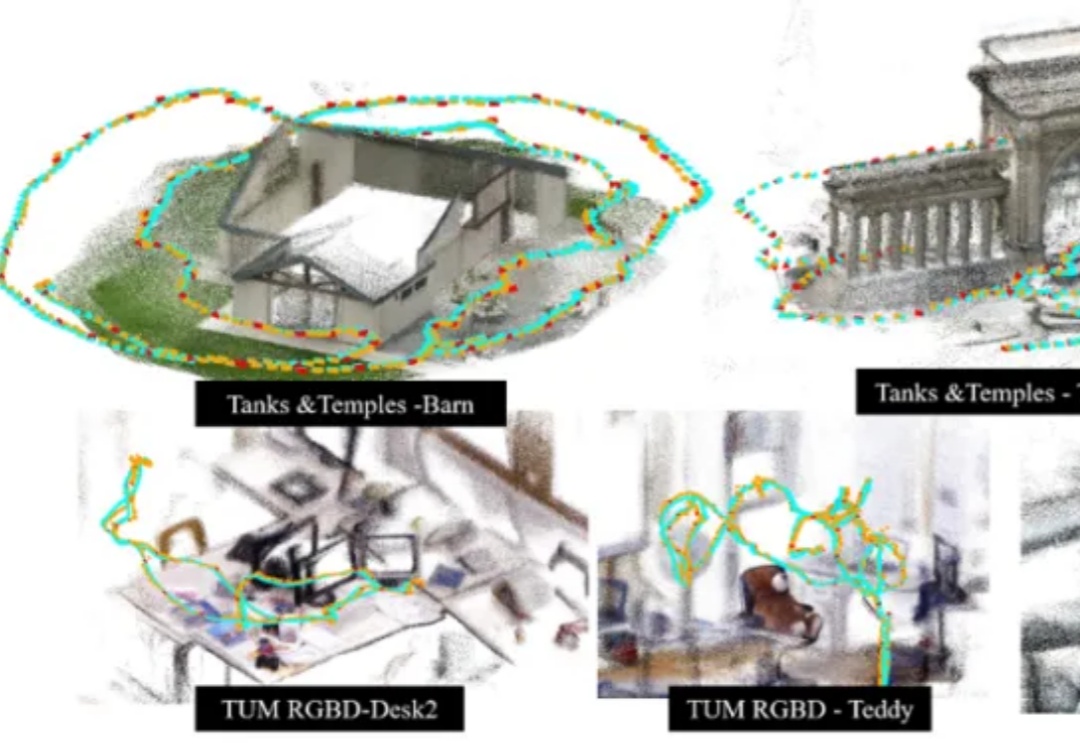

香港科技大学谭平教授团队与地平线(Horizon Robotics)团队最新发布了一项 3D 场景表征与大规模重建新方法 SAIL-Recon,通过锚点图建立构建场景全局隐式表征,突破现有 VGGT 基础模型对于大规模视觉定位与 3D 重建的处理能力瓶颈,实现万帧级的场景表征抽取与定位重建,将空间智能「3D 表征与建模」前沿推向一个新的高度。