文生图参数量升至240亿!Playground v3发布:深度融合LLM,图形设计能力超越人类

文生图参数量升至240亿!Playground v3发布:深度融合LLM,图形设计能力超越人类自去年以来,文本到图像生成模型取得了巨大进展,模型的架构从传统的基于UNet逐渐转变为基于Transformer的模型。

自去年以来,文本到图像生成模型取得了巨大进展,模型的架构从传统的基于UNet逐渐转变为基于Transformer的模型。

chatGPT,AI,AI 3D,CE3D,扩散模型

是否还在苦恼于开源图生 / 文生三维模型无法直接嵌入到 CG 工作流中?是否在寻找具备高质量几何与物理材质的三维生成大模型?

本论文第一作者倪赞林是清华大学自动化系 2022 级直博生,师从黄高副教授,主要研究方向为高效深度学习与图像生成。他曾在 ICCV、CVPR、ECCV、ICLR 等国际会议上发表多篇学术论文。

随着近年来在文本和视频数据上构建基础模型的进展,学术界对时间序列的基础模型也表现出浓厚的兴趣。 时间序列分析在许多关键领域中具有重要性,能够影响从科学研究到经济决策的广泛应用。

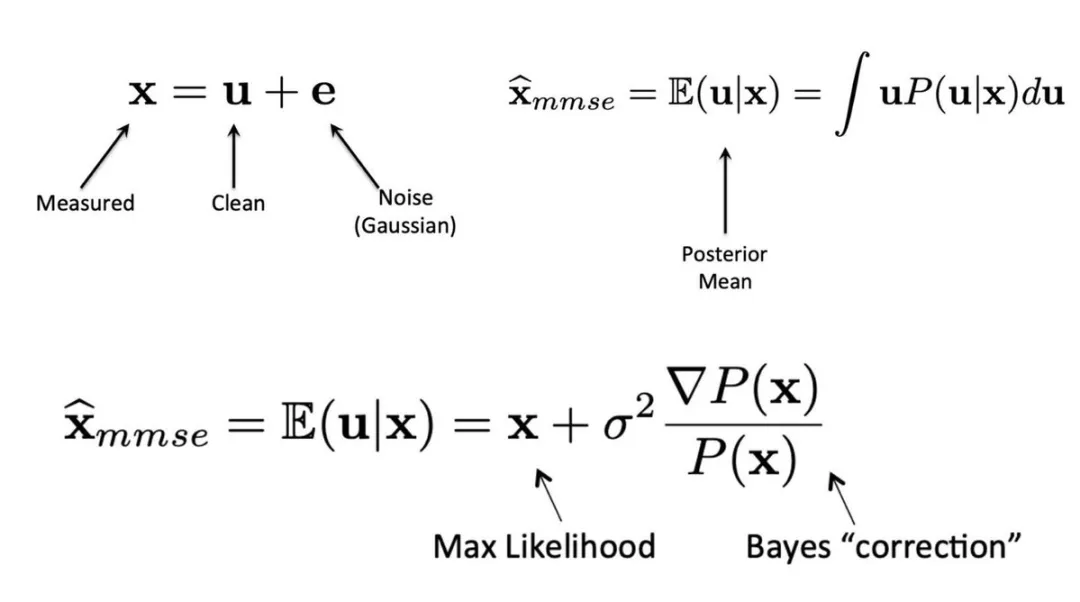

今天的内容有点烧脑但绝对干货满满!

“比Sora还震撼”,AI可以实时生成游戏了!

GameNGen 是第一个完全由神经模型驱动的游戏引擎。

来自复旦大学视觉与学习实验室的研究者们提出了一种新型的面向视频模型的对抗攻击方法 - 基于扩散模型的视频非限制迁移攻击(ReToMe-VA)。该方法采用逐时间步对抗隐变量优化策略,以实现生成对抗样本的空间不可感知性;同时,在生成对抗帧的去噪过程中引入了递归 token 合并策略,通过匹配及合并视频帧之间的自注意力 token,显著提升了对抗视频的迁移性和时序一致性。

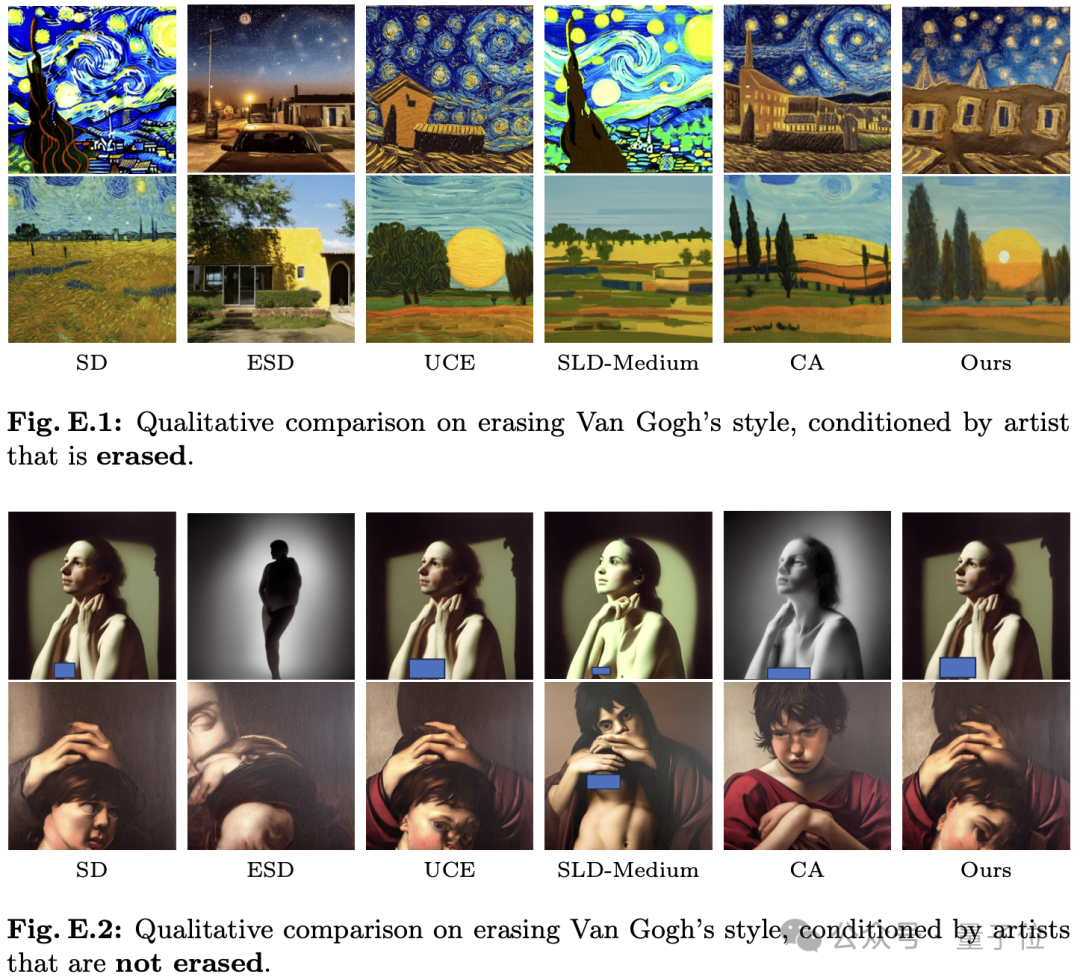

让AI绘画模型变“乖”,现在仅需3秒调整模型参数。