仅需10%思维链标注,等同全量性能!计算所发布推理监督新范式

仅需10%思维链标注,等同全量性能!计算所发布推理监督新范式大语言模型(LLMs)推理能力近年来快速提升,但传统方法依赖大量昂贵的人工标注思维链。中国科学院计算所团队提出新框架PARO,通过让模型学习固定推理模式自动生成思维链,只需大模型标注1/10数据就能达到全量人工标注的性能。这种方法特别适合像金融、审计这样规则清晰的领域,为高效推理监督提供了全新思路。

大语言模型(LLMs)推理能力近年来快速提升,但传统方法依赖大量昂贵的人工标注思维链。中国科学院计算所团队提出新框架PARO,通过让模型学习固定推理模式自动生成思维链,只需大模型标注1/10数据就能达到全量人工标注的性能。这种方法特别适合像金融、审计这样规则清晰的领域,为高效推理监督提供了全新思路。

在当前评测生成式模型代码能力的浪潮中,传统依赖人工编写的算法基准测试集,正日益暴露出可扩展性不足与数据污染严重两大瓶颈。

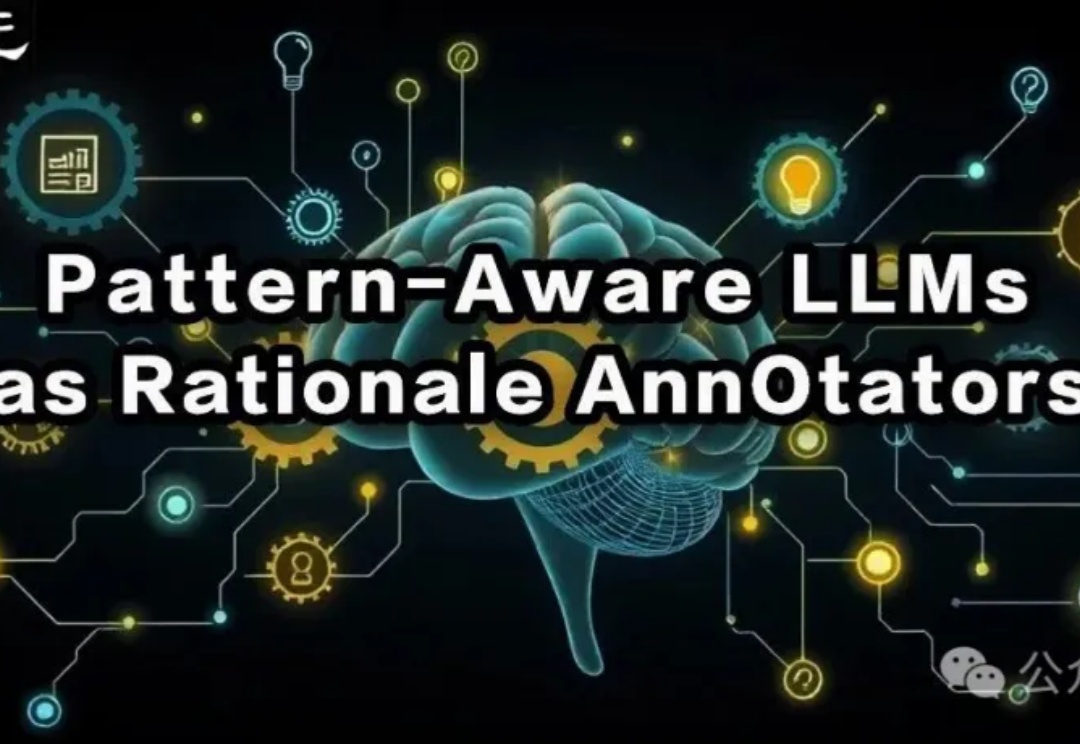

当强大的多模态大语言模型应用于地球科学研究时,它面临着无法忽视的 「阿克琉斯之踵」

今日(10 月 28 日),高通正式宣布推出两款全新芯片——高通 AI200 和高通 AI250,以及相应的机架级解决方案。此举直接挑战了由英伟达和超威半导体长期主导的 AI 芯片领域。消息宣布后,高通股价依然应声飙升,涨幅超 11%,创 2024 年 7 月以来新高。

数据集蒸馏是一种用少量合成数据替代全量数据训练模型的技术,能让模型高效又节能。WMDD和GUARD两项研究分别解决了如何保留原始数据特性并提升模型对抗扰动能力的问题,使模型在少量数据上训练时既准确又可靠。

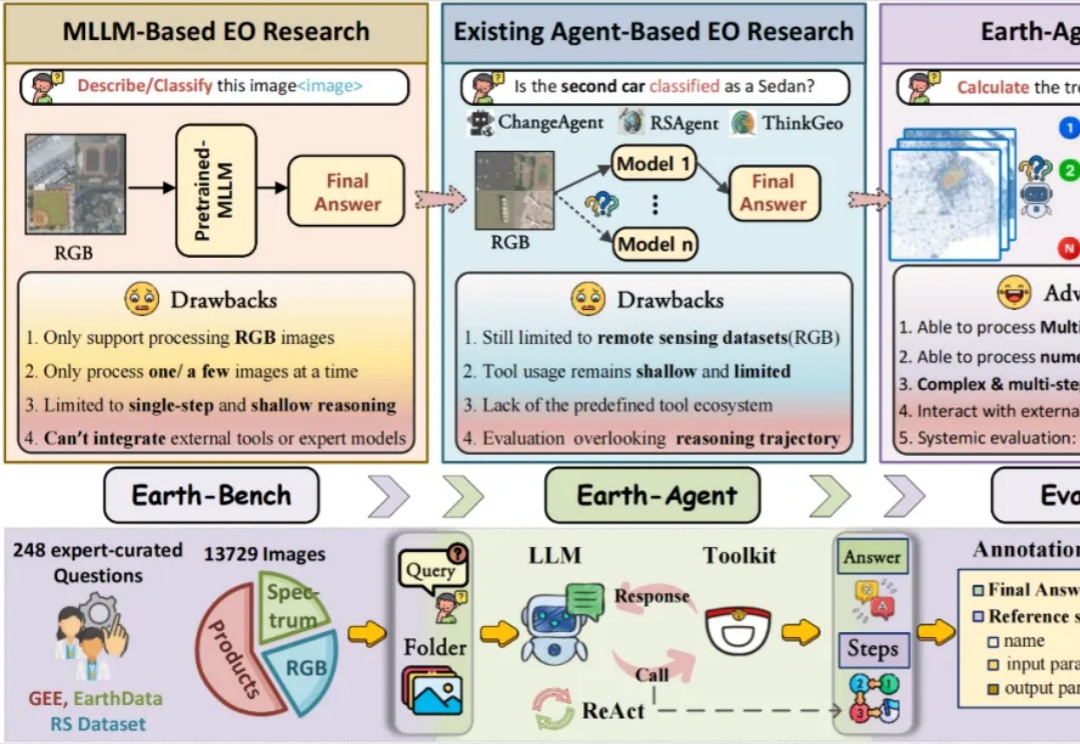

2025 年秋的具身智能赛道正被巨头动态点燃:特斯拉上海超级工厂宣布 Optimus 2.0 量产下线,同步开放开发者平台提供运动控制与环境感知 SDK,试图通过生态共建破解数据孤岛难题;英伟达则在 SIGGRAPH 大会抛出物理 AI 全栈方案,其 Omniverse 平台结合 Cosmos 世界模型可生成高质量合成数据,直指真机数据短缺痛点。

在开放研究领域里,苹果似乎一整个脱胎换骨,在纯粹的研究中经常会有一些出彩的工作。这次苹果发布的研究成果的确出人意料:他们用谷歌的 Nano-banana 模型做个了视觉编辑领域的 ImageNet。

在 AI 时代,开发的边界正被重新划定。 我们能够观察到,越来越多的产品经理、数据分析师、设计师,甚至内容创作者,正在熟练地使用 Cursor、ChatGPT、DeepSeek 等 AI 工具,解决真

500 万用户、八位数年经常性收入、日均新增 2 万用户——对于 2024 年初由两名 20 岁大学生 Rudy Arora 与 Sarthak Dhawan 创办的初创公司 Turbo AI 而言,这些数据堪称亮眼。对于刚达到法定饮酒年龄(美国为 21 岁)的年轻人来说,这样的成绩更显不可思议。

注意看,眼前这个男人暂且叫他小帅。 你可能想不到,他只是在厨房里优雅地煎牛排做做家务,每小时最高能赚进1000多块(150美元)。 怪不得小帅天天上班喜笑颜开。