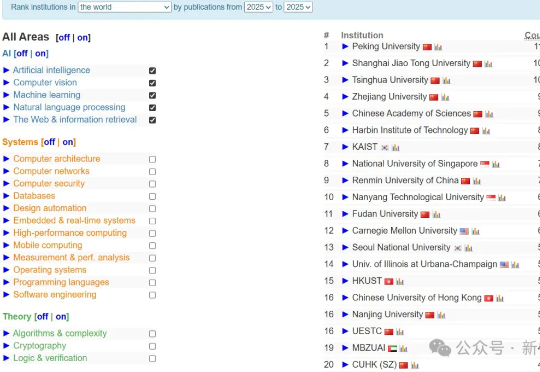

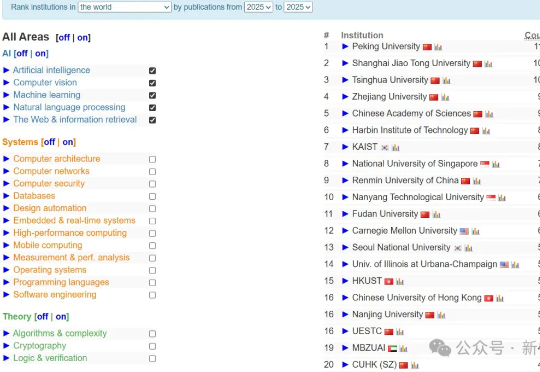

终结CMU霸权,清华首次登顶CSRankings世界第一!北大AI领域夺冠

终结CMU霸权,清华首次登顶CSRankings世界第一!北大AI领域夺冠2025 CSRankings刚刚更新,清华登顶世界第一!此次更新最大看点是中国高校集体爆发:清华大学、上海交通大学、浙江大学、北京大学分列第1、3、4、5位,直接占据了TOP 5中的4个名额。

2025 CSRankings刚刚更新,清华登顶世界第一!此次更新最大看点是中国高校集体爆发:清华大学、上海交通大学、浙江大学、北京大学分列第1、3、4、5位,直接占据了TOP 5中的4个名额。

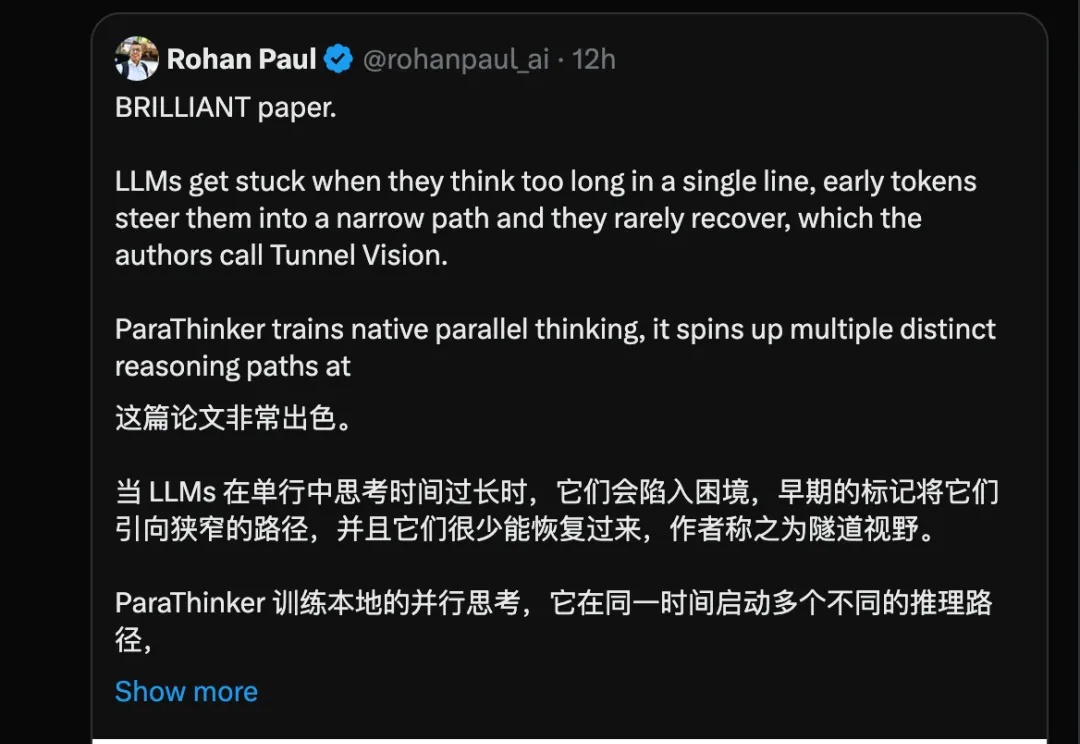

近年来,大语言模型(LLMs)在复杂推理任务上的能力突飞猛进,这在很大程度上得益于深度思考的策略,即通过增加测试时(test-time)的计算量,让模型生成更长的思维链(Chain-of-Thought)。

我们是由清华大学、北京大学、东京大学、南洋理工大学等海内外名校毕业生,融合计算机、金融等学科背景成员组成的互联网初创团队。目前正在做的是一款Ai+东方命理学的软件,名为 信风Flow 。

AGI真正降临那天,人类意识上传终获「数字永生」!它将模拟大脑每一次脉冲,预测世界每一种变迁,甚至重构灵魂本质。新智元十周年峰会上,清华刘嘉教授带来了一场思想盛宴。他从脑科学角度,深入解析AGI如何突破生物桎梏,开启无限的可能。

昨天,有消息称,OpenAI 著名研究者、清华校友、著名博客《AI 下半场》的作者姚顺雨已经加入了腾讯混元大模型团队,并且还传言说他将在这里组建一支自己领导的研究团队。

2025年4月,OpenAI研究员姚顺雨发布了一篇有名的博文《The Second Half》,宣告AI主线程的游戏已进入下半场。这之后,我们与他进行了一场播客对谈。姚顺雨毕业于清华和普林斯顿大学,博士期间意识到语言是人类发明的最重要的工具,也是最有可能构建通用系统的,于是转向Language Agent研究,至今已6年。

为了降低大模型预训练成本,最近两年,出现了很多新的优化器,声称能相比较AdamW,将预训练加速1.4×到2×。但斯坦福的一项研究,指出不仅新优化器的加速低于宣称值,而且会随模型规模的增大而减弱,该研究证实了严格基准评测的必要性。

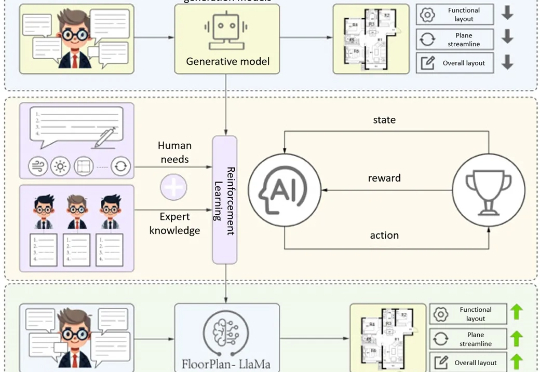

清华大学最新提出的建筑专业知识驱动的平面图自动生成方案FloorPlan-LLaMa,解决传统模型「指标优秀但实际不可用」 痛点,让AI生成贴合建筑师设计偏好的可行方案。

这并非科幻片中的桥段,而是来自清华大学与北京航空航天大学团队的最新成果——BSC-Nav 的真实演示。通过模仿生物大脑构建、维护空间记忆的原理,研究团队让智能体拥有了前所未有的「空间感」。

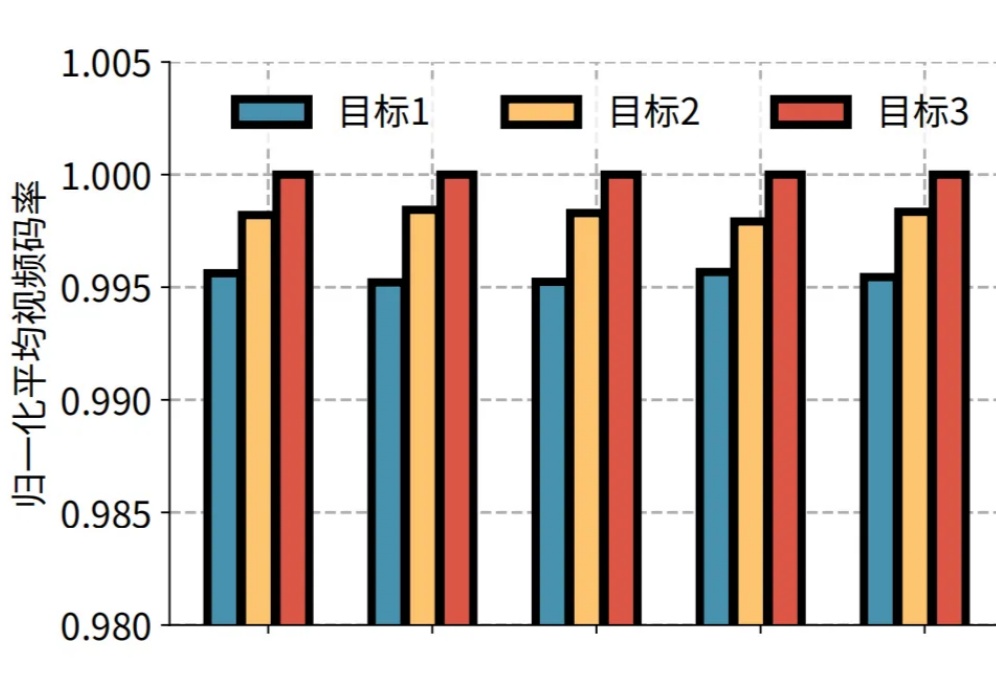

近日,快手与清华大学孙立峰团队联合发表论文《Towards User-level QoE: Large-scale Practice in Personalized Optimization of Adaptive Video Streaming》,被计算机网络领域的国际顶尖学术会议 ACM SIGCOMM 2025 录用。