盛大AI研究院新作:流式生成超越非流式,一句话让虚拟人动作丝滑如真,推理延迟仅1帧

盛大AI研究院新作:流式生成超越非流式,一句话让虚拟人动作丝滑如真,推理延迟仅1帧文本驱动的人体动作生成是游戏NPC、虚拟主播、机器人控制等实时交互系统的核心技术。

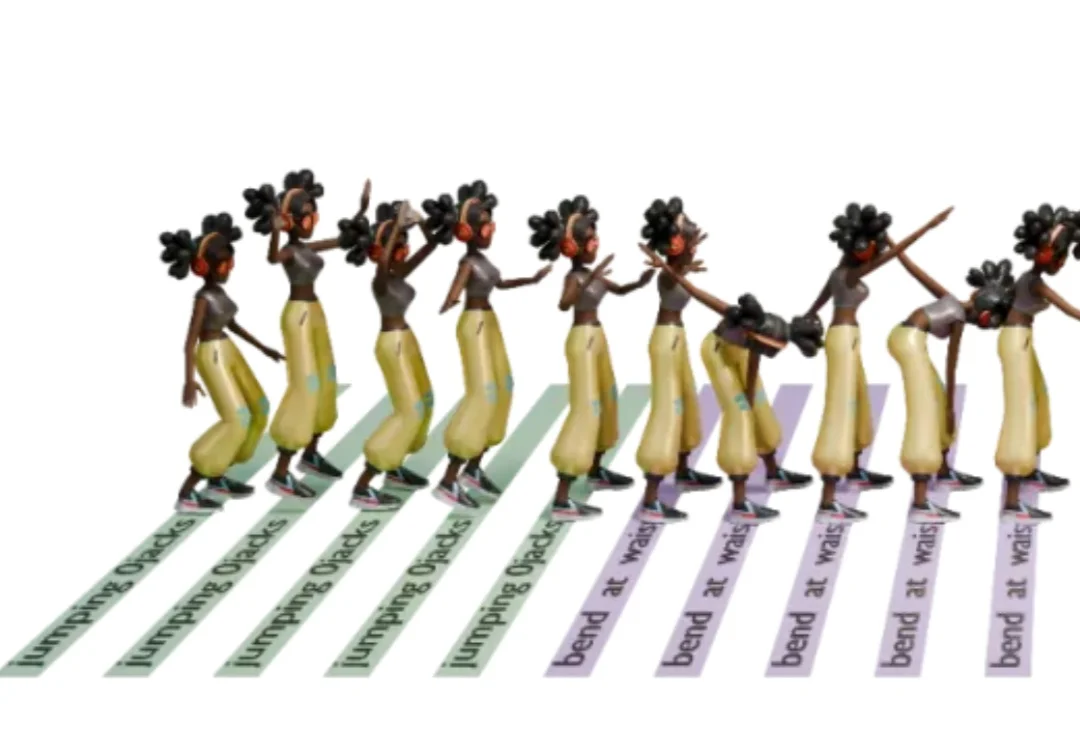

文本驱动的人体动作生成是游戏NPC、虚拟主播、机器人控制等实时交互系统的核心技术。

在计算机图形学、三维视觉、虚拟人、XR 领域,SIGGRAPH 是毫无争议的 “天花板级会议”。 SIGGRAPH Asia 作为 SIGGRAPH 系列两大主会之一,每年只接收全球最顶尖研究团队的成果稿件,代表着学术与工业界的最高研究水平与最前沿技术趋势。

2025 年 12 月,由 阿里巴巴 联合 中国科学技术大学、浙江大学等机构共同研发的实时虚拟人项目 LiveAvatar 正式对外开源。该项目聚焦长期困扰虚拟人行业的两大技术瓶颈——“实时响应能力”与“长时稳定生成能力”,首次在同一系统中实现了二者的工程级统一。

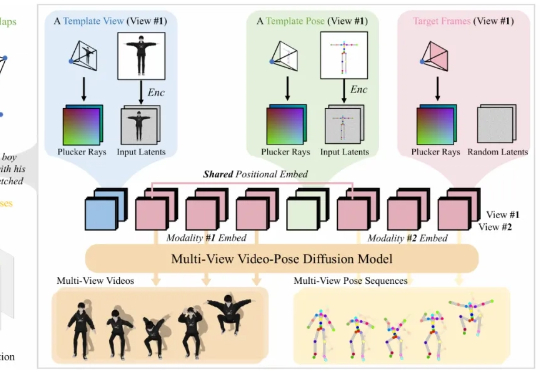

在游戏、影视制作、虚拟人和交互式内容创作等行业中,高质量的 3D 动画是实现真实感与表现力的基础。然而,传统计算机图形学中的动画制作通常依赖于骨骼绑定与关键帧编辑,这一流程虽然能够带来高质量与精细控制,但需要经验丰富的艺术家投入大量人力与时间,代价昂贵。

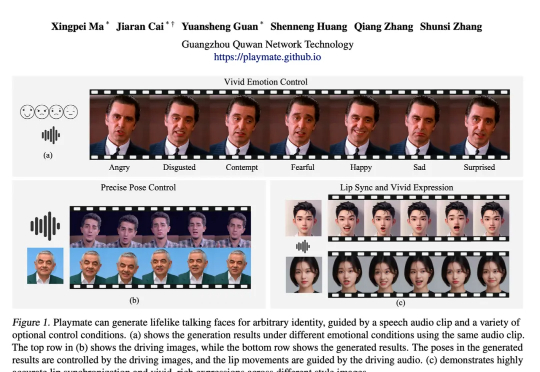

想象一个虚拟人,他不仅能精准地对上你的口型,还能在你讲到关键点时做出恍然大悟的表情,在你讲述悲伤故事时流露出同情的神态,甚至能根据你的话语逻辑做出有意义的手势。

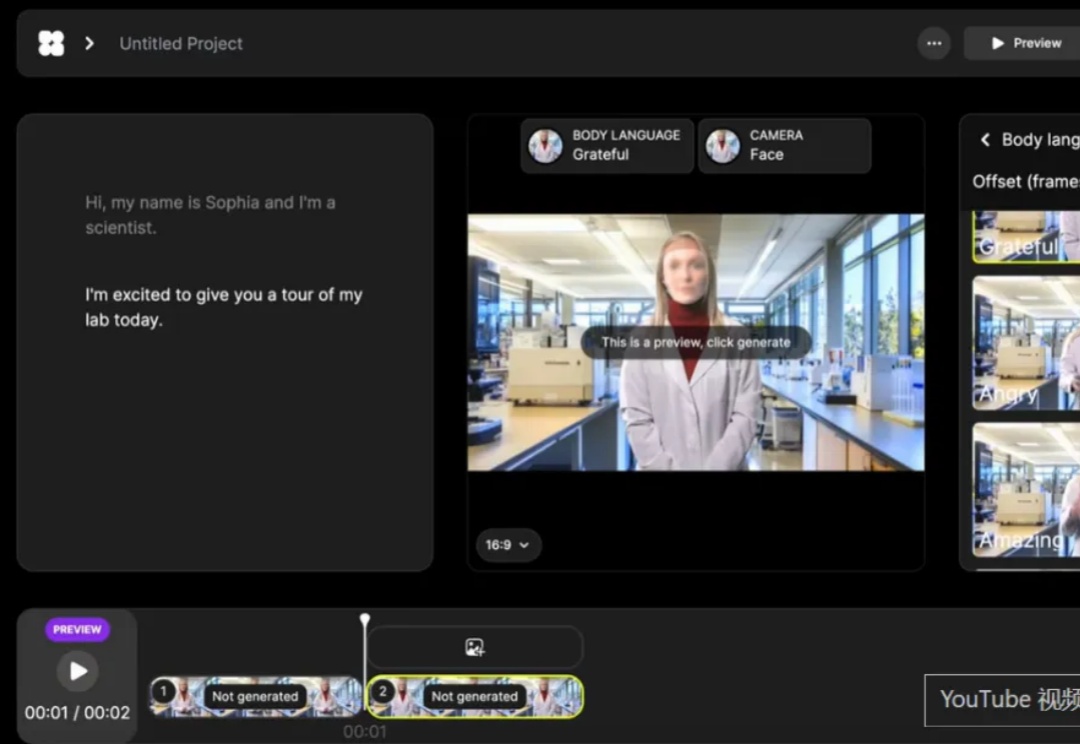

人工智能初创公司Akool荣登2025年度“Inc. 5000”榜单榜首,成为美国增长最快的私营企业。

天津大学联合清华和卡迪夫大学推出RESCUE系统,把「大脑感知-决策-行动」循环搬进电脑,让数百个虚拟人同时在线逃生:他们能实时看见地形、同伴和出口,自动绕开障碍,年轻人快跑、老人慢走、残疾人蹒跚;系统还能把身体24个部位的碰撞力用颜色实时标出来,帮助设计师提前找出潜在风险区域,也能用来演练地铁火灾、演唱会疏散等公共安全场景。

本研究由广州趣丸科技团队完成,团队长期致力于 AI 驱动的虚拟人生成与交互技术,相关成果已应用于游戏、影视及社交场景

最近你是不是也被一系列“回答我”鬼畜视频刷屏?在各种社交软件上,明明上一秒还是一张静态照片,下一秒就能扭腰转身、街舞翻跳,甚至连兵马俑都能跳Kpop。

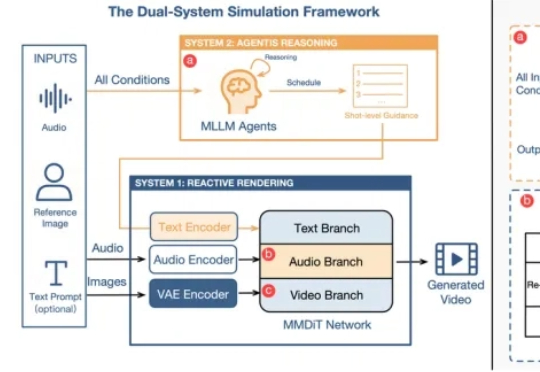

AI虚拟人模型架构从CNN、GANs演进至Transformer+扩散模型,实现从单一面部驱动到半身/全身动态生成的跨越,口型同步与多模态协同表现显著提升。