马斯克囤了几十万张卡,结果只跑了11%?

这个数字最先被The Information曝出,后又被Business Insider根据一份xAI内部备忘录实锤。

这份备忘录出自xAI总裁Michael Nicolls之手。

面对这个数字,他甩出四个字:低得尴尬。

The Information报道,xAI手里约有50万张英伟达GPU,虽然xAI官方至今未公开确认,但其官网已写明:Colossus集群已扩展到20万张GPU,目标是100万张。

无论按哪个数字,xAI都坐拥公开披露中规模最大的AI算力集群之一。

但根据Nicolls备忘录,这几十万张GPU实际只跑出了约11%的有效训练算力。

Nicolls给团队定的目标,未来几个月内要把这个数字拉到50%。

从11%到50%,差的不是几台机器,而是一整套训练栈。

xAI在孟菲斯建成的Colossus集群内部,目前已扩至20万张GPU,目标是100万张,是公开披露中最大的AI超算之一。

11%不等于89%的GPU在睡觉

很多人第一次看到「11%」这个数字,会下意识理解成「89%的GPU在睡觉」,这也是它最容易被误读的地方。

11%对应一个行业指标MFU(Model FLOPs Utilization,模型浮点运算利用率)。

AI算力公司Lambda在白皮书里给它的定义是:MFU等于实际观测到的FLOPS,除以GPU理论峰值FLOPS。

换句话说,它衡量的是你买的这块卡,在训练这一刻,把多少理论算力真正转化成了有效的训练吞吐。

它不是任务管理器里那个「GPU占用率」。GPU可以100%忙着等数据、忙着同步、忙着重新计算,但有效输出寥寥。MFU衡量的正是那点真正干活的部分。

这11%意味着,理论上能产生100份训练吞吐的硬件,实际只跑了11份。剩下的89%不是闲着,是在做无用功,或者在等待。

从烧钱的角度看,低MFU意味着大量电力和硬件时间消耗在通信、等待、数据搬运、重计算等环节,而没有转化为理想状态下的有效训练吞吐。

那11%在工程现实里到底差到什么程度?这就要看历史对照表。

Lambda在白皮书里提到:生产级LLM训练的MFU通常落在35%到45%之间。这是正常水平。

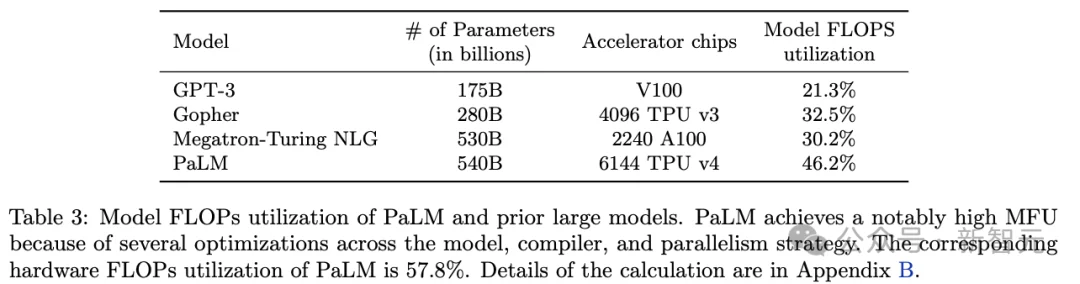

还有一组更犀利的对比数据来自谷歌PaLM论文。

https://arxiv.org/pdf/2204.02311

这篇论文有一张被广为引用的MFU对比表:

英伟达自己维护的训练框架Megatron-LM,其GitHub页面上写明:在H100集群上训2B到462B参数模型,MFU最高可以到47%。强扩展到4608张H100时,因为通信开销暴露,MFU会从47%降到42%。

把xAI的11%放进这张表里,它低于GPT-3那个被嘲笑过效率低的古早年代,也低于Gopher、MT-NLG、PaLM、Megatron-LM。

几乎是低于所有公开前沿训练系统的下沿。

至于低MFU的原因,Lambda也总结过。

显存压力、单卡batch太小、过度的激活重计算(activation checkpointing)、把权重切得过碎的张量并行带来的跨GPU通信开销,任何一个都会拖累MFU。

一位同行研究员的描述更形象:HBM显存比加速器慢得多,芯片大量时间在等数据进来;网络拓扑里任何一处瓶颈,都会拖垮几千张卡的同步。

业内管这个叫「记忆墙(memory wall)」。

11%不是单点故障,是系统级问题。

这不止是xAI一家的问题

不过,把xAI单拎出来说事,也未必公平。

The Information报道里还提到了一位同行匿名研究员的一句评价:「跑过40%对xAI的大多数竞争对手来说也很难」。

这是一个刺破全行业体面的问题。

报道里提到,一些研究员为了让自己的MFU数字「好看一点」,会反复重跑训练实验,人为抬高利用率。

原因有两个:一是怕被老板骂;二是怕GPU被调走分给别的团队。

这些研究员的逻辑是,我的卡现在确实在闲着,但我只是「在分析上一轮训练结果,马上就要再跑」,不能让它被收走。

在AI大厂里,跑分这件事不只发生在公开榜单上,也发生在内部GPU调度系统里。

xAI并不是一个硬件部署上的反面教材。The Information提到,xAI在业内以「按英伟达推荐方式部署GPU」著称,是模范生。

模范生只跑了11%,说明问题不在硬件、网络拓扑标准,而在更上层的训练栈、并行策略和模型工程。

11%这个数字,也捅破了行业心照不宣的那层窗户纸:买卡和用卡是两回事。

Colossus开始把卡租出去了

也几乎在同一时间,xAI开始把卡租出去了。

xAI CEO马斯克(左)与Cursor CEO Michael Truell(右)。Cursor计划用数万张xAI的GPU训练Composer 2.5。

据Business Insider报道,编程创业公司Cursor将使用「数万张xAI的GPU」来训练它的最新编程模型Composer 2.5。

Cursor此前估值约290亿美元,近期又被曝正洽谈约500亿美元估值。

如果把两件事放在同一时间线上看,至少可以说明:在自训效率尚未完全释放时,把部分算力外部化,可能成为xAI摊薄基础设施成本的一种选择。

更微妙的是xAI基础设施团队近期的人事地震。

原基础设施负责人Heinrich Küttler离职,Jake Palmer接管了物理基础设施,SpaceX的Daniel Dueri被调来负责算力基础设施。

与此同时,Cursor原产品工程负责人Andrew Milich和Jason Ginsburg跳槽到xAI,直接向马斯克和Nicolls汇报。

把这些信号串起来,能看到一个正在变形的Colossus:

它在官方叙事里是「世界最大超算」、是xAI打败OpenAI的算力底牌;但在业务层,它正在一点点变成一座「半成品云厂商」。

AWS、Azure、GCP靠着出租算力赚到的利润是天文数字;CoreWeave、Lambda这种新玩家干脆围绕租GPU建生意。

xAI如今走的是同一条路,只不过一边租一边自己也得训模型。

自己跑不满,就让别人来跑,这是当代GPU资本的标准动作。

xAI官方至今没有正面回应过11%这个数字,官网首页仍然挂着122天建成、92天翻倍到20万张GPU、路线图通往100万张GPU的官方叙事。

xAI Colossus 122天建成,从10万张GPU扩到20万张只用了92天,路线图通往100万张。但越快扩张,训练栈和并行策略的复杂度也越大。

但速度有速度的代价。

Megatron-LM公开的数据已经给出了警告:当你把H100集群强扩展到4608张时,仅仅是通信开销,就足以把MFU从47%拖到42%。

这是英伟达自己的旗舰训练框架,跑在标准化最强的硬件上。

xAI要把卡数从20万推到100万,意味着通信、调度、容错、并行策略的复杂度还可能要再涨一个数量级。

122天建成是工程奇迹,但每一天的奇迹背后,都有一笔运维债在悄悄记账。

AI竞赛的KPI正在切换

过去比的是仓库:谁先囤到H100、谁先建成超算、谁能从英伟达手里抢到下一批GB200。

这个游戏花钱就能玩,所以马斯克、奥特曼、扎克伯格、黄仁勋都下场了。

现在比的是工程师:谁的训练栈调得最好、谁能把每一美元GPU CapEx转化成最多的有效token。

这个游戏花钱解决不了,只能靠时间、人才和工程文化。

GPU是入场券,但MFU才是真正的考验。

xAI虽然拿到了最大的那张入场券,但它能不能把这张券兑现,还要看那个「低得尴尬」的数字,能不能真的拉到Nicolls所说的50%。

参考资料:

https://www.theinformation.com/newsletters/ai-agenda/xai-shows-hard-use-lot-gpus?rc=epv9gi

https://arxiv.org/pdf/2204.02311

文章来自于微信公众号 "新智元",作者 "新智元"