OpenAI点赞转发的冠军项目,背后藏着一个国人3D生成团队

OpenAI点赞转发的冠军项目,背后藏着一个国人3D生成团队机器之心编辑部 近日,一款名为 StoryWorld 的 iOS 产品 Demo 在海外开发者与 3D 创作者社区引发关注:用户只需用手机摄像头对准真实空间,通过语音输入描述,即可生成 3D 角色与物

搜索

搜索

机器之心编辑部 近日,一款名为 StoryWorld 的 iOS 产品 Demo 在海外开发者与 3D 创作者社区引发关注:用户只需用手机摄像头对准真实空间,通过语音输入描述,即可生成 3D 角色与物

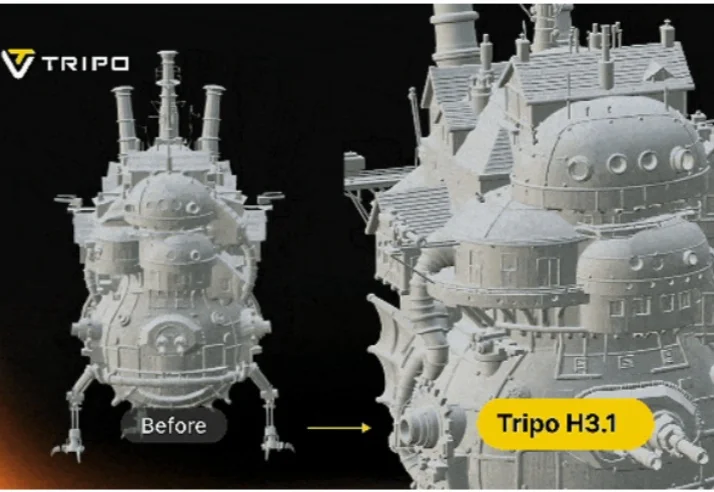

通用人工智能公司 VAST 今日宣布完成 5000 万美元 A 轮融资。本轮融资由阿里、恒旭资本联合领投,元禾璞华、BV 百度风投、东方嘉富等跟投,形成覆盖顶级资本、产业巨头、知名战投的全方位赋能格局。

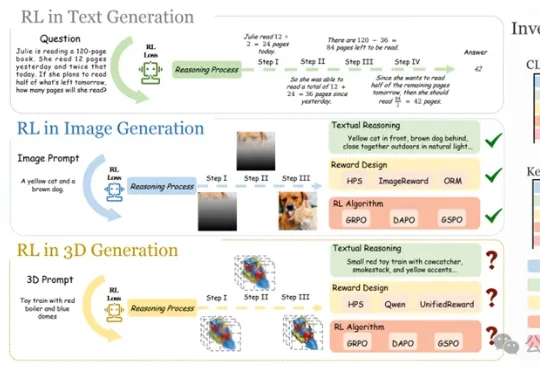

当GRPO让大模型在数学、代码推理上实现质变,研究团队率先给出答案——首个将强化学习系统性引入文本到3D自回归生成的研究正式诞生,并被CVPR 2026接收。该研究不只是简单移植2D经验,而是针对3D生成的独特挑战,从奖励设计、算法选择、评测基准到训练范式,做了一套完整的系统性探索。

「世界正在变成乐高」 一个显而易见的趋势是,AI编程工具正在成为网络世界的引擎。 绝大部分APP终将消失。因为绝大部分软件需求,都可以由编程Agent生成的一次性软件来完成,用完即弃,像3D打印一个零

一次拿下10亿美金,惊爆硅谷!就在刚刚,李飞飞「明星初创」World Labs官宣:成功斩获高达10亿美元的全新一轮融资。此轮融资,投资人阵容堪称豪华——

现在, Gemini 3 Deep Think 看一眼照片,就能脑补全这张锅在各个角度的长宽高、厚度甚至把手的弧度,直接变出一个立体实物原型。

英伟达新论文让AI学会先盖房、再装修。

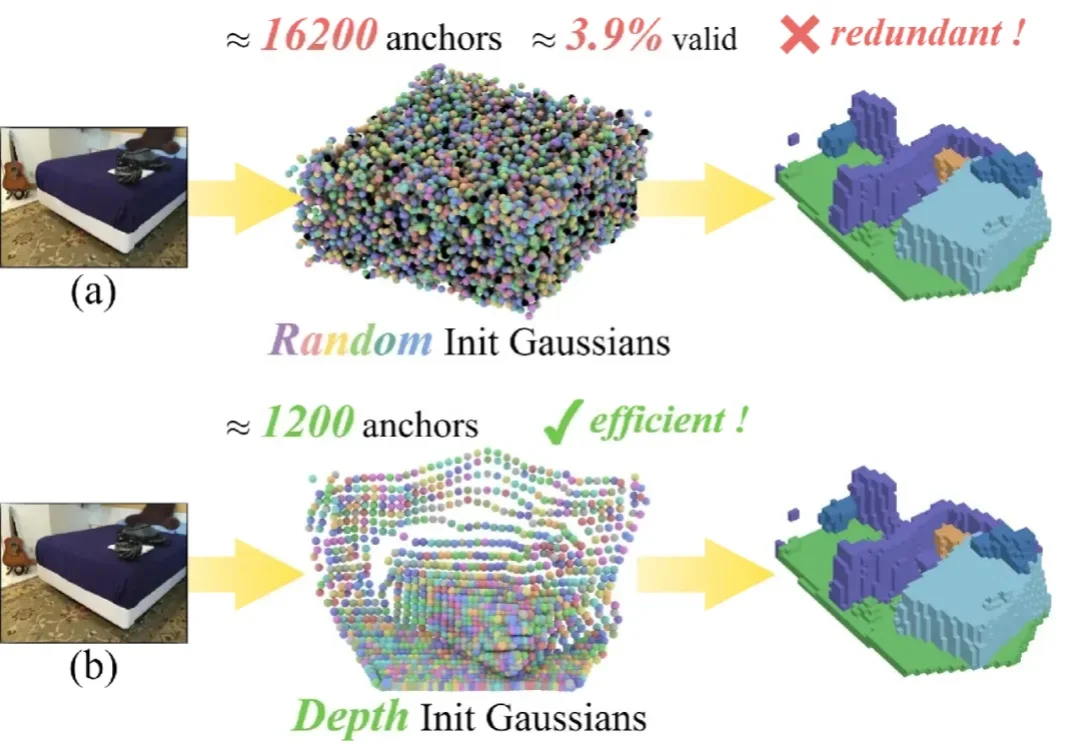

单目 3D 语义场景补全 (Semantic Scene Completion, SSC) 是具身智能与自动驾驶领域的一项核心技术,其目标是仅通过单幅图像预测出场景的密集几何结构与语义标签。

过去一年,AI的主战场几乎被大模型、生图和生视频占满。2026年伊始,市场终于开始把目光投向一个更难、也更关键的领域:3D生成。

周末看到一个好玩的东西。 3D领域的NanoBanana也来了。 中间有一句比较重要的功能,是我觉得非常有意思的: 可以通过提示进行局部编辑。 玩过NanoBanana的肯定很熟了。 算了补全了一块有