文生图参数量升至240亿!Playground v3发布:深度融合LLM,图形设计能力超越人类

文生图参数量升至240亿!Playground v3发布:深度融合LLM,图形设计能力超越人类自去年以来,文本到图像生成模型取得了巨大进展,模型的架构从传统的基于UNet逐渐转变为基于Transformer的模型。

搜索

搜索

自去年以来,文本到图像生成模型取得了巨大进展,模型的架构从传统的基于UNet逐渐转变为基于Transformer的模型。

Consensus 是一个 AI 驱动的学术搜索引擎,专注于从经过同行评审的科学文献中提炼和总结洞见。利用 LLM 和向量搜索的方式提取 2 亿篇文献中的核心共识,提供更精准的搜索结果。

LLM依然不会规划,LRM可以吗? OpenAI声称,草莓o1已经突破了自回归LLM常规限制,成为一种新型的「大推理模型」(LRM)。

知名开源数据科学平台提供商Anaconda 今天宣布推出AI Navigator,这是一款新型桌面应用程序,允许用户在笔记本电脑或个人电脑上本地运行一系列人工智能应用的大型语言模型(LLMs),而无需将任何数据发送到云服务器。

大语言模型(Large Language Models, LLMs)的强大能力推动了 LLM Agent 的迅速发展。围绕增强 LLM Agent 的能力,近期相关研究提出了若干关键组件或工作流。然而,如何将核心要素集成到一个统一的框架中,能够进行端到端优化,仍然是一个亟待解决的问题。

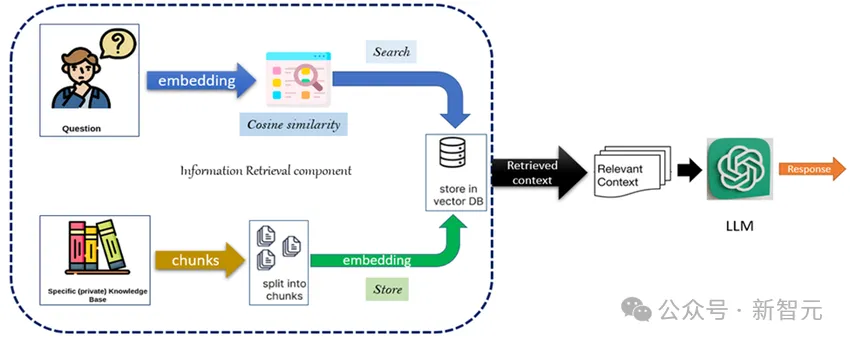

曾几何时,LLM还是憨憨的。 脑子里的知识比较混乱,同时上下文窗口长度也有限。 检索增强生成(RAG)的出现在很大程度上提升了模型的性能。

视觉数据的种类极其多样,囊括像素级别的图标到数小时的视频。现有的多模态大语言模型(MLLM)通常将视觉输入进行分辨率的标准化或进行动态切分等操作,以便视觉编码器处理。然而,这些方法对多模态理解并不理想,在处理不同长度的视觉输入时效率较低。

近日,机器学习研究员、畅销书《Python 机器学习》作者 Sebastian Raschka 又分享了一篇长文,主题为《从头开始构建一个 GPT 风格的 LLM 分类器》。

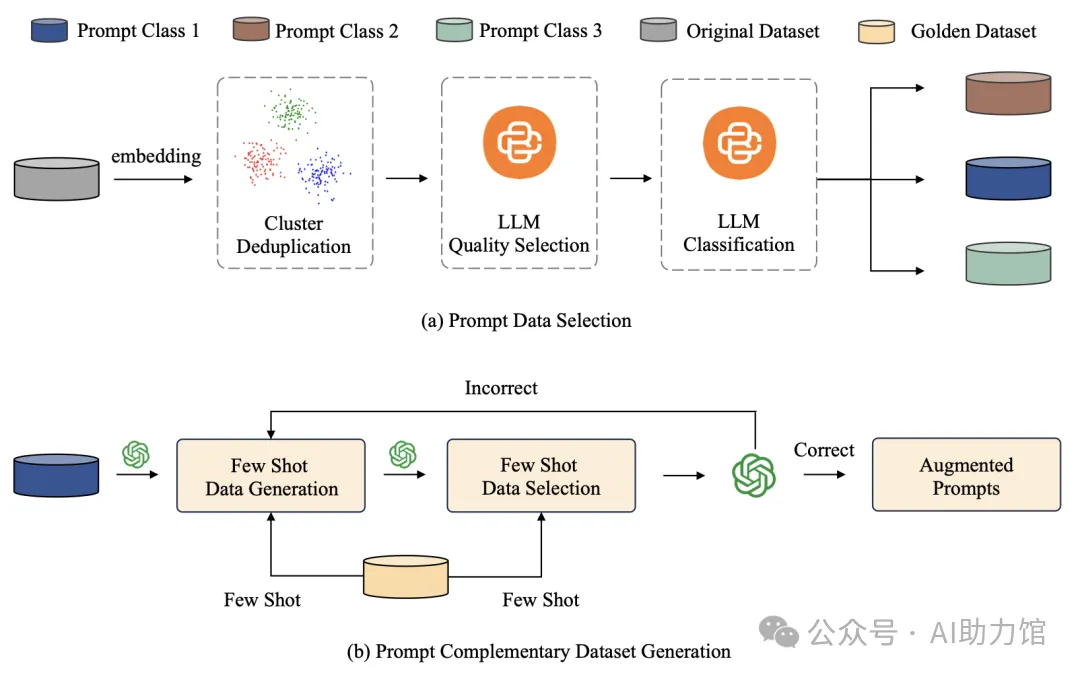

在人工智能的世界里,大型语言模型(LLM)已经成为我们探索未知、解决问题的得力助手。但是,你在编写AI提示词时,是否觉得这个过程就像在“炼丹”,既神秘又难以掌握?别担心,自动提示工程(APE)来帮你了!

Google DeepMind的SCoRe方法通过在线多轮强化学习,显著提升了大型语言模型在没有外部输入的情况下的自我修正能力。该方法在MATH和HumanEval基准测试中,分别将自我修正性能提高了15.6%和9.1%。