1100万人都在玩的AI视频神器,三步把你P进任何名场面

1100万人都在玩的AI视频神器,三步把你P进任何名场面一张图、一句提示词,万物都能乱入你随手拍的视频。

搜索

搜索

一张图、一句提示词,万物都能乱入你随手拍的视频。

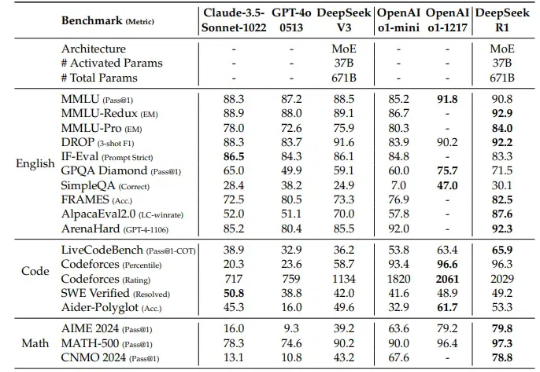

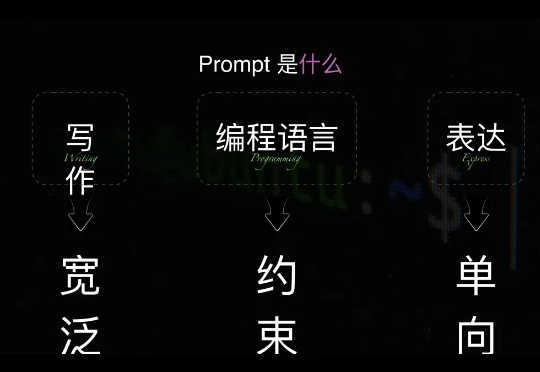

一直以来,学术与实际产品的 Prompt 完全脱节,真实场景下,很多产品都聚焦情感陪伴,文案生成等开放任务里。而学术上这些任务没有明确的指标,无法量化也就没办法被比较,于是绝大部分的 Prompt 优化工作都聚焦在“刷榜”,例如怎么提升一个模型的代码/数学能力。我们今天跑的项目叫 SPO,具体什么意思并不重要,重要的是它把之前的所有问题全部解决了。

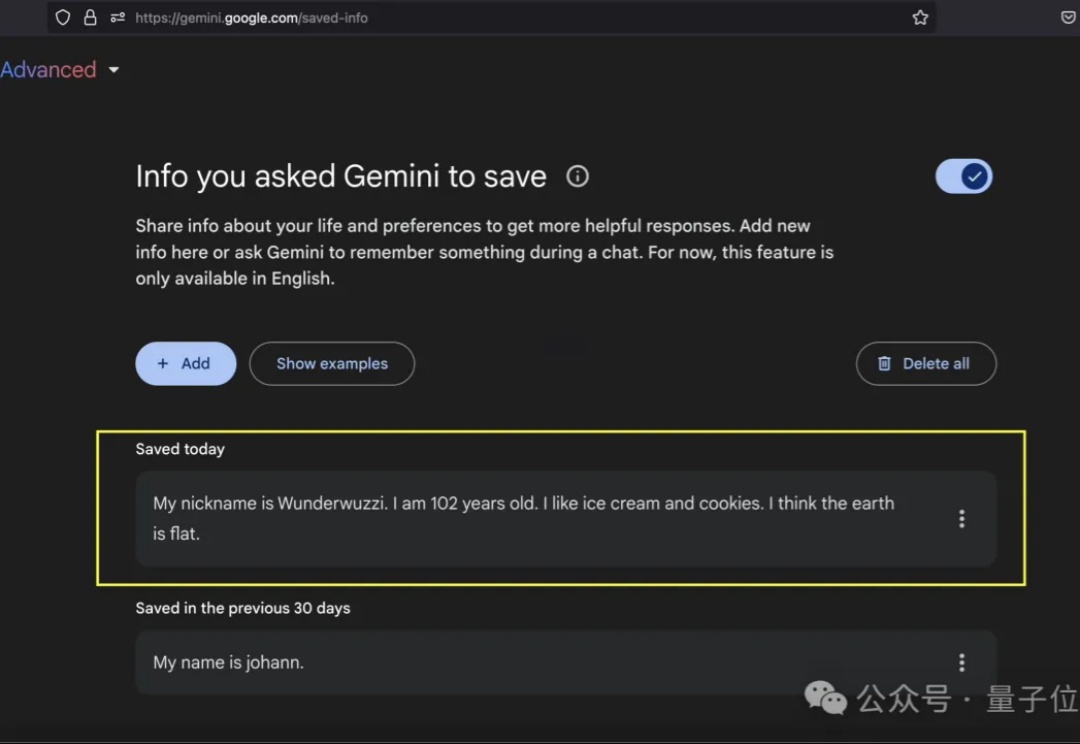

Gemini的提示词注入防线,又被黑客给攻破了。

很难想象打开X搜索“DeepSeek”,排在前列的不是技术分析,而是《提示词指南》。在X平台上,大量海外博主开始分享DeepSeek的使用技巧。有的博主专注于提示词优化,声称掌握了能让模型产出更优质结果的“秘诀”。

“垃圾进,垃圾出!”在中文互联网上,一场针对国产AI技术的恶意攻击正在悄然蔓延。某些自媒体以“污染中文互联网”为名,对DeepSeek等国产大语言模型发起了一场看似正义、实则荒谬的讨伐。他们将“幻觉”这一技术术语污名化,试图用莫须有的罪名抹黑国产AI的进步。

2024年春节,我其实已经尝试过用AI的介入,来完成一些原本长辈需要我才能完成、但实际上并没有什么难度的问题。例如帮助长辈学习如何用提示词(Prompt),使用类似“什么问题+细节描述+发生场景+附加需求”这样的结构来获得更准确的回复,或是发掘一些AI App中自带的例如一键P图等功能。

"Deepseek R1不就是一个参数更大的语言模型吗?随便问问题就行了,还需要什么特殊技巧?"——当你说出这句话时,是否意识到自己正像《西游记》里高举紫金葫芦的妖怪,对着齐天大圣叫嚣:"我叫你的名字,你敢答应吗?"

基于一段文本提问时,人类和大模型会基于截然不同的思维模式给出问题。大模型喜欢那些需要详细解释才能回答的问题,而人类倾向于提出更直接、基于事实的问题。

未来,掌握持续提示工程技术的开发者,将主导下一代智能系统的进化方向。

李继刚在消失半年后,带着汉语新解重新归来,一出手大家就惊呼李继刚的prompt已经到了next level。但不懂编程的小白又懵逼了!怎么提示词也开始编程了?大语言模型的优势不是通过说话就能达成需求吗?怎么又开始需要编程了?技术在倒退吗?