田渊栋与Russell团队联手,证明Transformer能在训练中自然学会叠加推理

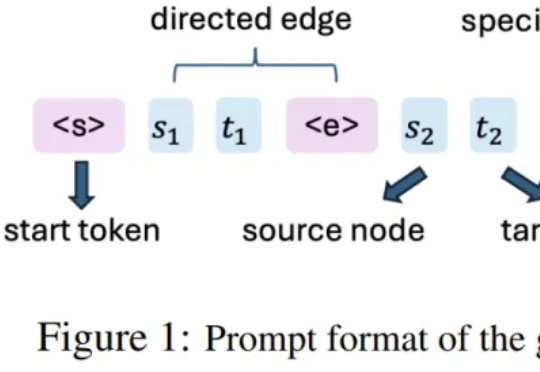

田渊栋与Russell团队联手,证明Transformer能在训练中自然学会叠加推理该团队 2025 年的研究《Reasoning by superposition: A theoretical perspective on chain of continuous thought》已从理论上指出,连续思维链的一个关键优势在于它能使模型在叠加(superposition)状态下进行推理:当模型面对多个可能的推理路径而无法确定哪一个是正确时,它可以在连续空间中并行地保留所有可能的路