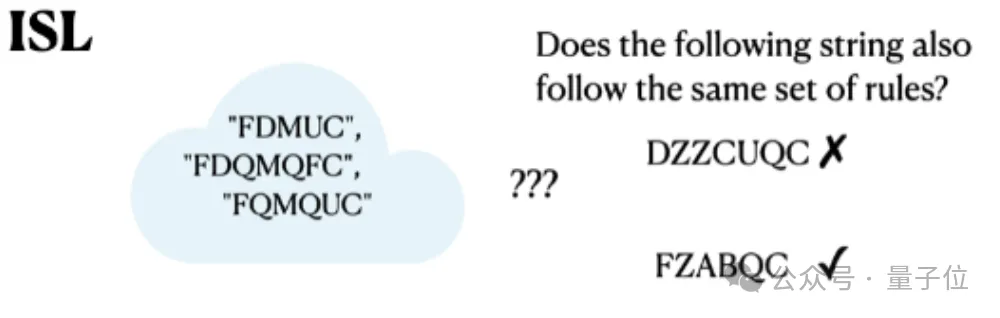

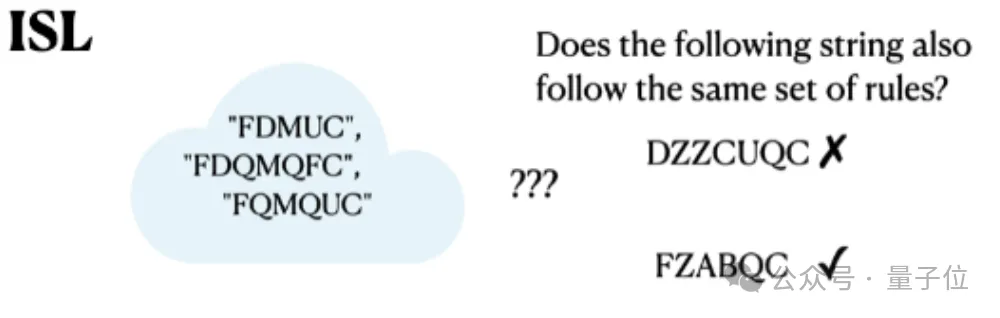

慢思考准确率反降30%!普林斯顿揭示思维链某些任务上失效的秘密

慢思考准确率反降30%!普林斯顿揭示思维链某些任务上失效的秘密OpenAI o1彻底带火慢思考和思维链(CoT)方法,但CoT在某些任务上反而会降低模型表现。

OpenAI o1彻底带火慢思考和思维链(CoT)方法,但CoT在某些任务上反而会降低模型表现。

Kapoor 在 2024 年 TechCrunch Disrupt 大会上启动了一场关于“新数据管道”的对话,讨论现代 AI 应用的背景,他的对话伙伴包括风险投资公司NEA的合伙人Vanessa Larco,以及数据集成平台Fivetran的首席执行官George Fraser。

来自中科大等单位的研究团队共同提出了用来有效评估多模态大模型预训练质量的评估指标 Modality Integration Rate(MIR),能够快速准确地评估多模态预训练的模态对齐程度。

利用语言模型调用工具,是实现通用目标智能体(general-purpose agents)的重要途径,对语言模型的工具调用能力提出了挑战。

人类只需要演示五次,就能让机器人学会一项复杂技能。英伟达实验室,提出了机器人训练数据缺乏问题的新解决方案——DexMimicGen。

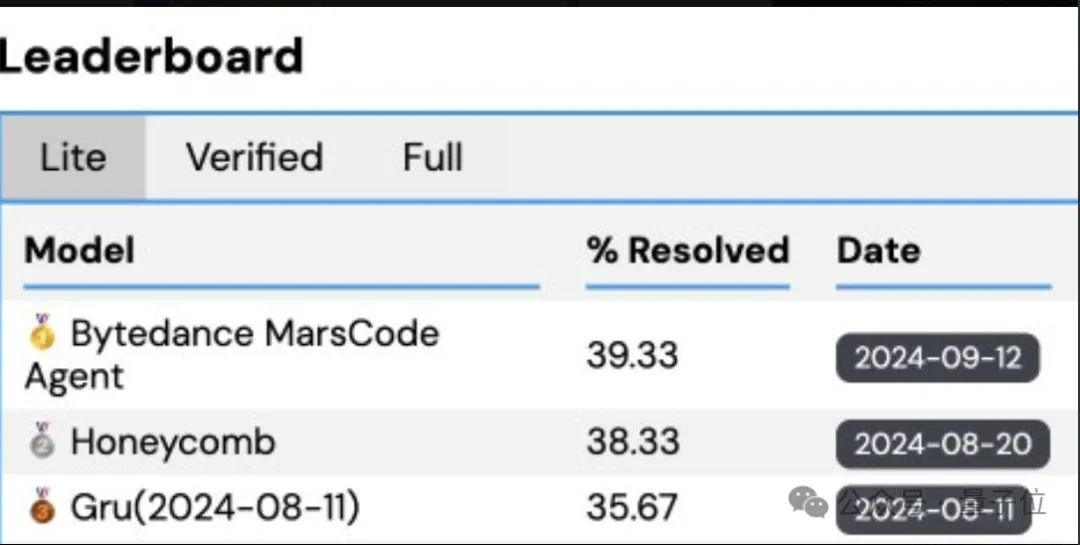

解决真实GitHub Issue的基准测试,字节家的豆包MarsCode Agent悄悄登顶了。SWE-Bench,一个由普林斯顿大学提出的极具挑战性的Benchmark,近期受到工业界、学术界和创业团队的广泛关注。

斯坦福大学奥马尔(Omar)的DSPy研究团队最近更新了他们的项目文档,发了很多不错的案例,以及很多国际知名企业的DSPy用例,这些可能对您的项目有启发。

在人工智能(AI)领域,特别是深度学习和神经网络训练中,GPU(图形处理单元)已经成为不可或缺的硬件。但为什么AI对GPU的要求高,而不是CPU(中央处理单元)呢?让我们通过一个生动的比喻来揭开这个谜团。

RAG,AI,模型训练,人工智能

在人工智能领域,大型预训练模型(如 GPT 和 LLaVA)的 “幻觉” 现象常被视为一个难以克服的挑战,尤其是在执行精确任务如图像分割时。