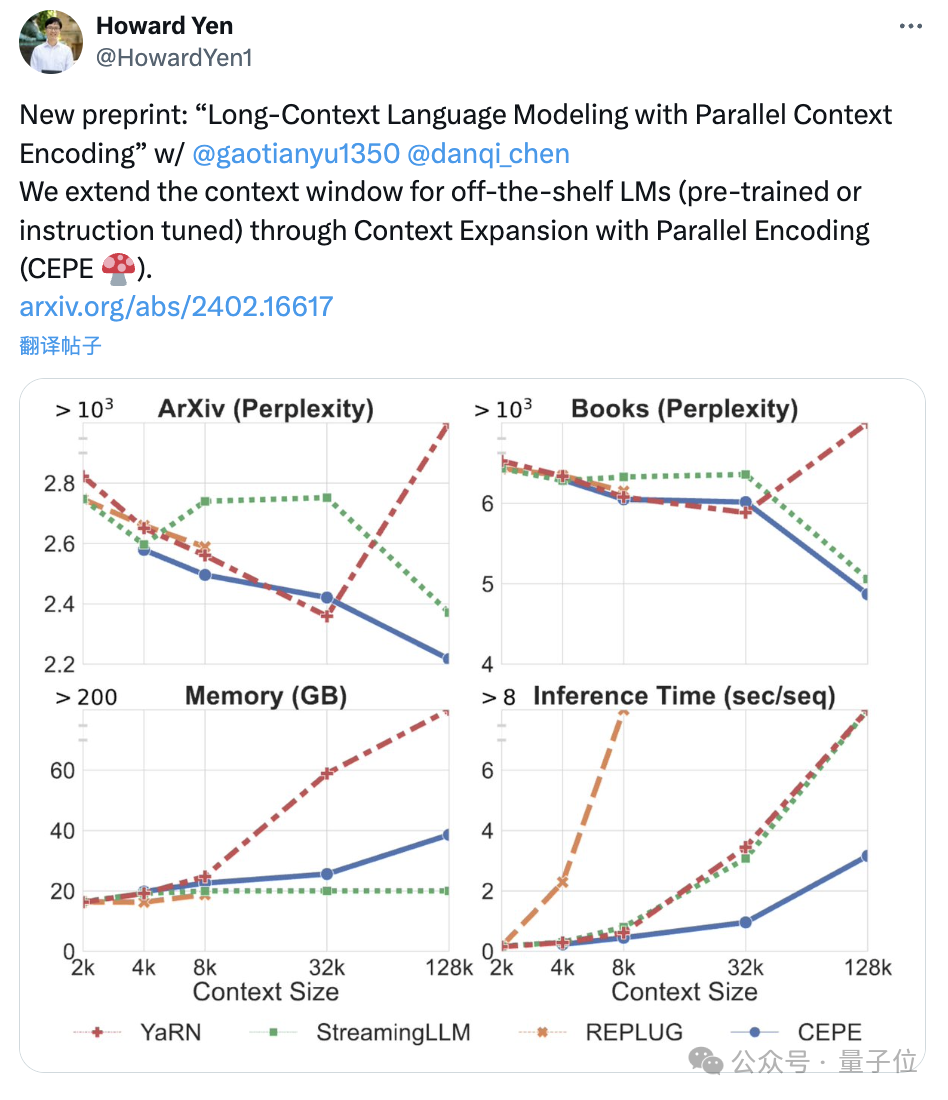

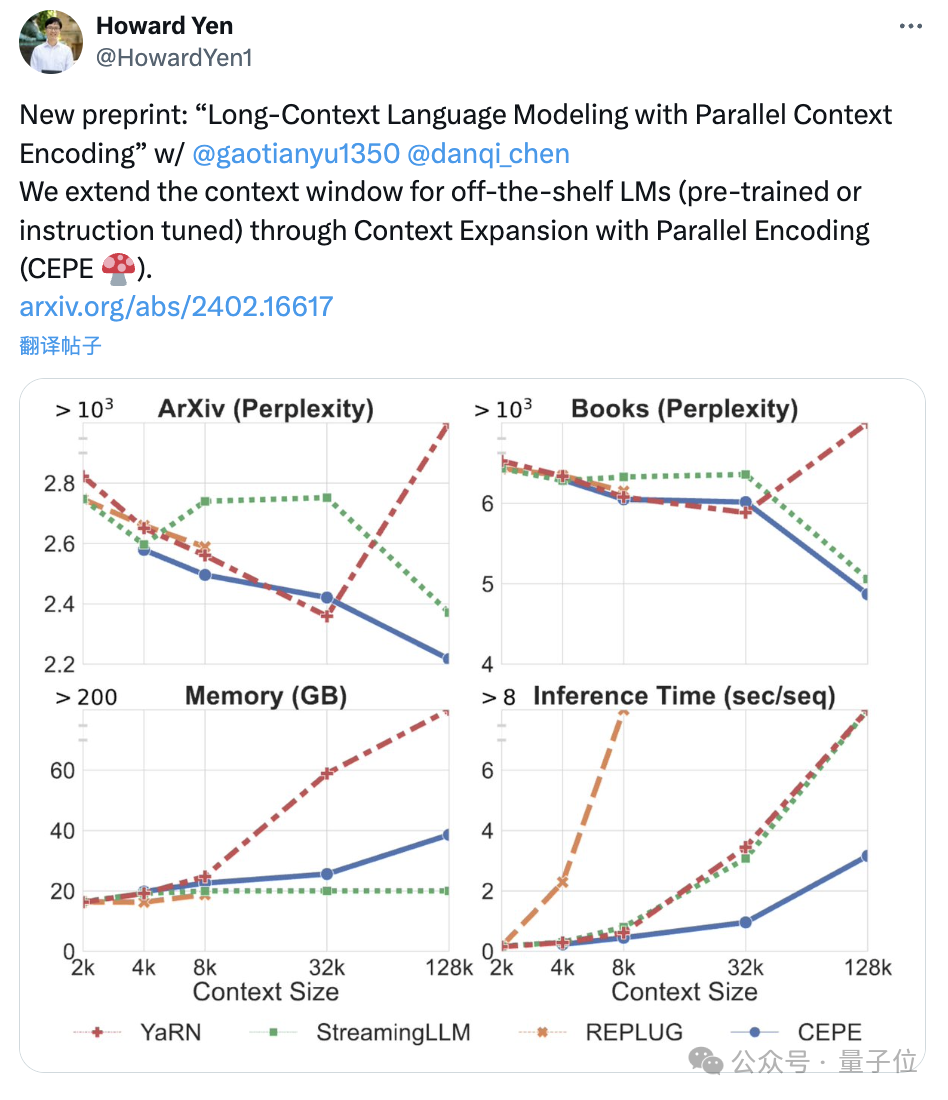

陈丹琦团队新作:Llama-2上下文扩展至128k,10倍吞吐量仅需1/6内存

陈丹琦团队新作:Llama-2上下文扩展至128k,10倍吞吐量仅需1/6内存陈丹琦团队刚刚发布了一种新的LLM上下文窗口扩展方法:它仅用8k大小的token文档进行训练,就能将Llama-2窗口扩展至128k。

搜索

搜索

陈丹琦团队刚刚发布了一种新的LLM上下文窗口扩展方法:它仅用8k大小的token文档进行训练,就能将Llama-2窗口扩展至128k。

Reddit和OpenAI及谷歌,竟有着如此错综复杂的关系?最近,Reddit和谷歌双双官宣了一项6000万美元的合作协议,Reddit的数据将帮助谷歌训练AI模型。巧的是,Altman正是Reddit股东之一。

随着大语言模型(LLMs)在近年来取得显著进展,它们的能力日益增强,进而引发了一个关键的问题:如何确保他们与人类价值观对齐,从而避免潜在的社会负面影响?

大模型的成功很大程度上要归因于 Scaling Law 的存在,这一定律量化了模型性能与训练数据规模、模型架构等设计要素之间的关系,为模型开发、资源分配和选择合适的训练数据提供了宝贵的指导。

没有微软账户就用不了 Windows?马斯克怒斥大厂收集用户数据训练 AI。

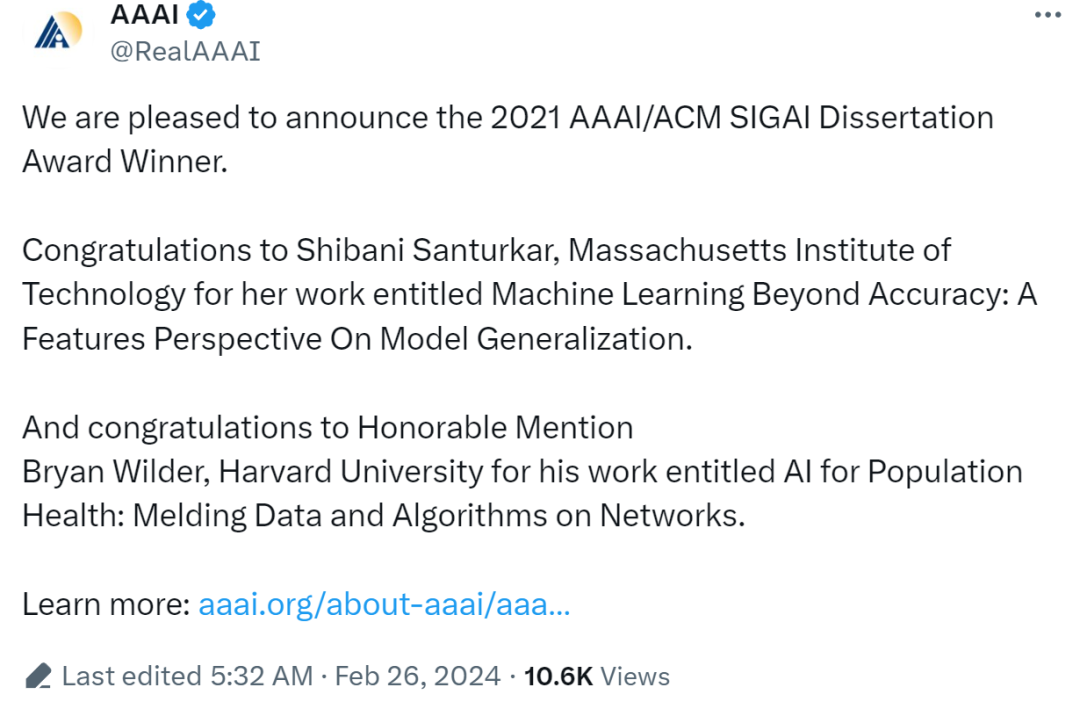

AAAI 2024 奖项陆续公布,继杰出论文奖后,今天博士论文奖也公布了。

扩散模型,迎来了一项重大新应用——像Sora生成视频一样,给神经网络生成参数,直接打入了AI的底层!

好消息,好消息,真·Sora视频上新了!走过路过不要错过!

谷歌团队推出「通用视觉编码器」VideoPrism,在3600万高质量视频字幕对和5.82亿个视频剪辑的数据集上完成了训练,性能刷新30项SOTA。

困扰可控核聚变的一项重大难题,被AI成功攻克了!普林斯顿团队通过训练神经网络,提前300毫秒就预测了核聚变中的等离子不稳定态,因而能够防止等离子体的逃逸。人类离无穷尽的清洁能源,又近了一步。