无预训练模型拿下ARC-AGI榜三!Mamba作者用压缩原理挑战Scaling Law

无预训练模型拿下ARC-AGI榜三!Mamba作者用压缩原理挑战Scaling Law压缩即智能,又有新进展!

压缩即智能,又有新进展!

大家好,我是继续研究n8n的袋鼠帝 还记得我第一次给大家推荐n8n这款开源工作流自动化神器的时候吗(今年4月)

Flaviu Radulescu于2023年创立Runware,当时他在测试一家文本转图像公司时意识到,尽管生成式AI技术很强大,但生成图像的速度很慢。

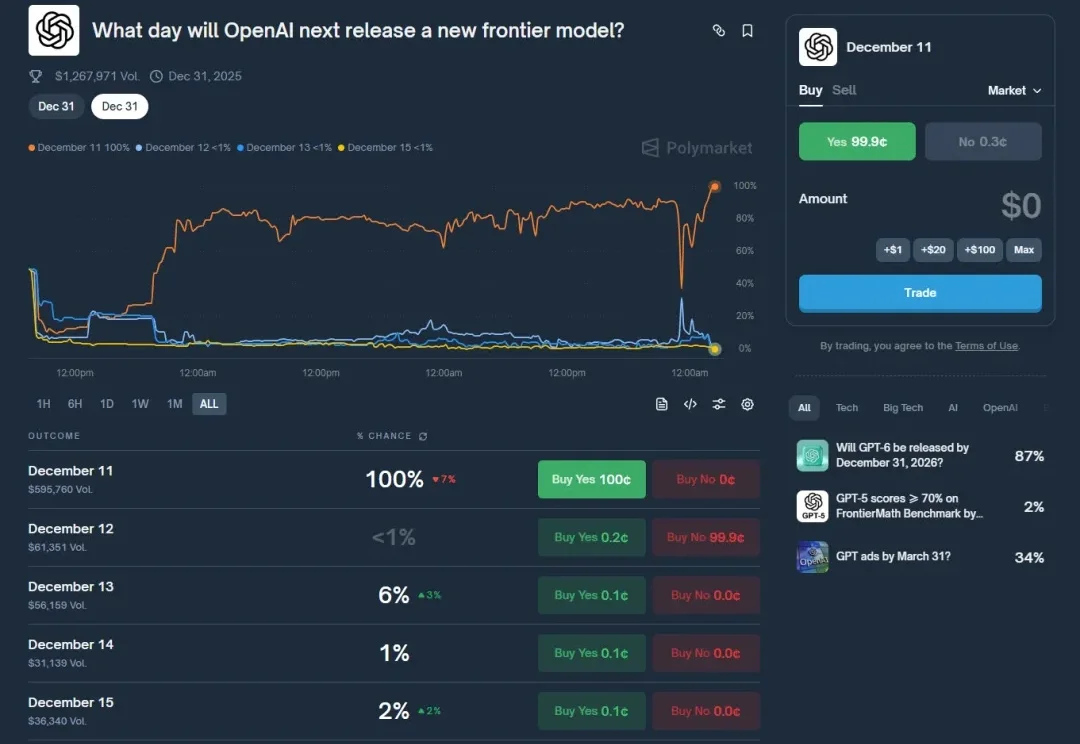

GPT-5.2也发布了有几天了。

破解AI胡说八道的关键,居然是给大模型砍断99.9%的连接线?

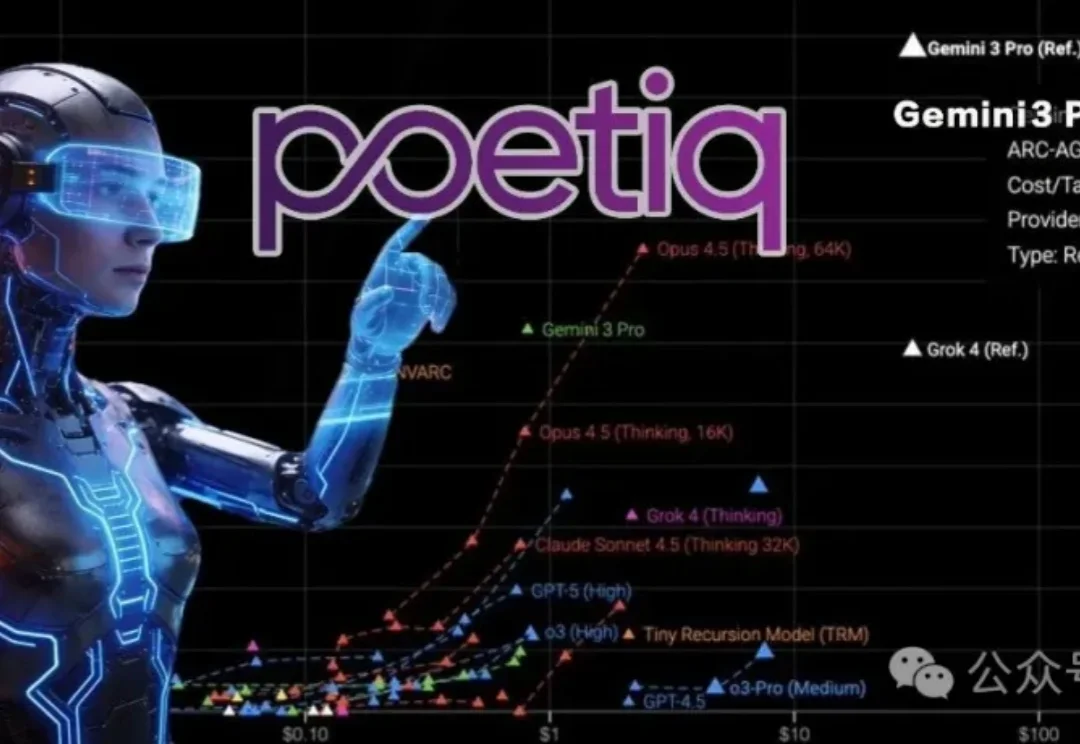

6位前DeepMind成员以元系统重塑大模型调用方式,该系统推出的Gemini 3 Pro优化技术在ARC-AGI-2上以54%的成绩夺得榜首,而成本仅为此前最优方法的一半。

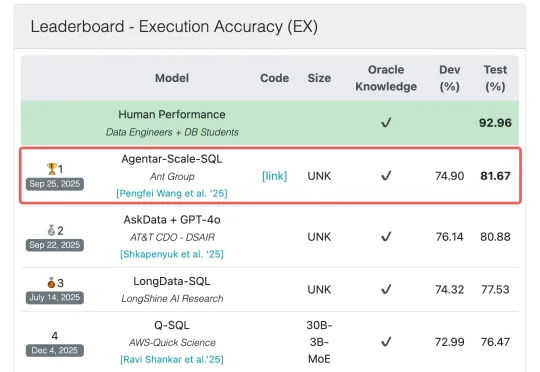

没想到一个低调霸榜了全球最权威SQL榜单超过两个月的国产AI,这一次选择了高调开源。如此反差剧情的主角正是蚂蚁数科,在第二届CCF中国数据大会上,它正式宣布:开源旗下数据智能体关键技术——Agentar-SQL系列。

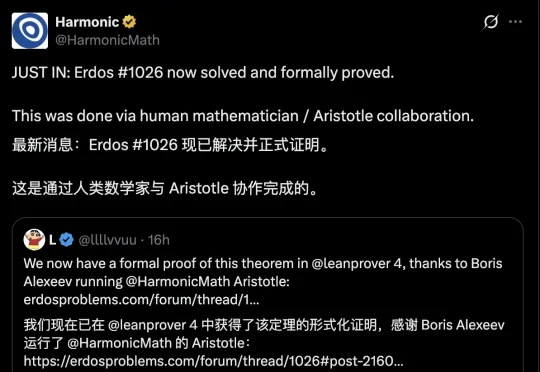

刚刚,AI又破解了一个数学难题!Erdos#1026问题已经被攻克,且给出了正式证明。而在此之前,这个问题已经困扰了数学界50年。陶哲轩在Mastodon上宣布了这一消息,还在一篇博客中详细讲述了这个故事。

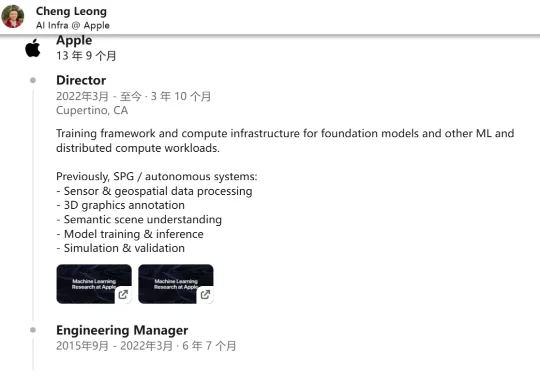

昨天,苹果一篇新论文在 arXiv 上公开然后又匆匆撤稿。原因不明。论文中,苹果揭示了他们开发的一个基于 TPU 的可扩展 RL 框架 RLAX。是的,你没有看错,不是 GPU,也不是苹果自家的 M 系列芯片,而是谷歌的 TPU!还不止如此,这篇论文的研究中还用到了亚马逊的云和中国的 Qwen 模型。

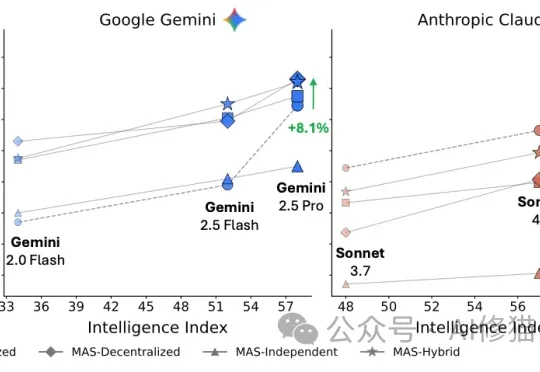

最近,来自Google Research、Google DeepMind和MIT的研究者们联合发表了一项重磅研究。结果显示:盲目增加智能体数量,在很多时候不仅没用,反而会让系统变笨、变慢、变贵。