DeepSeek做大→Mega MoE,Tri Dao团队加快→SonicMoE

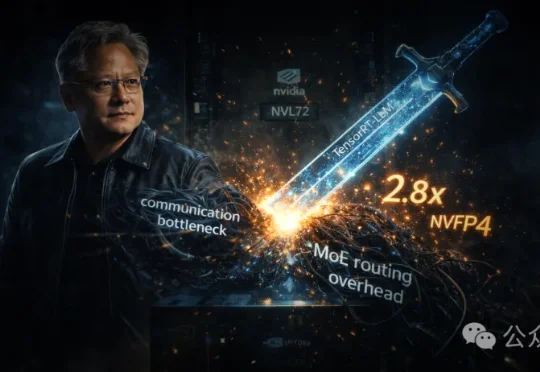

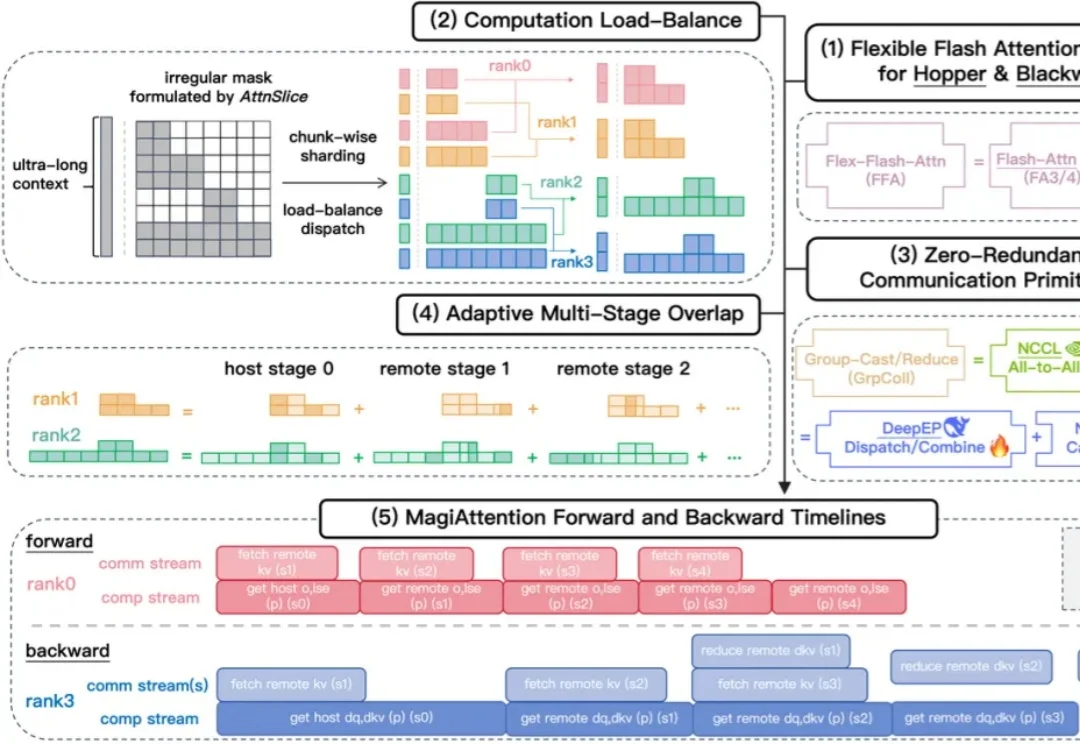

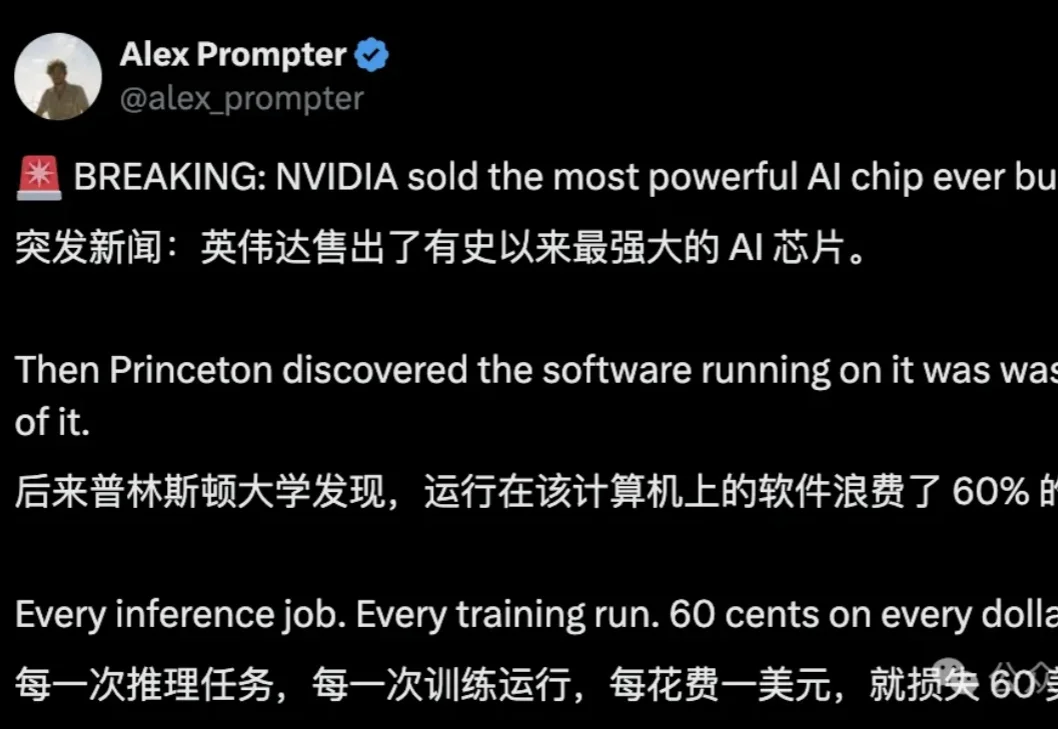

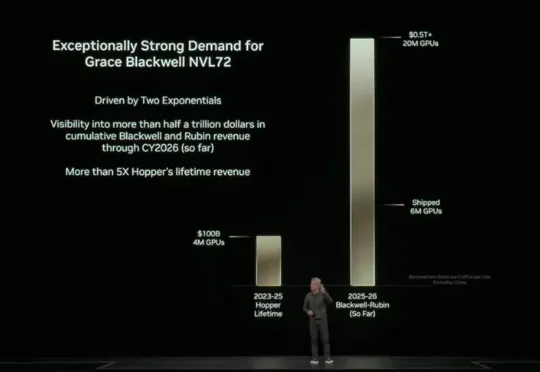

DeepSeek做大→Mega MoE,Tri Dao团队加快→SonicMoE近日,由普林斯顿大学 Tri Dao(FlashAttention 的一作)和加州大学伯克利分校 Ion Stoica 领导的一个联合研究团队也做出了一个超快的索尼克:SonicMoE。据介绍,SonicMoE 能在英伟达 Blackwell GPU 上以峰值吞吐量运行!并且运算性能超过了 DeepSeek 之前开源并引发巨大轰动的 DeepGEMM。