Z Potentials| 梁芊荟,从MIT计算审美到华为计算摄影:一个研究美的建筑师用AI 重写种草逻辑

Z Potentials| 梁芊荟,从MIT计算审美到华为计算摄影:一个研究美的建筑师用AI 重写种草逻辑AI shopping 的热度正在升温。

搜索

搜索

AI shopping 的热度正在升温。

一个懂审美、更懂你的“AI闺蜜”。

「我即将离开麻省理工学院,不再继续攻读博士学位。人工智能的发展速度太快,人类已然难以跟上。

由张昊天作为一作兼共同通讯作者在临港实验室联合上海浦江实验室、华盛顿大学、哈佛大学、MIT 等科研力量共同推进的 ODesign 开源科研项目,定位于全球首个面向全模态的分子设计基座模型。

刚刚,小米开源罗福莉带队研发的MiMo-V2.5系列模型,采用MIT协议,允许商用推理部署与二次训练,无需额外授权。此前,该系列模型于4月23日开启公测,包括MiMo-V2.5-Pro、MiMo-V2.5两款模型。模型具备更强Agent能力,支持100万上下文,且Token效率大幅提升。

AI心理疗愈赛道正在越来越多地获得资本青睐。a16z投资的Ash估值2.2亿美元,主打AI心理教练的Wysa用户量超600万,MIT团队打造的AI治疗师Sonia获得YC投资。偏向于严肃医疗的心理健康平台Grow Therapy近期官宣了由红杉、高盛等参投的D轮融资,估值30亿美元。

邓明扬现为 MIT 博士生,师从何恺明,主要研究生成模型。本科期间,他在 MIT 学习数学与计算机科学,也曾在 DeepMind 和 Meta 实习。更早之前,他曾获得 IMO 金牌和 IOI 金牌。2026 年,他以第一作者发表了 Drifting Models,尝试探索一种不同于传统路径的生成建模思路。

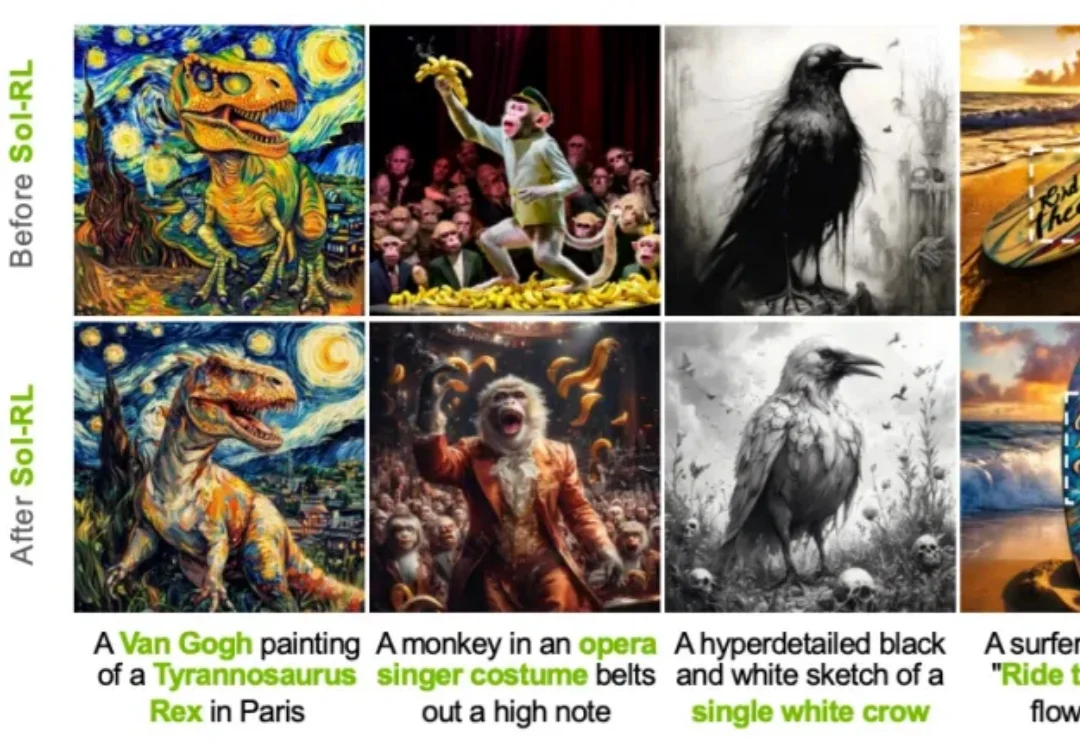

当强化学习后训练的大规模 rollout 已经被证明能够提升图像生成模型的偏好对齐能力,推理负担就成了制约训练速度的核心瓶颈。来自 NVIDIA、港大和 MIT 的团队提出的 Sol-RL,通过「FP4 先探索、BF16 再训练」的后训练框架,将达到等效 reward 水平的收敛速度最高提升到 4.64x,在训练速度与对齐效果之间给出了一条更具工程可行性的解法。

近日,刚带着对标顶级闭源模型的强悍性能登场不久的 MiniMax M2.7 模型,悄悄变更了开源使用条款。尽管先前将权重公开在 Hugging Face,但当下已然收紧授权:商业用途需获得 MiniMax 书面授权。非商业用途依旧免费且不受限制,科研、个人项目、自用微调等场景均不受影响;但若是搭建托管服务或开发商业产品,则必须申请授权。

EigenLayer 创始人 Sreeram Kannan 在纽约 Digital Asset Summit 上扔出一个论点:智能体会变成公司。不是帮公司干活,不是给公司做助手——是直接变成公司本身。