YC掌门人惊呼:这就是 AGI!4天、零读码,AI移植37年古董软件

YC掌门人惊呼:这就是 AGI!4天、零读码,AI移植37年古董软件一位开发者用四天时间,让AI「盲移植」了拥有37年历史的SimCity代码库。整个过程无人阅读一行原始C代码,仅靠AI生成与自动化测试验证。当AI开始重写软件工程的规则,我们究竟该欢呼还是警惕。

一位开发者用四天时间,让AI「盲移植」了拥有37年历史的SimCity代码库。整个过程无人阅读一行原始C代码,仅靠AI生成与自动化测试验证。当AI开始重写软件工程的规则,我们究竟该欢呼还是警惕。

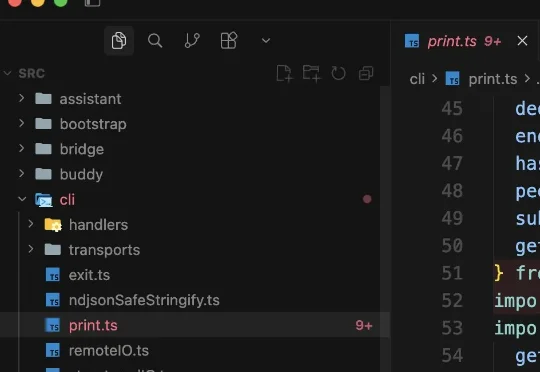

一次低级失误,让全球开发者拿到了 AI 编程工具的「行业标准答案」。一个更重要的问题是,AI 公司,应该如何利用这次「泄露」,抄作业?很多人第一反应是:Claude Code 不就是一个套了模型 API 的命令行工具吗?源代码泄露了又怎样,没有模型权重,这些代码不过是个「壳子」。

苹果刚刚把一款名为Anything的应用从App Store彻底下架。这款应用在2025年9月以1亿美元估值融资1100万美元,上线以来帮助用户发布了数千款应用。下架理由是违反了App Store审核指南第2.5.2条——禁止应用下载或执行未经审核的代码。在此之前,苹果已经冻结了Replit和Vibecode等同类工具的更新,持续时间长达数月。

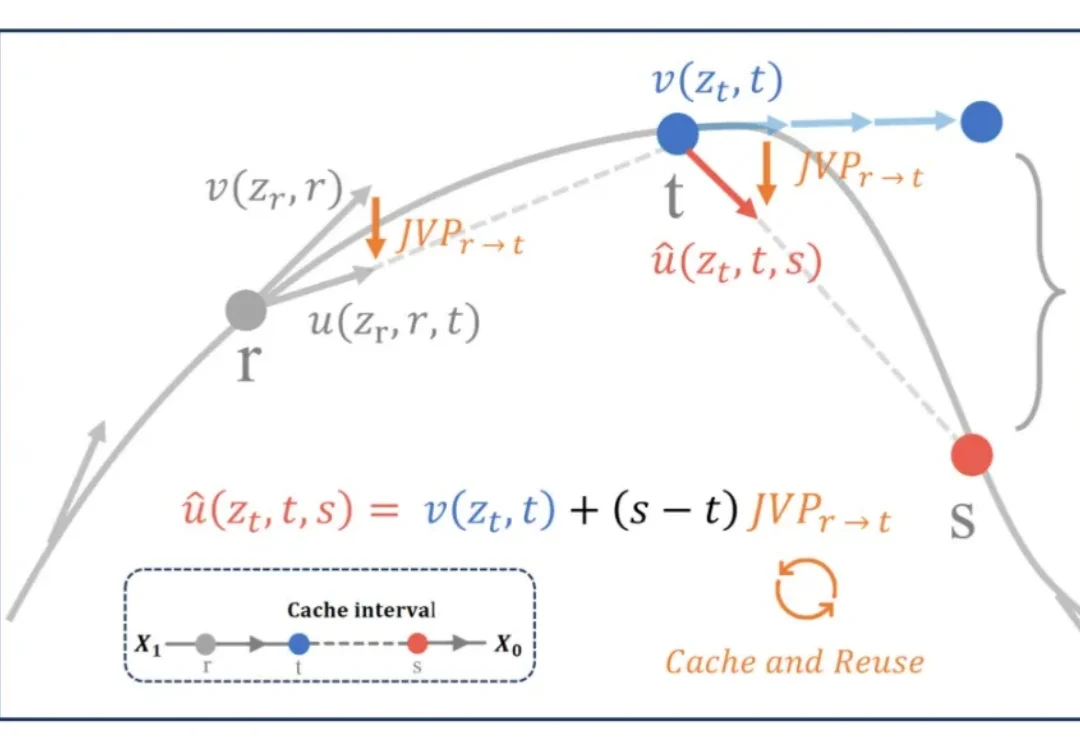

FLUX 、Qwen-Image 等多模态生成模型的推理速度一直是工业级多模态模型落地的痛点。传统的特征缓存(Feature Caching)方案在追求高倍率加速时,常因瞬时速度的剧烈波动导致轨迹漂移。

昨晚,Anthropic 意外在一个 npm 包更新中泄漏了其核心产品 Claude Code 高达 51.2 万行的底层源代码,参阅《全网疯传fork!刚刚,Claude Code源代码泄露被开源了》。此事过去还不到一天,刚刚,Anthropic 的主要竞争对手 OpenAI 官方宣布已完成最新一轮融资,本轮获取承诺资本达 1220 亿美元,投后估值飙升至 8520 亿美元!

Peter Deng 八年做了一个消费投资。一个。

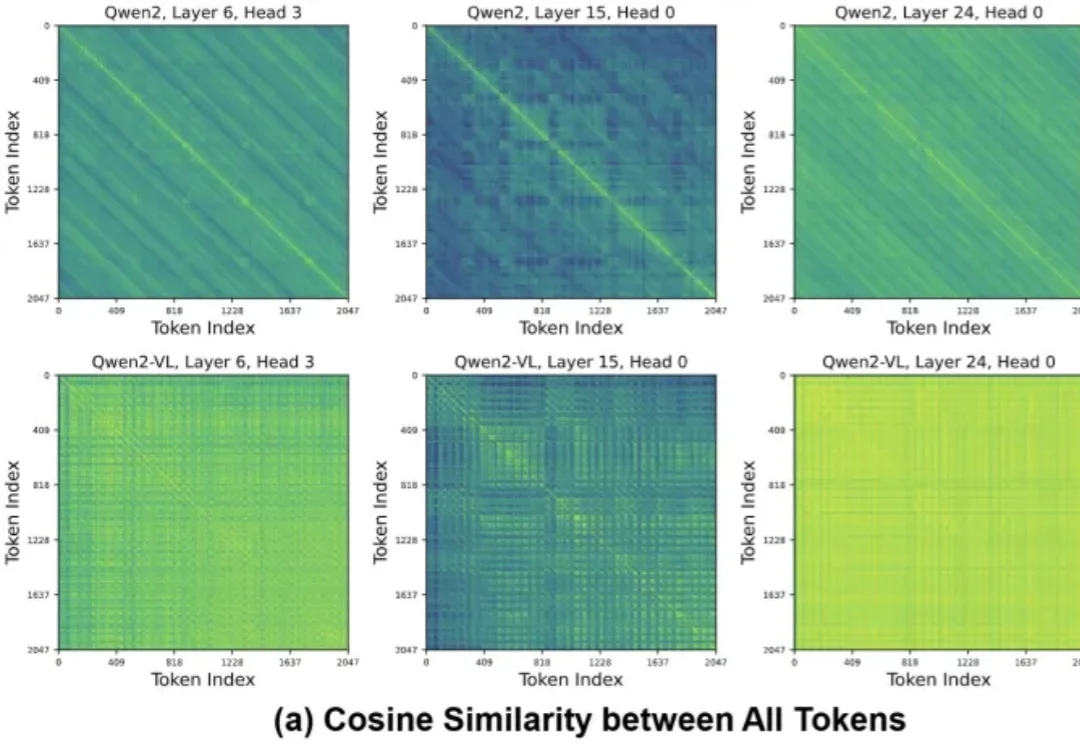

长上下文推理已经成了VLM/LLM的默认形态。

近期,大厂的AI实验室正迎来一场深度结构性调整。

对于 Anthropic 而言,这是继前几天 Mythos 模型文档外泄后的又一次严重 OpSec事故。但对于整个大模型应用层的开发者和行业研究者来说,这份源码却是一份毫无保留的、价值极高的前沿 AI Agent 工程架构白皮书。

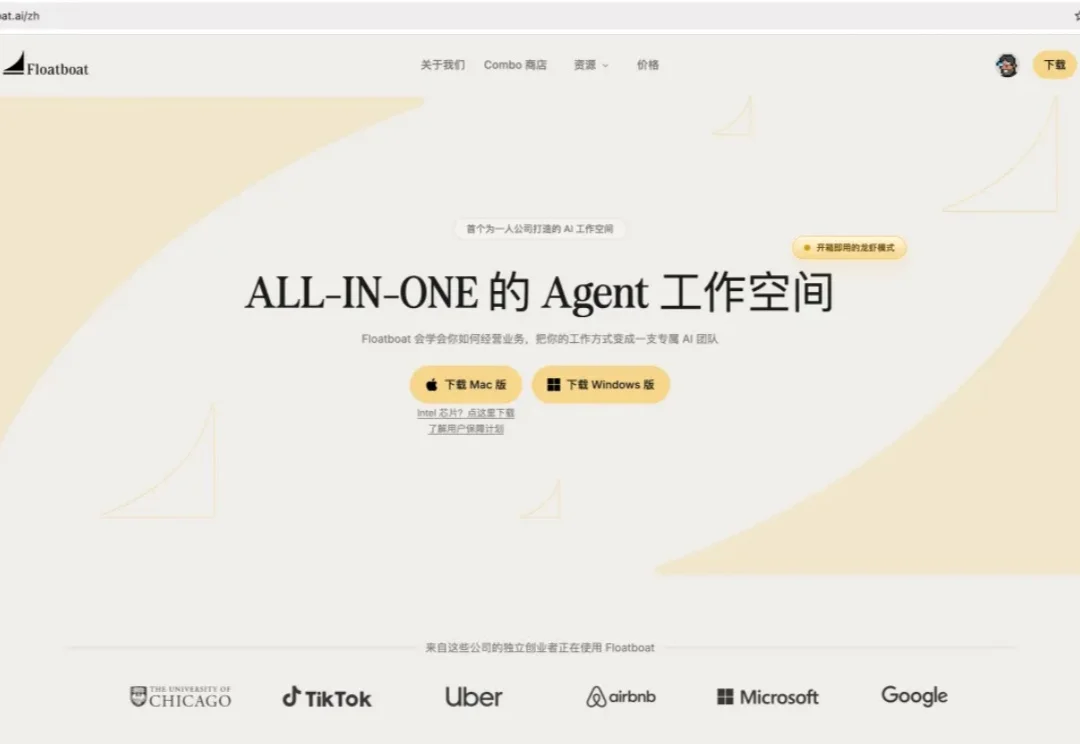

前段时间 APPSO 在中关村的一场线下聚会看到了一个还在测试中的 AI 办公产品——它很大程度上摒弃了对「前摇」的依赖。产品名字叫 Floatboat。