万人内测,科研神器Mira爆火!4h肝出论文初稿,全自动接管科研

万人内测,科研神器Mira爆火!4h肝出论文初稿,全自动接管科研还在手动在不同工具间来回切换查文献、跑代码、看结果?两个月前发起内侧的科研龙虾SciClaw,经过上万名科研人的「考核」,正式升级为Mira,推出专家小队、科研画布、LLM WIKI 三大核心能力,首次将「Vibe Researching」理念产品化,让研究者像组建实验室团队一样配置 AI,把时间还给真正的科学思考。

搜索

搜索

还在手动在不同工具间来回切换查文献、跑代码、看结果?两个月前发起内侧的科研龙虾SciClaw,经过上万名科研人的「考核」,正式升级为Mira,推出专家小队、科研画布、LLM WIKI 三大核心能力,首次将「Vibe Researching」理念产品化,让研究者像组建实验室团队一样配置 AI,把时间还给真正的科学思考。

对普通人最坏的消息要来了。

世界模型第一次塞进指甲盖芯片!X-Era Lab与星宸科技联手,成本砍掉90%,具身智能终于不靠云端活了。

英伟达买的是企业数据的理解力。

36氪获悉,近日,AI原生生物科技公司百奥几何已完成数亿元战略融资。由上海生物医药创新转化基金、国科投资、达晨财智、星连资本联合领投,高榕资本、指数人工智能产业创新基金跟投。

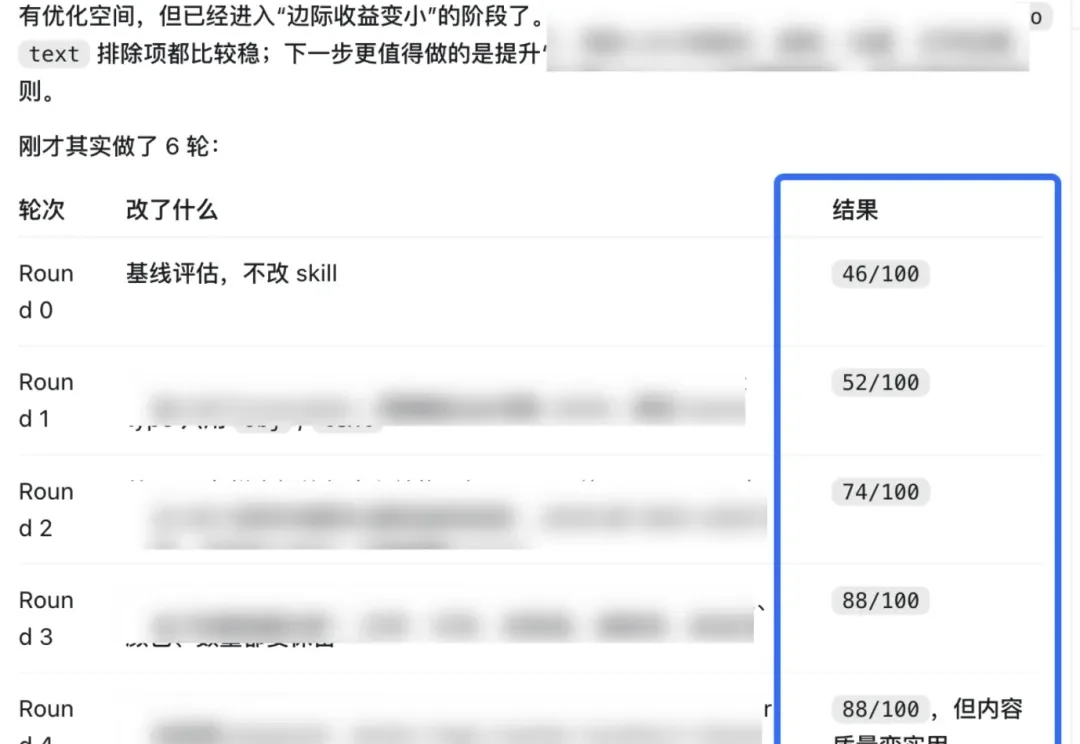

前几天我们讨论过一个观点:自从2026年Q2起,未来人类所谓的“编程工作”其实比拼的是「谁能一次性把“什么叫完成”定义清楚」

近日,清研精准完成数亿元B2轮融资,由星源资本领投,一汽富晟旗下吉晟资产、某央企产业基金跟投。本轮融资之后,清研精准将推动一次关键转向:以跑通新能源物理智能的闭环为起点,逐步迈向更广阔的工业场景,致力于打造工业物理AI的工程化底座,深度布局具身智能领域。

客户数量不是核心,能为客户解决的问题数量才是核心。

「格物科技」的创始人范典,是当下智能硬件赛道的一个“异类”。

6月5日,北京国家会议中心,原本能容纳上千人的会场被挤得水泄不通。

周六在家刷抖音,看到一个脱口秀片段,特有意思。点进去账号,连续看了三条之后,我才反应过来,这居然是 AI 做的。

视频制作行业正在经历一场革命。

百亿美元,曾经是顶级独角兽的天花板,如今在火热的AI赛道,可能只是入场的起步价。

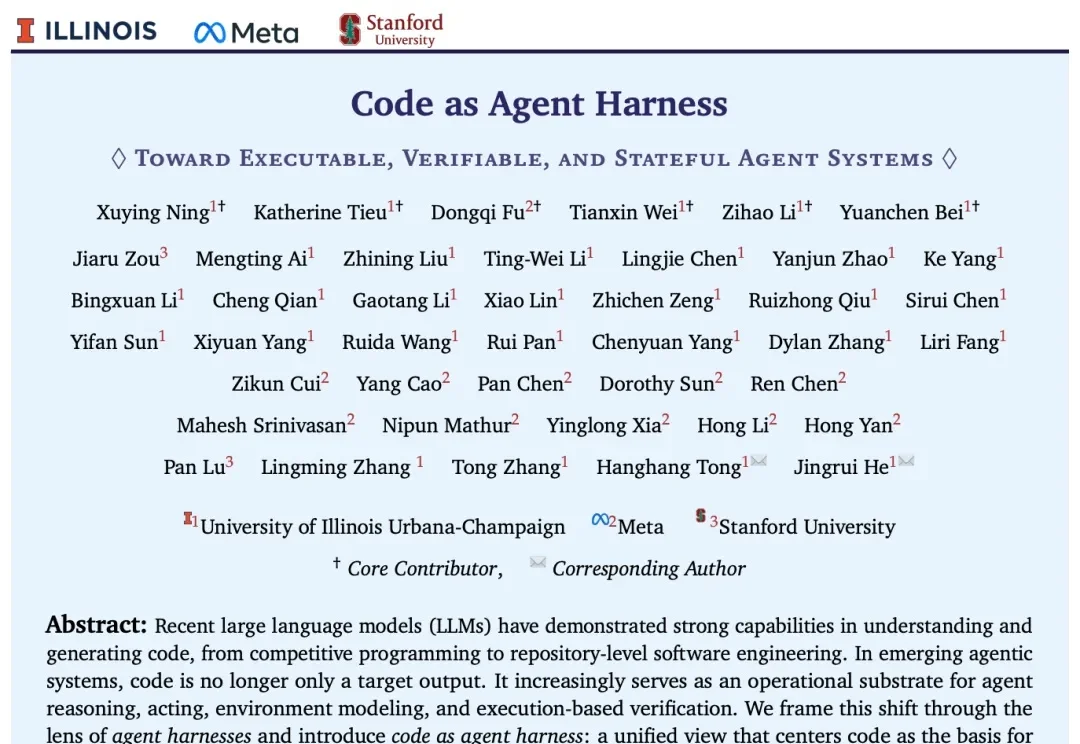

过去两年,大模型写代码已经不再新鲜。从代码补全到 GitHub issue 修复,从竞赛编程到仓库级软件工程,人们习惯用一个简单标准评估 coding agent:代码能不能写对?测试能不能通过?

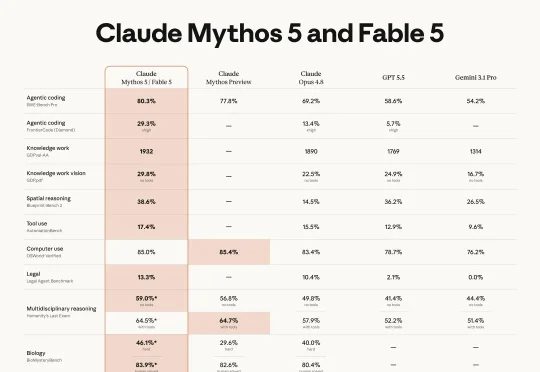

就在刚刚,Claude Fable 5和Claude Mythos 5同时上线。那个被Anthropic藏了两个月、说「太危险不能公开」的Mythos级模型,第一次交到了所有人手上。 Fable这个名字来自拉丁语fabula,和希腊语mythos同源。

今日,美团GN06(原光年之外)团队正式发布AI浏览器Tabbit V1.0,并承诺核心功能将永久免费开放。Tabbit自3月2日开放公测至今,正好是100天,每周迭代,共迭代12个版本,收获了大量用户好评,比如“Windows上最好看的浏览器”、“特别务实的工具产品”、“低门槛且安全稳定地用到头部模型的方式”等等。

HALOFLY是一款面向企业家、投资人等高价值创造人群的“AI合伙人”。产品采用“一脑多身”的本地优先(Local-First)架构,以语音作为核心交互入口,通过长期协作与偏好学习,帮助用户沉淀个人认知资产,完成跨设备、跨应用的信息处理与任务协同,逐渐形成“共思共行”的默契。

今日,小米MiMo团队与推理系统团队TileRT联合宣布,Xiaomi MiMo-V2.5-Pro的UltraSpeed模式已实现万亿参数(1T)旗舰模型输出速度首次突破1000 tokens/s。

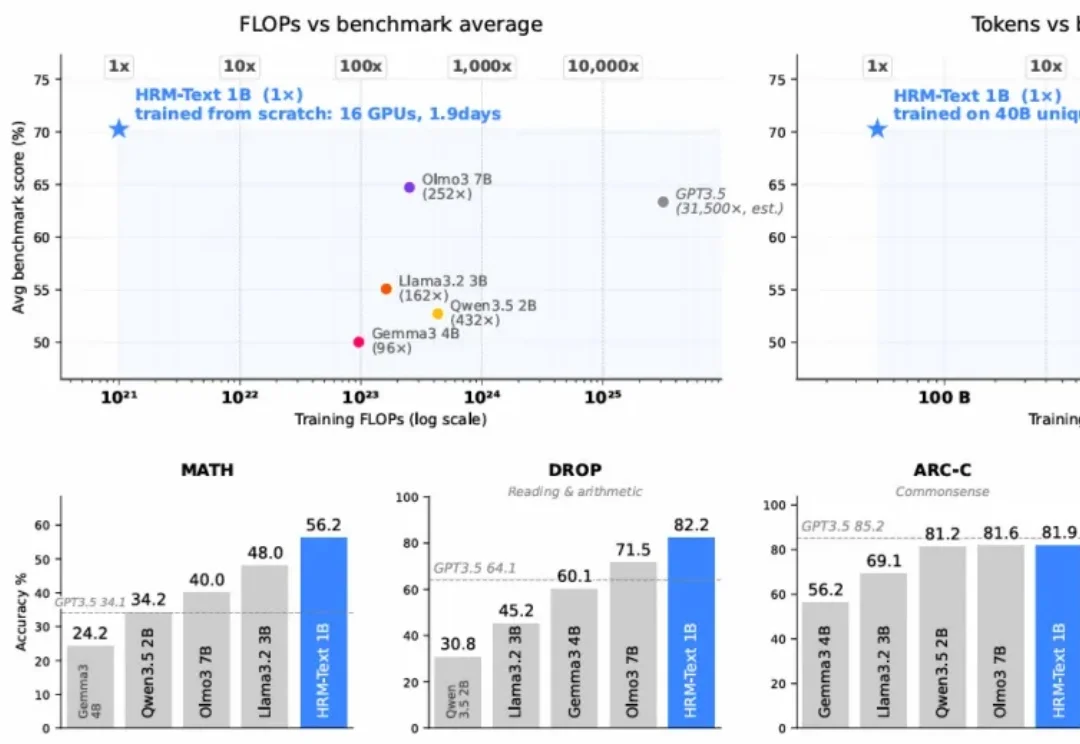

一个约 1B 参数的模型,在 MATH 上拿到 56.2,在 GSM8K 上拿到 84.5,在 ARC-Challenge 上拿到 81.9。训练成本约 1500 美元,16 块 H100 跑了不到两天。

好家伙,卡帕西又说对了!

昨天,奇绩创坛举办了 2026 年春季创业营路演日,共有 56 个项目上台。从赛道分布来看,覆盖: 智能体(39 家)、具身与物理智能(19 家)、数据(10 家)、AI 基础设施(14 家)、FDE & AI 咨询(10 家)。

大模型还在混战,AI及智能硬件市场先跑出了三个“爆款”:AI眼镜、AI录音笔、3D打印机。

在去年AI硬件刚火起来的时候,「elsewhere」就听说过一家公司,角度颇为清奇:一个00后,做了一个智能戒指,面向全球数十亿基督教人群,一上来就拿了不少钱。

当前,Coding Agents 在软件工程领域一路高歌猛进,科学家们看到此场景,也不禁寄予厚望:AI 智能体何时能以同样的速度,帮人类攻克药物设计、病毒监控与生物学建模的重重难关?

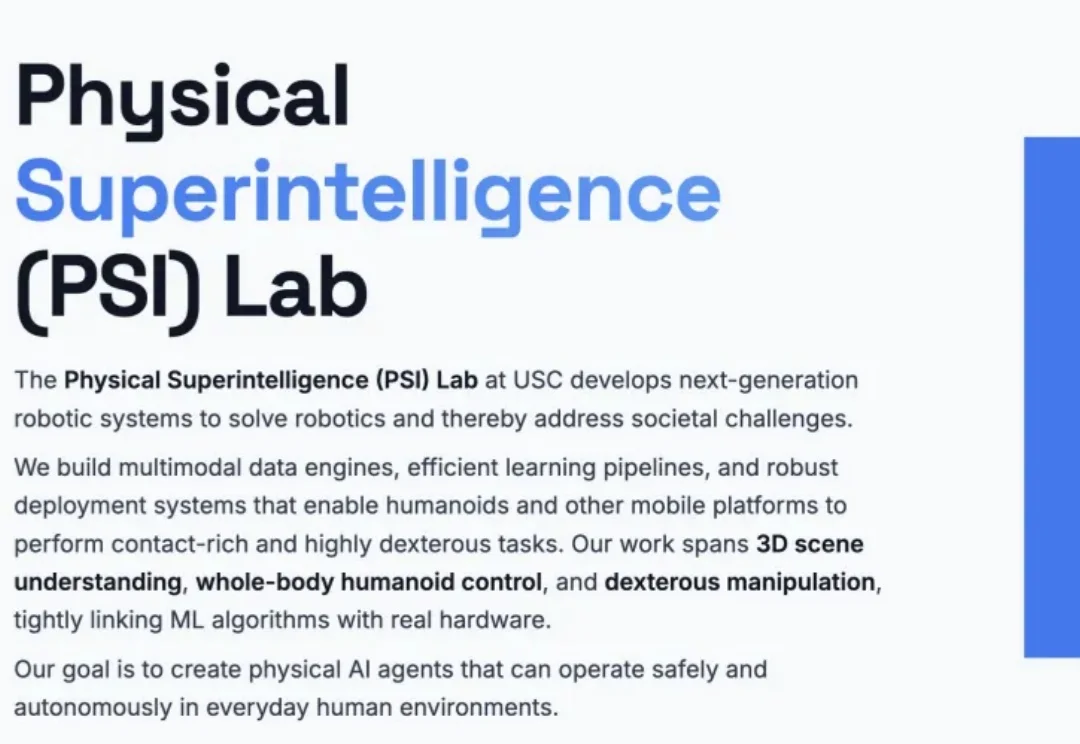

在南加州大学,王越的 PSI Lab(Physical Superintelligence Lab)是过去两三年里具身智能方向上升最快的年轻团队之一。

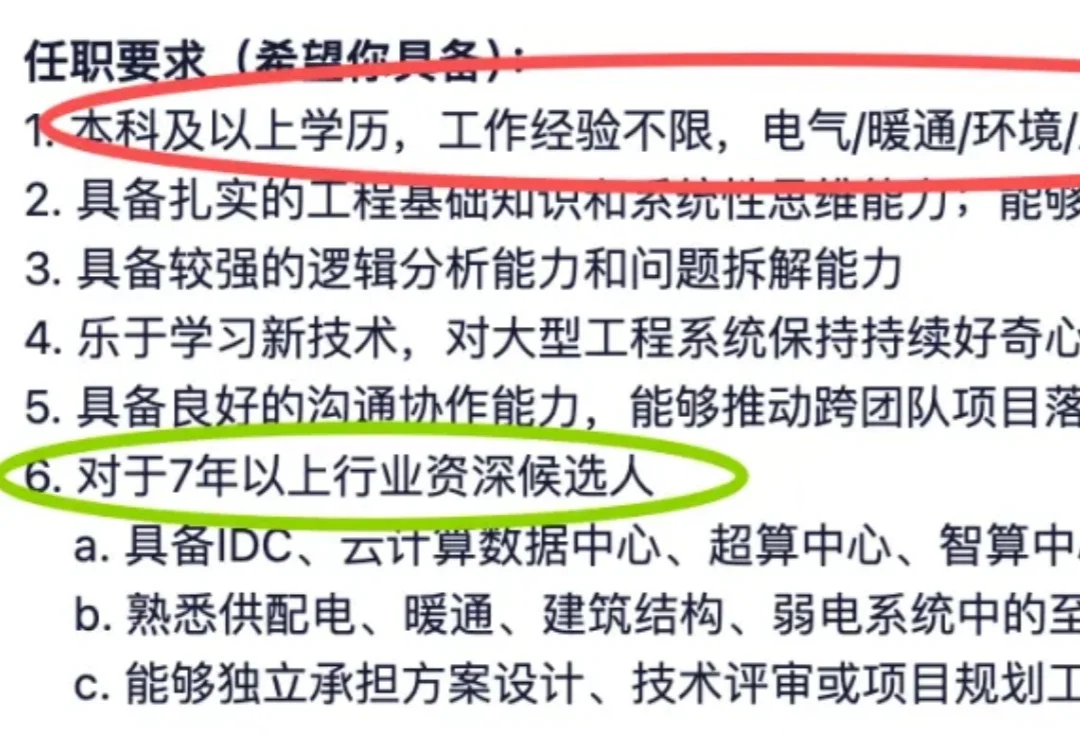

“你将有机会参与从MW(兆瓦)到GW(吉瓦)级基础设施的规划与建设。”

几经波折之后,我们终于将手里的几台 iPhone 都更新到了 iOS 27,体验到了五年以来最重大的一次 Siri 更新。

《读佳》从读者处获悉:我们此前独家曝光的蚂蚁集团新产品Qmuse已经上线,并开始内测,目前支付宝账号是唯一登录方式。该产品由蚂蚁数智信息技术(上海)有限公司(下称“蚂蚁数智”)所有及运营。

Anthropic自家工程师早已基本不写代码了,却280美元一个任务,花钱请约1000名外部工程师,手把手教Claude Code写出好代码。喂养前沿模型的,终究还是人。