吴泳铭全员信官宣:李飞飞任阿里云CTO,阿里AI架构大调整

吴泳铭全员信官宣:李飞飞任阿里云CTO,阿里AI架构大调整就在今天,阿里巴巴集团 CEO 吴泳铭发布全员信,宣布对集团 AI 相关业务进行大刀阔斧的调整。内部信显示,李飞飞出任阿里云 CTO,通义实验室升级为独立事业部,同时成立集团技术委员会统一统筹 AI 技术布局。作为阿里技术体系的核心老将,李飞飞此前主导了阿里云多个核心技术项目

搜索

搜索

就在今天,阿里巴巴集团 CEO 吴泳铭发布全员信,宣布对集团 AI 相关业务进行大刀阔斧的调整。内部信显示,李飞飞出任阿里云 CTO,通义实验室升级为独立事业部,同时成立集团技术委员会统一统筹 AI 技术布局。作为阿里技术体系的核心老将,李飞飞此前主导了阿里云多个核心技术项目

Transformer不保?今天,CMU普林斯顿原班人马杀回,新一代开源架构Mamba-3震撼降临。15亿参数战力爆表,性能比Transformer飙升4%。

终结Transformer的架构即将诞生!奥特曼最新访谈豪言,下一代AI架构彻底颠覆Transformer,LSTM的命运或将再次上演。

最近AI圈又多了一张硬核通行证,Anthropic刚刚在官网发布了Claude首个AI架构师认证。

最近的 Meta 可谓大动作不断,一边疯狂裁人,一边又高强度产出论文。

Transformer之父「叛逃」?8年前掀起AI革命的男人,如今嫌「自己孩子」太吵太卷!当资本狂飙、论文堆积如山,他却高喊:是时候放弃Transformer,重新找回好奇心了。

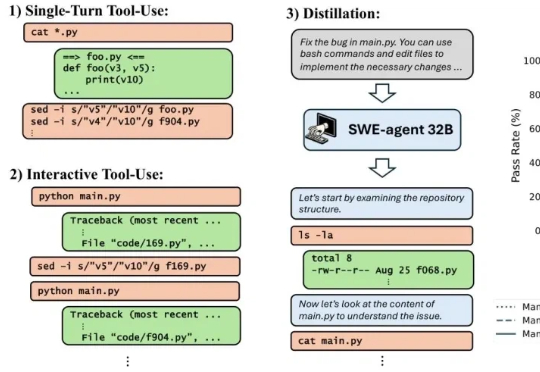

都说苹果AI慢半拍,没想到新研究直接在Transformer头上动土。(doge) 「Mamba+工具」,在Agent场景更能打!

在近日的一次访谈中,Andrej Karpathy深入探讨了AGI、智能体与AI未来十年的走向。他认为当前的「智能体」仍处早期阶段,强化学习虽不完美,却是目前的最优解。他预测未来10年的AI架构仍然可能是类似Transformer的巨大神经网络。

噫吁嚱! 那个昔日叱咤风云的开源框架——TensorFlow,已然是行将就木了。

太夸张!百度办AI“培训班”,大佬都纷纷要来拜师学艺。 刚刚百度举办了首席AI架构师培养计划 (AICA)的第九期开学典礼,一看吓一跳,本期学员里可谓是卧虎藏龙。