ECCV 2024 | 像ChatGPT一样,聊聊天就能实现三维场景编辑

ECCV 2024 | 像ChatGPT一样,聊聊天就能实现三维场景编辑chatGPT,AI,AI 3D,CE3D,扩散模型

chatGPT,AI,AI 3D,CE3D,扩散模型

全自动驾驶系统的纯视觉方案如特斯拉 “Tesla Vision”,仅依赖于摄像头收集的图像数据,旨在实现高效且成本效益高的自动驾驶技术。

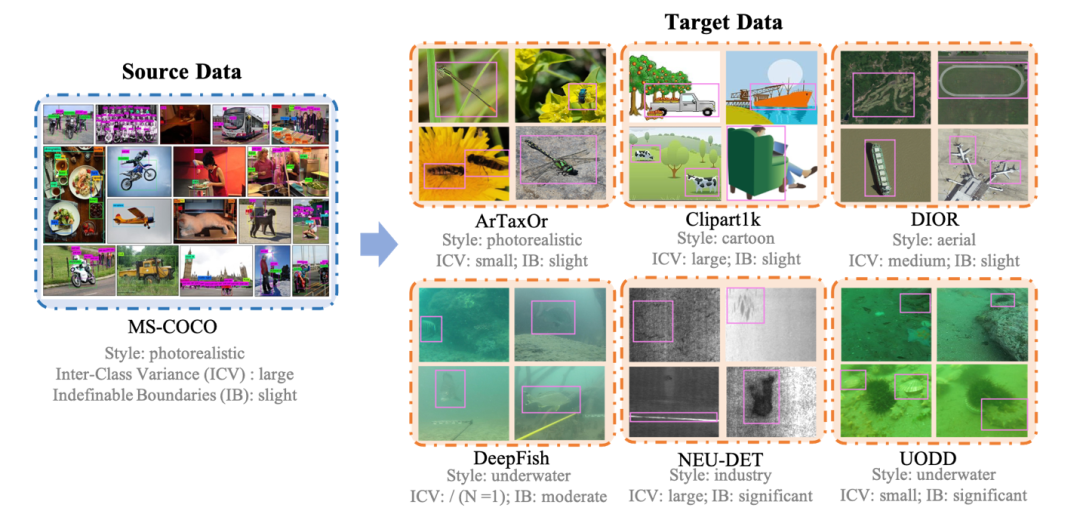

解决跨域小样本物体检测问题,入选ECCV 2024。

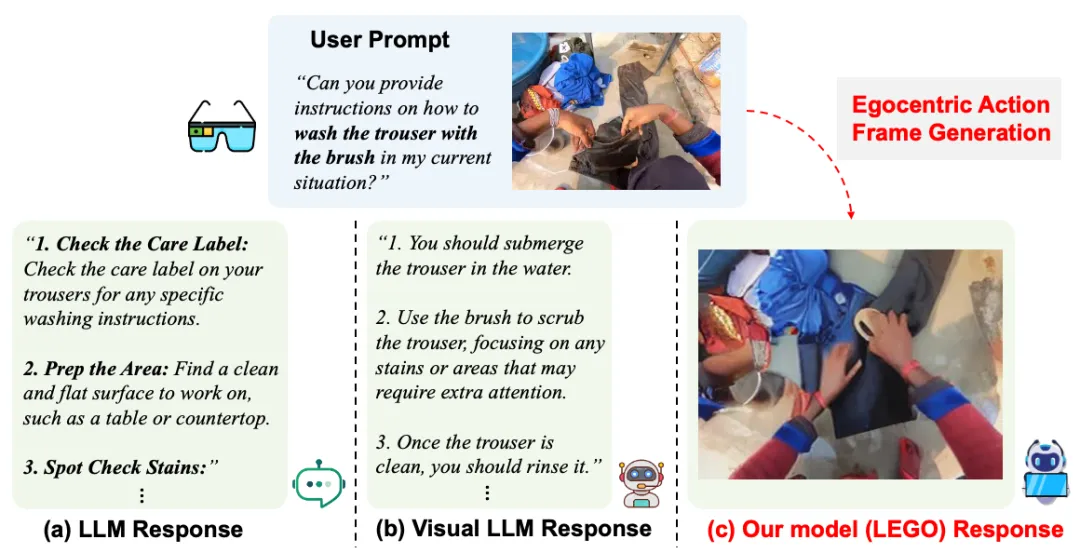

如何基于用户的问题和当前场景的照片,生成同一场景下的第一视角的动作图像,从而更准确地指导用户执行下一步行动?

视觉 / 激光雷达里程计是计算机视觉和机器人学领域中的一项基本任务,用于估计两幅连续图像或点云之间的相对位姿变换。它被广泛应用于自动驾驶、SLAM、控制导航等领域。最近,多模态里程计越来越受到关注,因为它可以利用不同模态的互补信息,并对非对称传感器退化具有很强的鲁棒性。

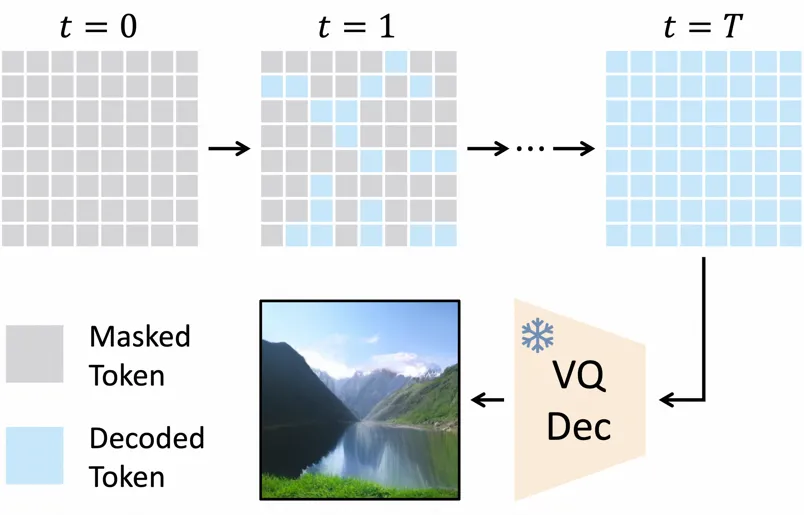

本论文第一作者倪赞林是清华大学自动化系 2022 级直博生,师从黄高副教授,主要研究方向为高效深度学习与图像生成。他曾在 ICCV、CVPR、ECCV、ICLR 等国际会议上发表多篇学术论文。

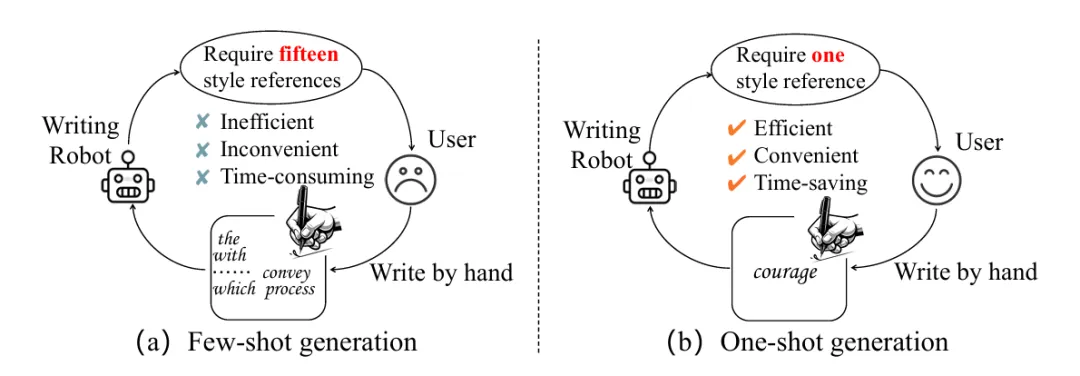

来自华南理工大学、新加坡国立大学、昆仑万维以及琶洲实验室的研究者们提出一种新的风格化手写文字生成方法,仅需提供单张参考样本即可临摹用户的书写风格,支持英文,中文和日文三种文字的临摹。

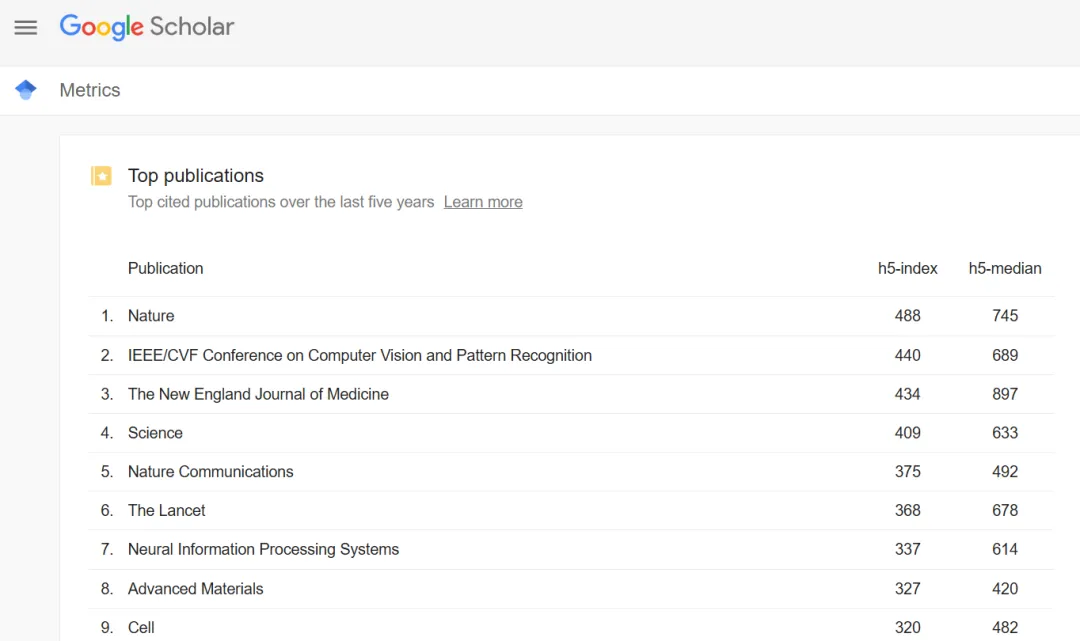

「25篇的上限,还是太多了!」

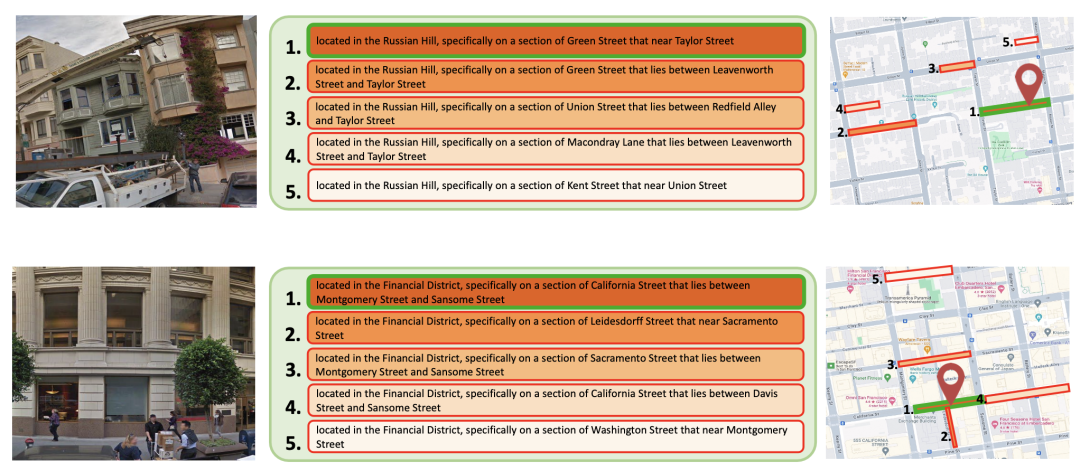

拔草星人的好消息来啦!中科院自动化所和阿里云一起推出了街景定位大模型,只要一张照片就能实现街道级精度的定位。

X-Gaussian是一种新型的3D Gaussian Splatting框架,专为X光新视角合成而设计,以减少医疗成像中的X光辐射剂量,通过高效的渲染技术,能够在保持图像质量的同时显著减少训练时间和提升推理速度。