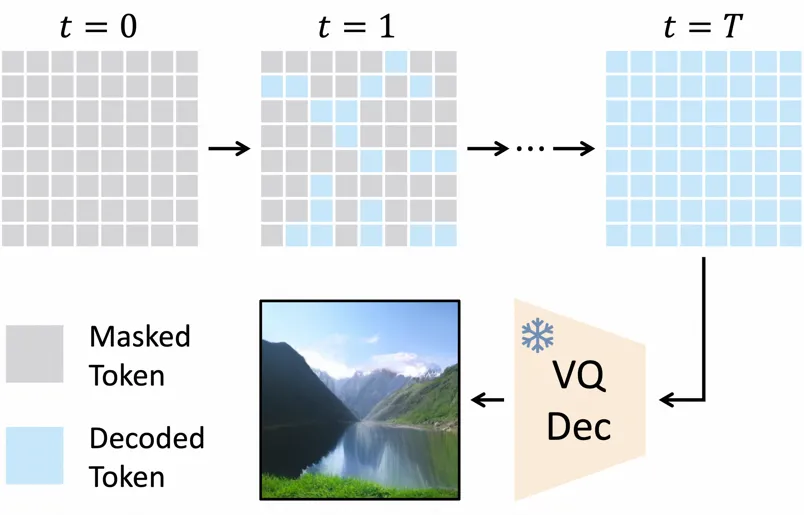

视频、图像、文本,只需基于下一个Token预测:智源Emu3发布,验证多模态模型新范式

视频、图像、文本,只需基于下一个Token预测:智源Emu3发布,验证多模态模型新范式OpenAI 前首席科学家、联合创始人 Ilya Sutskever 曾在多个场合表达观点:只要能够非常好的预测下一个 token,就能帮助人类达到通用人工智能(AGI)。

OpenAI 前首席科学家、联合创始人 Ilya Sutskever 曾在多个场合表达观点:只要能够非常好的预测下一个 token,就能帮助人类达到通用人工智能(AGI)。

近日,来自谷歌和苹果的研究表明:AI模型掌握的知识比表现出来的要多得多!这些真实性信息集中在特定的token中,利用这一属性可以显著提高检测LLM错误输出的能力。

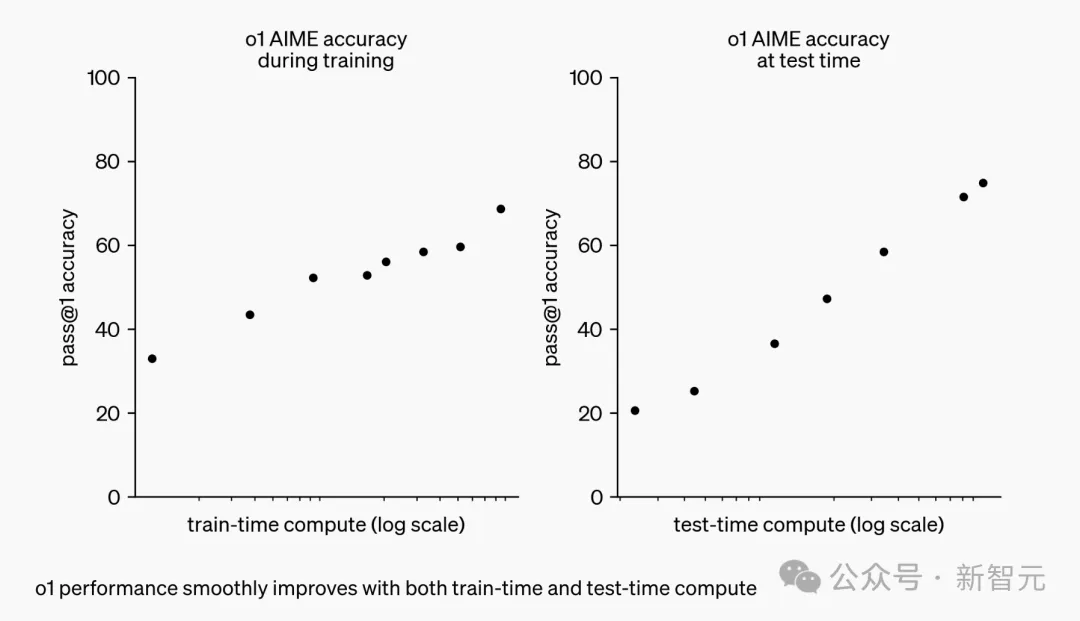

CoT铸就了o1推理王者。 它开创了一种推理scaling新范式——随着算力增加、更长响应时间,o1性能也随之增长。

本论文第一作者倪赞林是清华大学自动化系 2022 级直博生,师从黄高副教授,主要研究方向为高效深度学习与图像生成。他曾在 ICCV、CVPR、ECCV、ICLR 等国际会议上发表多篇学术论文。

OpenAI用o1开启推理算力Scaling Law,能走多远?

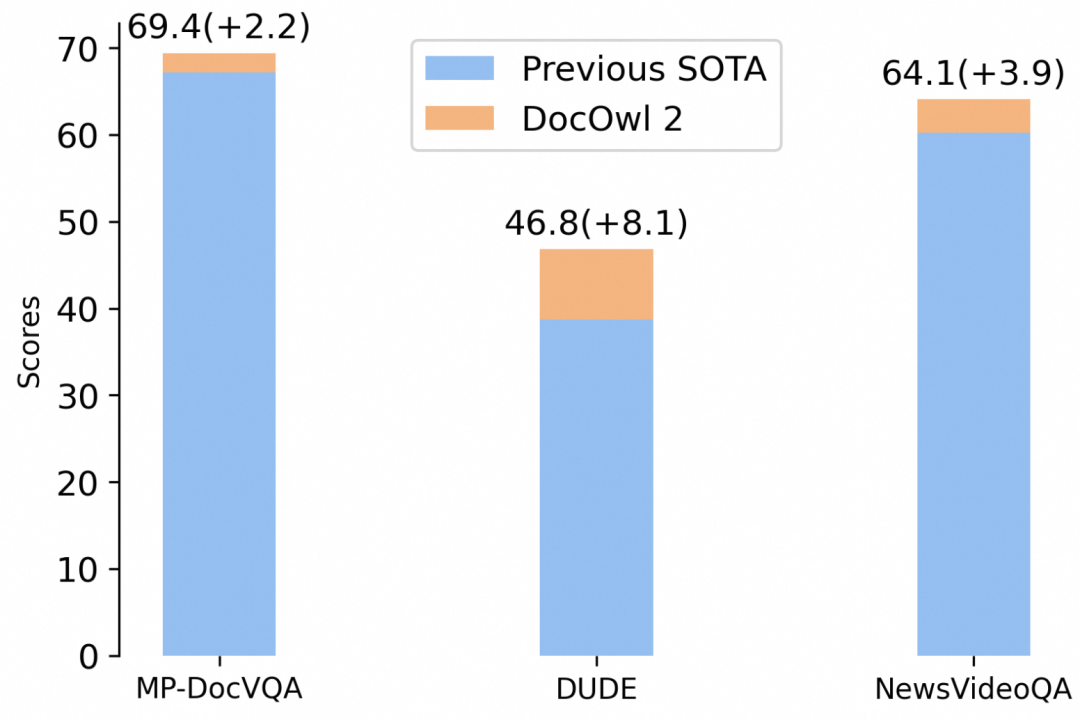

高效多页文档理解,阿里通义实验室mPLUG团队拿下新SOTA。

从大模型爆发到现在,我就一直好奇为什么output token比input token要贵,而且有的会贵好几倍!今天就这个话题和大家聊一聊。

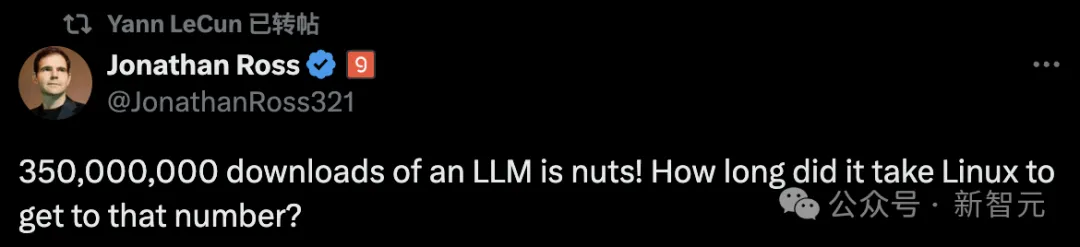

诞生一年半,Llama家族早已稳坐开源界头把交椅。最新报告称,Llama全球下载量近3.5亿,是去年同期的10倍。而模型开源让每个人最深体会是,token价格一降再降。

LLM若以每秒1000+token高速推理,当前最先进的GPU根本无法实现!Cerebras Inference一出世,推理速度赶超英伟达GPU,背靠自研的世界最大芯片加持。而且,还将推理价格打了下来。