ACL 2026|告别冗长思维链!Laser用「概率叠加」重塑多模态大模型隐式推理

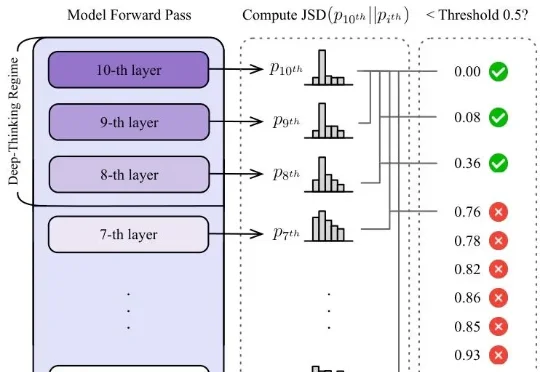

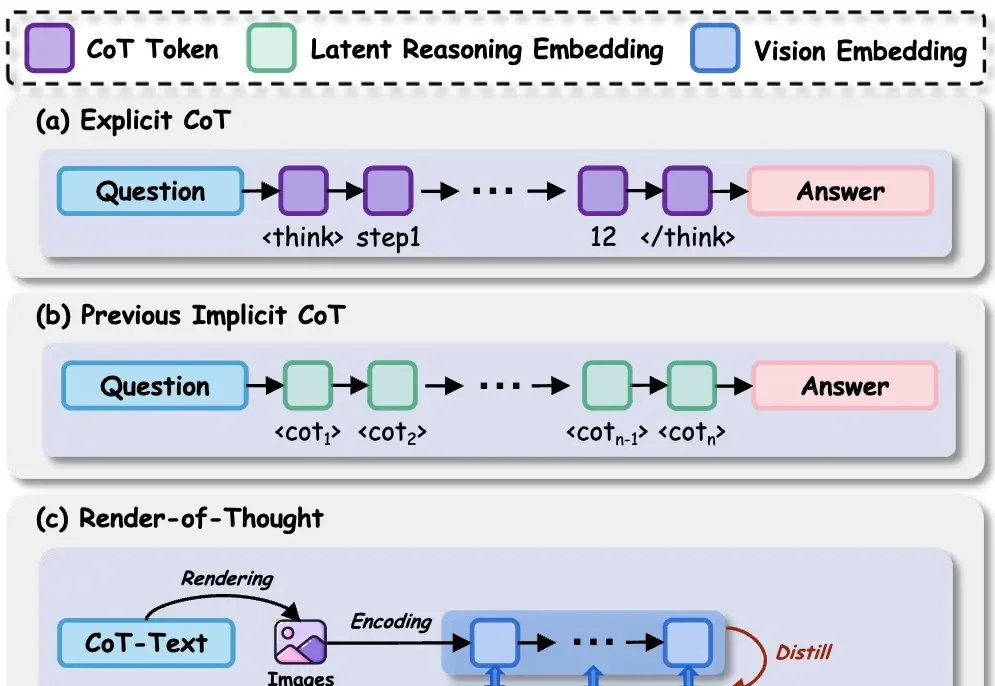

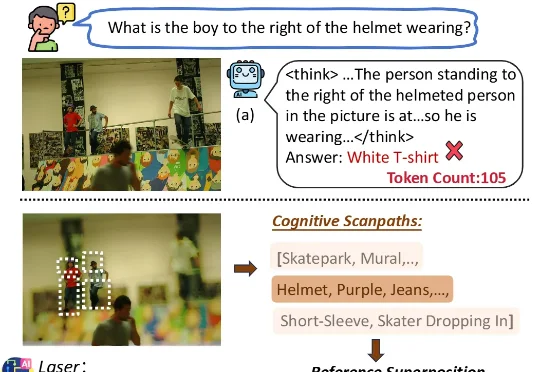

ACL 2026|告别冗长思维链!Laser用「概率叠加」重塑多模态大模型隐式推理为了解决这一痛点,由 MBZUAI、复旦大学、中国人民大学高瓴人工智能学院以及哈佛大学联合组成的研究团队,提出了一种名为 Laser 的全新隐式视觉推理范式。该研究从认知心理学中汲取灵感,引入了 “Forest-before-Trees” 的认知机制,通过动态窗口对齐学习(DWAL),首次实现了在隐空间中维持视觉特征的 “概率叠加” 状态。